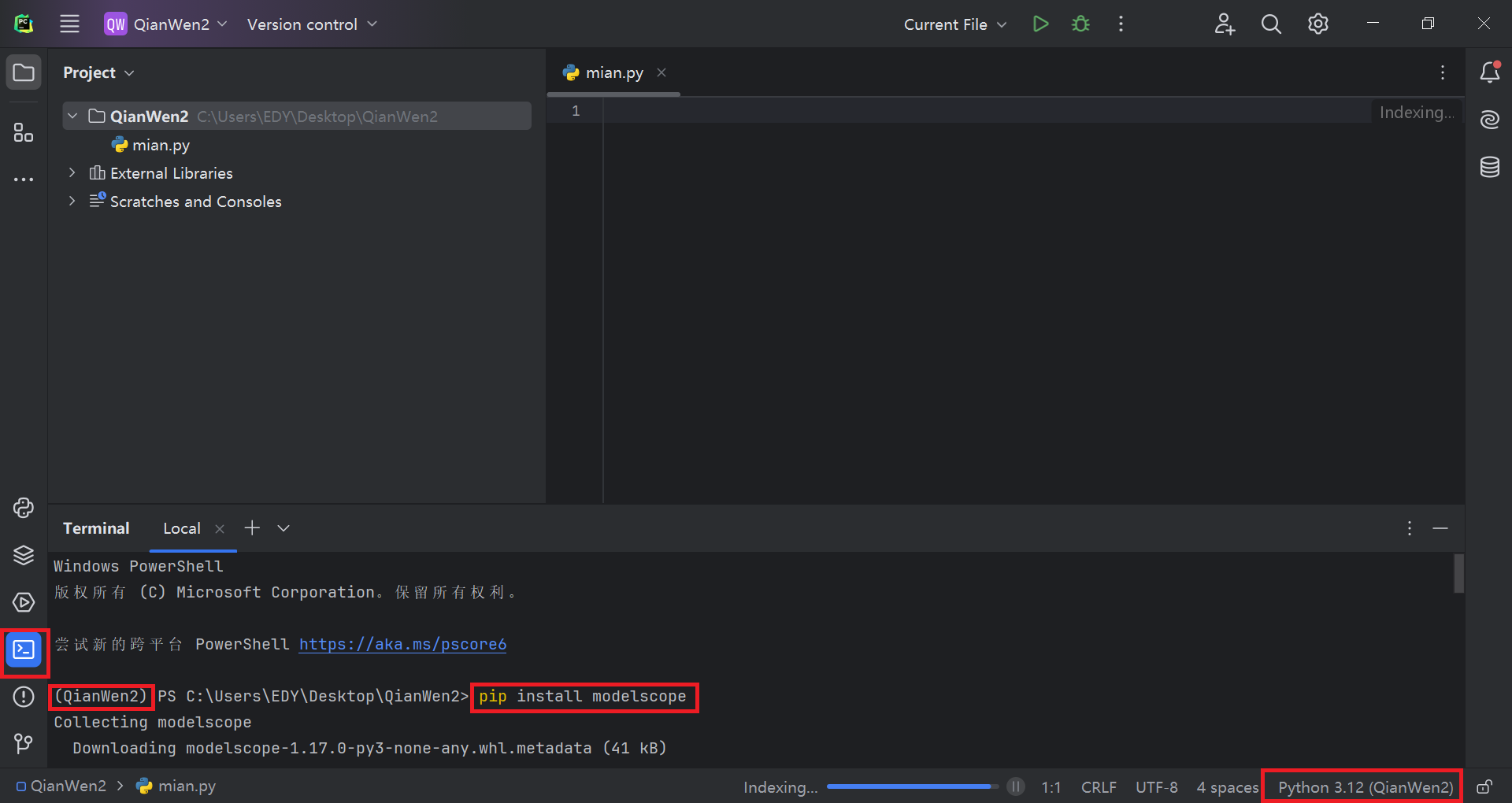

使用Anconda创建一个Python环境,然后使用打开Playcharm创建一个新项目,打开Terminal,激活刚刚创建的环境

conda activate QianWen3

使用PIP指令下载modelscope。

pip install modelscope

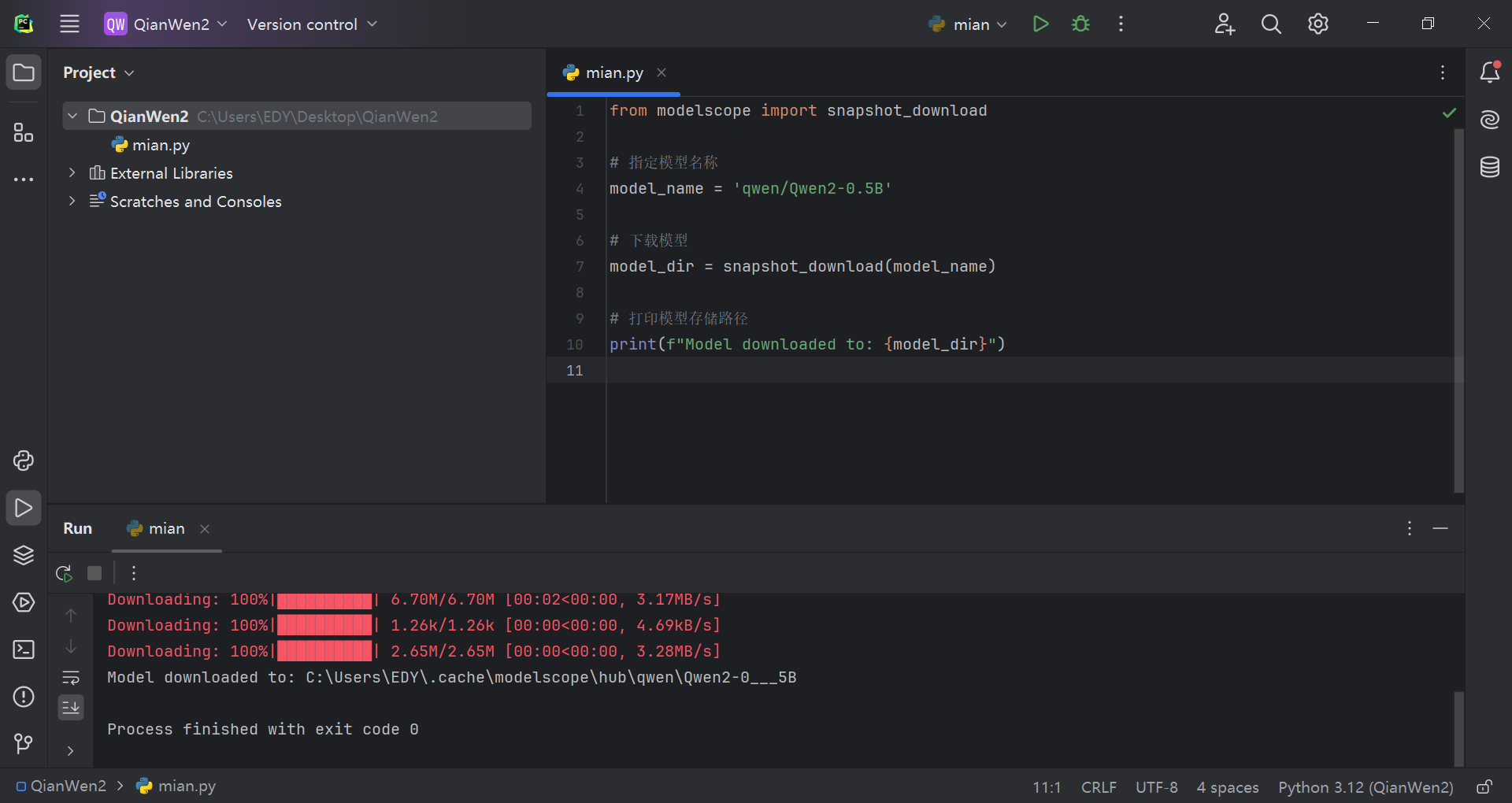

下载QianWen2-0.5B的模型。

from modelscope import snapshot_download

# 指定模型名称

model_name = 'qwen/Qwen2-0.5B'

# 下载模型

model_dir = snapshot_download(model_name)

# 打印模型存储路径

print(f"Model downloaded to: {model_dir}")

注意保存模型的位置,复制下来

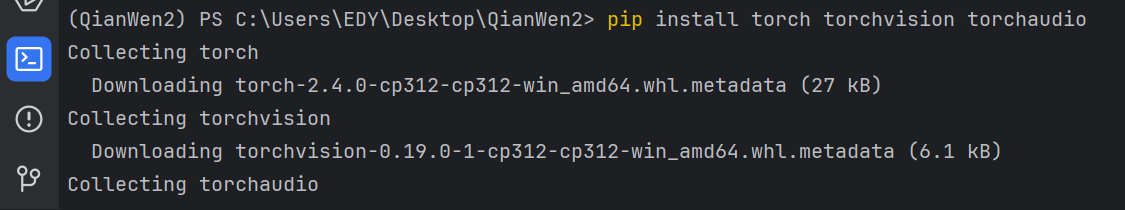

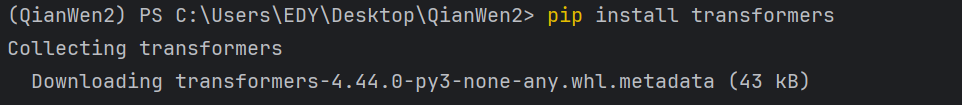

下载Torch库与Transformers库。

这里需要注意版本兼容问题,如果后续代码报错的话,大概率就是版本不兼容。

运行Demo调用存储到本地的大模型。

from transformers import AutoModelForCausalLM, AutoTokenizer

model_dir = r"C:\Users\EDY\.cache\modelscope\hub\qwen\Qwen2-0___5B" # 替换为你的模型目录

tokenizer = AutoTokenizer.from_pretrained(model_dir)

model = AutoModelForCausalLM.from_pretrained(model_dir)

# 输入文本

input_text = "你好,我是一名市场营销专业学生,我正在寻找一份市场营销工作。"

inputs = tokenizer(input_text, return_tensors="pt")

# 生成文本

outputs = model.generate(

inputs['input_ids'],

max_length=100, # 设置合适的长度

pad_token_id=tokenizer.eos_token_id

)

# 解码和打印生成的文本

output_text = tokenizer.decode(outputs[0], skip_special_tokens=True)

print(output_text)

输出结果:

到这里,一个简单的部署本地大模型就部署好了,0.5B的模型在CPU上也可以运行。

1253

1253

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?