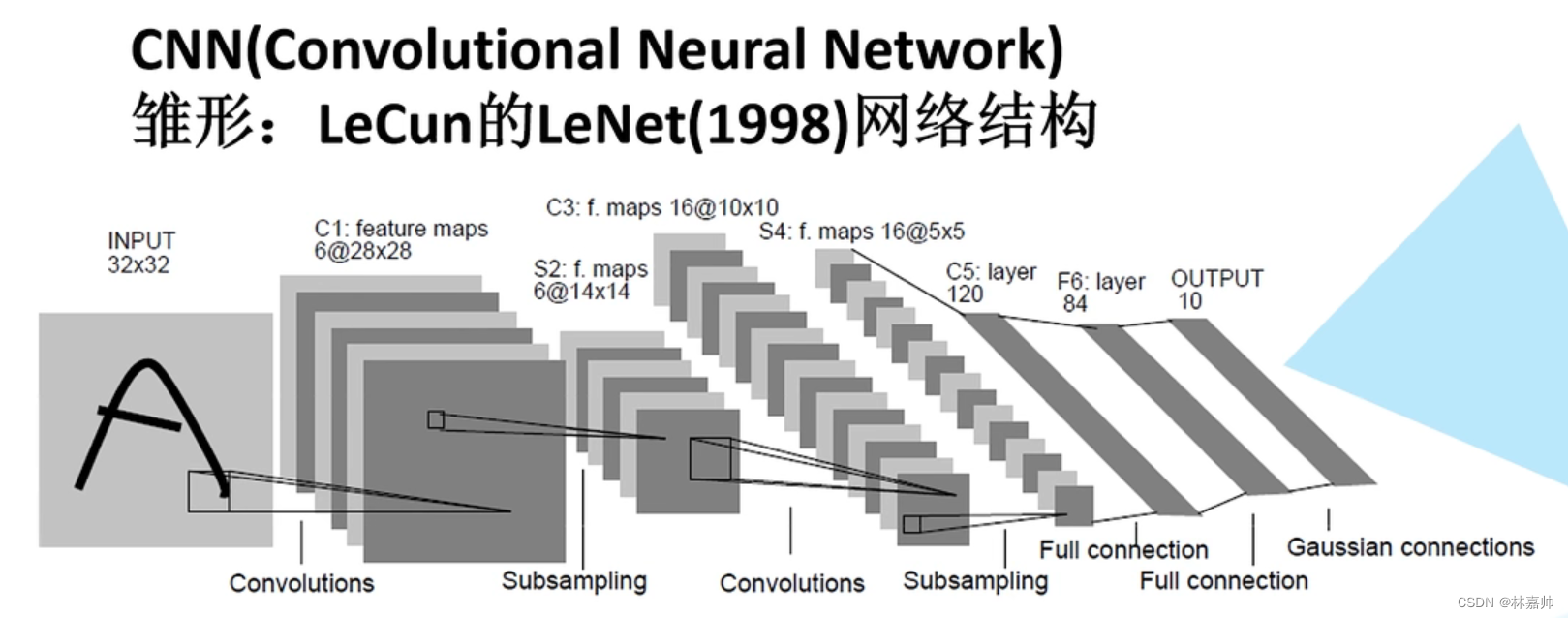

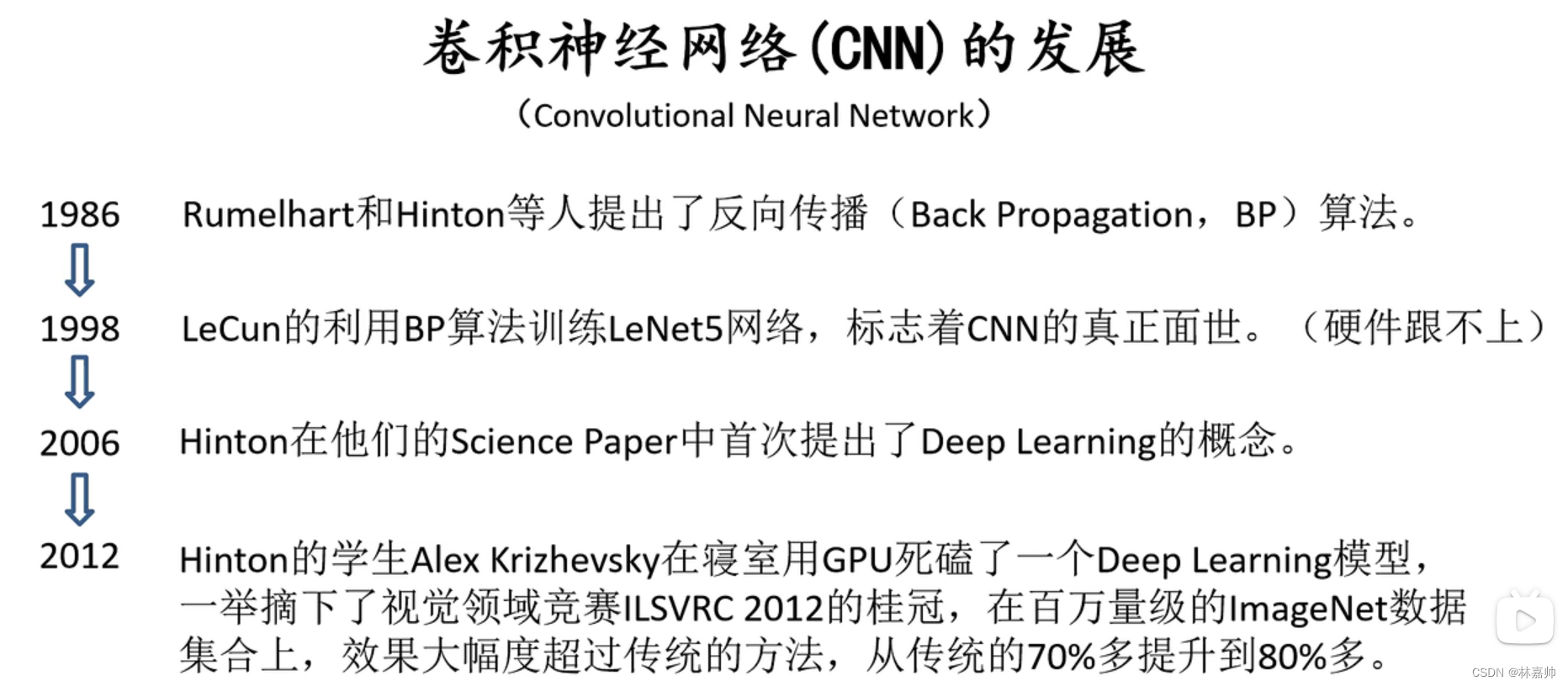

1. 卷积神经网络

- 可以简单理解为包含卷积层的网络就是卷积神经网络

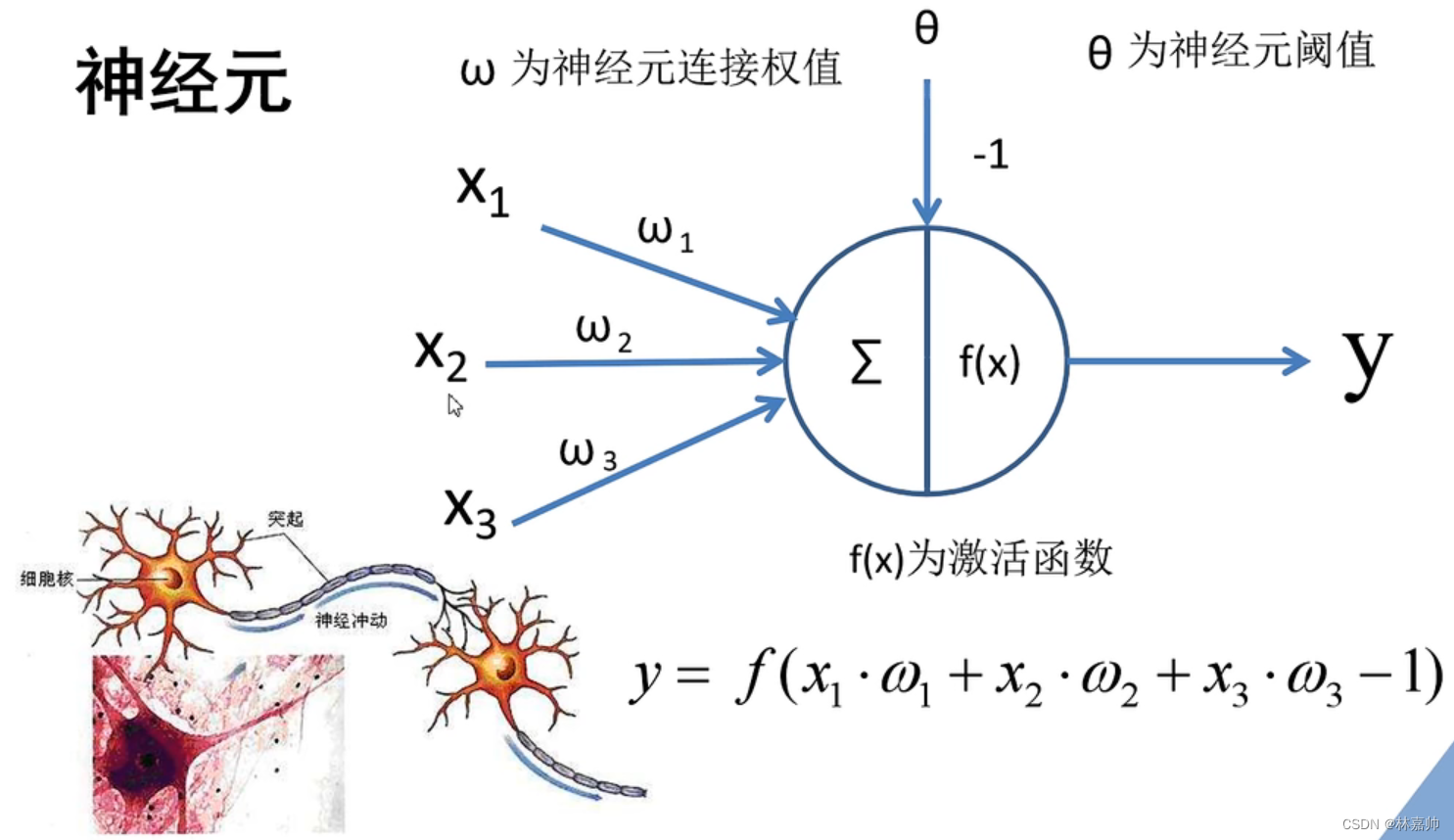

2. 全连接层

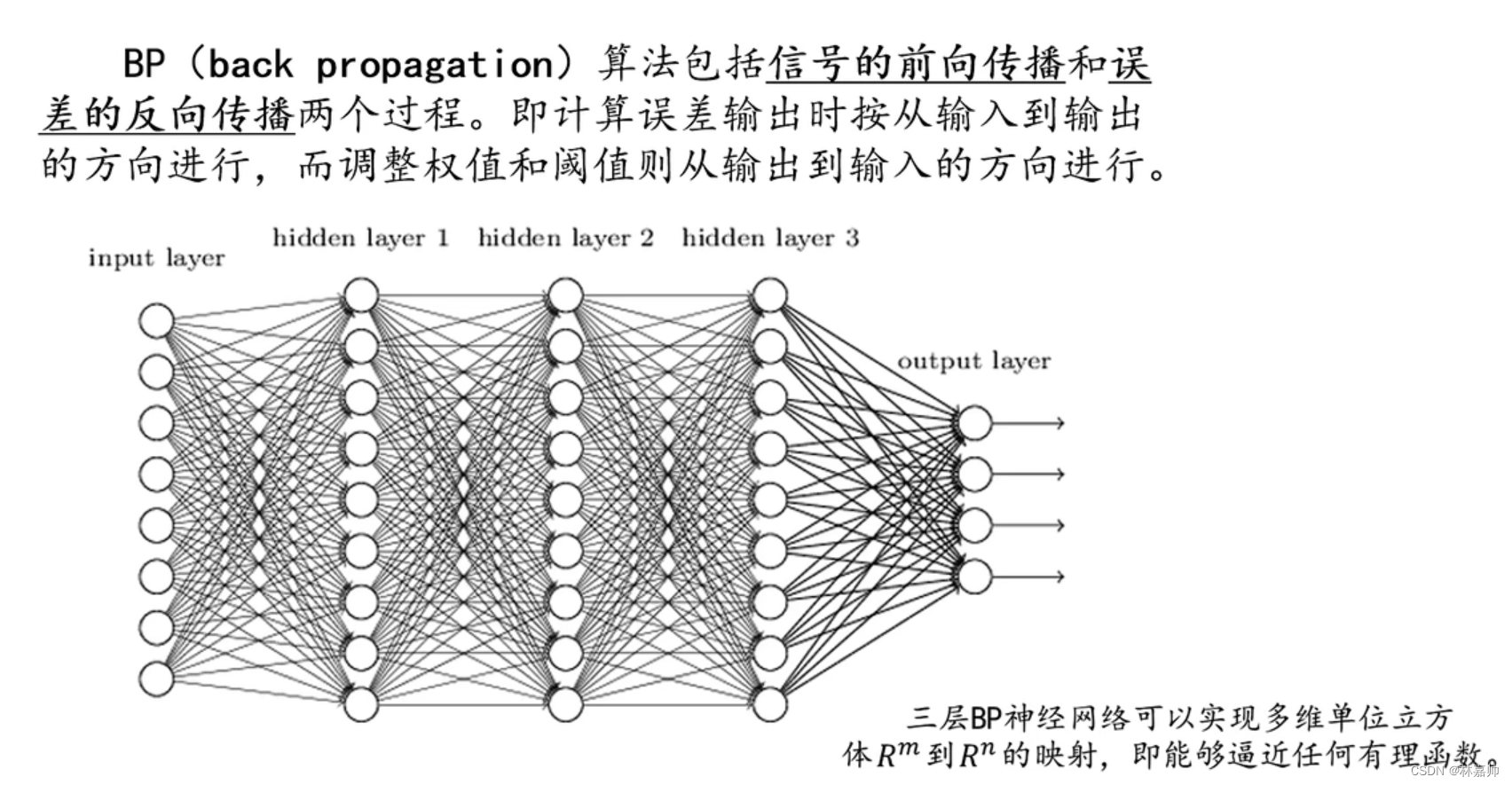

- 将得到输出值和期望输出值做对比,就可以得到一个损失值。

- 通过计算每个节点的偏导数,就能得到其损失梯度

- 将的得到的损失值反向应用到损失梯度上,就达到了反向传播

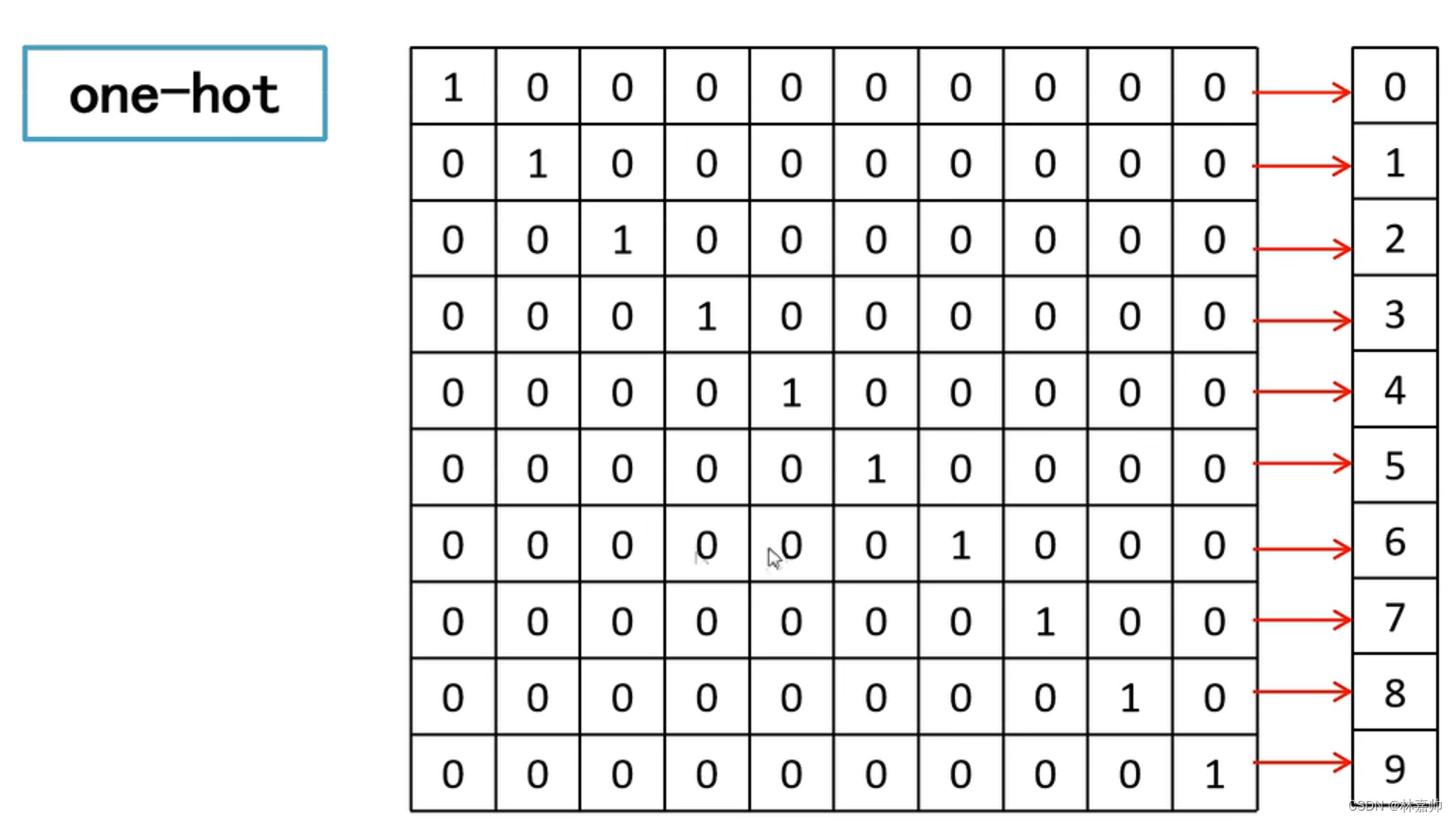

- 每个数字对应位置定为 1,其余为0

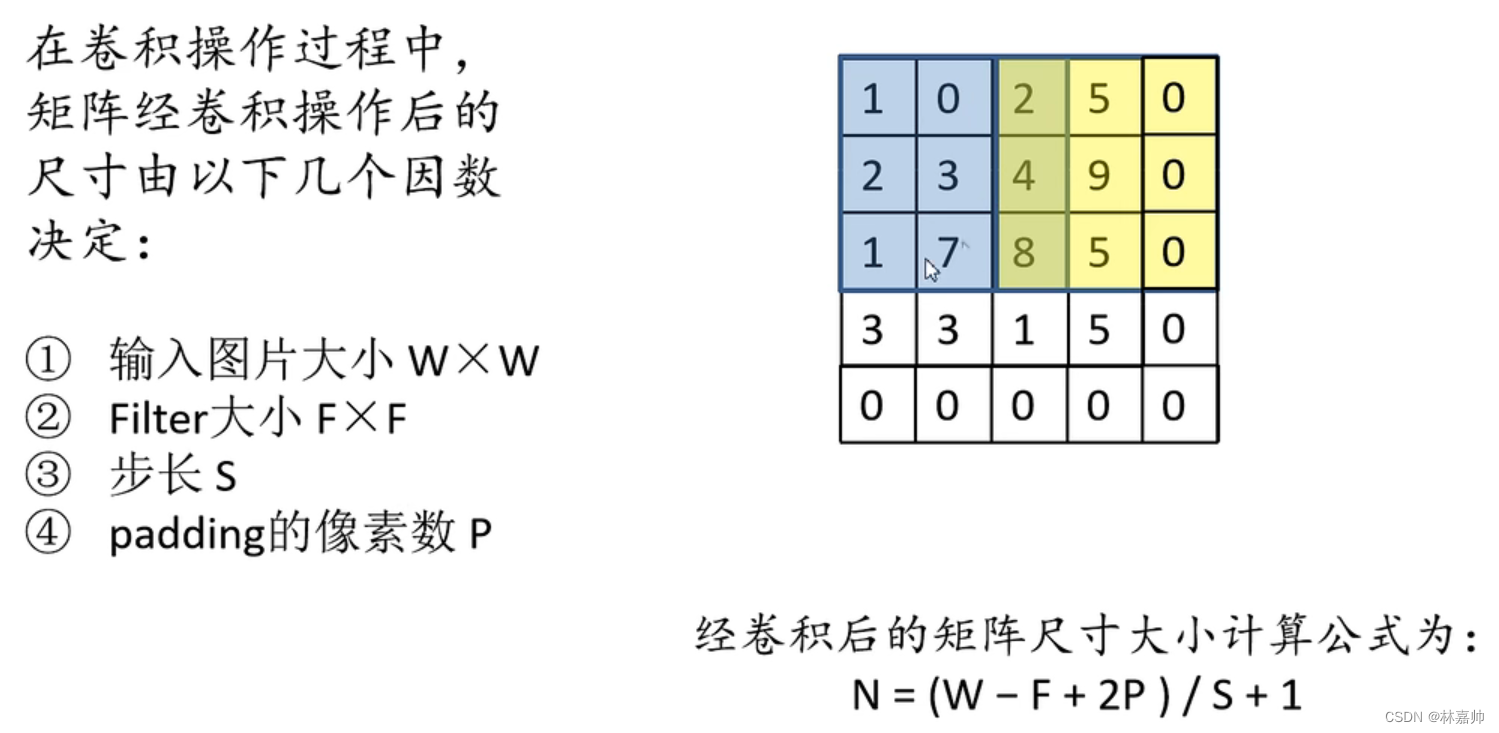

3. 卷积层

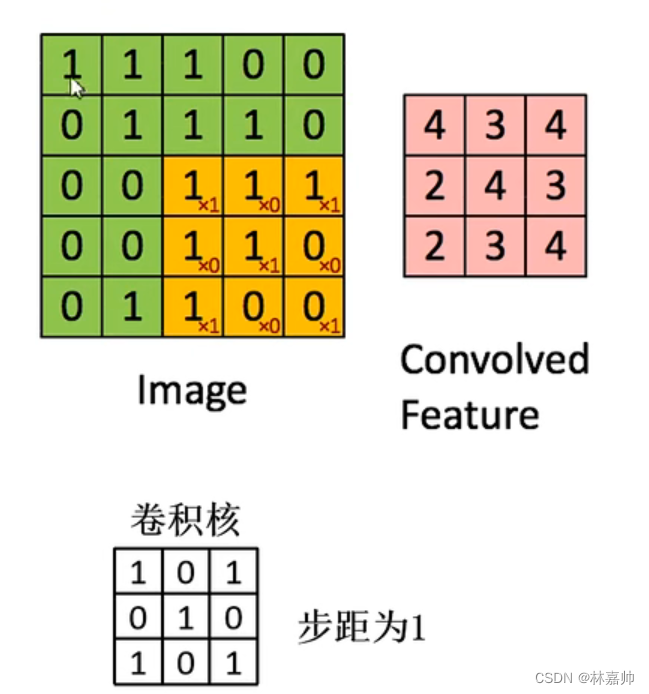

- 将特征层上的值与卷积核上的值对应相乘再相加

- 卷积目的:进行特征提取

《卷积特性》 - 拥有局部感知机制

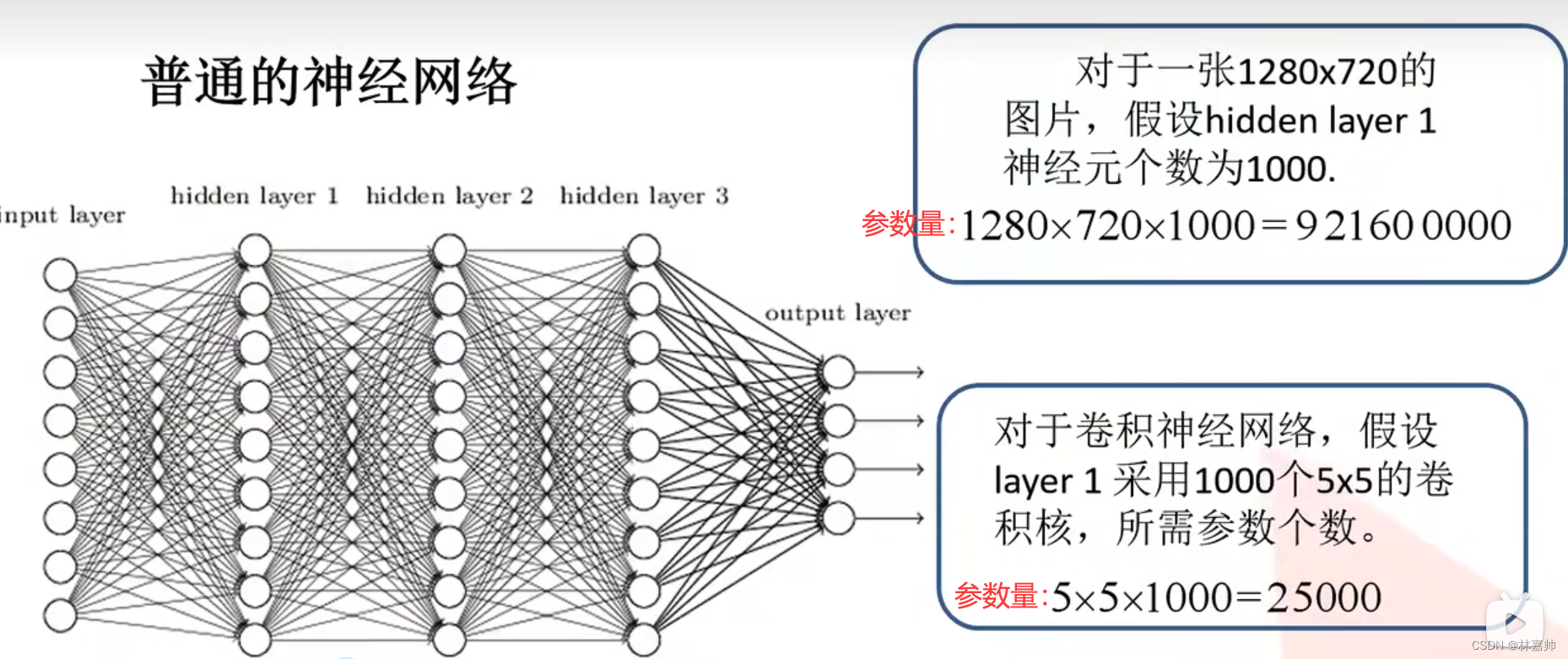

- 权值共享

权值共享的优点: 极大的减少参数量

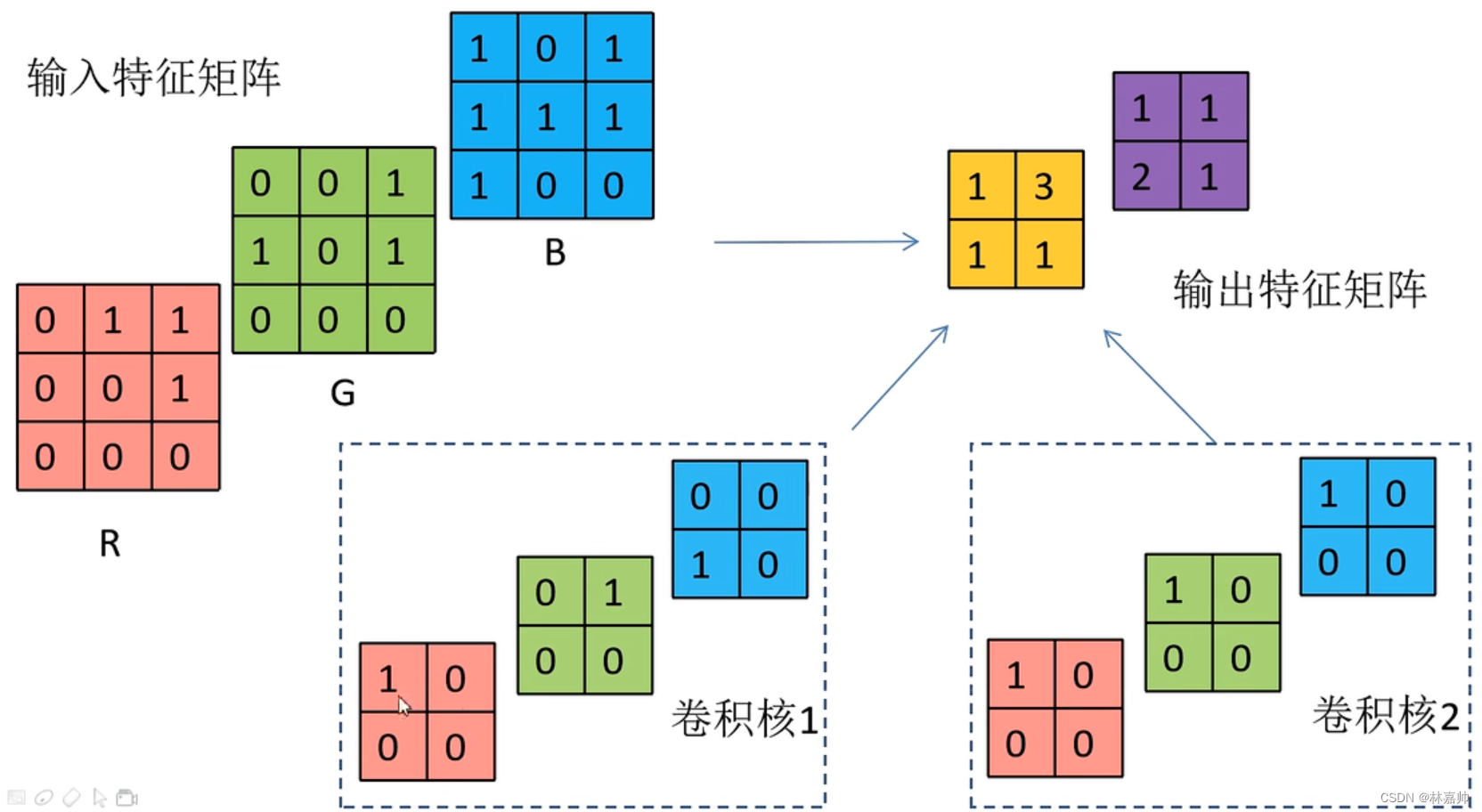

- 输入特征矩阵的个数(此处为3)与卷积核的个数保持一致

- 输出的特征矩阵个数与卷积核维度(2个)相同

问:如果卷积过程中出现越界的情况该怎么办?

答:在周围用0 补齐

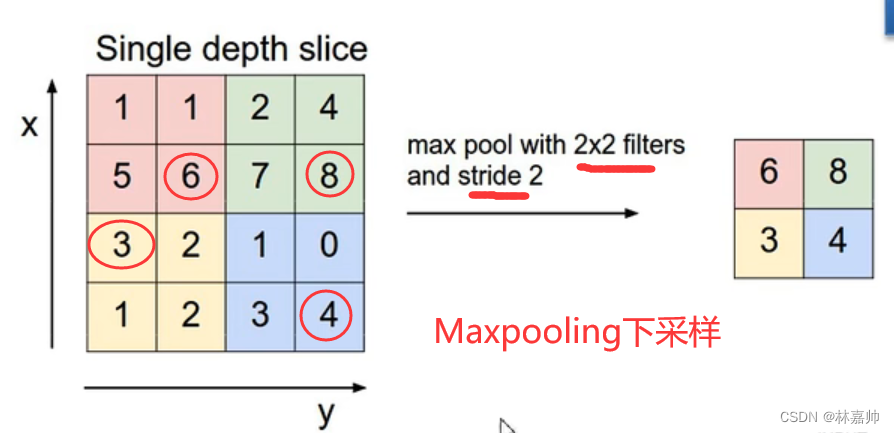

4. 池化层

没有训练参数

只改变特征层矩阵的w和h,不改变channel(深度)

一般poolingsize与stride相同(并非绝对的)

Maxpooling下采样层

目的:对特征图进行稀疏处理,减少数据运算量

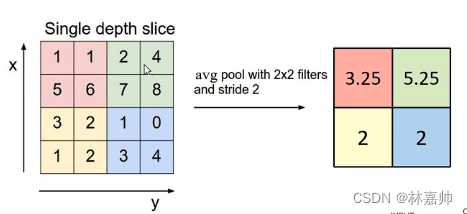

Averagepooling下采样

笔记参考视频:b站:霹雳吧啦Wz

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?