垃圾邮件分类器

1 数据采集:

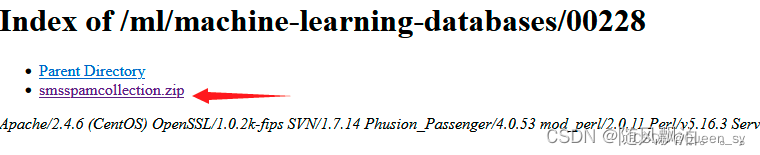

数据集:UCI Machine Learning Repository: SMS Spam Collection Data Set

文件中每一行由两部分组成,行首是标签 spam/ham(spam 代表垃圾邮件),中间空一格,之后是邮件内容

文件中每一行由两部分组成,行首是标签 spam/ham(spam 代表垃圾邮件),中间空一格,之后是邮件内容

import numpy as np #numpy,pandas,matplotlib库需要提前下载

import pandas as pd

from pandas import Series,DataFrame

import matplotlib.pyplot as plt

%matplotlib inline

# 读数据集pd.read_table('./data/SMSSpamCollection')

df=pd.read_csv('./SMSSpamCollection', sep='\t',header=None,names=['laber','text'])

#文件放到了主文件夹下,有别的放到data文件夹中,因情况而已

#names=['laber','text'] 对列的名字进行重命名

#对邮件名字,全部改成小写

df['text']=df['text'].str.lower()

或者

file_path='./SMSSpamCollection' #找到文件

sms=open(file_path,'r',encoding='utf-8') #打开文件,以读的形式,打开文件所用的编码 utf-8

sms_data=[]

sms_label=[]

import csv

csv_reader=csv.reader(sms,delimiter='\t')

for line in csv_reader:

sms_label.append(line[0]) #标签和邮件test进行区分

sms_data.append(line[1])

sms.close() #文件关闭

(补充):csv.reader(file, delimiter=‘\t’),其中 delimiter 代表分隔符,通常根据数据集中相邻元素之间的分隔方式来设定,函数默认每行数据的元素间是以逗号分隔(也可以设置为’\t’)。

csv.reader()返回一个reader对象,利用该对象可以遍历csv文件中的行,从csv文件中读取的每一行都以字符串列表的形式返回。

2 数据清洗

还有数据预处理环节,没有涉及

3 特征工程

#数据集进行划分

from sklearn.model_selection import train_test_split #导入train_test_split方法

X_train, X_test, y_train, y_test = train_test_split(df['text'], df['laber'], test_size=0.3, random_state=42)

# test_size 测试集占整个数据集的比例

或者

#按0.7:0.3比例分为训练集和测试集,再将其向量化

dataset_size=len(sms_data) #总共数据集的长度

trainset_size=int(round(dataset_size*0.7)) #训练集的长度,按7:3比例

print('dataset_size:',dataset_size,' trainset_size:',trainset_size)

x_train=np.array([''.join(el) for el in sms_data[0:trainset_size]])

y_train=np.array(sms_label[0:trainset_size])

#[:]数据切割,0到trainset_size-1行

x_test=np.array(sms_data[trainset_size+1:dataset_size])

y_test=np.array(sms_label[trainset_size+1:dataset_size])

#特征处理

vectorizer=TfidfVectorizer(min_df=2,ngram_range=(1,2),stop_words='english',strip_accents='unicode',norm='l2')

X_train=vectorizer.fit_transform(x_train)

X_test=vectorizer.transform(x_test)

(补充)numpy.array(object, dtype=None)

各个参数意义:

object:创建的数组的对象,可以为单个值,列表,元胞等。

dtype:创建数组中的数据类型。

返回值:给定对象的数组。

4.选择模型并训练

这里使用朴素贝叶斯分类器

model = MultinomialNB()

model.fit(X_train,y_train)

score = model.score(X_test, y_test)

print(score)

因为 sklearn 的高度封装,只需几行代码就可以使用特定算法。我们不需要写出算法的流程,只要知道其功能即可,所以 sklearn 适用于快速构建模型。当然如果想让算法定制性更强,则需要自行构建。

借鉴的文章:

利用NLTK+sklearn进行垃圾邮件分类

【机器学习】贝叶斯分类原理+实战垃圾短信分类-SMSSpamCollection下载数据集

sklearn垃圾邮件识别

2738

2738

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?