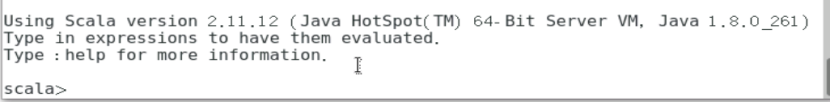

1. 启动Spark-shell

./bin/spark-shell

2. 学习RDD并实验RDD基本操作

Spark RDD支持两种类型的操作:

– 动作(action):在数据集上进行运算,返回计算值。

– 转换(transformation): 基于现有的数据集创建一个新的数据集。

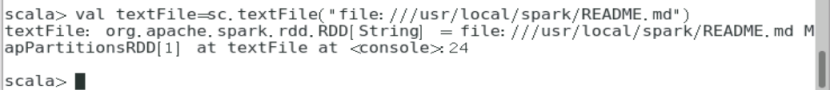

2.1创建RDD

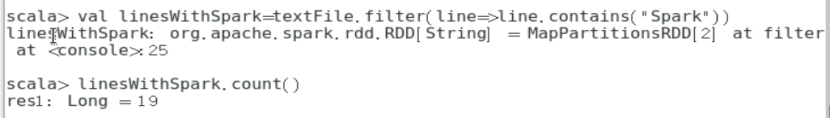

2.2使用action API - count()可以统计该文本文件的行数

2.3 使用transformation API - filter()可以筛选出只包含Spark的行

2.4 实现词频统计(WordCount)

首先使用flatMap()将每一行的文本内容通过空格进行划分为单词;

再使用map()将单词映射为(K,V)的键值对,其中K为单词,V为1;

最后使用reduceByKey()将相同单词的计数进行相加,最终得到该单词总的出现的次数。

1443

1443

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?