1.导入库

import random

import torch

from d2l import torch as d2l

#d2l的库也就是在动手深度学习中这本书上调动运用到,在往后的编程中几乎用不到

生成数据集

因为要进行一个线性回归,所以用下列代码生成一个包含1000个数据样本的数据集,且每个样本中包含从标准正态分布中采取2个特征值,然后合成一个1000*2的矩阵–X。

然后规定线性模型参数w和b的值,以及噪声项。

将噪声项视为模型预测和标签时的潜在观测误差。 在这里我们认为标准假设成立,即服从均值为0的正态分布。 为了简化问题,我们将标准差设为0.01。 下面的代码生成合成数据集。

def synthetic_data (w,b,num_examples):

“”“生成y=Xw+b+噪声”“”

x = torch.normal(0,1,(num_examples,len(w))) #生成x的正态随机分布 且数据长度等于w

y = torch.matmul(x,w)+b

y +=torch.normal(0,0.01,y.shape) #生成y的正态随机分布

return x,y.reshape((-1,1)) #表示(任意行,1列) reshape(行数,列数)常用来更改数据的行列数目

true_w = torch.tensor([2,-3.4])

true_b = 4.2

features,labels = synthetic_data(true_w,true_b,1000)

print('features:', features[0],'\nlabel:', labels[0])

输出结果:

注意,features中的每一行都包含一个二维数据样本, labels中的每一行都包含一维标签值(一个标量)。

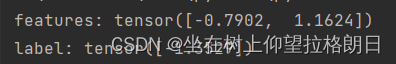

生成特征features[:, 1],features[:, 0]和labels的散点图, 可以直观观察到两者之间的线性关系。

d2l.set_figsize()

d2l.plt.scatter(features[:,(1)].detach().numpy(),labels.detach().numpy(),1);

d2l.plt.scatter(features[:,(0)].detach().numpy(),labels.detach().numpy(),1);

d2l.plt.show()

输出结果:

读取数据

在进行神经网络的训练时候必须要对数据进行遍历,每次抽取一个小部分,并且用他们来更新我们的模型,这是机器学习的基础,也是有必要定义一个函数—打乱数据集中的样本来以小批量方式获取数据。

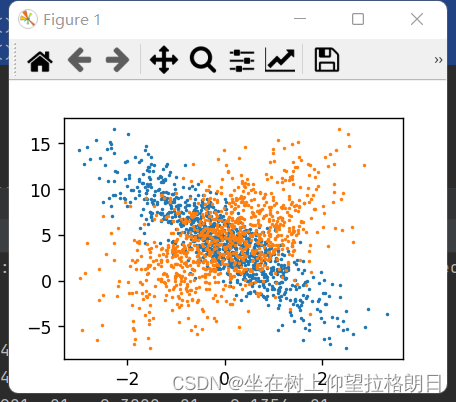

下面定义一个data_iter函数,接受批量大小,特征矩阵和标签向量作为输入。生成大小为

batch_size的小批量。每个小批量包含一组特征和标签。

代码:

def data_iter(batch_size,feacures,labels):

num_examples = len(features)

indices = list(range(num_examples))

# 这些样本是随机读取的,没有特定的顺序

random.shuffle(indices)

for i in range(0,num_examples,batch_size):

batch_indices = torch.tensor(

indices[i:min(i + batch_size,num_examples)])

yield feacures[batch_indices],labels[batch_size]

batch_size = 10 #小批量每次处理的数据为10个

for x, y in data_iter(batch_size, features, labels):

print(x, '\n', y)

break

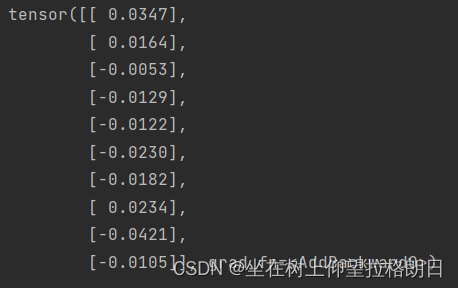

输出结果:

初始化模型参数

开始用小批量随机梯度下降优化我们的模型参数之前, 我们需要先有一些参数。 在下面的代码中,我们通过从均值为0、标准差为0.01的正态分布中采样随机数来初始化权重, 并将偏置初始化为0。

w = torch.normal(0, 0.01, size=(2,1), requires_grad=True)

b = torch.zeros(1, requires_grad=True)

在初始化参数之后,我们的任务是更新这些参数,直到这些参数足够拟合我们的数据。 每次更新都需要计算损失函数关于模型参数的梯度。 有了这个梯度,我们就可以向减小损失的方向更新每个参数。

定义模型

在进行前面的准备工作后,下面开始定义模型,

代码:

def linreg(x, w, b): #@save

"""线性回归模型"""

return torch.matmul(X, w) + b

print(linreg(x,w,b))

输出:

定义优化模型``

用梯度下降法,求梯度下降最快的方向。在每一步中,使用从数据集中随机抽取的一个小批量,然后根据参数计算损失的梯度。 接下来,朝着减少损失的方向更新我们的参数。 下面的函数实现小批量随机梯度下降更新。 该函数接受模型参数集合、学习速率和批量大小作为输入。每 一步更新的大小由学习速率lr决定。 因为我们计算的损失是一个批量样本的总和,所以我们用批量大小(batch_size) 来规范化步长,这样步长大小就不会取决于我们对批量大小的选择。

def squared_loss(y_hat, y):

"""均方损失"""

return (y_hat - y.reshape(y_hat.shape)) ** 2 / 2

def sgd(params, lr, batch_size): #@save

"""小批量随机梯度下降"""

with torch.no_grad():

for param in params:

param -= lr * param.grad / batch_size

param.grad.zero_()

训练

准备好了模型训练所有需要的要素,可以实现主要的训练过程部分了。 理解这段代码至关重要,因为从事深度学习后, 你会一遍又一遍地看到几乎相同的训练过程。 在每次迭代中,我们读取一小批量训练样本,并通过我们的模型来获得一组预测。 计算完损失后,我们开始反向传播,存储每个参数的梯度。 最后,我们调用优化算法sgd来更新模型参数。

在每个迭代周期(epoch)中,我们使用data_iter函数遍历整个数据集, 并将训练数据集中所有样本都使用一次(假设样本数能够被批量大小整除)。 这里的迭代周期个数num_epochs和学习率lr都是超参数,分别设为3和0.03

lr = 0.03

num_epochs = 3

net = linreg

loss = squared_loss

for epoch in range(num_epochs):

for x, y in data_iter(batch_size, features, labels):

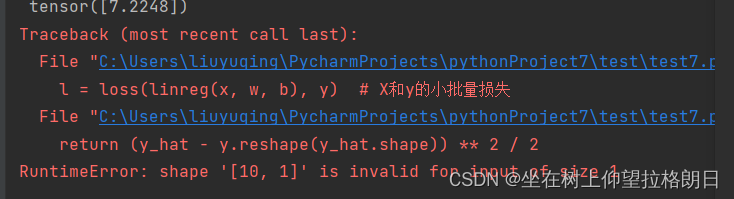

l = loss(net(x, w, b), y) # X和y的小批量损失

# 因为l形状是(batch_size,1),而不是一个标量。l中的所有元素被加到一起,

# 并以此计算关于[w,b]的梯度

l.sum().backward()

sgd([w, b], lr, batch_size) # 使用参数的梯度更新参数

with torch.no_grad():

train_l = loss(net(features, w, b), labels)

print(f'epoch {epoch + 1}, loss {float(train_l.mean()):f}')

最后输出结果出现问题!!!!

756

756

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?