最开始要安装好idea和maven,Maven的安装

首先选中file new project 创建一个项目。

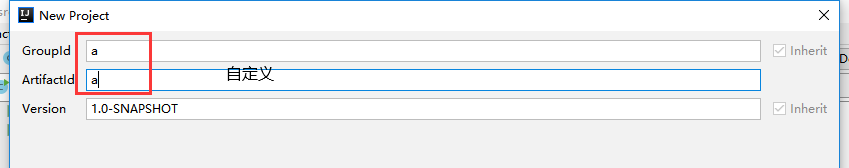

选中Maven项目,这个时候是没有jdk的,我们紫旭耀添加jdk进去即可:找到本机的jdk地址。

给定项目名。下一步

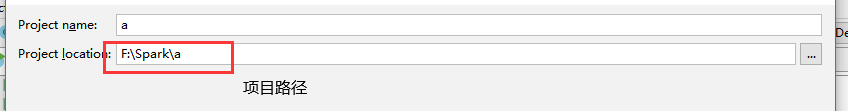

选择项目存放路径,finish创建即可

同样的在file下打开项目设置:

打开后,先看一下jdk是否配置好

同理,添加jdk

添加Scala sdk,在这里可能会没有新建Scala sdk这个选项。

添加效果示意图如下:找到安装Scala的地址,里面包含了bin目录的这一层。

如果没有新建Scala sdk就需要在file --> setting当中打开。搜索Scala这个插件,点击install安装,在这里是安装过的了,

install这个插件之后,重启idea,再一次就可以新建Scala sdk了,新建完成之后就可以进行代码编写了,先配置pom.xml文件

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>TestMaven</groupId>

<artifactId>cn.lilcol</artifactId>

<version>1.0-SNAPSHOT</version>

<!--aliyun外的仓库-->

<repositories>

<repository>

<id>hortonworks</id>

<url>https://repo.hortonworks.com/content/repositories/releases/</url>

</repository>

</repositories>

<!--具体依赖-->

<dependencies>

<!--spark-core_2.11:https://repo.hortonworks.com/content/repositories/releases/-->

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.11</artifactId>

<version>2.3.2.3.1.0.0-78</version>

</dependency>

<!--spark-streaming_2.11:https://repo.hortonworks.com/content/repositories/releases/-

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-streaming_2.11</artifactId>

<version>2.3.2.3.1.0.0-78</version>

</dependency>

<!--spark-sql_2.11:https://repo.hortonworks.com/content/repositories/releases/-->

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-sql_2.11</artifactId>

<version>2.3.2.3.1.0.0-78</version>

</dependency>

</dependencies>

</project>

在左侧项目栏当中就可以看到项目的环境:

在main文件夹下新建一个Scale文件夹,用于存放scala代码,并且对文件夹进行处理,如下图:

最后在java文件夹下新建java类,在Scala文件下新建Scala类

并且编写类当中的代码用于测试:

Java代码段

public class Test {

public static void main(String[] args) {

System.out.print("hello world");

}

}

Scala代码段

object Demo {

def main(args: Array[String]): Unit = {

val s="hello,湖南"

println(s)

}

}

java代码和Scala代码直接运行即可:java代码省略,以下是Scala代码运行效果图

373

373

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?