安装scrapy库

pip install scrapy

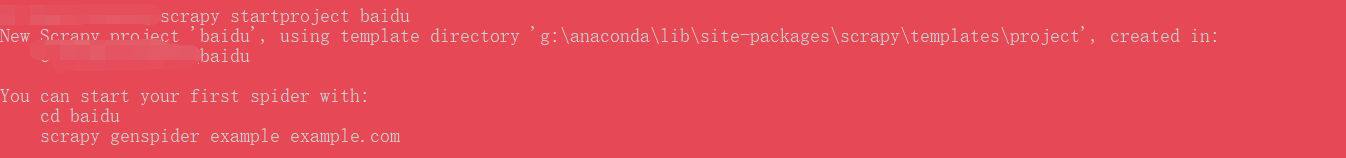

项目的创建

在cmd明命令下输入scrapy startproject 项目名

例如

scrapy startproject baidu

创建完成

设置编译环境

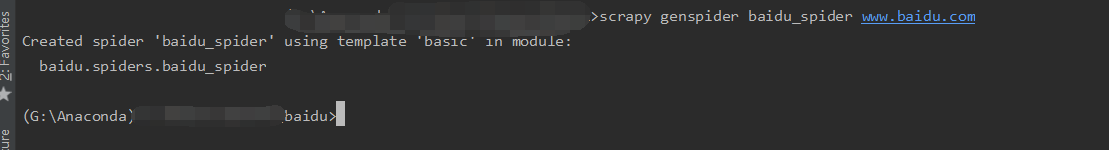

新建模板

Scrapy genspider [spider名称] [爬取网址]

打开这个文件

文件内容如下

# -*- coding: utf-8 -*-

import scrapy

class BaiduSpiderSpider(scrapy.Spider):

name = 'baidu_spider'

allowed_domains = ['www.baidu.com']

start_urls = ['http://www.baidu.com/']

# 处理下载器传送过来的response

def parse(self, response):

# response.text str类型

# response.body bytes类型

pass

#name:spider名称,在后面启动spider爬虫的时候需要使用

#allowed_domains:二次请求

#start_urls:需要让scrapy开始爬取的url

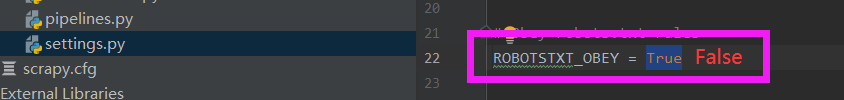

更改setting

1.不遵守robots协议

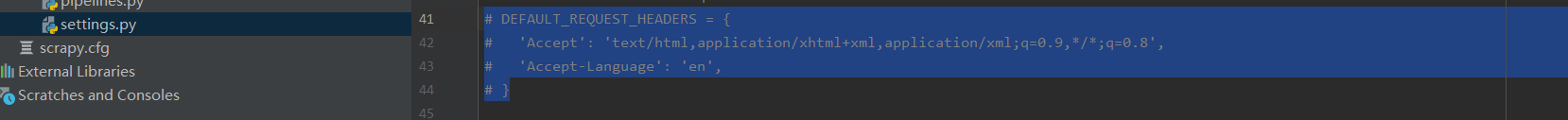

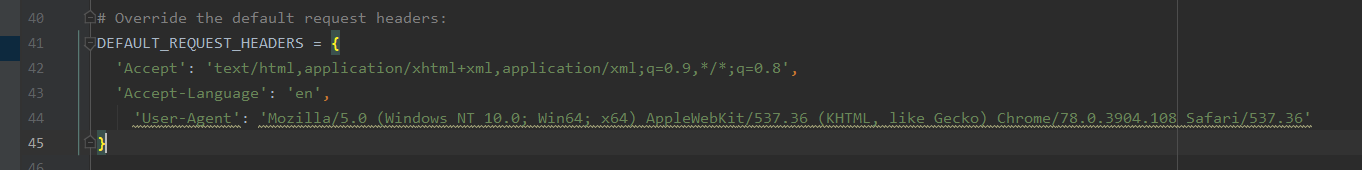

设置请求头

添加headers并取消注释

如下图

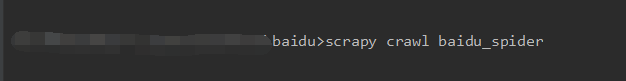

运行scrapy项目

scrapy crawl spider名称

我们运行刚才创建的baidu_spider

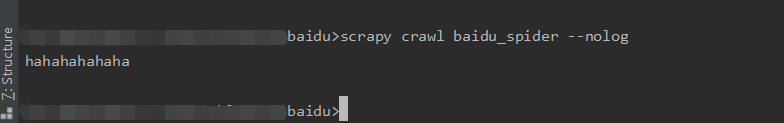

加上 --nolog可以不打印日志文件

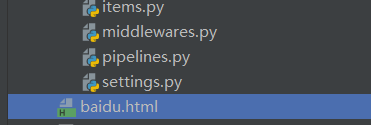

可以看出我们多了一个baidu.html的文件

8398

8398

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?