Spark安装部署

1、安装

下载Spark安装包

下载地址:http://spark.apache.org/downloads.html

Local模式安装部署

使用CDH5.14.0-Spark2.2版本

第一步:解压

tar -zxvf spark-2.2.0-bin-2.6.0-cdh5.14.0.tgz -C …/servers/

第二步:开箱即用(local模式)

进入spark-shell方式

1、Spark-shell

2、Spark-shell --master local[*]

*表示使用当前机器上所有可用的资源

3、Spark-shell --master local[n]

数字N表示在本地模拟N个线程来运行当前任务

本地数据计算

val textFile = sc.textFile(“file:export/pot/words.txt”)

val counts = textFile.flatMap(.split(" ")).map((, 1)).reduceByKey(_ + _)

集群上的数据计算

val textFile = sc.textFile(“hdfs://hadoop01:8020/words.txt”)

val counts = textFile.flatMap(.split(" ")).map((, 1)).reduceByKey(_ + _)

counts.saveAsTextFile(“hdfs://hadoop01:8020/lilixin22”)

standalone集群模式部署

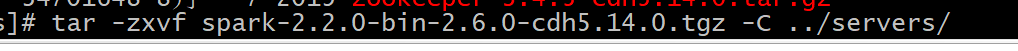

第一步:解压

tar -zxvf spark-2.2.0-bin-2.6.0-cdh5.14.0.tgz -C …/servers/

集群规划

hadoop01:master

hadoop02:slave/worker

hadoop03:slave/worker

第二步:修改配置并分发

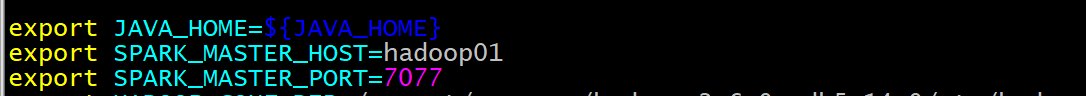

●修改Spark配置文件

cd /export/servers/spark/conf

mv spark-env.sh.template spark-env.sh

vim spark-env.sh

export JAVA_HOME=${JAVA_HOME}

export SPARK_MASTER_HOST=hadoop01

export SPARK_MASTER_PORT=7077

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1263

1263

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?