基于PyTorch的YoloV5目标检测平台

参考:

文章转载记录来自

Bubbliiiing大佬博客

Bubbliiiing大佬GIthub地址

Bubbliiiing大佬B站视频讲解

20系列及以下显卡环境配置pytorch代码对应的pytorch版本为1.2,配置方法地址

30系显卡由于框架更新不可使用上述环境配置教程。 配置如下: pytorch代码对应的pytorch版本为1.7.0,cuda为11.0,cudnn为8.0.5

江大白知乎、博客等

pytorch深度学习框架

YoloV5目标检测算法

YoloV5l版本

YoloV5改进的部分改进

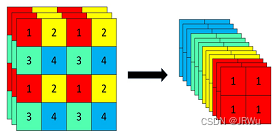

1、主干部分:使用了Focus网络结构,具体操作是在一张图片中**每隔一个像素拿到一个值,这个时候获得了四个独立的特征层,然后将四个独立的特征层进行堆叠,此时宽高信息就集中到了通道信息,输入通道扩充了四倍。**该结构在YoloV5第5版之前有所应用,最新版本中未使用(后面改为了6*6的卷积,效果更好)。

2、数据增强:Mosaic数据增强、Mosaic利用了四张图片进行拼接实现数据中增强,根据论文所说其拥有一个巨大的优点是丰富检测物体的背景!且在BN计算的时候一下子会计算四张图片的数据!

3、多正样本匹配:在之前的Yolo系列里面,在训练时每一个真实框对应一个正样本,即在训练时,每一个真实框仅由一个先验框负责预测。YoloV5中为了加快模型的训练效率,增加了正样本的数量,在训练时,每一个真实框可以由多个先验框负责预测。

- 输入端:在模型训练阶段,提出了一些改进思路,主要包括Mosaic数据增强、自适应锚框计算、自适应图片缩放;

- 基准网络:融合其它检测算法中的一些新思路,主要包括:Focus结构与CSP结构;

- Neck网络:目标检测网络在BackBone与最后的Head输出层之间往往会插入一些层,Yolov5中添加了FPN+PAN结构;

- Head输出层:输出层的锚框机制与YOLOv4相同,主要改进的是训练时的损失函数GIOU_Loss,以及预测框筛选的DIOU_nms。

YoloV5思路

一、 整体结构

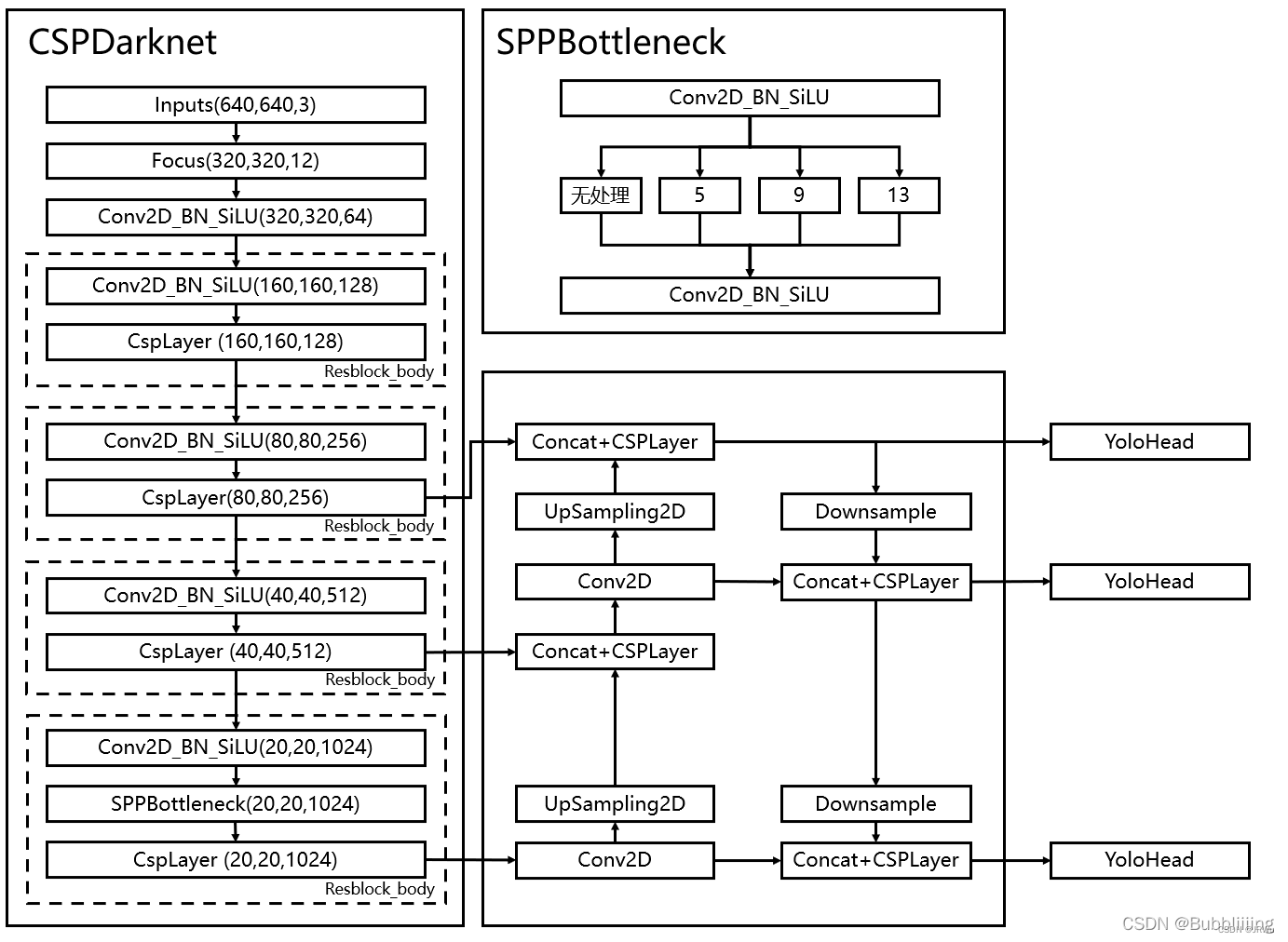

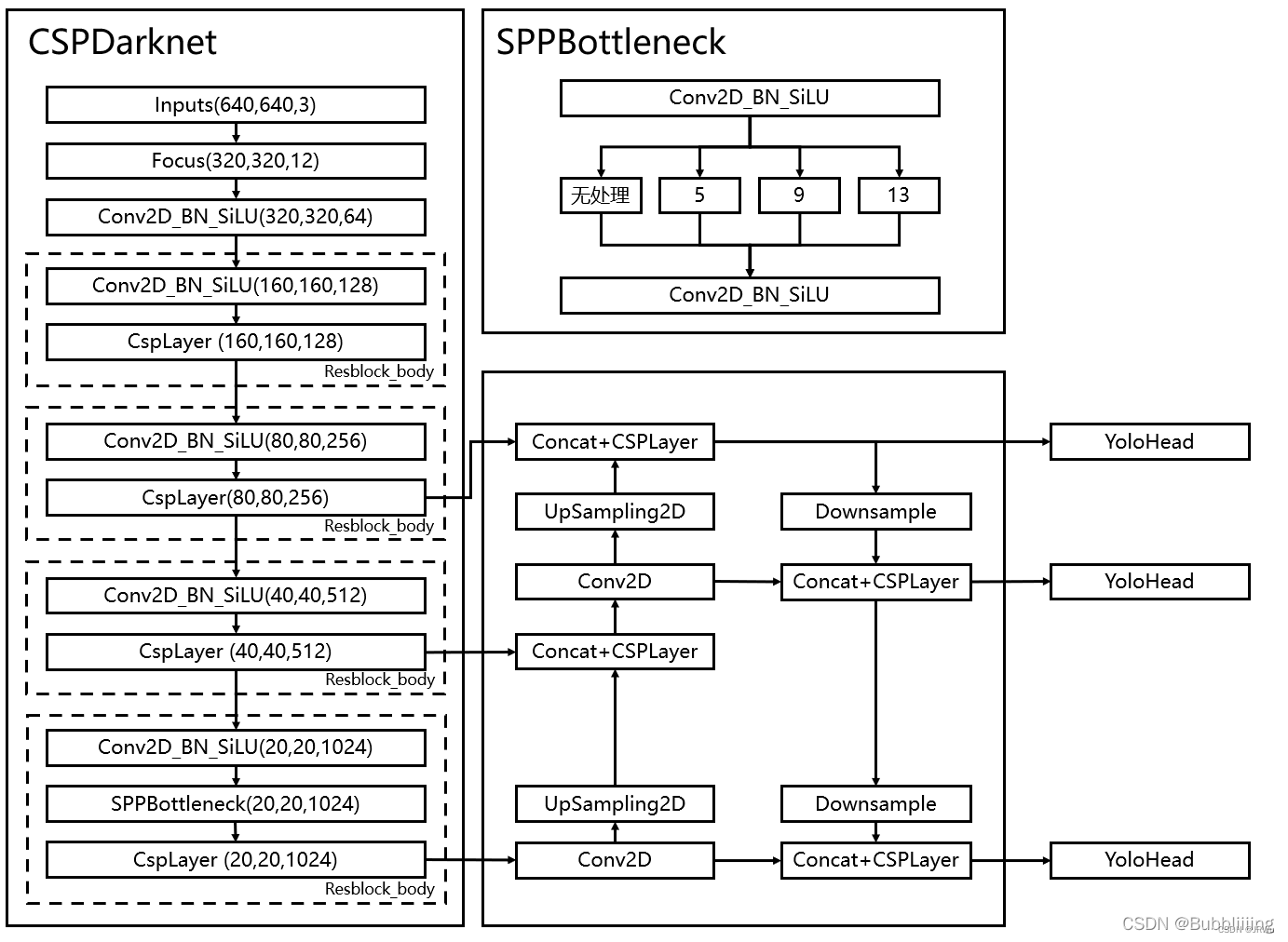

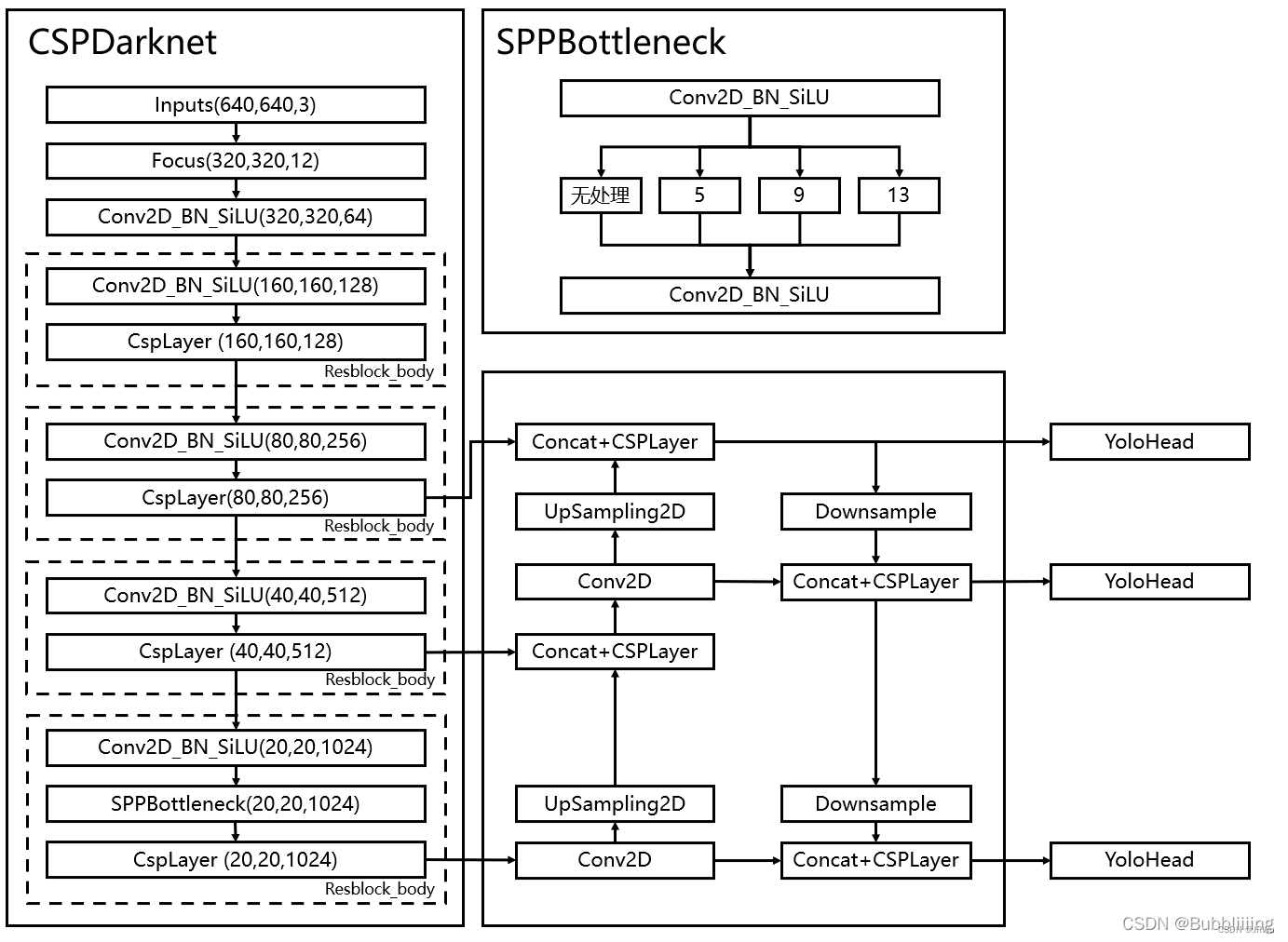

和之前版本的Yolo类似,整个YoloV5可以依然可以分为三个部分,分别是Backbone,FPN以及Yolo Head。

Backbone可以被称作YoloV5的主干特征提取网络,根据它的结构以及之前Yolo主干的叫法,我一般叫它CSPDarknet(Cross Stage Partial),输入的图片首先会在CSPDarknet里面进行特征提取,提取到的特征可以被称作特征层,是输入图片的特征集合。在主干部分,我们获取了三个特征层进行下一步网络的构建,这三个特征层我称它为有效特征层。

FPN+PAN:FPN可以被称作YoloV5的加强特征提取网络(特征金字塔),在主干部分获得的三个有效特征层会在这一部分进行特征融合,特征融合的目的是结合不同尺度的特征信息。在FPN部分,已经获得的有效特征层被用于继续提取特征。在YoloV5里依然使用到了Panet(基于提议的实例分割框架下的路径聚合网络Path Aggregation Network)的结构,我们不仅会对特征进行上采样实现特征融合,还会对特征再次进行下采样实现特征融合。

PANet(Path Aggregation Network)最大的贡献是提出了一个自顶向下和自底向上的双向融合骨干网络,同时在最底层和最高层之间添加了一条**“short-cut”**,用于缩短层之间的路径。

PANet还提出了自适应特征池化和全连接融合两个模块。

其中自适应特征池化可以用于聚合不同层之间的特征,保证特征的完整性和多样性,而通过全连接融合可以得到更加准确的预测mask。

Yolo Head是YoloV5的分类器与回归器(分类:离散变量预测如天气晴或阴,回归:连续变量预测如气温几度),通过CSPDarknet和FPN,我们已经可以获得三个加强过的有效特征层。每一个特征层都有宽、高和通道数,此时我们可以将特征图看作一个又一个特征点的集合,每一个特征点都有通道数个特征。Yolo Head实际上所做的工作就是对特征点进行判断,判断特征点是否有物体与其对应。与以前版本的Yolo一样,YoloV5所用的解耦头是一起的,也就是分类和回归在一个1X1卷积里实现。

因此,整个YoloV5网络所作的工作就是 特征提取-特征加强-预测特征点对应的物体情况。

二、网络结构分析

(1)输入端:Mosaic数据增强、自适应锚框计算、自适应图片缩放

(2)Backbone:Focus结构,CSP结构

(3)Neck:FPN+PAN结构

(4)Prediction:GIOU_Loss

1、主干网络Backbone(即CSPDarknet)

YoloV5使用的Backbone(主干特征提取网络)为CSPDarknet,五个重要特点:

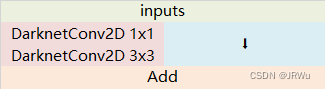

1、使用了残差网络Residual,CSPDarknet中的残差卷积可以分为两个部分,主干部分是一次1X1的卷积和一次3X3的卷积;残差边部分不做任何处理,直接将主干的输入与输出结合。整个YoloV5的主干部分都由残差卷积构成:

# 使用了残差网络Residual,CSPDarknet中的残差卷积可以分为两个部分,主干部分是一次1X1的卷积和一次3X3的卷积;

# 残差边部分不做任何处理,直接将主干的输入与输出结合。整个YoloV5的主干部分都由残差卷积构成:

# 残差网络的特点是容易优化,并且能够通过增加相当的深度来提高准确率。其内部的残差块使用了跳跃连接,

# 缓解了在深度神经网络中增加深度带来的梯度消失问题。

class Bottleneck(nn.Module):

# Standard bottleneck

def __init__(self, c1, c2, shortcut=True, g=1, e=0.5): # ch_in, ch_out, shortcut, groups, expansion

super(Bottleneck, self).__init__()

c_ = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, c_, 1, 1)

self.cv2 = Conv(c_, c2, 3, 1, g=g)

self.add = shortcut and c1 == c2

def forward(self, x):

return x + self.cv2(self.cv1(x)) if self.add else self.cv2(self.cv1(x)) #卷积完成之后直接将主干的输入与输出结合

残差网络的特点是容易优化,并且能够通过增加相当的深度来提高准确率。其内部的残差块使用了跳跃连接,缓解了在深度神经网络中增加深度带来的梯度消失问题。

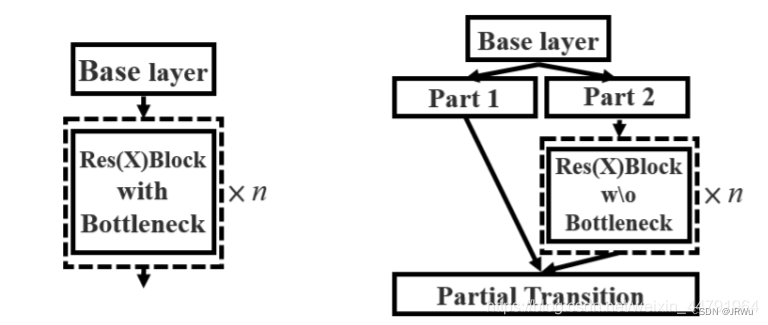

2、使用**CSPnet(Cross Stage Partial Network)**网络结构(每层是CSPlayer),CSPnet结构并不算复杂,就是将原来的残差块的堆叠进行了一个拆分,拆成左右两部分:主干部分继续进行原来的残差块的堆叠;另一部分则像一个残差边一样,经过少量处理直接连接到最后。因此可以认为CSP中存在一个大的残差边。

引出一个大的残差边,跳过特征提取过程,将大结构块的输入和输出直接相接

在 CSPResNe(X)t 结构中,输入特征图在通道维度被分为两个部分,第一部分被保留下来,第二部分则经过多个残差块向后传递,最后将两者在 CSPNet 结构的末端进行合并,这样跨阶段拆分与合并的网络构造有效降低了梯度信息重复的可能性,增加了梯度组合的多样性,有利于提高模型的学习能力,并且降低了网络中的数据传递量与计算量。

# 使用CSPnet网络结构,CSPnet结构并不算复杂,就是将原来的残差块的堆叠进行了一个拆分,拆成左右两部分:主干部分继续进行原来的残差块的堆叠;

# 另一部分则像一个残差边一样,经过少量处理直接连接到最后。因此可以认为CSP中存在一个大的残差边。

class C3(nn.Module):

# CSP Bottleneck with 3 convolutions

def __init__(self, c1, c2, n=1, shortcut=True, g=1, e=0.5): # ch_in, ch_out, number, shortcut, groups, expansion

super(C3, self).__init__()

c_ = int(c2 * e) # hidden channels

# 卷积1

self.cv1 = Conv(c1, c_, 1, 1)

self.cv2 = Conv(c1, c_, 1, 1)

self.cv3 = Conv(2 * c_, c2, 1) # act=FReLU(c2)

self.m = nn.Sequential(*[Bottleneck(c_, c_, shortcut, g, e=1.0) for _ in range(n)])

# self.m = nn.Sequential(*[CrossConv(c_, c_, 3, 1, g, 1.0, shortcut) for _ in range(n)])

def forward(self, x):

return self.cv3(torch.cat(

(

self.m(self.cv1(x)), #CSPlayer的主干部分,利用卷积1进行简单的通道数调整后,不断利用残差结构进行特征提取

self.cv2(x)

)

, dim=1))

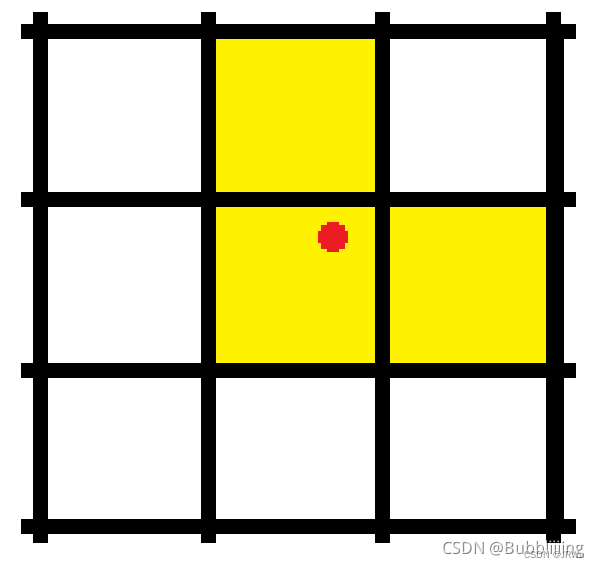

3、使用了Focus网络结构,这个网络结构是在YoloV5里面使用到比较有趣的网络结构,具体操作是在一张图片中每隔一个像素拿到一个值,这个时候获得了四个独立的特征层,然后将四个独立的特征层进行堆叠,此时宽高信息就集中到了通道信息,输入通道扩充了四倍。拼接起来的特征层相对于原先的三通道变成了十二个通道,下图很好的展示了Focus结构,一看就能明白。(高宽压缩通道扩张)(新的YoloV5用6*6的卷积替代了Focus,更快)

# focus网络构建 具体操作是在一张图片中每隔一个像素拿到一个值,这个时候获得了四个独立的特征层,然后将四个独立的特征层进行堆叠,

# 此时宽高信息就集中到了通道信息,输入通道扩充了四倍。拼接起来的特征层相对于原先的三通道变成了十二个通道(高宽压缩通道扩张)

class Focus(nn.Module):

def __init__(self, c1, c2, k=1, s=1, p=None, g=1, act=True): # ch_in, ch_out, kernel, stride, padding, groups

super(Focus, self).__init__()

# 卷积标准化加激活函数

self.conv = Conv(c1 * 4, c2, k, s, p, g, act)

def forward(self, x):

# 320, 320, 12 (卷积 标准化加激活函数变成)=> 320, 320, 64(设置的输出通道数是64)

return self.conv(

# 640, 640, 3 => 320, 320, 12

# 每隔一个像素拿到一个值,这个时候获得了四个独立的特征层,然后将四个独立的特征层进行堆叠,

torch.cat(

[

x[..., ::2, ::2],

x[..., 1::2, ::2],

x[..., ::2, 1::2],

x[..., 1::2, 1::2]

], 1

)

)

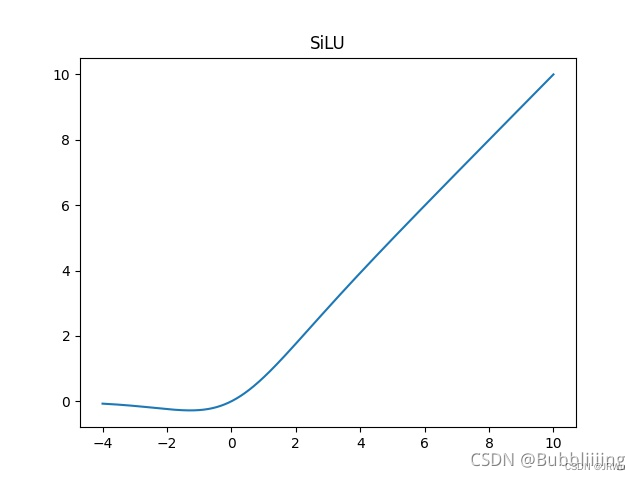

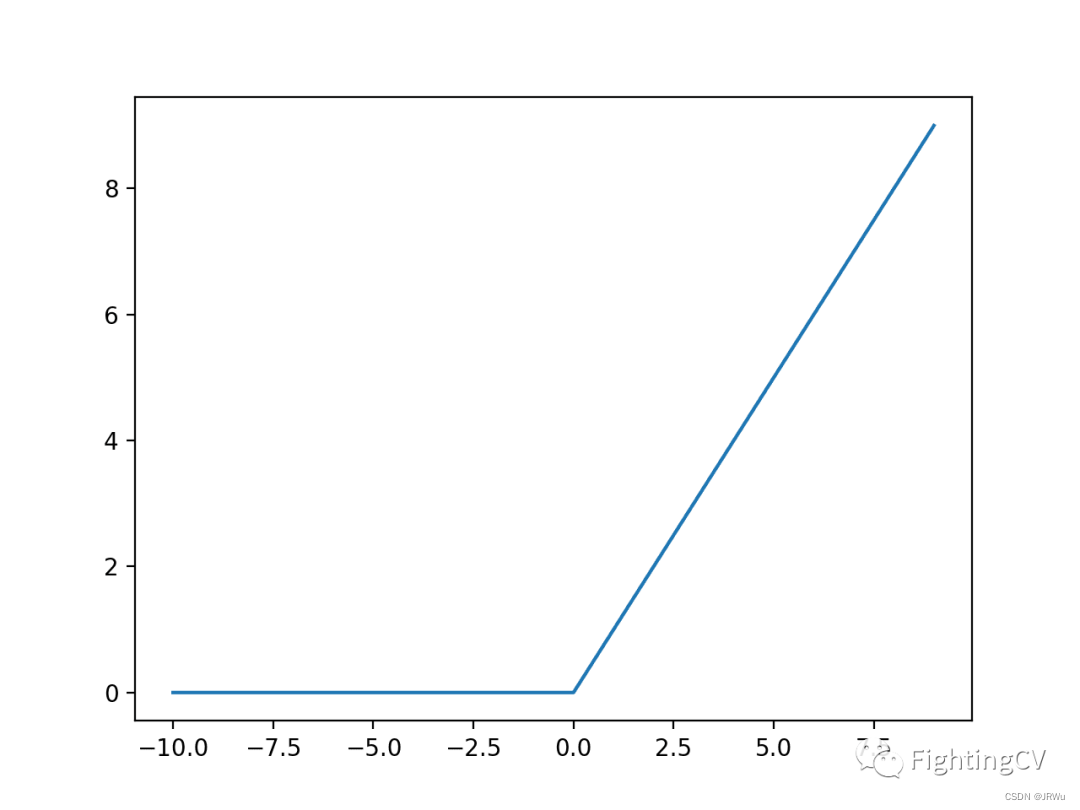

4、使用了SiLU激活函数,SiLU是Sigmoid和ReLU的改进版。SiLU具备无上界有下界、平滑、非单调的特性。SiLU在深层模型上的效果优于 ReLU。可以看做是平滑的ReLU激活函数。

# 使用了SiLU激活函数,SiLU是Sigmoid和ReLU的改进版。SiLU具备无上界有下界、平滑、非单调的特性。

# SiLU在深层模型上的效果优于 ReLU。可以看做是平滑的ReLU激活函数。

class SiLU(nn.Module):

@staticmethod

def forward(x):

return x * torch.sigmoid(x)

ReLU激活函数

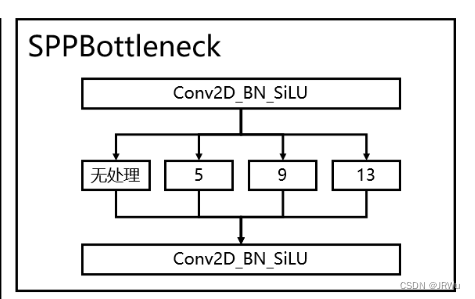

5、使用了SPP结构,通过不同池化核大小的最大池化进行特征提取,提高网络的感受野。在YoloV4中,SPP是用在FPN里面的,在YoloV5中,SPP模块被用在了主干特征提取网络中。

SPP

卷积调整通道数之后利用不同池化核的最大池化核(5 9 13 )来进行特征提取 除了5 9 13 还有一个没有处理的

四个部分堆叠然后卷积标准化加激活函数进行通道数的调整

# 使用了SPP结构,通过不同池化核大小的最大池化进行特征提取,提高网络的感受野。

# 在YoloV4中,SPP是用在FPN里面的,在YoloV5中,SPP模块被用在了主干特征提取网络中。

class SPP(nn.Module):

# Spatial pyramid pooling layer used in YOLOv3-SPP

def __init__(self, c1, c2, k=(5, 9, 13)):

super(SPP, self).__init__()

c_ = c1 // 2 # hidden channels

self.cv1 = Conv(c1, c_, 1, 1) # 卷积调整通道数

self.cv2 = Conv(c_ * (len(k) + 1), c2, 1, 1)# 四个部分堆叠然后卷积进行通道数调整

# 卷积调整通道数之后利用不同池化核的最大池化核(5 9 13 )来进行特征提取 除了5 9 13 还有一个没有处理的

# 四个部分组合然后卷积标准化加激活函数进行通道数的调整

self.m = nn.ModuleList([nn.MaxPool2d(kernel_size=x, stride=1, padding=x // 2) for x in k])

def forward(self, x):

x = self.cv1(x)

return self.cv2(torch.cat([x] + [m(x) for m in self.m], 1))# 四个部分堆叠

主干代码CSPDarknet.py:

import torch

import torch.nn as nn

# 使用了SiLU激活函数,SiLU是Sigmoid和ReLU的改进版。SiLU具备无上界有下界、平滑、非单调的特性。

# SiLU在深层模型上的效果优于 ReLU。可以看做是平滑的ReLU激活函数。

class SiLU(nn.Module):

@staticmethod

def forward(x):

return x * torch.sigmoid(x)

def autopad(k, p=None):

if p is None:

p = k // 2 if isinstance(k, int) else [x // 2 for x in k]

return p

# focus网络构建 具体操作是在一张图片中每隔一个像素拿到一个值,这个时候获得了四个独立的特征层,然后将四个独立的特征层进行堆叠,

# 此时宽高信息就集中到了通道信息,输入通道扩充了四倍。拼接起来的特征层相对于原先的三通道变成了十二个通道(高宽压缩通道扩张)

class Focus(nn.Module):

def __init__(self, c1, c2, k=1, s=1, p=None, g=1, act=True): # ch_in, ch_out, kernel, stride, padding, groups

super(Focus, self).__init__()

# 卷积标准化加激活函数

self.conv = Conv(c1 * 4, c2, k, s, p, g, act)

def forward(self, x):

# 320, 320, 12 (卷积 标准化加激活函数变成)=> 320, 320, 64(设置的输出通道数是64)

return self.conv(

# 640, 640, 3 => 320, 320, 12

# 每隔一个像素拿到一个值,这个时候获得了四个独立的特征层,然后将四个独立的特征层进行堆叠,

torch.cat(

[

x[..., ::2, ::2],

x[..., 1::2, ::2],

x[..., ::2, 1::2],

x[..., 1::2, 1::2]

], 1

)

)

class Conv(nn.Module):

def __init__(self, c1, c2, k=1, s=1, p=None, g=1, act=True):

super(Conv, self).__init__()

self.conv = nn.Conv2d(c1, c2, k, s, autopad(k, p), groups=g, bias=False)

self.bn = nn.BatchNorm2d(c2, eps=0.001, momentum=0.03)

self.act = SiLU() if act is True else (act if isinstance(act, nn.Module) else nn.Identity())

def forward(self, x):

return self.act(self.bn(self.conv(x)))

def fuseforward(self, x):

return self.act(self.conv(x))

# 使用了残差网络Residual,CSPDarknet中的残差卷积可以分为两个部分,主干部分是一次1X1的卷积和一次3X3的卷积;

# 残差边部分不做任何处理,直接将主干的输入与输出结合。整个YoloV5的主干部分都由残差卷积构成:

# 残差网络的特点是容易优化,并且能够通过增加相当的深度来提高准确率。其内部的残差块使用了跳跃连接,

# 缓解了在深度神经网络中增加深度带来的梯度消失问题。

class Bottleneck(nn.Module):

# Standard bottleneck

def __init__(self, c1, c2, shortcut=True, g=1, e=0.5): # ch_in, ch_out, shortcut, groups, expansion

super(Bottleneck, self).__init__()

c_ = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, c_, 1, 1)

self.cv2 = Conv(c_, c2, 3, 1, g=g)

self.add = shortcut and c1 == c2

def forward(self, x):

return x + self.cv2(self.cv1(x)) if self.add else self.cv2(self.cv1(x)) #卷积完成之后直接将主干的输入与输出结合

# 使用CSPnet网络结构,CSPnet结构并不算复杂,就是将原来的残差块的堆叠进行了一个拆分,拆成左右两部分:主干部分继续进行原来的残差块的堆叠;

# 另一部分则像一个残差边一样,经过少量处理直接连接到最后。因此可以认为CSP中存在一个大的残差边。

class C3(nn.Module):

# CSP Bottleneck with 3 convolutions

def __init__(self, c1, c2, n=1, shortcut=True, g=1, e=0.5): # ch_in, ch_out, number, shortcut, groups, expansion

super(C3, self).__init__()

c_ = int(c2 * e) # hidden channels

# 卷积1

self.cv1 = Conv(c1, c_, 1, 1)

self.cv2 = Conv(c1, c_, 1, 1)

self.cv3 = Conv(2 * c_, c2, 1) # act=FReLU(c2)

self.m = nn.Sequential(*[Bottleneck(c_, c_, shortcut, g, e=1.0) for _ in range(n)])

# self.m = nn.Sequential(*[CrossConv(c_, c_, 3, 1, g, 1.0, shortcut) for _ in range(n)])

def forward(self, x):

return self.cv3(torch.cat(

(

self.m(self.cv1(x)), #CSPlayer的主干部分,利用卷积1进行简单的通道数调整后,不断利用残差结构进行特征提取

self.cv2(x)

)

, dim=1))

# 使用了SPP结构,通过不同池化核大小的最大池化进行特征提取,提高网络的感受野。

# 在YoloV4中,SPP是用在FPN里面的,在YoloV5中,SPP模块被用在了主干特征提取网络中。

class SPP(nn.Module):

# Spatial pyramid pooling layer used in YOLOv3-SPP

def __init__(self, c1, c2, k=(5, 9, 13)):

super(SPP, self).__init__()

c_ = c1 // 2 # hidden channels

self.cv1 = Conv(c1, c_, 1, 1) # 卷积调整通道数

self.cv2 = Conv(c_ * (len(k) + 1), c2, 1, 1)# 四个部分堆叠然后卷积进行通道数调整

# 卷积调整通道数之后利用不同池化核的最大池化核(5 9 13 )来进行特征提取 除了5 9 13 还有一个没有处理的

# 四个部分组合然后卷积标准化加激活函数进行通道数的调整

self.m = nn.ModuleList([nn.MaxPool2d(kernel_size=x, stride=1, padding=x // 2) for x in k])

def forward(self, x):

x = self.cv1(x)

return self.cv2(torch.cat([x] + [m(x) for m in self.m], 1))# 四个部分堆叠

# 该类完成YoloV5主干构建

class CSPDarknet(nn.Module):

#初始化

def __init__(self, base_channels, base_depth, phi, pretrained):

super().__init__()

#-----------------------------------------------#

# 输入图片是640, 640, 3

# 初始的基本通道base_channels是64

#-----------------------------------------------#

#-----------------------------------------------#

# 利用focus网络结构进行特征提取

# 640, 640, 3 -> 320, 320, 12 -> 320, 320, 64

#-----------------------------------------------#

self.stem = Focus(3, base_channels, k=3)

#-----------------------------------------------#

# 完成卷积之后,320, 320, 64 -> 160, 160, 128 base_channels * 2所以64变12

# 完成CSPlayer之后,160, 160, 128 -> 160, 160, 128 不改变通道数

#-----------------------------------------------#

self.dark2 = nn.Sequential(

# 320, 320, 64 -> 160, 160, 128 获得160, 160, 128的特征层,然后要进行CSPlayer的构建

Conv(base_channels, base_channels * 2, 3, 2), # 卷积高和宽的压缩,通道数的扩张

# 160, 160, 128 -> 160, 160, 128 base_channels * 2都是基础通道数*2 所以还是160, 160, 128

C3(base_channels * 2, base_channels * 2, base_depth),

)

#-----------------------------------------------#

# 完成卷积之后,160, 160, 128 -> 80, 80, 256

# 完成CSPlayer之后,80, 80, 256 -> 80, 80, 256

# 在这里引出有效特征层80, 80, 256

# 进行加强特征提取网络FPN的构建

#-----------------------------------------------#

self.dark3 = nn.Sequential(

Conv(base_channels * 2, base_channels * 4, 3, 2), # 卷积高和宽的压缩,通道数的扩张

C3(base_channels * 4, base_channels * 4, base_depth * 3),

)

#-----------------------------------------------#

# 完成卷积之后,80, 80, 256 -> 40, 40, 512

# 完成CSPlayer之后,40, 40, 512 -> 40, 40, 512

# 在这里引出有效特征层40, 40, 512

# 进行加强特征提取网络FPN的构建

#-----------------------------------------------#

self.dark4 = nn.Sequential(

Conv(base_channels * 4, base_channels * 8, 3, 2), # 卷积高和宽的压缩,通道数的扩张

C3(base_channels * 8, base_channels * 8, base_depth * 3),

)

#-----------------------------------------------#

# 完成卷积之后,40, 40, 512 -> 20, 20, 1024

# 完成SPP之后,20, 20, 1024 -> 20, 20, 1024

# 完成CSPlayer之后,20, 20, 1024 -> 20, 20, 1024

#-----------------------------------------------#

self.dark5 = nn.Sequential(

Conv(base_channels * 8, base_channels * 16, 3, 2), # 卷积高和宽的压缩,通道数的扩张

SPP(base_channels * 16, base_channels * 16),

C3(base_channels * 16, base_channels * 16, base_depth, shortcut=False), # shortcut=False 没有进行残差边的构建

)

if pretrained:

url = {

's' : 'https://github.com/bubbliiiing/yolov5-pytorch/releases/download/v1.0/cspdarknet_s_backbone.pth',

'm' : 'https://github.com/bubbliiiing/yolov5-pytorch/releases/download/v1.0/cspdarknet_m_backbone.pth',

'l' : 'https://github.com/bubbliiiing/yolov5-pytorch/releases/download/v1.0/cspdarknet_l_backbone.pth',

'x' : 'https://github.com/bubbliiiing/yolov5-pytorch/releases/download/v1.0/cspdarknet_x_backbone.pth',

}[phi]

checkpoint = torch.hub.load_state_dict_from_url(url=url, map_location="cpu", model_dir="./model_data")

self.load_state_dict(checkpoint, strict=False)

print("Load weights from ", url.split('/')[-1])

def forward(self, x):

x = self.stem(x)

x = self.dark2(x)

#三个有效特征层进入FPN加强特征提取网络(FPN特征金字塔)进行特征提取

#-----------------------------------------------#

# dark3的输出为80, 80, 256,是一个有效特征层

#-----------------------------------------------#

x = self.dark3(x)

feat1 = x

#-----------------------------------------------#

# dark4的输出为40, 40, 512,是一个有效特征层

#-----------------------------------------------#

x = self.dark4(x)

feat2 = x

#-----------------------------------------------#

# dark5的输出为20, 20, 1024,是一个有效特征层

#-----------------------------------------------#

x = self.dark5(x)

feat3 = x

return feat1, feat2, feat3

2、构建FPN特征金字塔(加强特征提取网络)进行加强特征提取

在特征利用部分,YoloV5提取多特征层进行目标检测,一共提取三个特征层。

三个特征层位于主干部分CSPdarknet的不同位置,分别位于中间层,中下层,底层,当输入为(640,640,3)的时候,三个特征层的shape分别为feat1=(80,80,256)、feat2=(40,40,512)、feat3=(20,20,1024)。

在获得三个有效特征层后,我们利用这三个有效特征层进行FPN层的构建,构建方式为:

- feat3=(20,20,1024)的特征层进行1次1X1卷积调整通道后获得P5,P5进行上采样UmSampling2d后与feat2=(40,40,512)特征层进行结合,然后使用CSPLayer进行特征提取获得P5_upsample,此时获得的特征层为(40,40,512)。

- P5_upsample=(40,40,512)的特征层进行1次1X1卷积调整通道后获得P4,P4进行上采样UmSampling2d后与feat1=(80,80,256)特征层进行结合,然后使用CSPLayer进行特征提取P3_out,此时获得的特征层为(80,80,256)。

- P3_out=(80,80,256)的特征层进行一次3x3卷积进行下采样,下采样后与P4堆叠,然后使用CSPLayer进行特征提取P4_out,此时获得的特征层为(40,40,512)。

- P4_out=(40,40,512)的特征层进行一次3x3卷积进行下采样,下采样后与P5堆叠,然后使用CSPLayer进行特征提取P5_out,此时获得的特征层为(20,20,1024)。

特征金字塔可以将不同shape的特征层进行特征融合,有利于提取出更好的特征。

nets/yolo.py

import torch

import torch.nn as nn

from nets.ConvNext import ConvNeXt_Small, ConvNeXt_Tiny

from nets.CSPdarknet import C3, Conv, CSPDarknet

from nets.Swin_transformer import Swin_transformer_Tiny

#---------------------------------------------------#

# yolo_body

#---------------------------------------------------#

class YoloBody(nn.Module):

def __init__(self, anchors_mask, num_classes, phi, backbone='cspdarknet', pretrained=False, input_shape=[640, 640]):

super(YoloBody, self).__init__()

depth_dict = {'s' : 0.33, 'm' : 0.67, 'l' : 1.00, 'x' : 1.33,}

width_dict = {'s' : 0.50, 'm' : 0.75, 'l' : 1.00, 'x' : 1.25,}

dep_mul, wid_mul = depth_dict[phi], width_dict[phi]

base_channels = int(wid_mul * 64) # 64

base_depth = max(round(dep_mul * 3), 1) # 3

#-----------------------------------------------#

# 输入图片是640, 640, 3

# 初始的基本通道是64

#-----------------------------------------------#

#生成YoloV5的主干部分

self.backbone_name = backbone

if backbone == "cspdarknet":

#---------------------------------------------------#

# 生成CSPdarknet53的主干模型

# 获得三个有效特征层,他们的shape分别是:

# P3:80,80,256

# P4:40,40,512

# P5:20,20,1024

# 构建FPN特征金字塔进行加强特征提取(利用这三个有效特征层进行加强特征提取网络的构建)

#---------------------------------------------------#

self.backbone = CSPDarknet(base_channels, base_depth, phi, pretrained)

else:

#---------------------------------------------------#

# 如果输入不为cspdarknet,则调整通道数

# 使其符合YoloV5的格式

#---------------------------------------------------#

self.backbone = {

'convnext_tiny' : ConvNeXt_Tiny,

'convnext_small' : ConvNeXt_Small,

'swin_transfomer_tiny' : Swin_transformer_Tiny,

}[backbone](pretrained=pretrained, input_shape=input_shape)

in_channels = {

'convnext_tiny' : [192, 384, 768],

'convnext_small' : [192, 384, 768],

'swin_transfomer_tiny' : [192, 384, 768],

}[backbone]

feat1_c, feat2_c, feat3_c = in_channels

self.conv_1x1_feat1 = Conv(feat1_c, base_channels * 4, 1, 1)

self.conv_1x1_feat2 = Conv(feat2_c, base_channels * 8, 1, 1)

self.conv_1x1_feat3 = Conv(feat3_c, base_channels * 16, 1, 1)

self.upsample = nn.Upsample(scale_factor=2, mode="nearest")

self.conv_for_feat3 = Conv(base_channels * 16, base_channels * 8, 1, 1)

self.conv3_for_upsample1 = C3(base_channels * 16, base_channels * 8, base_depth, shortcut=False) # shortcut=False 没有残差边

self.conv_for_feat2 = Conv(base_channels * 8, base_channels * 4, 1, 1) #卷积标准化加激活函数

self.conv3_for_upsample2 = C3(base_channels * 8, base_channels * 4, base_depth, shortcut=False)

self.down_sample1 = Conv(base_channels * 4, base_channels * 4, 3, 2) # 第二个base_channels * 4:输出通道数,3:卷积核大小,1:步长

self.conv3_for_downsample1 = C3(base_channels * 8, base_channels * 8, base_depth, shortcut=False)

self.down_sample2 = Conv(base_channels * 8, base_channels * 8, 3, 2)

self.conv3_for_downsample2 = C3(base_channels * 16, base_channels * 16, base_depth, shortcut=False)

# 80, 80, 256 => 80, 80, 3 * (5 + num_classes) => 80, 80, 3 * (4 + 1 + num_classes)

self.yolo_head_P3 = nn.Conv2d(base_channels * 4, len(anchors_mask[2]) * (5 + num_classes), 1)

# 40, 40, 512 => 40, 40, 3 * (5 + num_classes) => 40, 40, 3 * (4 + 1 + num_classes)

self.yolo_head_P4 = nn.Conv2d(base_channels * 8, len(anchors_mask[1]) * (5 + num_classes), 1)

# 20, 20, 1024 => 20, 20, 3 * (5 + num_classes) => 20, 20, 3 * (4 + 1 + num_classes)

self.yolo_head_P5 = nn.Conv2d(base_channels * 16, len(anchors_mask[0]) * (5 + num_classes), 1)

def forward(self, x):

# backbone

feat1, feat2, feat3 = self.backbone(x)

if self.backbone_name != "cspdarknet":

feat1 = self.conv_1x1_feat1(feat1)

feat2 = self.conv_1x1_feat2(feat2)

feat3 = self.conv_1x1_feat3(feat3)

# ---------------------------------------------------#

# 三个有效特征层

# feat1:80,80,256

# feat2:40,40,512

# feat3:20,20,1024

# ---------------------------------------------------#

# ---------------------------------------------------#

# 上采样进行特征融合

# ---------------------------------------------------#

# feat3:20, 20, 1024 -> P5:20, 20, 512

# 输入20, 20, 1024 卷积完成之后-> 得到 20, 20, 512 的特征层 ctrl右键可知上面为基础通道数64*8=512

P5 = self.conv_for_feat3(feat3)

# 20, 20, 512 -> 40, 40, 512

# 对20, 20, 512 特征层上采样之后获得 -> 40, 40, 512 特征层(上采样放大图像 内插值等方法)

P5_upsample = self.upsample(P5)

# 40, 40, 512 -> 40, 40, 1024

# P5上采样后结果40, 40, 512和feat2:40, 40, 512堆叠 最后变成 P4:40, 40, 1024

P4 = torch.cat([P5_upsample, feat2], 1)

# 40, 40, 1024 -> 40, 40, 512

# 40, 40, 1024 CSPlayer特征提取(没有残差边,输出通道数是基础通道数*8,变成512通道数) -> 40, 40, 512

P4 = self.conv3_for_upsample1(P4)

# 40, 40, 512 -> 40, 40, 256

# 卷积 通道数为基础通道数*4

P4 = self.conv_for_feat2(P4)

# 40, 40, 256 -> 80, 80, 256

# 上采样

P4_upsample = self.upsample(P4)

# 80, 80, 256 cat 80, 80, 256 -> 80, 80, 512

# 堆叠

P3 = torch.cat([P4_upsample, feat1], 1)

# 80, 80, 512 -> 80, 80, 256

# 同P4经过CSPlayer

P3 = self.conv3_for_upsample2(P3)# P3特征层两个处理过程:1.一个传入YoloHead获得分类预测结果和回归预测结果

# 2.另一个进行下采样继续进行特征融合

# ---------------------------------------------------#

# 下采样进行特征融合

# ---------------------------------------------------#

# 80, 80, 256 -> 40, 40, 256

# 下采样 高宽压缩

P3_downsample = self.down_sample1(P3)

# 40, 40, 256 cat 40, 40, 256 -> 40, 40, 512

# 堆叠

P4 = torch.cat([P3_downsample, P4], 1)

# 40, 40, 512 -> 40, 40, 512

# CSPlayer shortcut=False,通道数没变

P4 = self.conv3_for_downsample1(P4) # P4特征层两个处理:1.YoloHead 2.继续下采样进行特征融合

# 40, 40, 512 -> 20, 20, 512

# 下采样 高宽压缩

P4_downsample = self.down_sample2(P4)

# 20, 20, 512 cat 20, 20, 512 -> 20, 20, 1024

# 堆叠

P5 = torch.cat([P4_downsample, P5], 1)

# 20, 20, 1024 -> 20, 20, 1024

# CSPlayer特征提取

P5 = self.conv3_for_downsample2(P5) # P5特征层传入YoloHead

#三个加强后的有效特征层通过YoloHead获得分类预测结果和回归预测结果

#---------------------------------------------------#

# 第三个特征层

# y3=(batch_size,75,80,80)

#---------------------------------------------------#

out2 = self.yolo_head_P3(P3)

#---------------------------------------------------#

# 第二个特征层

# y2=(batch_size,75,40,40)

#---------------------------------------------------#

out1 = self.yolo_head_P4(P4)

#---------------------------------------------------#

# 第一个特征层

# y1=(batch_size,75,20,20)

#---------------------------------------------------#

out0 = self.yolo_head_P5(P5)

return out0, out1, out2

3、利用Yolo Head获得预测结果

利用FPN特征金字塔,我们可以获得三个加强特征,这三个加强特征的shape分别为(20,20,1024)、(40,40,512)、(80,80,256),然后我们利用这三个shape的特征层传入Yolo Head获得预测结果。

对于每一个特征层,我们可以获得利用一个卷积调整通道数,最终的通道数和需要区分的种类个数相关,在YoloV5里,每一个特征层上每一个特征点存在3个先验框。

如果使用的是voc训练集,类则为20种,最后的维度应该为75 = 3x25,三个特征层的shape为(20,20,75),(40,40,75),(80,80,75)。本人使用的也是VOC数据集

最后的75可以拆分成3个25,对应3个先验框的25个参数,25可以拆分成4+1+20。

前4个参数用于判断每一个特征点的回归参数,回归参数调整后可以获得预测框;

第5个参数用于判断每一个特征点是否包含物体;

最后20个参数用于判断每一个特征点所包含的物体种类。

如果使用的是coco训练集,类则为80种,最后的维度应该为255 = 3x85,三个特征层的shape为(20,20,255),(40,40,255),(80,80,255)

最后的255可以拆分成3个85,对应3个先验框的85个参数,85可以拆分成4+1+80。

前4个参数用于判断每一个特征点的回归参数,回归参数调整后可以获得预测框;

第5个参数用于判断每一个特征点是否包含物体;

最后80个参数用于判断每一个特征点所包含的物体种类。

nets/yolo.py

import torch

import torch.nn as nn

from nets.ConvNext import ConvNeXt_Small, ConvNeXt_Tiny

from nets.CSPdarknet import C3, Conv, CSPDarknet

from nets.Swin_transformer import Swin_transformer_Tiny

#---------------------------------------------------#

# yolo_body

#---------------------------------------------------#

class YoloBody(nn.Module):

def __init__(self, anchors_mask, num_classes, phi, backbone='cspdarknet', pretrained=False, input_shape=[640, 640]):

super(YoloBody, self).__init__()

depth_dict = {'s' : 0.33, 'm' : 0.67, 'l' : 1.00, 'x' : 1.33,}

width_dict = {'s' : 0.50, 'm' : 0.75, 'l' : 1.00, 'x' : 1.25,}

dep_mul, wid_mul = depth_dict[phi], width_dict[phi]

base_channels = int(wid_mul * 64) # 64

base_depth = max(round(dep_mul * 3), 1) # 3

#-----------------------------------------------#

# 输入图片是640, 640, 3

# 初始的基本通道是64

#-----------------------------------------------#

#生成YoloV5的主干部分

self.backbone_name = backbone

if backbone == "cspdarknet":

#---------------------------------------------------#

# 生成CSPdarknet53的主干模型

# 获得三个有效特征层,他们的shape分别是:

# P3:80,80,256

# P4:40,40,512

# P5:20,20,1024

# 构建FPN特征金字塔进行加强特征提取(利用这三个有效特征层进行加强特征提取网络的构建)

#---------------------------------------------------#

self.backbone = CSPDarknet(base_channels, base_depth, phi, pretrained)

else:

#---------------------------------------------------#

# 如果输入不为cspdarknet,则调整通道数

# 使其符合YoloV5的格式

#---------------------------------------------------#

self.backbone = {

'convnext_tiny' : ConvNeXt_Tiny,

'convnext_small' : ConvNeXt_Small,

'swin_transfomer_tiny' : Swin_transformer_Tiny,

}[backbone](pretrained=pretrained, input_shape=input_shape)

in_channels = {

'convnext_tiny' : [192, 384, 768],

'convnext_small' : [192, 384, 768],

'swin_transfomer_tiny' : [192, 384, 768],

}[backbone]

feat1_c, feat2_c, feat3_c = in_channels

self.conv_1x1_feat1 = Conv(feat1_c, base_channels * 4, 1, 1)

self.conv_1x1_feat2 = Conv(feat2_c, base_channels * 8, 1, 1)

self.conv_1x1_feat3 = Conv(feat3_c, base_channels * 16, 1, 1)

self.upsample = nn.Upsample(scale_factor=2, mode="nearest")

self.conv_for_feat3 = Conv(base_channels * 16, base_channels * 8, 1, 1)

self.conv3_for_upsample1 = C3(base_channels * 16, base_channels * 8, base_depth, shortcut=False) # shortcut=False 没有残差边

self.conv_for_feat2 = Conv(base_channels * 8, base_channels * 4, 1, 1) #卷积标准化加激活函数

self.conv3_for_upsample2 = C3(base_channels * 8, base_channels * 4, base_depth, shortcut=False)

self.down_sample1 = Conv(base_channels * 4, base_channels * 4, 3, 2) # 第二个base_channels * 4:输出通道数,3:卷积核大小,1:步长

self.conv3_for_downsample1 = C3(base_channels * 8, base_channels * 8, base_depth, shortcut=False)

self.down_sample2 = Conv(base_channels * 8, base_channels * 8, 3, 2)

self.conv3_for_downsample2 = C3(base_channels * 16, base_channels * 16, base_depth, shortcut=False)

# 80, 80, 256 => 80, 80, 3 * (5 + num_classes) => 80, 80, 3 * (4 + 1 + num_classes)

self.yolo_head_P3 = nn.Conv2d(base_channels * 4, len(anchors_mask[2]) * (5 + num_classes), 1)

# 40, 40, 512 => 40, 40, 3 * (5 + num_classes) => 40, 40, 3 * (4 + 1 + num_classes)

self.yolo_head_P4 = nn.Conv2d(base_channels * 8, len(anchors_mask[1]) * (5 + num_classes), 1)

# 20, 20, 1024 => 20, 20, 3 * (5 + num_classes) => 20, 20, 3 * (4 + 1 + num_classes)

self.yolo_head_P5 = nn.Conv2d(base_channels * 16, len(anchors_mask[0]) * (5 + num_classes), 1)

def forward(self, x):

# backbone

feat1, feat2, feat3 = self.backbone(x)

if self.backbone_name != "cspdarknet":

feat1 = self.conv_1x1_feat1(feat1)

feat2 = self.conv_1x1_feat2(feat2)

feat3 = self.conv_1x1_feat3(feat3)

# ---------------------------------------------------#

# 三个有效特征层

# feat1:80,80,256

# feat2:40,40,512

# feat3:20,20,1024

# ---------------------------------------------------#

# ---------------------------------------------------#

# 上采样进行特征融合

# ---------------------------------------------------#

# feat3:20, 20, 1024 -> P5:20, 20, 512

# 输入20, 20, 1024 卷积完成之后-> 得到 20, 20, 512 的特征层 ctrl右键可知上面为基础通道数64*8=512

P5 = self.conv_for_feat3(feat3)

# 20, 20, 512 -> 40, 40, 512

# 对20, 20, 512 特征层上采样之后获得 -> 40, 40, 512 特征层(上采样放大图像 内插值等方法)

P5_upsample = self.upsample(P5)

# 40, 40, 512 -> 40, 40, 1024

# P5上采样后结果40, 40, 512和feat2:40, 40, 512堆叠 最后变成 P4:40, 40, 1024

P4 = torch.cat([P5_upsample, feat2], 1)

# 40, 40, 1024 -> 40, 40, 512

# 40, 40, 1024 CSPlayer特征提取(没有残差边,输出通道数是基础通道数*8,变成512通道数) -> 40, 40, 512

P4 = self.conv3_for_upsample1(P4)

# 40, 40, 512 -> 40, 40, 256

# 卷积 通道数为基础通道数*4

P4 = self.conv_for_feat2(P4)

# 40, 40, 256 -> 80, 80, 256

# 上采样

P4_upsample = self.upsample(P4)

# 80, 80, 256 cat 80, 80, 256 -> 80, 80, 512

# 堆叠

P3 = torch.cat([P4_upsample, feat1], 1)

# 80, 80, 512 -> 80, 80, 256

# 同P4经过CSPlayer

P3 = self.conv3_for_upsample2(P3)# P3特征层两个处理过程:1.一个传入YoloHead获得分类预测结果和回归预测结果

# 2.另一个进行下采样继续进行特征融合

# ---------------------------------------------------#

# 下采样进行特征融合

# ---------------------------------------------------#

# 80, 80, 256 -> 40, 40, 256

# 下采样 高宽压缩

P3_downsample = self.down_sample1(P3)

# 40, 40, 256 cat 40, 40, 256 -> 40, 40, 512

# 堆叠

P4 = torch.cat([P3_downsample, P4], 1)

# 40, 40, 512 -> 40, 40, 512

# CSPlayer shortcut=False,通道数没变

P4 = self.conv3_for_downsample1(P4) # P4特征层两个处理:1.YoloHead 2.继续下采样进行特征融合

# 40, 40, 512 -> 20, 20, 512

# 下采样 高宽压缩

P4_downsample = self.down_sample2(P4)

# 20, 20, 512 cat 20, 20, 512 -> 20, 20, 1024

# 堆叠

P5 = torch.cat([P4_downsample, P5], 1)

# 20, 20, 1024 -> 20, 20, 1024

# CSPlayer特征提取

P5 = self.conv3_for_downsample2(P5) # P5特征层传入YoloHead

#三个加强后的有效特征层通过YoloHead获得分类预测结果和回归预测结果

#---------------------------------------------------#

# 第三个特征层

# y3=(batch_size,75,80,80)

#---------------------------------------------------#

out2 = self.yolo_head_P3(P3)

#---------------------------------------------------#

# 第二个特征层

# y2=(batch_size,75,40,40)

#---------------------------------------------------#

out1 = self.yolo_head_P4(P4)

#---------------------------------------------------#

# 第一个特征层

# y1=(batch_size,75,20,20)

#---------------------------------------------------#

out0 = self.yolo_head_P5(P5)

return out0, out1, out2

三、预测结果的解码

1、获得预测框与得分

由第二步我们可以获得三个特征层的预测结果,shape分别为 (N,20,20,75),(N,40,40,75),(N,80,80,75) 的数据。

但是这个预测结果并不对应着最终的预测框在图片上的位置,还需要解码才可以完成。在YoloV5里,每一个特征层上每一个特征点存在3个先验框。

每个特征层最后的255可以拆分成3个75,对应3个先验框的75个参数,我们先将其reshape一下,其结果为(N,20,20,3,25),(N,40.40,3,25),(N,80,80,3,25)。

如果使用的是voc训练集,类则为20种,最后的维度应该为75 = 3x25,三个特征层的shape为(20,20,25),(40,40,25),(80,80,25)。本人使用的也是VOC数据集

最后的75可以拆分成3个25,对应3个先验框的25个参数,25可以拆分成4+1+20。

前4个参数用于判断每一个特征点的回归参数,回归参数调整后可以获得预测框;

第5个参数用于判断每一个特征点是否包含物体;

最后20个参数用于判断每一个特征点所包含的物体种类。

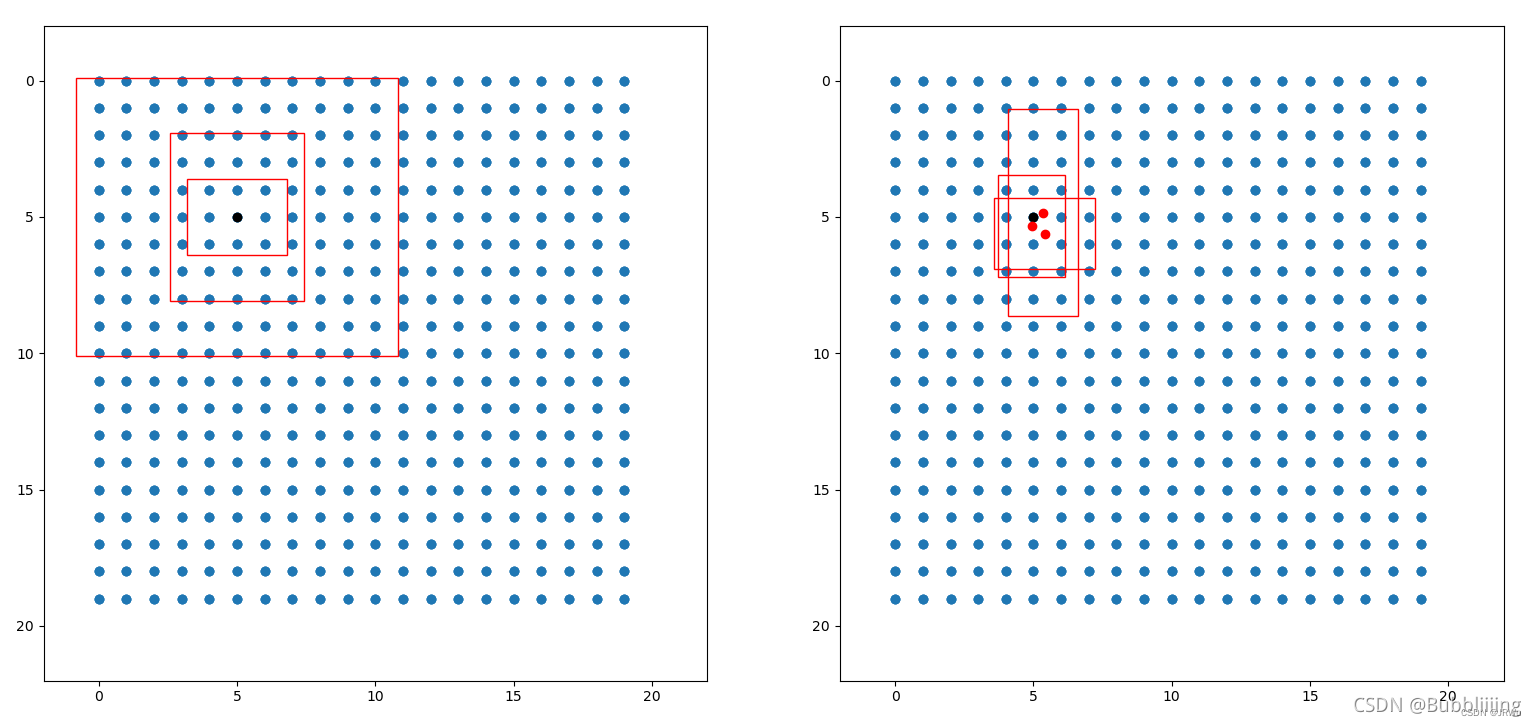

以 (N,20,20,3,25) 这个特征层为例,该特征层相当于将图像划分成20x20个特征点,如果某个特征点落在物体的对应框内,就用于预测该物体。

如图所示,蓝色的点为20x20的特征点,此时我们对左图黑色点的三个先验框进行解码操作演示:

1、进行中心预测点的计算,利用Regression预测结果前两个序号的内容对特征点的三个先验框中心坐标进行偏移,偏移后是右图红色的三个点;

2、进行预测框宽高的计算,利用Regression预测结果后两个序号的内容求指数后获得预测框的宽高;

3、此时获得的预测框就可以绘制在图片上了。

除去这样的解码操作,还有非极大抑制的操作需要进行,防止同一种类的框的堆积。

utils/utils_bbox.py

def decode_box(self, inputs):

outputs = []

for i, input in enumerate(inputs):

#-----------------------------------------------#

# 输入的input一共有三个,他们的shape分别是

# batch_size = 1

# batch_size, 3 * (4 + 1 + 80), 20, 20

# batch_size, 255, 40, 40

# batch_size, 255, 80, 80

#-----------------------------------------------#

batch_size = input.size(0)

input_height = input.size(2)

input_width = input.size(3)

#-----------------------------------------------#

# 输入为640x640时

# stride_h = stride_w = 32、16、8

#-----------------------------------------------#

stride_h = self.input_shape[0] / input_height

stride_w = self.input_shape[1] / input_width

#-------------------------------------------------#

# 此时获得的scaled_anchors大小是相对于特征层的

#-------------------------------------------------#

scaled_anchors = [(anchor_width / stride_w, anchor_height / stride_h) for anchor_width, anchor_height in self.anchors[self.anchors_mask[i]]]

#-----------------------------------------------#

# 输入的input一共有三个,他们的shape分别是

# batch_size, 3, 20, 20, 85

# batch_size, 3, 40, 40, 85

# batch_size, 3, 80, 80, 85

#-----------------------------------------------#

prediction = input.view(batch_size, len(self.anchors_mask[i]),

self.bbox_attrs, input_height, input_width).permute(0, 1, 3, 4, 2).contiguous()

#-----------------------------------------------#

# 先验框的中心位置的调整参数

#-----------------------------------------------#

x = torch.sigmoid(prediction[..., 0])

y = torch.sigmoid(prediction[..., 1])

#-----------------------------------------------#

# 先验框的宽高调整参数

#-----------------------------------------------#

w = torch.sigmoid(prediction[..., 2])

h = torch.sigmoid(prediction[..., 3])

#-----------------------------------------------#

# 获得置信度,是否有物体

#-----------------------------------------------#

conf = torch.sigmoid(prediction[..., 4])

#-----------------------------------------------#

# 种类置信度

#-----------------------------------------------#

pred_cls = torch.sigmoid(prediction[..., 5:])

FloatTensor = torch.cuda.FloatTensor if x.is_cuda else torch.FloatTensor

LongTensor = torch.cuda.LongTensor if x.is_cuda else torch.LongTensor

#----------------------------------------------------------#

# 生成网格,先验框中心,网格左上角

# batch_size,3,20,20

#----------------------------------------------------------#

grid_x = torch.linspace(0, input_width - 1, input_width).repeat(input_height, 1).repeat(

batch_size * len(self.anchors_mask[i]), 1, 1).view(x.shape).type(FloatTensor)

grid_y = torch.linspace(0, input_height - 1, input_height).repeat(input_width, 1).t().repeat(

batch_size * len(self.anchors_mask[i]), 1, 1).view(y.shape).type(FloatTensor)

#----------------------------------------------------------#

# 按照网格格式生成先验框的宽高

# batch_size,3,20,20

#----------------------------------------------------------#

anchor_w = FloatTensor(scaled_anchors).index_select(1, LongTensor([0]))

anchor_h = FloatTensor(scaled_anchors).index_select(1, LongTensor([1]))

anchor_w = anchor_w.repeat(batch_size, 1).repeat(1, 1, input_height * input_width).view(w.shape)

anchor_h = anchor_h.repeat(batch_size, 1).repeat(1, 1, input_height * input_width).view(h.shape)

#----------------------------------------------------------#

# 利用预测结果对先验框进行调整

# 首先调整先验框的中心,从先验框中心向右下角偏移

# 再调整先验框的宽高。

# x 0 ~ 1 => 0 ~ 2 => -0.5, 1.5 => 负责一定范围的目标的预测

# y 0 ~ 1 => 0 ~ 2 => -0.5, 1.5 => 负责一定范围的目标的预测

# w 0 ~ 1 => 0 ~ 2 => 0 ~ 4 => 先验框的宽高调节范围为0~4倍

# h 0 ~ 1 => 0 ~ 2 => 0 ~ 4 => 先验框的宽高调节范围为0~4倍

#----------------------------------------------------------#

pred_boxes = FloatTensor(prediction[..., :4].shape)

pred_boxes[..., 0] = x.data * 2. - 0.5 + grid_x

pred_boxes[..., 1] = y.data * 2. - 0.5 + grid_y

pred_boxes[..., 2] = (w.data * 2) ** 2 * anchor_w

pred_boxes[..., 3] = (h.data * 2) ** 2 * anchor_h

#----------------------------------------------------------#

# 将输出结果归一化成小数的形式

#----------------------------------------------------------#

_scale = torch.Tensor([input_width, input_height, input_width, input_height]).type(FloatTensor)

output = torch.cat((pred_boxes.view(batch_size, -1, 4) / _scale,

conf.view(batch_size, -1, 1), pred_cls.view(batch_size, -1, self.num_classes)), -1)

outputs.append(output.data)

return outputs

2、得分筛选与非极大值抑制

得到最终的预测结果后还要进行得分排序与非极大抑制筛选。

得分筛选就是筛选出得分满足confidence置信度的预测框。

非极大抑制就是筛选出一定区域内属于同一种类得分最大的框。

得分筛选与非极大抑制的过程可以概括如下:

1、找出该图片中得分大于门限函数的框。在进行重合框筛选前就进行得分的筛选可以大幅度减少框的数量。

2、对种类进行循环,非极大抑制的作用是筛选出一定区域内属于同一种类得分最大的框,对种类进行循环可以帮助我们对每一个类分别进行非极大抑制。

3、根据得分对该种类进行从大到小排序。

4、每次取出得分最大的框,计算其与其它所有预测框的重合程度,重合程度过大的则剔除。

得分筛选与非极大抑制后的结果就可以用于绘制预测框了。

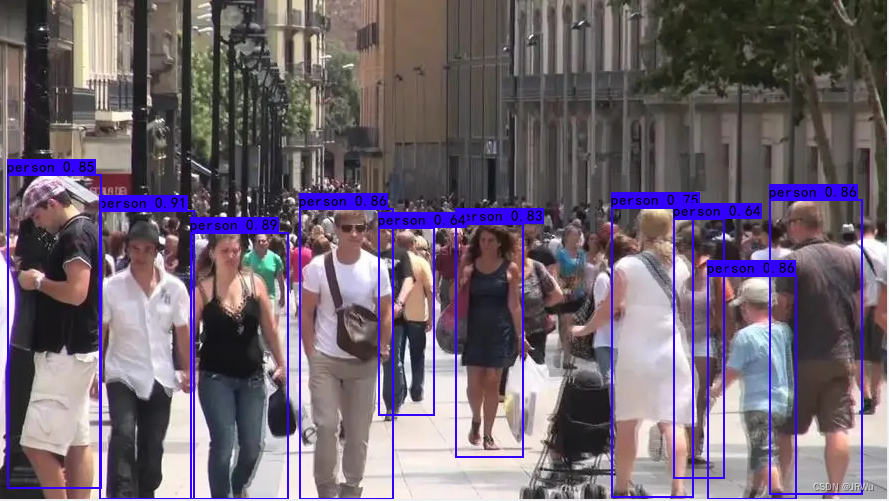

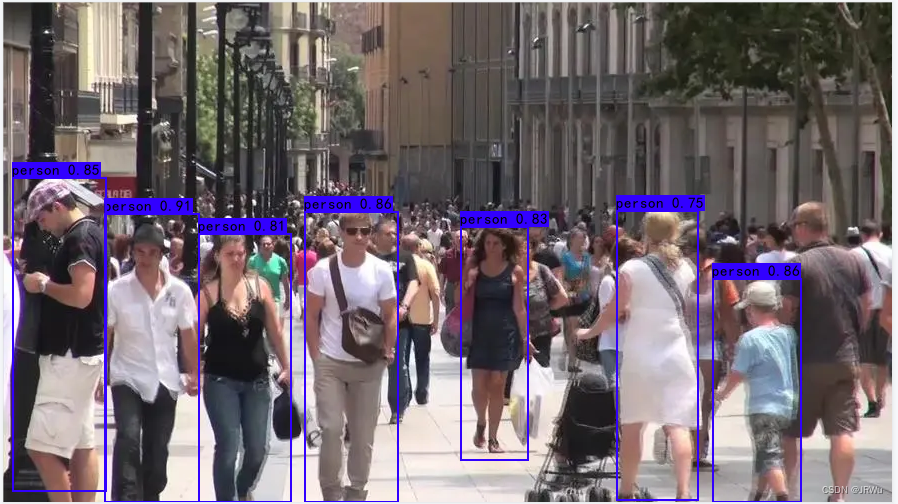

nms_iou=0.3(越小越严格即距离相近的两个类别会选取得分高的。即框少了):

nms_iou=0.01:

def non_max_suppression(self, prediction, num_classes, input_shape, image_shape, letterbox_image, conf_thres=0.5, nms_thres=0.4):

#----------------------------------------------------------#

# 将预测结果的格式从中心点宽高的形式转换成左上角右下角的格式。

# prediction [batch_size, num_anchors, 85]

#----------------------------------------------------------#

box_corner = prediction.new(prediction.shape)

box_corner[:, :, 0] = prediction[:, :, 0] - prediction[:, :, 2] / 2

box_corner[:, :, 1] = prediction[:, :, 1] - prediction[:, :, 3] / 2

box_corner[:, :, 2] = prediction[:, :, 0] + prediction[:, :, 2] / 2

box_corner[:, :, 3] = prediction[:, :, 1] + prediction[:, :, 3] / 2

prediction[:, :, :4] = box_corner[:, :, :4]

output = [None for _ in range(len(prediction))]

# 对每一个图片进行循环

for i, image_pred in enumerate(prediction):

#----------------------------------------------------------#

# 对种类预测部分取max。

# class_conf [num_anchors, 1] 种类置信度

# class_pred [num_anchors, 1] 种类

#----------------------------------------------------------#

class_conf, class_pred = torch.max(image_pred[:, 5:5 + num_classes], 1, keepdim=True)

#----------------------------------------------------------#

# 利用置信度进行第一轮筛选

#----------------------------------------------------------#

conf_mask = (image_pred[:, 4] * class_conf[:, 0] >= conf_thres).squeeze() # 种类置信度和先验框置信度相乘然后进行门限判断,大于则保留

#----------------------------------------------------------#

# 根据置信度进行预测结果的筛选

# 保留满足置信度要求的预测框

#----------------------------------------------------------#

image_pred = image_pred[conf_mask]

class_conf = class_conf[conf_mask]

class_pred = class_pred[conf_mask]

if not image_pred.size(0): # 没满足的预测框就跳过重新循环下一张图片

continue

#-------------------------------------------------------------------------#

# detections [num_anchors, 7]

# 7的内容为:x1, y1, x2, y2, obj_conf, class_conf, class_pred 堆叠到一起,方便后续处理

# x1, y1, x2, y2:预测框左上角右下角坐标

# obj_conf:预测框置信度

# class_conf:种类置信度

# class_pred:种类

#-------------------------------------------------------------------------#

detections = torch.cat((image_pred[:, :5], class_conf.float(), class_pred.float()), 1)

#------------------------------------------#

# 获得预测结果中包含的所有种类

# 对堆叠后的结果的最后一个序号的内容也就是种类取unique,判断预测框里都有什么种类

#------------------------------------------#

unique_labels = detections[:, -1].cpu().unique()

if prediction.is_cuda:

unique_labels = unique_labels.cuda()

detections = detections.cuda()

# 对预测框内的种类进行循环

for c in unique_labels:

#------------------------------------------#

# 获得某一类得分筛选后全部的预测结果

# 取出某一种类的预测框

#------------------------------------------#

detections_class = detections[detections[:, -1] == c]

#------------------------------------------#

# 使用官方自带的非极大抑制会速度更快一些!

# 筛选出一定区域内,属于同一种类得分最大的框

#------------------------------------------#

keep = nms(

detections_class[:, :4],

detections_class[:, 4] * detections_class[:, 5],

nms_thres

)

# 保留非极大抑制结果

max_detections = detections_class[keep]

# # 按照存在物体的置信度排序

# _, conf_sort_index = torch.sort(detections_class[:, 4]*detections_class[:, 5], descending=True)

# detections_class = detections_class[conf_sort_index]

# # 进行非极大抑制

# max_detections = []

# while detections_class.size(0):

# # 取出这一类置信度最高的,一步一步往下判断,判断重合程度是否大于nms_thres,如果是则去除掉

# max_detections.append(detections_class[0].unsqueeze(0))

# if len(detections_class) == 1:

# break

# ious = bbox_iou(max_detections[-1], detections_class[1:])

# detections_class = detections_class[1:][ious < nms_thres]

# # 堆叠

# max_detections = torch.cat(max_detections).data

# Add max detections to outputs

# 将每一种类非极大抑制的结果堆叠到一起方便,后续处理

output[i] = max_detections if output[i] is None else torch.cat((output[i], max_detections))

# 调整非极大抑制后的预测框使其适合原图,因为使用了不失真的resize,有灰条,调整原点

if output[i] is not None:

output[i] = output[i].cpu().numpy()

box_xy, box_wh = (output[i][:, 0:2] + output[i][:, 2:4])/2, output[i][:, 2:4] - output[i][:, 0:2]

output[i][:, :4] = self.yolo_correct_boxes(box_xy, box_wh, input_shape, image_shape, letterbox_image)

# 调整后的预测框就是适合原图的,返回结果

return output

四、训练部分

1、计算loss所需内容

计算loss实际上是网络的预测结果和网络的真实结果的对比。

和网络的预测结果一样,网络的损失也由三个部分组成,分别是Reg部分、Obj部分、Cls部分。Reg部分是特征点的回归参数判断、Obj部分是特征点是否包含物体判断、Cls部分是特征点包含的物体的种类。

2、正样本的匹配过程

在YoloV5中,训练时正样本的匹配过程可以分为两部分。

a、匹配先验框。

b、匹配特征点。

所谓正样本匹配,就是寻找哪些先验框被认为有对应的真实框,并且负责这个真实框的预测。

a、匹配先验框

在YoloV5网络中,一共设计了9个不同大小的先验框。每个输出的特征层对应3个先验框。

对于任何一个真实框gt,YoloV5不再使用iou进行正样本的匹配,而是直接采用高宽比进行匹配,即使用真实框和9个不同大小的先验框计算宽高比。

如果真实框与某个先验框的宽高比例大于设定阈值,则说明该真实框和该先验框匹配度不够,将该先验框认为是负样本。

比如此时有一个真实框,它的宽高为[200, 200],是一个正方形。YoloV5默认设置的9个先验框为[10,13], [16,30], [33,23], [30,61], [62,45], [59,119], [116,90], [156,198], [373,326]。设定阈值门限为4。

此时我们需要计算该真实框和9个先验框的宽高比例。 比较宽高时存在两个情况,一个是真实框的宽高比先验框大,一个是先验框的宽高比真实框大。 因此我们需要同时计算:真实框的宽高/先验框的宽高;先验框的宽高/真实框的宽高。然后在这其中选取最大值。

下个列表就是比较结果,这是一个shape为[9, 4]的矩阵,9代表9个先验框,4代表真实框的宽高/先验框的宽高;先验框的宽高/真实框的宽高。

[[20. 15.38461538 0.05 0.065 ]

[12.5 6.66666667 0.08 0.15 ]

[ 6.06060606 8.69565217 0.165 0.115 ]

[ 6.66666667 3.27868852 0.15 0.305 ]

[ 3.22580645 4.44444444 0.31 0.225 ]

[ 3.38983051 1.68067227 0.295 0.595 ]

[ 1.72413793 2.22222222 0.58 0.45 ]

[ 1.28205128 1.01010101 0.78 0.99 ]

[ 0.53619303 0.61349693 1.865 1.63 ]]

然后对每个先验框的比较结果取最大值。获得下述矩阵:

[20. 12.5 8.69565217 6.66666667 4.44444444 3.38983051

2.22222222 1.28205128 1.865 ]

**之后我们判断,哪些先验框的比较结果的值小于门限。**可以知道[59,119], [116,90], [156,198], [373,326]四个先验框均满足需求。

[116,90], [156,198], [373,326]属于20,20的特征层。

[59,119]属于40,40的特征层。

此时我们已经可以判断哪些大小的先验框可用于该真实框的预测。

b、匹配特征点

在过去的Yolo系列中,每个真实框由其中心点所在的网格内的左上角特征点来负责预测。

对于被选中的特征层,首先计算真实框落在哪个网格内,此时该网格左上角特征点便是一个负责预测的特征点。

同时利用四舍五入规则,找出最近的两个网格,将这三个网格都认为是负责预测该真实框的。

红色点表示该真实框的中心,除了当前所处的网格外,其2个最近的邻域网格也被选中。从这里就可以发现预测框的XY轴偏移部分的取值范围不再是0-1,而是0.5-1.5。

找到对应特征点后,对应特征点在a中被选中的先验框负责该真实框的预测。

3、计算Loss

由第一部分可知,YoloV5的损失由三个部分组成:

1、Reg部分,由第2部分可知道每个真实框对应的先验框,获取到每个框对应的先验框后,取出该先验框对应的预测框,利用真实框和预测框计算CIOU损失,作为Reg部分的Loss组成。

2、Obj部分,由第2部分可知道每个真实框对应的先验框,所有真实框对应的先验框都是正样本,剩余的先验框均为负样本,根据正负样本和特征点的是否包含物体的预测结果计算交叉熵损失,作为Obj部分的Loss组成。

3、Cls部分,由第三部分可知道每个真实框对应的先验框,获取到每个框对应的先验框后,取出该先验框的种类预测结果,根据真实框的种类和先验框的种类预测结果计算交叉熵损失,作为Cls部分的Loss组成。

import math

from copy import deepcopy

from functools import partial

import numpy as np

import torch

import torch.nn as nn

class YOLOLoss(nn.Module):

def __init__(self, anchors, num_classes, input_shape, cuda, anchors_mask = [[6,7,8], [3,4,5], [0,1,2]], label_smoothing = 0):

super(YOLOLoss, self).__init__()

#-----------------------------------------------------------#

# 20x20的特征层对应的anchor是[116,90],[156,198],[373,326]

# 40x40的特征层对应的anchor是[30,61],[62,45],[59,119]

# 80x80的特征层对应的anchor是[10,13],[16,30],[33,23]

#-----------------------------------------------------------#

self.anchors = anchors

self.num_classes = num_classes

self.bbox_attrs = 5 + num_classes

self.input_shape = input_shape

self.anchors_mask = anchors_mask

self.label_smoothing = label_smoothing

self.threshold = 4

self.balance = [0.4, 1.0, 4]

self.box_ratio = 0.05

self.obj_ratio = 1 * (input_shape[0] * input_shape[1]) / (640 ** 2)

self.cls_ratio = 0.5 * (num_classes / 80)

self.cuda = cuda

def clip_by_tensor(self, t, t_min, t_max):

t = t.float()

result = (t >= t_min).float() * t + (t < t_min).float() * t_min

result = (result <= t_max).float() * result + (result > t_max).float() * t_max

return result

def MSELoss(self, pred, target):

return torch.pow(pred - target, 2)

def BCELoss(self, pred, target):

epsilon = 1e-7

pred = self.clip_by_tensor(pred, epsilon, 1.0 - epsilon)

output = - target * torch.log(pred) - (1.0 - target) * torch.log(1.0 - pred)

return output

def box_giou(self, b1, b2):

"""

输入为:

----------

b1: tensor, shape=(batch, feat_w, feat_h, anchor_num, 4), xywh

b2: tensor, shape=(batch, feat_w, feat_h, anchor_num, 4), xywh

返回为:

-------

giou: tensor, shape=(batch, feat_w, feat_h, anchor_num, 1)

"""

#----------------------------------------------------#

# 求出预测框左上角右下角

#----------------------------------------------------#

b1_xy = b1[..., :2]

b1_wh = b1[..., 2:4]

b1_wh_half = b1_wh/2.

b1_mins = b1_xy - b1_wh_half

b1_maxes = b1_xy + b1_wh_half

#----------------------------------------------------#

# 求出真实框左上角右下角

#----------------------------------------------------#

b2_xy = b2[..., :2]

b2_wh = b2[..., 2:4]

b2_wh_half = b2_wh/2.

b2_mins = b2_xy - b2_wh_half

b2_maxes = b2_xy + b2_wh_half

#----------------------------------------------------#

# 求真实框和预测框所有的iou

#----------------------------------------------------#

intersect_mins = torch.max(b1_mins, b2_mins)

intersect_maxes = torch.min(b1_maxes, b2_maxes)

intersect_wh = torch.max(intersect_maxes - intersect_mins, torch.zeros_like(intersect_maxes))

intersect_area = intersect_wh[..., 0] * intersect_wh[..., 1]

b1_area = b1_wh[..., 0] * b1_wh[..., 1]

b2_area = b2_wh[..., 0] * b2_wh[..., 1]

union_area = b1_area + b2_area - intersect_area

iou = intersect_area / union_area

#----------------------------------------------------#

# 找到包裹两个框的最小框的左上角和右下角

#----------------------------------------------------#

enclose_mins = torch.min(b1_mins, b2_mins)

enclose_maxes = torch.max(b1_maxes, b2_maxes)

enclose_wh = torch.max(enclose_maxes - enclose_mins, torch.zeros_like(intersect_maxes))

#----------------------------------------------------#

# 计算对角线距离

#----------------------------------------------------#

enclose_area = enclose_wh[..., 0] * enclose_wh[..., 1]

giou = iou - (enclose_area - union_area) / enclose_area

return giou

#---------------------------------------------------#

# 平滑标签

#---------------------------------------------------#

def smooth_labels(self, y_true, label_smoothing, num_classes):

return y_true * (1.0 - label_smoothing) + label_smoothing / num_classes

# YoloV5损失函数的计算

def forward(self, l, input, targets=None, y_true=None):

#----------------------------------------------------#

# 1. l 代表使用的是第几个有效特征层

# 2. input(即YoloV5网络的输出)的shape为:

# bs, 3*(5+num_classes), 20, 20

# bs, 3*(5+num_classes), 40, 40

# bs, 3*(5+num_classes), 80, 80

# 3. targets 真实框的标签情况 [batch_size, num_gt, 5]

#----------------------------------------------------#

#--------------------------------#

# 获得图片数量,特征层的高和宽

# bs, 3*(5+num_classes), 20, 20该特征层的高宽为20, 20

#--------------------------------#

bs = input.size(0) # bs即batch_size:图片的数量

in_h = input.size(2)

in_w = input.size(3)

#-----------------------------------------------------------------------#

# 计算步长

# 每一个特征点对应原来的图片上多少个像素点

# [640, 640] 高的步长为640 / 20 = 32,宽的步长为640 / 20 = 32

# 如果特征层为20x20的话,一个特征点就对应原来的图片上的32个像素点

# 如果特征层为40x40的话,一个特征点就对应原来的图片上的16个像素点

# 如果特征层为80x80的话,一个特征点就对应原来的图片上的8个像素点

# stride_h = stride_w = 32、16、8

#-----------------------------------------------------------------------#

stride_h = self.input_shape[0] / in_h

stride_w = self.input_shape[1] / in_w

#-------------------------------------------------#

# 此时获得的scaled_anchors大小是相对于特征层的

#-------------------------------------------------#

scaled_anchors = [(a_w / stride_w, a_h / stride_h) for a_w, a_h in self.anchors]

#-----------------------------------------------#

# 输入的input一共有三个,他们的shape分别是

# bs, 3 * (5+num_classes), 20, 20 => bs, 3, 5 + num_classes, 20, 20 => batch_size, 3, 20, 20, 5 + num_classes

# batch_size, 3, 20, 20, 5 + num_classes

# batch_size, 3, 40, 40, 5 + num_classes

# batch_size, 3, 80, 80, 5 + num_classes

#-----------------------------------------------#

prediction = input.view(bs, len(self.anchors_mask[l]), self.bbox_attrs, in_h, in_w).permute(0, 1, 3, 4, 2).contiguous()

#-----------------------------------------------#

# 先验框的中心位置的调整参数

#-----------------------------------------------#

x = torch.sigmoid(prediction[..., 0])

y = torch.sigmoid(prediction[..., 1])

#-----------------------------------------------#

# 先验框的宽高调整参数

#-----------------------------------------------#

w = torch.sigmoid(prediction[..., 2])

h = torch.sigmoid(prediction[..., 3])

#-----------------------------------------------#

# 获得置信度,是否有物体

#-----------------------------------------------#

conf = torch.sigmoid(prediction[..., 4])

#-----------------------------------------------#

# 种类置信度

#-----------------------------------------------#

pred_cls = torch.sigmoid(prediction[..., 5:])

#-----------------------------------------------#

# self.get_target已经合并到dataloader中

# 原因是在这里执行过慢,会大大延长训练时间

#-----------------------------------------------#

# y_true, noobj_mask = self.get_target(l, targets, scaled_anchors, in_h, in_w)

#---------------------------------------------------------------#

# 将预测结果进行解码,判断预测结果和真实值的重合程度

# 如果重合程度过大则忽略,因为这些特征点属于预测比较准确的特征点

# 作为负样本不合适

#----------------------------------------------------------------#

pred_boxes = self.get_pred_boxes(l, x, y, h, w, targets, scaled_anchors, in_h, in_w)

if self.cuda:

y_true = y_true.type_as(x)

loss = 0

n = torch.sum(y_true[..., 4] == 1)

if n != 0:

#---------------------------------------------------------------#

# 计算预测结果和真实结果的giou,计算对应有真实框的先验框的giou损失

# loss_cls计算对应有真实框的先验框的分类损失

#----------------------------------------------------------------#

giou = self.box_giou(pred_boxes, y_true[..., :4]).type_as(x)

loss_loc = torch.mean((1 - giou)[y_true[..., 4] == 1])

loss_cls = torch.mean(self.BCELoss(pred_cls[y_true[..., 4] == 1], self.smooth_labels(y_true[..., 5:][y_true[..., 4] == 1], self.label_smoothing, self.num_classes)))

loss += loss_loc * self.box_ratio + loss_cls * self.cls_ratio

#-----------------------------------------------------------#

# 计算置信度的loss

# 也就意味着先验框对应的预测框预测的更准确

# 它才是用来预测这个物体的。

#-----------------------------------------------------------#

tobj = torch.where(y_true[..., 4] == 1, giou.detach().clamp(0), torch.zeros_like(y_true[..., 4]))

else:

tobj = torch.zeros_like(y_true[..., 4])

loss_conf = torch.mean(self.BCELoss(conf, tobj))

loss += loss_conf * self.balance[l] * self.obj_ratio

# if n != 0:

# print(loss_loc * self.box_ratio, loss_cls * self.cls_ratio, loss_conf * self.balance[l] * self.obj_ratio)

return loss

# 找最邻近两个网格

def get_near_points(self, x, y, i, j):

sub_x = x - i

sub_y = y - j

if sub_x > 0.5 and sub_y > 0.5:

return [[0, 0], [1, 0], [0, 1]]

elif sub_x < 0.5 and sub_y > 0.5:

return [[0, 0], [-1, 0], [0, 1]]

elif sub_x < 0.5 and sub_y < 0.5:

return [[0, 0], [-1, 0], [0, -1]]

else:

return [[0, 0], [1, 0], [0, -1]]

def get_target(self, l, targets, anchors, in_h, in_w):

#-----------------------------------------------------#

# 计算一共有多少张图片

#-----------------------------------------------------#

bs = len(targets)

#-----------------------------------------------------#

# 用于选取哪些先验框不包含物体

# bs, 3, 20, 20

#-----------------------------------------------------#

noobj_mask = torch.ones(bs, len(self.anchors_mask[l]), in_h, in_w, requires_grad = False)

#-----------------------------------------------------#

# 帮助找到每一个先验框最对应的真实框

#-----------------------------------------------------#

box_best_ratio = torch.zeros(bs, len(self.anchors_mask[l]), in_h, in_w, requires_grad = False)

#-----------------------------------------------------#

# batch_size, 3, 20, 20, 5 + num_classes

#-----------------------------------------------------#

y_true = torch.zeros(bs, len(self.anchors_mask[l]), in_h, in_w, self.bbox_attrs, requires_grad = False)

for b in range(bs):

if len(targets[b])==0: # 判断每张图片真实框数量是否为0

continue

# 真实框匹配过程

batch_target = torch.zeros_like(targets[b])

#-------------------------------------------------------#

# 计算出正样本在特征层上的中心点

# 获得真实框相对于特征层的大小

#-------------------------------------------------------#

# 真实框乘上特征层的高和宽

batch_target[:, [0,2]] = targets[b][:, [0,2]] * in_w

batch_target[:, [1,3]] = targets[b][:, [1,3]] * in_h

batch_target[:, 4] = targets[b][:, 4]

batch_target = batch_target.cpu()

#-----------------------------------------------------------------------------#

# 比较真实框和先验框,实现二者配对

# batch_target : num_true_box, 5

# batch_target[:, 2:4] : num_true_box, 2

# torch.unsqueeze(batch_target[:, 2:4], 1) : num_true_box, 1, 2

# anchors : 9, 2

# torch.unsqueeze(torch.FloatTensor(anchors), 0) : 1, 9, 2

# ratios_of_gt_anchors : num_true_box, 9, 2

# ratios_of_anchors_gt : num_true_box, 9, 2

#

# ratios : num_true_box, 9, 4

# max_ratios : num_true_box, 9

# max_ratios每一个真实框和每一个先验框的最大宽高比!

#------------------------------------------------------------------------------#

# 两种情况:一个是真实框的宽高比先验框大,一个是先验框的宽高比真实框大

ratios_of_gt_anchors = torch.unsqueeze(batch_target[:, 2:4], 1) / torch.unsqueeze(torch.FloatTensor(anchors), 0) # 真实框的宽高比先验框大

ratios_of_anchors_gt = torch.unsqueeze(torch.FloatTensor(anchors), 0) / torch.unsqueeze(batch_target[:, 2:4], 1) # 先验框的宽高比真实框大

ratios = torch.cat([ratios_of_gt_anchors, ratios_of_anchors_gt], dim = -1) # 比值堆叠

max_ratios, _ = torch.max(ratios, dim = -1) # 取最大值

for t, ratio in enumerate(max_ratios):

# 对每一个真实框和9个(3个特征层,每个特征层的每个特征点有3个先验框)先验框进行比较

#-------------------------------------------------------#

# ratio : 9

#-------------------------------------------------------#

over_threshold = ratio < self.threshold # 取出宽高比,判断是否小于门限

over_threshold[torch.argmin(ratio)] = True # 保证每一个真实框至少有一个先验框与其匹配

# 对当前特征层所有的先验框进行循环

for k, mask in enumerate(self.anchors_mask[l]):

# 判断该先验框是否满足门限要求

if not over_threshold[mask]:

continue

# 若满足门限要求会先取出当前先验框对应的中心坐标并取整,取整就相当于那些红点会变到最近的红点的位置

#----------------------------------------#

# 获得真实框属于哪个网格点(真实框中心坐标)

# x 1.25 => 1

# y 3.75 => 3

#----------------------------------------#

i = torch.floor(batch_target[t, 0]).long()

j = torch.floor(batch_target[t, 1]).long()

offsets = self.get_near_points(batch_target[t, 0], batch_target[t, 1], i, j)

for offset in offsets:

local_i = i + offset[0]

local_j = j + offset[1]

if local_i >= in_w or local_i < 0 or local_j >= in_h or local_j < 0:

continue

if box_best_ratio[b, k, local_j, local_i] != 0:

if box_best_ratio[b, k, local_j, local_i] > ratio[mask]:

y_true[b, k, local_j, local_i, :] = 0

else:

continue

#----------------------------------------#

# 取出真实框的种类

#----------------------------------------#

c = batch_target[t, 4].long()

#----------------------------------------#

# noobj_mask代表无目标的特征点

#----------------------------------------#

noobj_mask[b, k, local_j, local_i] = 0

#----------------------------------------#

# tx、ty代表中心调整参数的真实值

#----------------------------------------#

y_true[b, k, local_j, local_i, 0] = batch_target[t, 0]

y_true[b, k, local_j, local_i, 1] = batch_target[t, 1]

y_true[b, k, local_j, local_i, 2] = batch_target[t, 2]

y_true[b, k, local_j, local_i, 3] = batch_target[t, 3]

y_true[b, k, local_j, local_i, 4] = 1

y_true[b, k, local_j, local_i, c + 5] = 1

#----------------------------------------#

# 获得当前先验框最好的比例

#----------------------------------------#

box_best_ratio[b, k, local_j, local_i] = ratio[mask]

return y_true, noobj_mask

def get_pred_boxes(self, l, x, y, h, w, targets, scaled_anchors, in_h, in_w):

#-----------------------------------------------------#

# 计算一共有多少张图片

#-----------------------------------------------------#

bs = len(targets)

#-----------------------------------------------------#

# 生成网格,先验框中心,网格左上角

#-----------------------------------------------------#

grid_x = torch.linspace(0, in_w - 1, in_w).repeat(in_h, 1).repeat(

int(bs * len(self.anchors_mask[l])), 1, 1).view(x.shape).type_as(x)

grid_y = torch.linspace(0, in_h - 1, in_h).repeat(in_w, 1).t().repeat(

int(bs * len(self.anchors_mask[l])), 1, 1).view(y.shape).type_as(x)

# 生成先验框的宽高

scaled_anchors_l = np.array(scaled_anchors)[self.anchors_mask[l]]

anchor_w = torch.Tensor(scaled_anchors_l).index_select(1, torch.LongTensor([0])).type_as(x)

anchor_h = torch.Tensor(scaled_anchors_l).index_select(1, torch.LongTensor([1])).type_as(x)

anchor_w = anchor_w.repeat(bs, 1).repeat(1, 1, in_h * in_w).view(w.shape)

anchor_h = anchor_h.repeat(bs, 1).repeat(1, 1, in_h * in_w).view(h.shape)

#-------------------------------------------------------#

# 计算调整后的先验框中心与宽高

#-------------------------------------------------------#

pred_boxes_x = torch.unsqueeze(x * 2. - 0.5 + grid_x, -1)

pred_boxes_y = torch.unsqueeze(y * 2. - 0.5 + grid_y, -1)

pred_boxes_w = torch.unsqueeze((w * 2) ** 2 * anchor_w, -1)

pred_boxes_h = torch.unsqueeze((h * 2) ** 2 * anchor_h, -1)

pred_boxes = torch.cat([pred_boxes_x, pred_boxes_y, pred_boxes_w, pred_boxes_h], dim = -1)

return pred_boxes

训练自己的YoloV5模型

注意文件存放的目录

一、数据集的准备

大佬为大家准备好的数据集链接

VOC数据集下载地址如下,里面已经包括了训练集、测试集、验证集(与测试集一样),无需再次划分:

链接: https://pan.baidu.com/s/19Mw2u_df_nBzsC2lg20fQA

提取码: j5ge

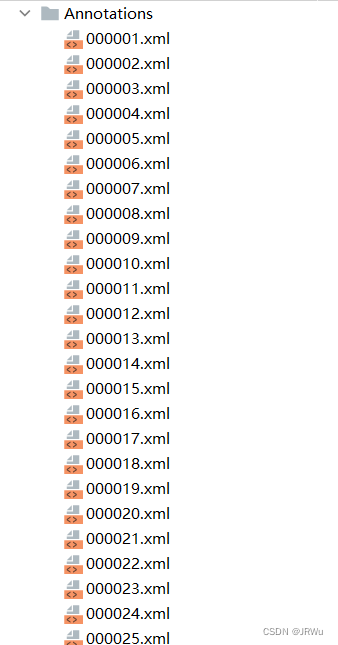

训练前将标签文件放在VOCdevkit文件夹下的VOC2007文件夹下的Annotation中。

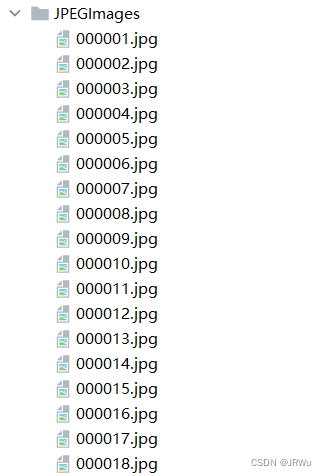

训练前将图片文件放在VOCdevkit文件夹下的VOC2007文件夹下的JPEGImages中。

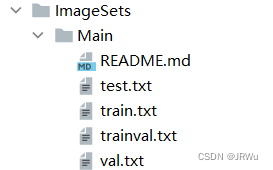

划分测试集test.txt(用来进行MAP计算,MAP是指标)、训练集train.txt、验证集val,txt、trainval.txt没用到

二、数据集的处理

在完成数据集的摆放之后,我们需要对数据集进行下一步的处理,目的是获得训练用的2007_train.txt以及2007_val.txt,需要用到根目录下的voc_annotation.py。

voc_annotation.py里面有一些参数需要设置。

分别是annotation_mode、classes_path、trainval_percent、train_percent、VOCdevkit_path,第一次训练可以仅修改classes_path

#--------------------------------------------------------------------------------------------------------------------------------#

# annotation_mode用于指定该文件运行时计算的内容

# annotation_mode为0代表整个标签处理过程,包括获得VOCdevkit/VOC2007/ImageSets里面的txt以及训练用的2007_train.txt、2007_val.txt

# annotation_mode为1代表获得VOCdevkit/VOC2007/ImageSets里面的txt

# annotation_mode为2代表获得训练用的2007_train.txt、2007_val.txt

#--------------------------------------------------------------------------------------------------------------------------------#

annotation_mode = 0

#-------------------------------------------------------------------#

# 必须要修改,用于生成2007_train.txt、2007_val.txt的目标信息

# 与训练和预测所用的classes_path一致即可

# 如果生成的2007_train.txt里面没有目标信息

# 那么就是因为classes没有设定正确

# 仅在annotation_mode为0和2的时候有效

#-------------------------------------------------------------------#

classes_path = 'model_data/voc_classes.txt'

#--------------------------------------------------------------------------------------------------------------------------------#

# trainval_percent用于指定(训练集+验证集)与测试集的比例,默认情况下 (训练集+验证集):测试集 = 9:1

# train_percent用于指定(训练集+验证集)中训练集与验证集的比例,默认情况下 训练集:验证集 = 9:1

# 仅在annotation_mode为0和1的时候有效

#--------------------------------------------------------------------------------------------------------------------------------#

trainval_percent = 0.9

train_percent = 0.9

#-------------------------------------------------------#

# 指向VOC数据集所在的文件夹

# 默认指向根目录下的VOC数据集

#-------------------------------------------------------#

VOCdevkit_path = 'VOCdevkit'

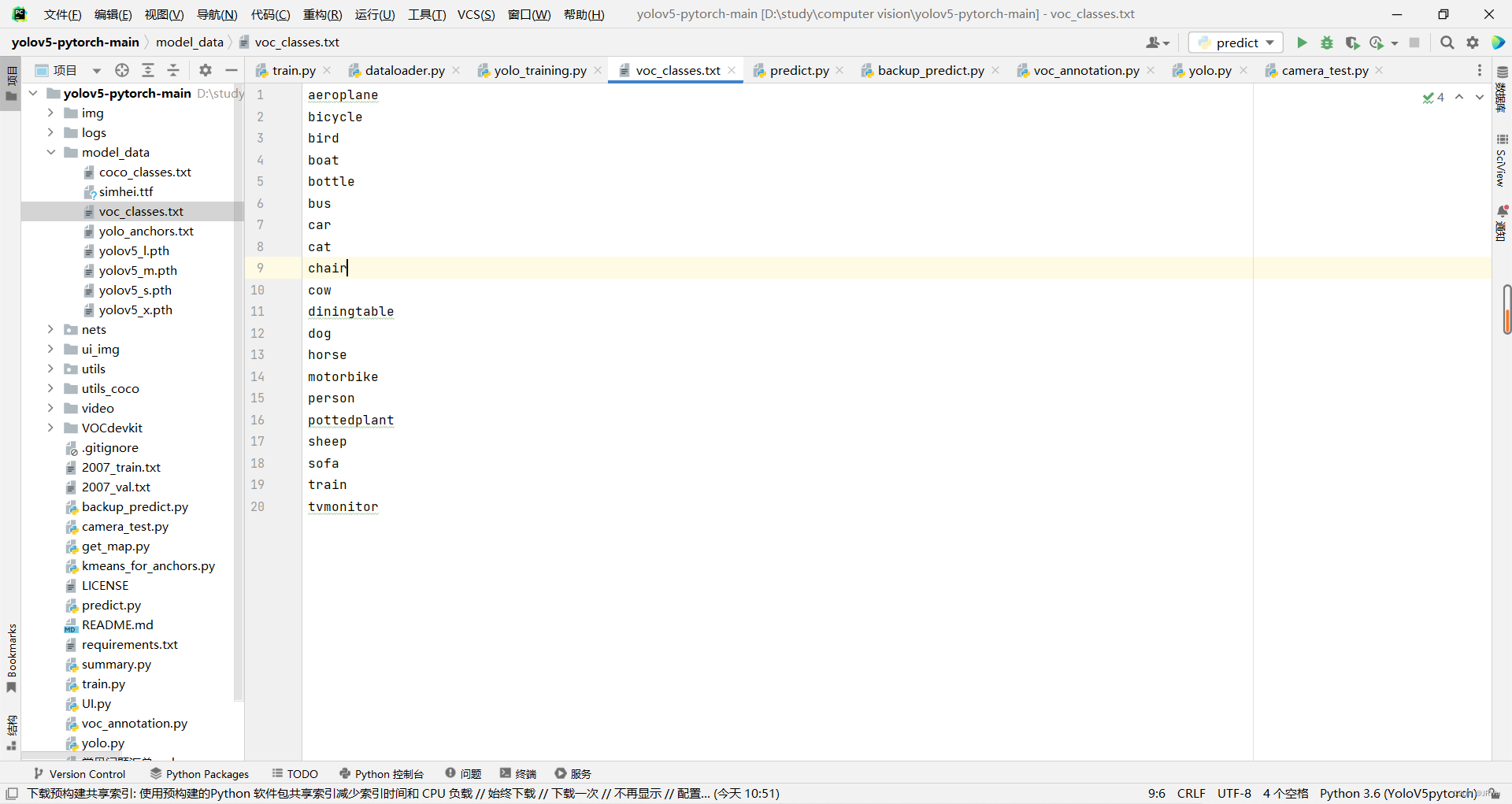

classes_path用于指向检测类别所对应的txt,以voc数据集为例,我们用的txt为:

训练自己的数据集时,可以自己建立一个cls_classes.txt,里面写自己所需要区分的类别。

训练自己的数据集时,可以自己建立一个cls_classes.txt,里面写自己所需要区分的类别。

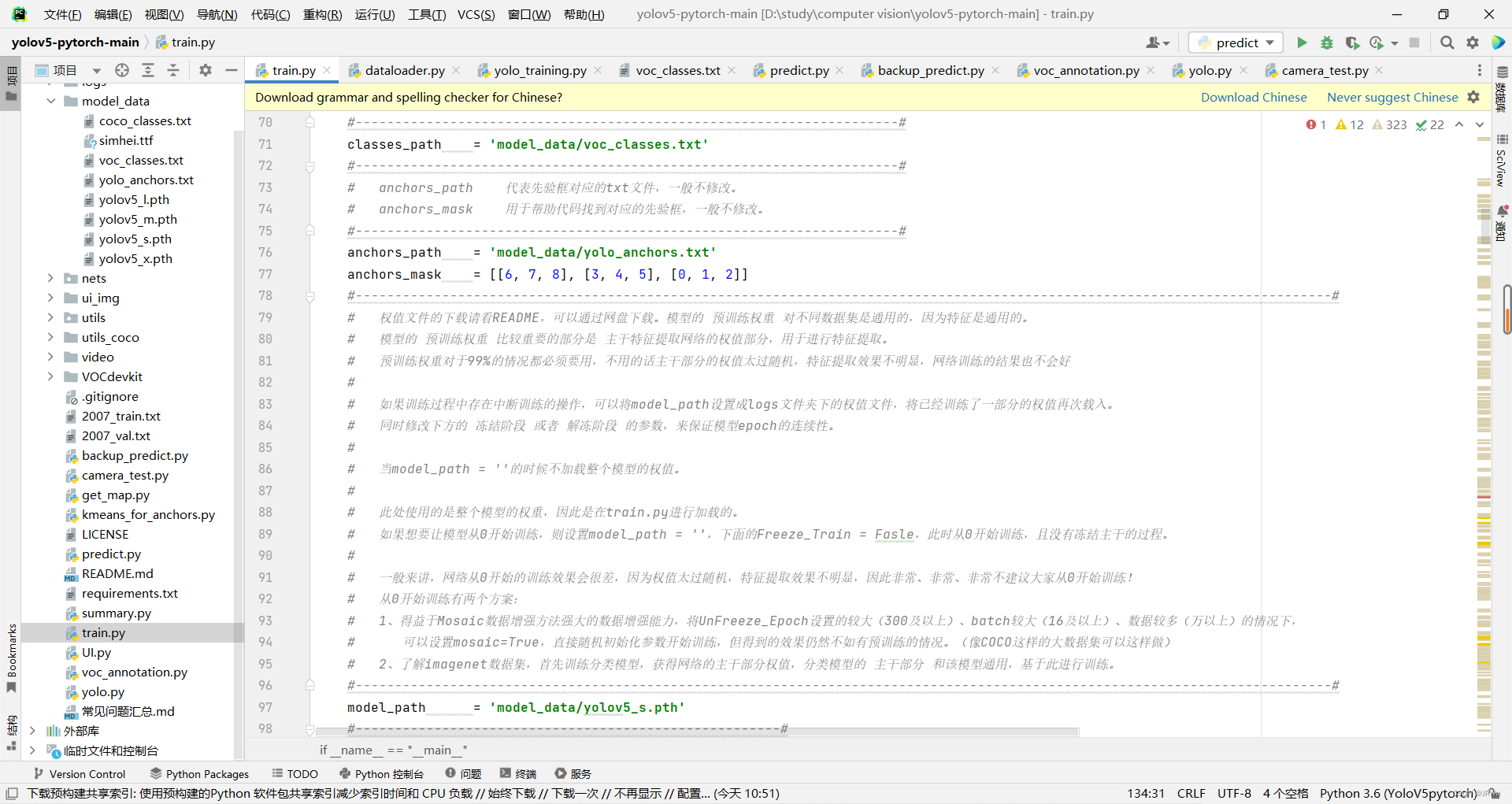

三、开始训练网络

通过voc_annotation.py我们已经生成了2007_train.txt以及2007_val.txt,此时我们可以开始训练了。

训练的参数较多,大家可以在下载库后仔细看注释,其中最重要的部分依然是train.py里的classes_path。

classes_path用于指向检测类别所对应的txt,这个txt和voc_annotation.py里面的txt一样!训练自己的数据集必须要修改!

修改完classes_path后就可以运行train.py开始训练了,在训练多个epoch后,权值会生成在logs文件夹中。

其它参数的作用如下:

#---------------------------------#

# Cuda 是否使用Cuda

# 没有GPU可以设置成False

#---------------------------------#

Cuda = True

#---------------------------------------------------------------------#

# distributed 用于指定是否使用单机多卡分布式运行

# 终端指令仅支持Ubuntu。CUDA_VISIBLE_DEVICES用于在Ubuntu下指定显卡。

# Windows系统下默认使用DP模式调用所有显卡,不支持DDP。

# DP模式:

# 设置 distributed = False

# 在终端中输入 CUDA_VISIBLE_DEVICES=0,1 python train.py

# DDP模式:

# 设置 distributed = True

# 在终端中输入 CUDA_VISIBLE_DEVICES=0,1 python -m torch.distributed.launch --nproc_per_node=2 train.py

#---------------------------------------------------------------------#

distributed = False

#---------------------------------------------------------------------#

# sync_bn 是否使用sync_bn,DDP模式多卡可用

#---------------------------------------------------------------------#

sync_bn = False

#---------------------------------------------------------------------#

# fp16 是否使用混合精度训练

# 可减少约一半的显存、需要pytorch1.7.1以上

#---------------------------------------------------------------------#

fp16 = False

#---------------------------------------------------------------------#

# classes_path 指向model_data下的txt,与自己训练的数据集相关

# 训练前一定要修改classes_path,使其对应自己的数据集

#---------------------------------------------------------------------#

classes_path = 'model_data/voc_classes.txt'

#---------------------------------------------------------------------#

# anchors_path 代表先验框对应的txt文件,一般不修改。

# anchors_mask 用于帮助代码找到对应的先验框,一般不修改。

#---------------------------------------------------------------------#

anchors_path = 'model_data/yolo_anchors.txt'

anchors_mask = [[6, 7, 8], [3, 4, 5], [0, 1, 2]]

#----------------------------------------------------------------------------------------------------------------------------#

# 权值文件的下载请看README,可以通过网盘下载。模型的 预训练权重 对不同数据集是通用的,因为特征是通用的。

# 模型的 预训练权重 比较重要的部分是 主干特征提取网络的权值部分,用于进行特征提取。

# 预训练权重对于99%的情况都必须要用,不用的话主干部分的权值太过随机,特征提取效果不明显,网络训练的结果也不会好

#

# 如果训练过程中存在中断训练的操作,可以将model_path设置成logs文件夹下的权值文件,将已经训练了一部分的权值再次载入。

# 同时修改下方的 冻结阶段 或者 解冻阶段 的参数,来保证模型epoch的连续性。

#

# 当model_path = ''的时候不加载整个模型的权值。

#

# 此处使用的是整个模型的权重,因此是在train.py进行加载的。

# 如果想要让模型从0开始训练,则设置model_path = '',下面的Freeze_Train = Fasle,此时从0开始训练,且没有冻结主干的过程。

#

# 一般来讲,网络从0开始的训练效果会很差,因为权值太过随机,特征提取效果不明显,因此非常、非常、非常不建议大家从0开始训练!

# 从0开始训练有两个方案:

# 1、得益于Mosaic数据增强方法强大的数据增强能力,将UnFreeze_Epoch设置的较大(300及以上)、batch较大(16及以上)、数据较多(万以上)的情况下,

# 可以设置mosaic=True,直接随机初始化参数开始训练,但得到的效果仍然不如有预训练的情况。(像COCO这样的大数据集可以这样做)

# 2、了解imagenet数据集,首先训练分类模型,获得网络的主干部分权值,分类模型的 主干部分 和该模型通用,基于此进行训练。

#----------------------------------------------------------------------------------------------------------------------------#

model_path = 'model_data/yolov5_s.pth'

#------------------------------------------------------#

# input_shape 输入的shape大小,一定要是32的倍数

#------------------------------------------------------#

input_shape = [640, 640]

#------------------------------------------------------#

# backbone cspdarknet(默认)

# convnext_tiny

# convnext_small

# swin_transfomer_tiny

#------------------------------------------------------#

backbone = 'cspdarknet'

#----------------------------------------------------------------------------------------------------------------------------#

# pretrained 是否使用主干网络的预训练权重,此处使用的是主干的权重,因此是在模型构建的时候进行加载的。

# 如果设置了model_path,则主干的权值无需加载,pretrained的值无意义。

# 如果不设置model_path,pretrained = True,此时仅加载主干开始训练。

# 如果不设置model_path,pretrained = False,Freeze_Train = Fasle,此时从0开始训练,且没有冻结主干的过程。

#----------------------------------------------------------------------------------------------------------------------------#

pretrained = False

#------------------------------------------------------#

# phi 所使用的YoloV5的版本。s、m、l、x

# 在除cspdarknet的其它主干中仅影响panet的大小

#------------------------------------------------------#

phi = 's'

#------------------------------------------------------------------#

# mosaic 马赛克数据增强。

# mosaic_prob 每个step有多少概率使用mosaic数据增强,默认50%。

#

# mixup 是否使用mixup数据增强,仅在mosaic=True时有效。

# 只会对mosaic增强后的图片进行mixup的处理。

# mixup_prob 有多少概率在mosaic后使用mixup数据增强,默认50%。

# 总的mixup概率为mosaic_prob * mixup_prob。

#

# special_aug_ratio 参考YoloX,由于Mosaic生成的训练图片,远远脱离自然图片的真实分布。

# 当mosaic=True时,本代码会在special_aug_ratio范围内开启mosaic。

# 默认为前70%个epoch,100个世代会开启70个世代。

#------------------------------------------------------------------#

mosaic = True

mosaic_prob = 0.5

mixup = True

mixup_prob = 0.5

special_aug_ratio = 0.7

#------------------------------------------------------------------#

# label_smoothing 标签平滑。一般0.01以下。如0.01、0.005。

#------------------------------------------------------------------#

label_smoothing = 0

#----------------------------------------------------------------------------------------------------------------------------#

# 训练分为两个阶段,分别是冻结阶段和解冻阶段。设置冻结阶段是为了满足机器性能不足的同学的训练需求。

# 冻结训练需要的显存较小,显卡非常差的情况下,可设置Freeze_Epoch等于UnFreeze_Epoch,Freeze_Train = True,此时仅仅进行冻结训练。

#

# 在此提供若干参数设置建议,各位训练者根据自己的需求进行灵活调整:

# (一)从整个模型的预训练权重开始训练:

# Adam:

# Init_Epoch = 0,Freeze_Epoch = 50,UnFreeze_Epoch = 100,Freeze_Train = True,optimizer_type = 'adam',Init_lr = 1e-3,weight_decay = 0。(冻结)

# Init_Epoch = 0,UnFreeze_Epoch = 100,Freeze_Train = False,optimizer_type = 'adam',Init_lr = 1e-3,weight_decay = 0。(不冻结)

# SGD:

# Init_Epoch = 0,Freeze_Epoch = 50,UnFreeze_Epoch = 300,Freeze_Train = True,optimizer_type = 'sgd',Init_lr = 1e-2,weight_decay = 5e-4。(冻结)

# Init_Epoch = 0,UnFreeze_Epoch = 300,Freeze_Train = False,optimizer_type = 'sgd',Init_lr = 1e-2,weight_decay = 5e-4。(不冻结)

# 其中:UnFreeze_Epoch可以在100-300之间调整。

# (二)从0开始训练:

# Init_Epoch = 0,UnFreeze_Epoch >= 300,Unfreeze_batch_size >= 16,Freeze_Train = False(不冻结训练)

# 其中:UnFreeze_Epoch尽量不小于300。optimizer_type = 'sgd',Init_lr = 1e-2,mosaic = True。

# (三)batch_size的设置:

# 在显卡能够接受的范围内,以大为好。显存不足与数据集大小无关,提示显存不足(OOM或者CUDA out of memory)请调小batch_size。

# 受到BatchNorm层影响,batch_size最小为2,不能为1。

# 正常情况下Freeze_batch_size建议为Unfreeze_batch_size的1-2倍。不建议设置的差距过大,因为关系到学习率的自动调整。

#----------------------------------------------------------------------------------------------------------------------------#

#------------------------------------------------------------------#

# 冻结阶段训练参数

# 此时模型的主干被冻结了,特征提取网络不发生改变

# 占用的显存较小,仅对网络进行微调

# Init_Epoch 模型当前开始的训练世代,其值可以大于Freeze_Epoch,如设置:

# Init_Epoch = 60、Freeze_Epoch = 50、UnFreeze_Epoch = 100

# 会跳过冻结阶段,直接从60代开始,并调整对应的学习率。

# (断点续练时使用)

# Freeze_Epoch 模型冻结训练的Freeze_Epoch

# (当Freeze_Train=False时失效)

# Freeze_batch_size 模型冻结训练的batch_size

# (当Freeze_Train=False时失效)

#------------------------------------------------------------------#

Init_Epoch = 0

Freeze_Epoch = 50

Freeze_batch_size = 16

#------------------------------------------------------------------#

# 解冻阶段训练参数

# 此时模型的主干不被冻结了,特征提取网络会发生改变

# 占用的显存较大,网络所有的参数都会发生改变

# UnFreeze_Epoch 模型总共训练的epoch

# SGD需要更长的时间收敛,因此设置较大的UnFreeze_Epoch

# Adam可以使用相对较小的UnFreeze_Epoch

# Unfreeze_batch_size 模型在解冻后的batch_size

#------------------------------------------------------------------#

UnFreeze_Epoch = 200

Unfreeze_batch_size = 8

#------------------------------------------------------------------#

# Freeze_Train 是否进行冻结训练

# 默认先冻结主干训练后解冻训练。

#------------------------------------------------------------------#

Freeze_Train = True

#------------------------------------------------------------------#

# 其它训练参数:学习率、优化器、学习率下降有关

#------------------------------------------------------------------#

#------------------------------------------------------------------#

# Init_lr 模型的最大学习率

# Min_lr 模型的最小学习率,默认为最大学习率的0.01

#------------------------------------------------------------------#

Init_lr = 1e-2

Min_lr = Init_lr * 0.01

#------------------------------------------------------------------#

# optimizer_type 使用到的优化器种类,可选的有adam、sgd

# 当使用Adam优化器时建议设置 Init_lr=1e-3

# 当使用SGD优化器时建议设置 Init_lr=1e-2

# momentum 优化器内部使用到的momentum参数

# weight_decay 权值衰减,可防止过拟合

# adam会导致weight_decay错误,使用adam时建议设置为0。

#------------------------------------------------------------------#

optimizer_type = "sgd"

momentum = 0.937

weight_decay = 5e-4

#------------------------------------------------------------------#

# lr_decay_type 使用到的学习率下降方式,可选的有step、cos

#------------------------------------------------------------------#

lr_decay_type = "cos"

#------------------------------------------------------------------#

# save_period 多少个epoch保存一次权值

#------------------------------------------------------------------#

save_period = 10

#------------------------------------------------------------------#

# save_dir 权值与日志文件保存的文件夹

#------------------------------------------------------------------#

save_dir = 'logs'

#------------------------------------------------------------------#

# eval_flag 是否在训练时进行评估,评估对象为验证集

# 安装pycocotools库后,评估体验更佳。

# eval_period 代表多少个epoch评估一次,不建议频繁的评估

# 评估需要消耗较多的时间,频繁评估会导致训练非常慢

# 此处获得的mAP会与get_map.py获得的会有所不同,原因有二:

# (一)此处获得的mAP为验证集的mAP。

# (二)此处设置评估参数较为保守,目的是加快评估速度。

#------------------------------------------------------------------#

eval_flag = True

eval_period = 10

#------------------------------------------------------------------#

# num_workers 用于设置是否使用多线程读取数据

# 开启后会加快数据读取速度,但是会占用更多内存

# 内存较小的电脑可以设置为2或者0

#------------------------------------------------------------------#

num_workers = 4

#------------------------------------------------------#

# train_annotation_path 训练图片路径和标签

# val_annotation_path 验证图片路径和标签

#------------------------------------------------------#

train_annotation_path = '2007_train.txt'

val_annotation_path = '2007_val.txt'

四、训练结果预测

训练结果预测需要用到两个文件,分别是yolo.py和predict.py。

我们首先需要去yolo.py里面修改model_path以及classes_path,这两个参数必须要修改。

model_path指向训练好的权值文件,在logs文件夹里。

classes_path指向检测类别所对应的txt。

class YOLO(object):

_defaults = {

#--------------------------------------------------------------------------#

# 使用自己训练好的模型进行预测一定要修改model_path和classes_path!

# model_path指向logs文件夹下的权值文件,classes_path指向model_data下的txt

#

# 训练好后logs文件夹下存在多个权值文件,选择验证集损失较低的即可。

# 验证集损失较低不代表mAP较高,仅代表该权值在验证集上泛化性能较好。

# 如果出现shape不匹配,同时要注意训练时的model_path和classes_path参数的修改

#--------------------------------------------------------------------------#

"model_path" : 'logs/ep200-loss0.048-val_loss0.048.pth',

#"model_path" : 'model_data/yolov5_s.pth',

"classes_path" : 'model_data/voc_classes.txt',

#---------------------------------------------------------------------#

# anchors_path代表先验框对应的txt文件,一般不修改。

# anchors_mask用于帮助代码找到对应的先验框,一般不修改。

#---------------------------------------------------------------------#

"anchors_path" : 'model_data/yolo_anchors.txt',

"anchors_mask" : [[6, 7, 8], [3, 4, 5], [0, 1, 2]],

#---------------------------------------------------------------------#

# 输入图片的大小,必须为32的倍数。

#---------------------------------------------------------------------#

"input_shape" : [640, 640],

#------------------------------------------------------#

# backbone cspdarknet(默认)

# convnext_tiny

# convnext_small

# swin_transfomer_tiny

#------------------------------------------------------#

"backbone" : 'cspdarknet',

#------------------------------------------------------#

# 所使用的YoloV5的版本。s、m、l、x

# 在除cspdarknet的其它主干中仅影响panet的大小

#------------------------------------------------------#

"phi" : 's',

#---------------------------------------------------------------------#

# 只有得分大于置信度的预测框会被保留下来

#---------------------------------------------------------------------#

"confidence" : 0.5,

#---------------------------------------------------------------------#

# 非极大抑制所用到的nms_iou大小 越小的话越严格 距离相近的两个类别会选取得分高的。即框少了

#---------------------------------------------------------------------#

"nms_iou" : 0.3,

#---------------------------------------------------------------------#

# 该变量用于控制是否使用letterbox_image对输入图像进行不失真的resize,

# 在多次测试后,发现关闭letterbox_image直接resize的效果更好

#---------------------------------------------------------------------#

"letterbox_image" : True,

#-------------------------------#

# 是否使用Cuda

# 没有GPU可以设置成False

#-------------------------------#

"cuda" : True,

}

完成修改后就可以运行predict.py进行检测了。

1125

1125

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?