通过在“CMD”命令提示符程序内,输入:pip install pyspark 安装PySpark时,遇到了导入PySpark包时无法找到SparkConf和SparkContext的问题。然后在网上搜索并尝试了多种方法,但问题依然未能得到解决。

然后发现一种可能解决的办法:

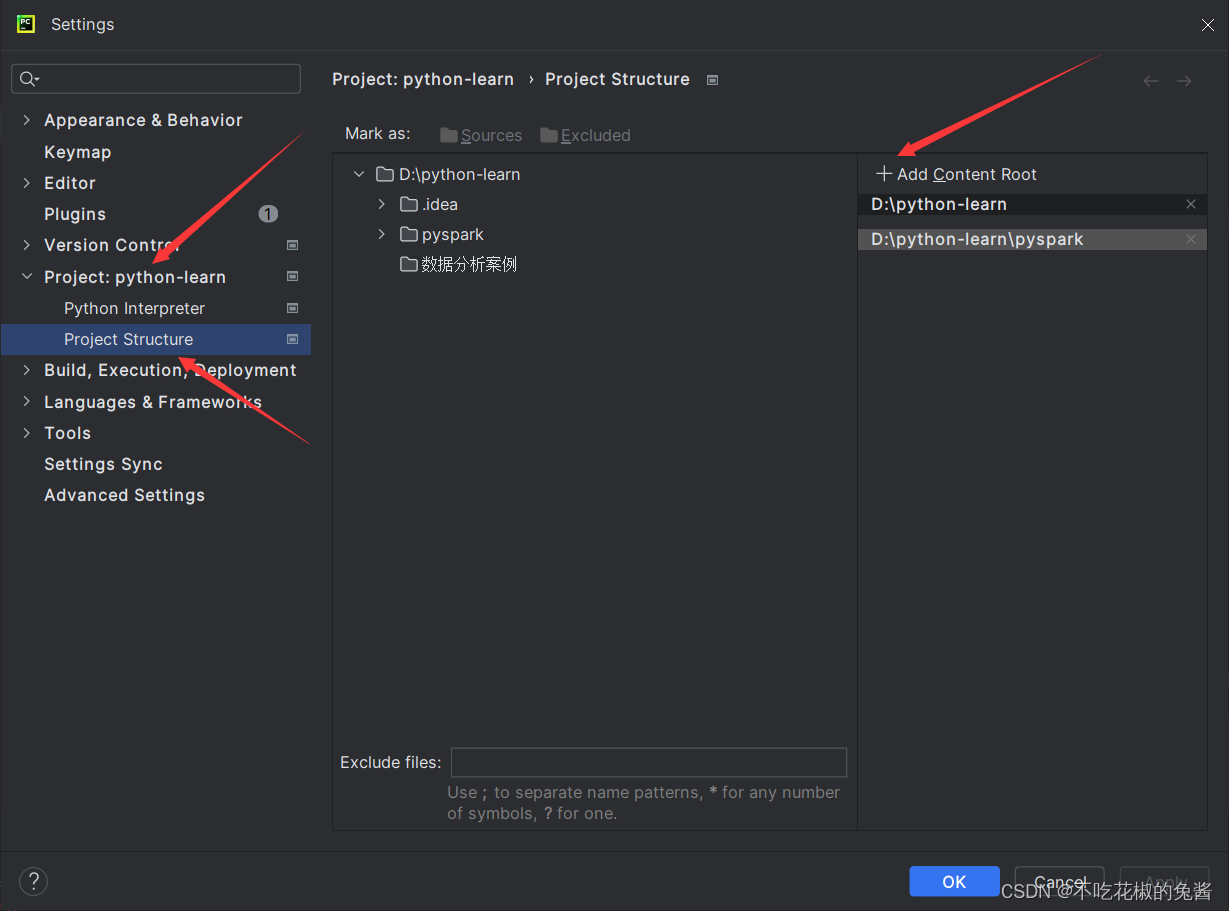

1.打开pycharm的项目,找到setting

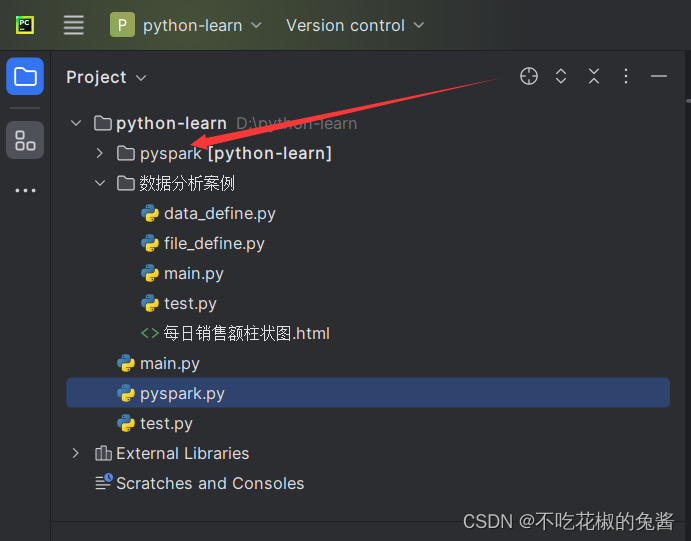

2.找到Project:xxx-->Project Structure-->点击“+”

3.找到Spark文件所在位置并添加到如图所指

这样导入PySpark包时就能找到SparkConf和SparkContext。

1151

1151

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?