主题:大模型应用于网络安全(大模型网络攻击流量识别、网络安全防御可解释性、遇攻击的自动化配置等)

流程:嘉宾工作汇报分享+专家点评+问答

一.苏金树 《人工智能赋能网络空间安全的理解与探索》

现实+网络空间,网络空间有四属性:社会属性、实体属性、逻辑属性、频谱属性;

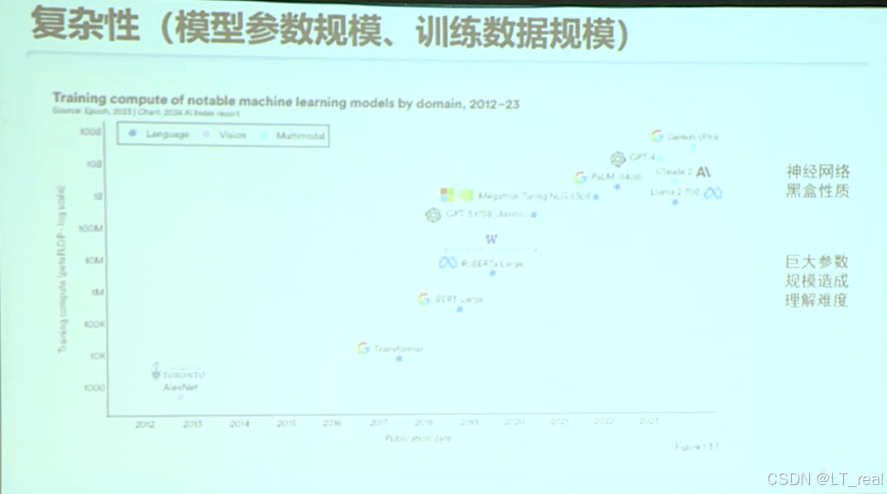

关注赋能的三方面:紧迫性(复杂性:软件代码+硬件逻辑)、正确性、安全性

1.紧迫性

紧迫性体现在网络空间的复杂性,也就是软件代码和硬件逻辑复杂性的日益增加

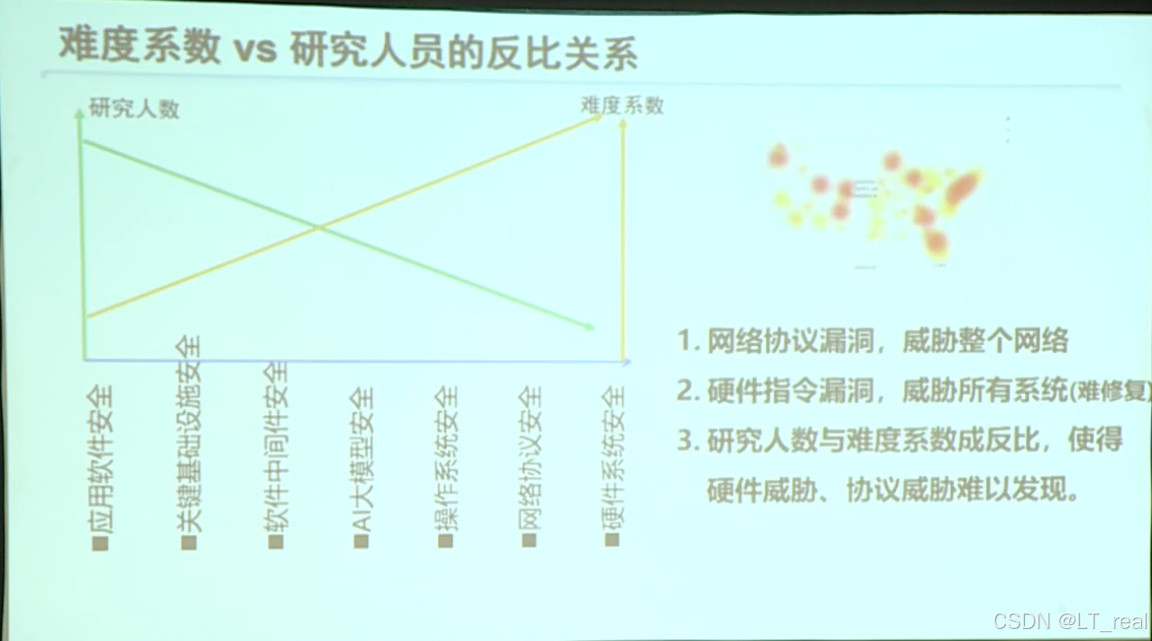

协议软件复杂性导致漏洞挖掘进度慢,难度系数与研究人员呈反比关系,目前攻击手段也日益丰富,所以我们迫切需要使用智能技术赋能,提升安全性。

2.正确性

工程化成为趋势,设计避免一个漏洞与测试修补一个漏洞的成本差两个数量级

利用LLM对代码静态扫描,但大模型有不确定性,正确性存疑、指令跟随能力差

利用LLM完成流程式处理工作,保证功能正确性

3.安全性

安全防御类型:伪造、篡改、溯源

问题:治标多、复杂性高、工作量大、利益有冲突

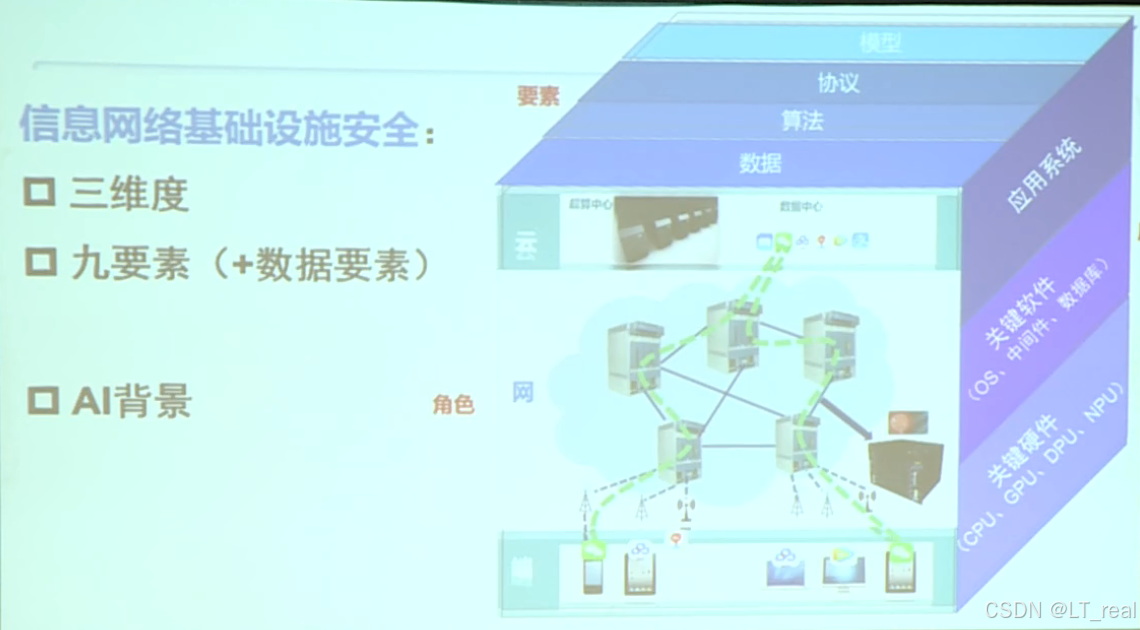

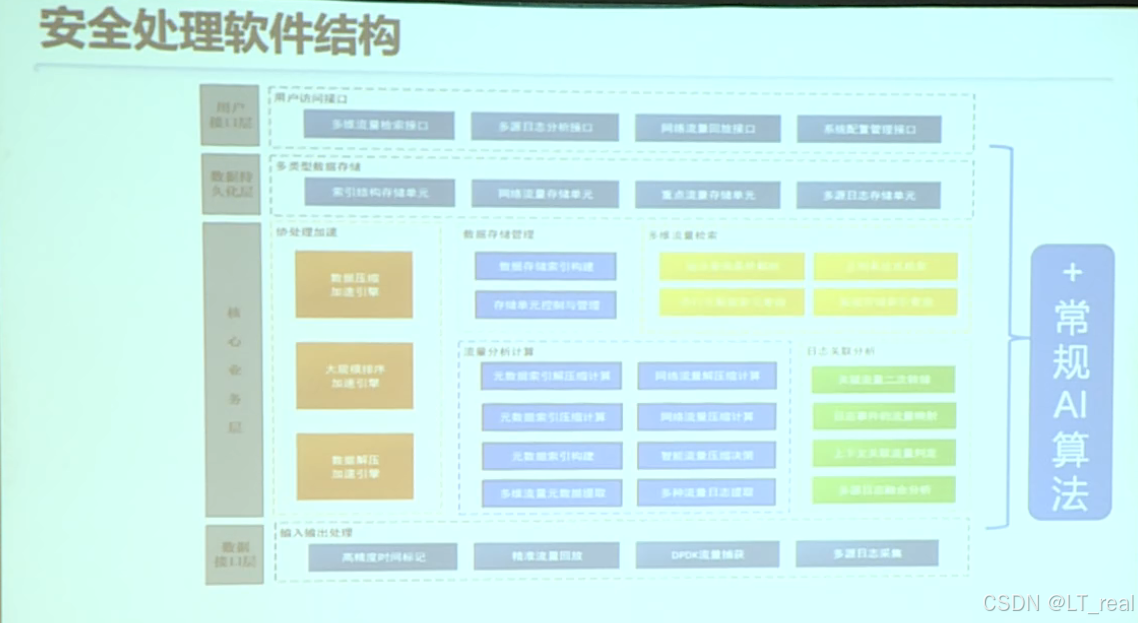

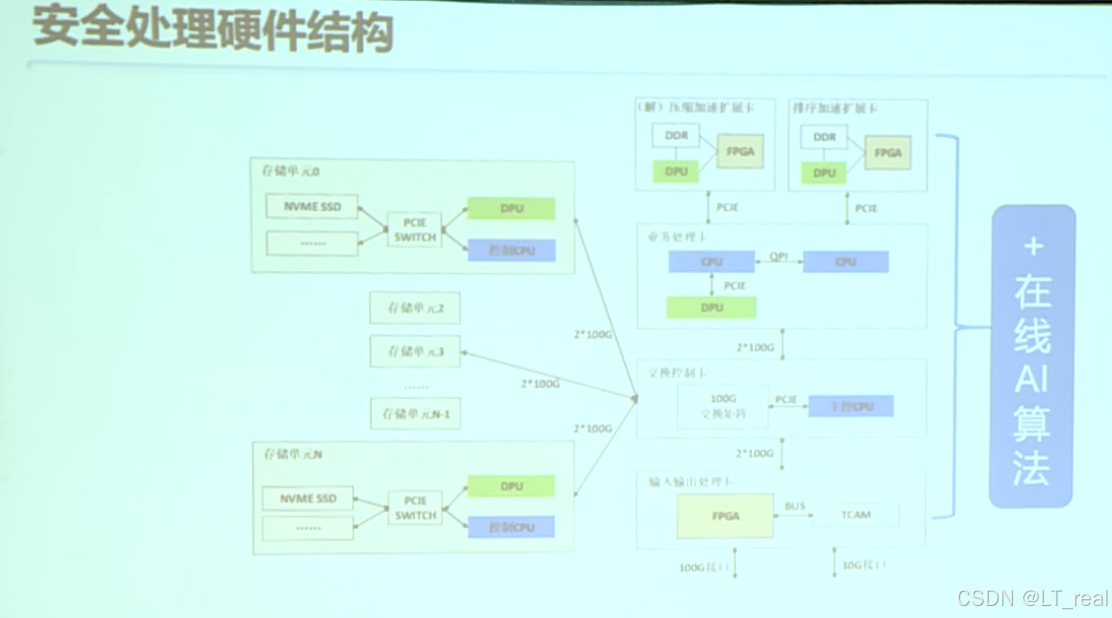

信息网络基础设施安全,将现在的AI技术加入进行机制创新

常规AI的算法,基于CPU,目前已经有大量研究

在线算法,未来发展方向

案例分析:

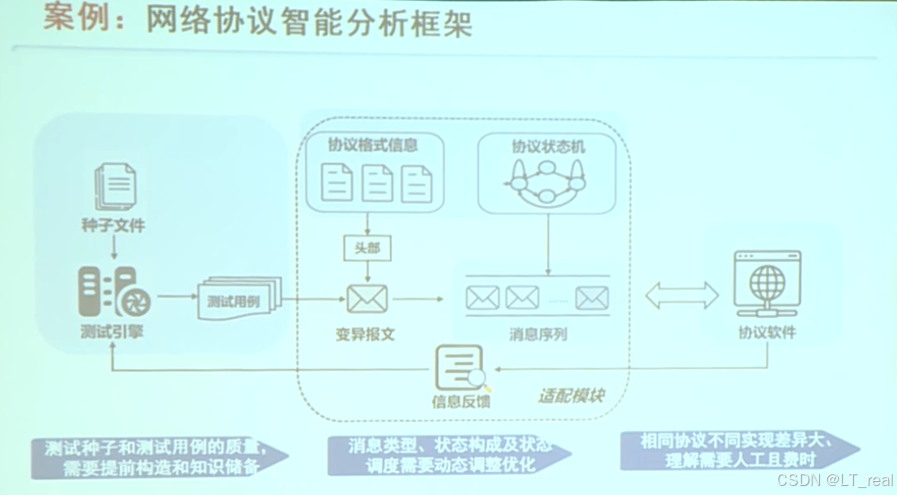

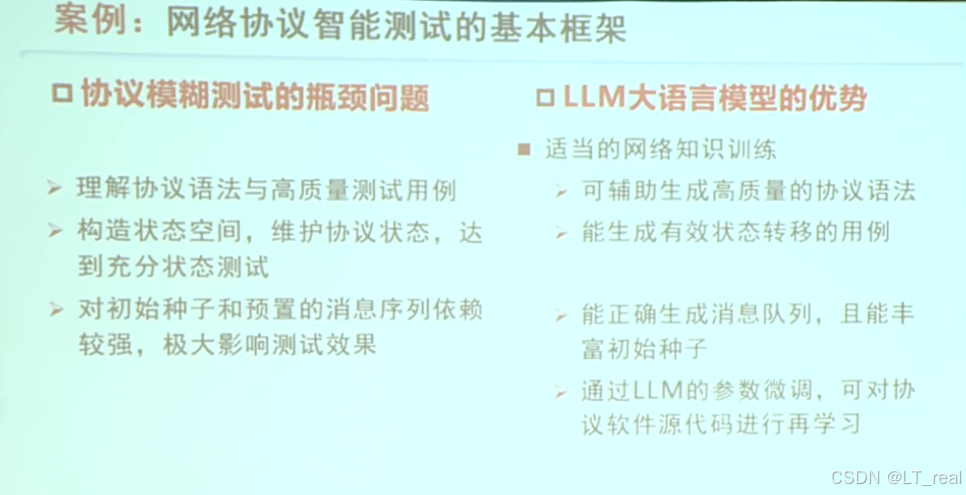

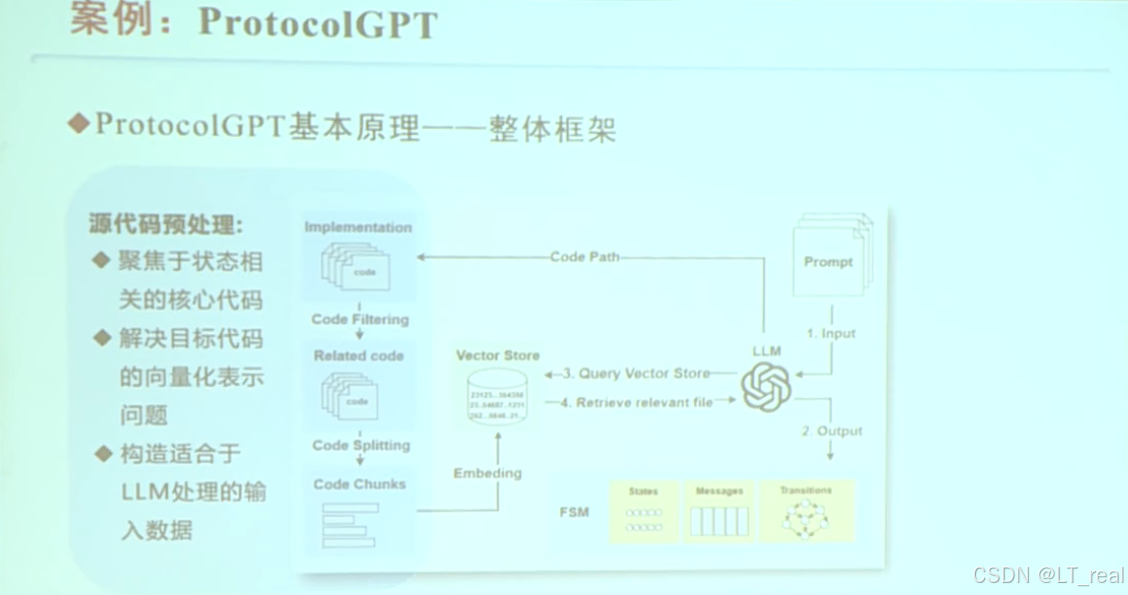

对网络协议智能分析框架案例进行分析,利用LLM学习对应协议的语法,从而完成协议的分析,如ProtocolGPT

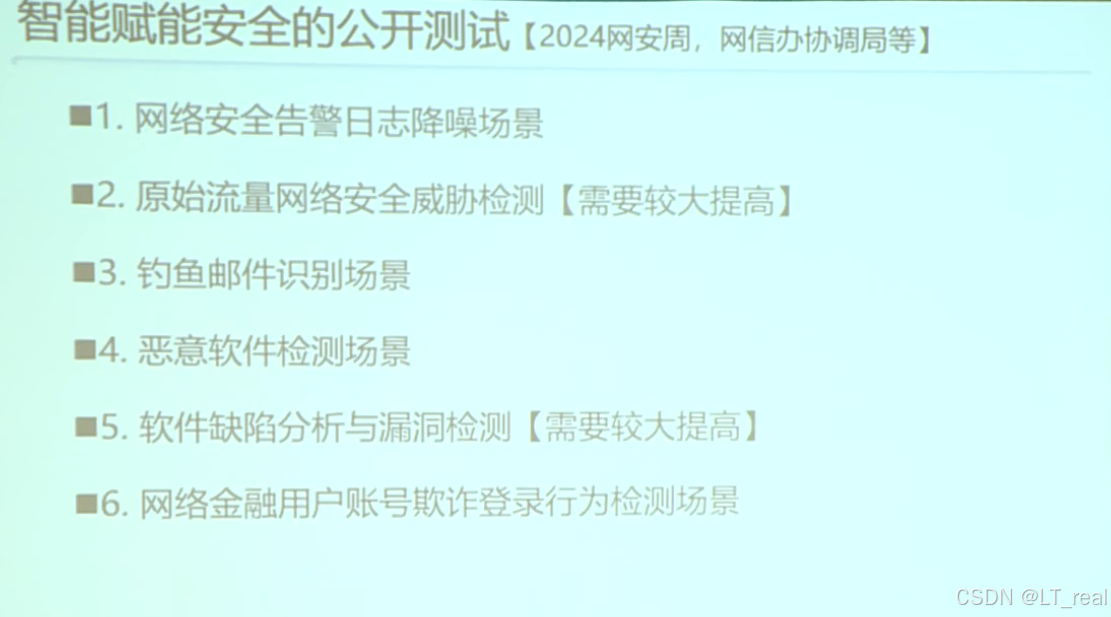

其中2、5有待发展

关注事件:1.2023.8的美CGC/AIxCC,开发网络空间自动推理系统,自动发现漏洞、修复漏洞;2.基于LLM的1-day漏洞利用;3.AI自身安全性;4.AI竞争(AI人才不多、大国竞争高)

邬江兴院士点评

1.大模型可以使用骨灰级工程师的经验覆盖菜鸟工程师,大模型对某确定功能设计,可以取代人类;

2.任何技术设计都有“暗功能”,LLM的设计将高于普遍的工程师

3.将LLM当成一个富含经验的工具,不能当成上帝,LLM的发展还需要经验丰富的老师傅带领

二、张小松 《网络安全编程语言与大模型的创新和实践》

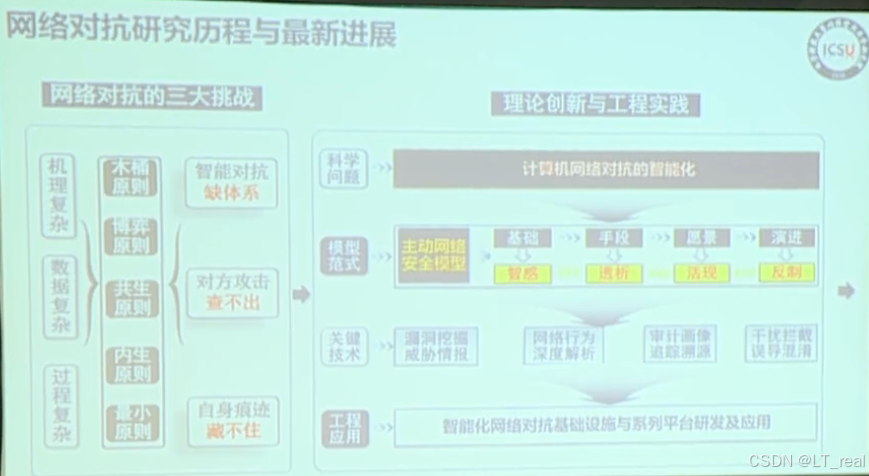

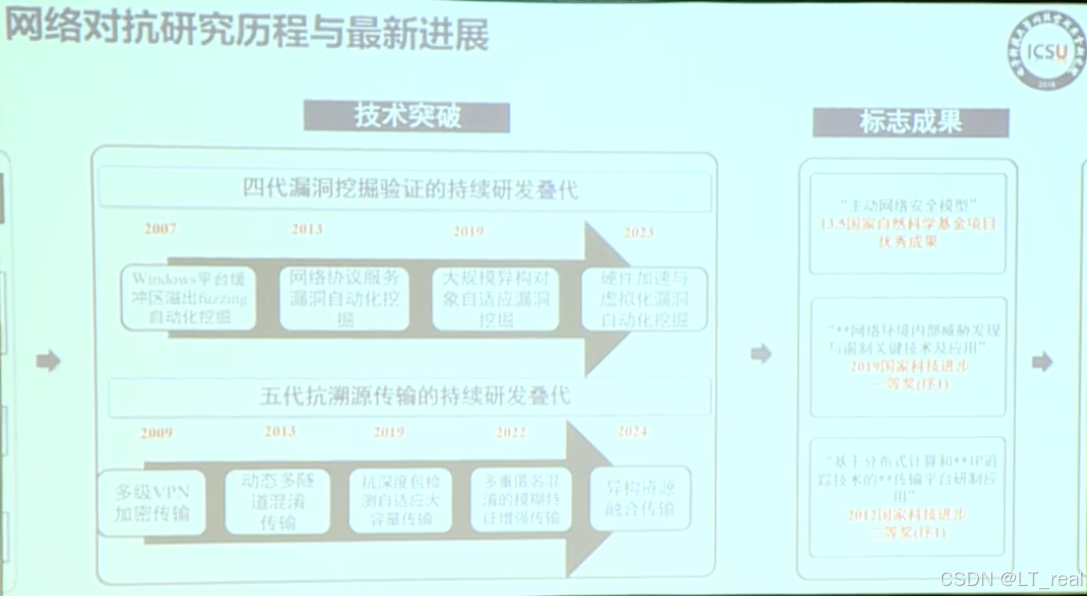

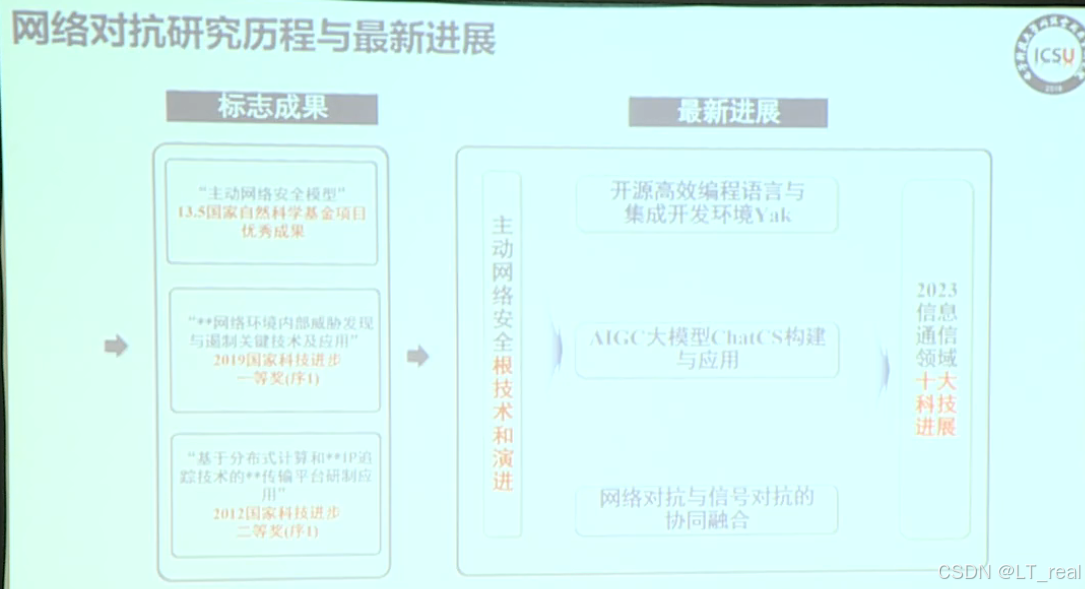

研究内容:计算机网络对抗,多邻域融合

三个复杂:机理、数据内容、过程

1.需求与挑战

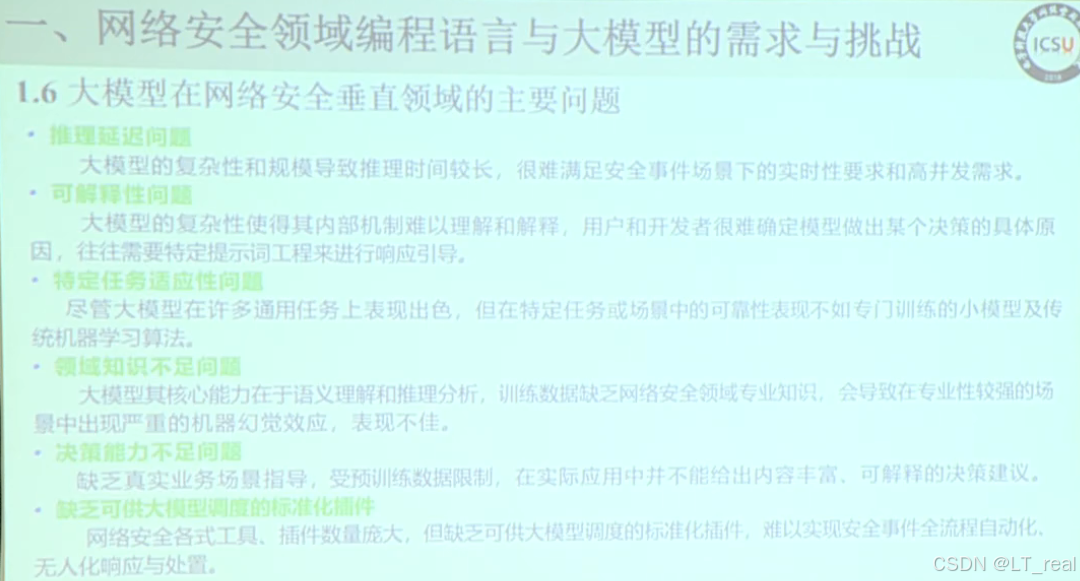

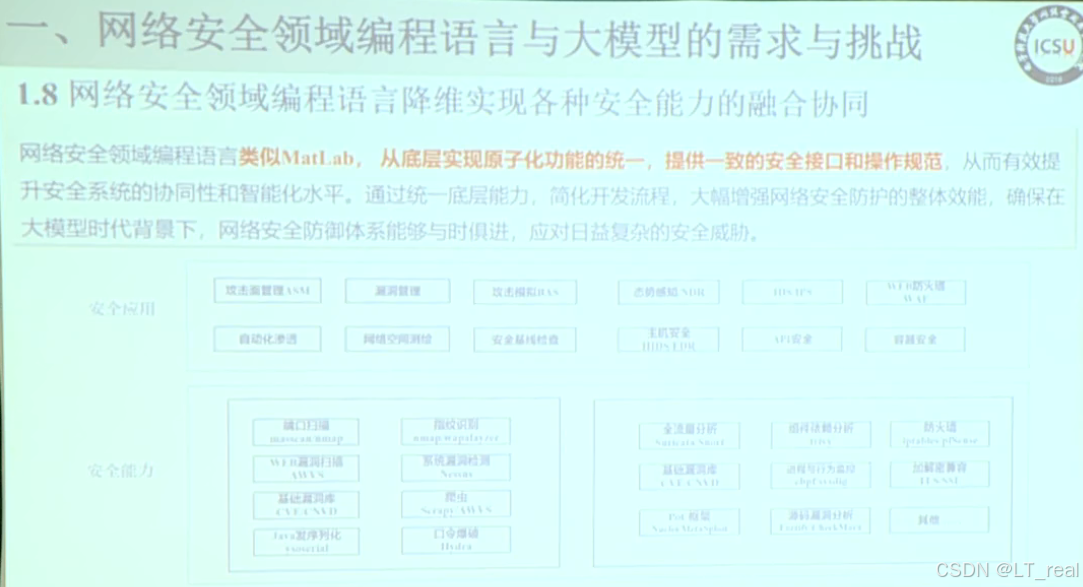

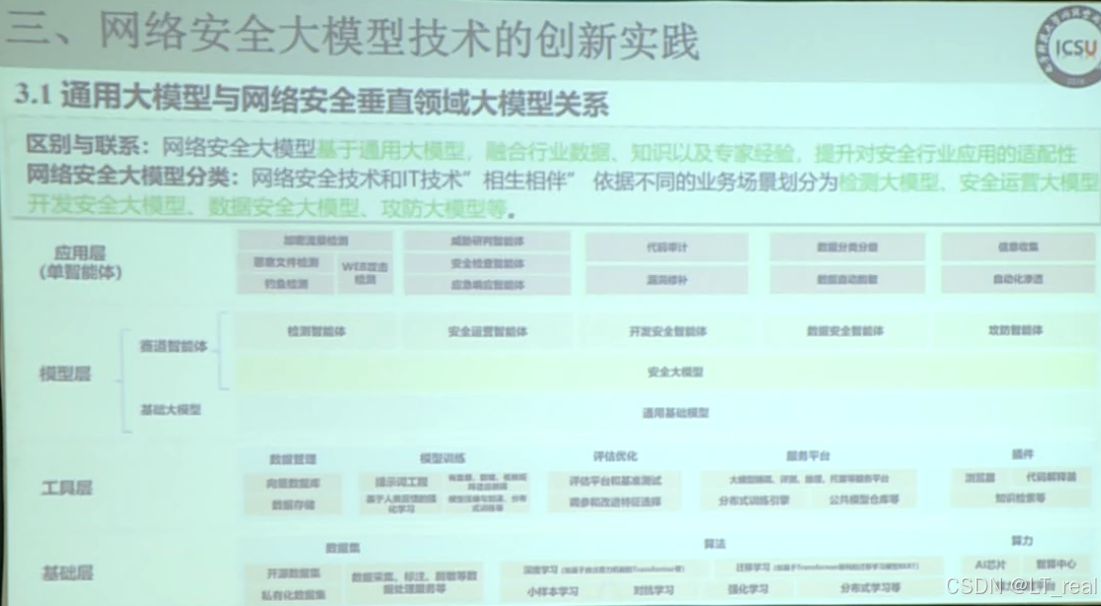

网络安全邻域对AI需求不断攀升,而传统机器学习在网安中应用有局限性(不可解析,缺乏信任),基于通用大模型基座训练更透明和可解释性的网络安全垂直领域大模型,但面临几个主要问题:

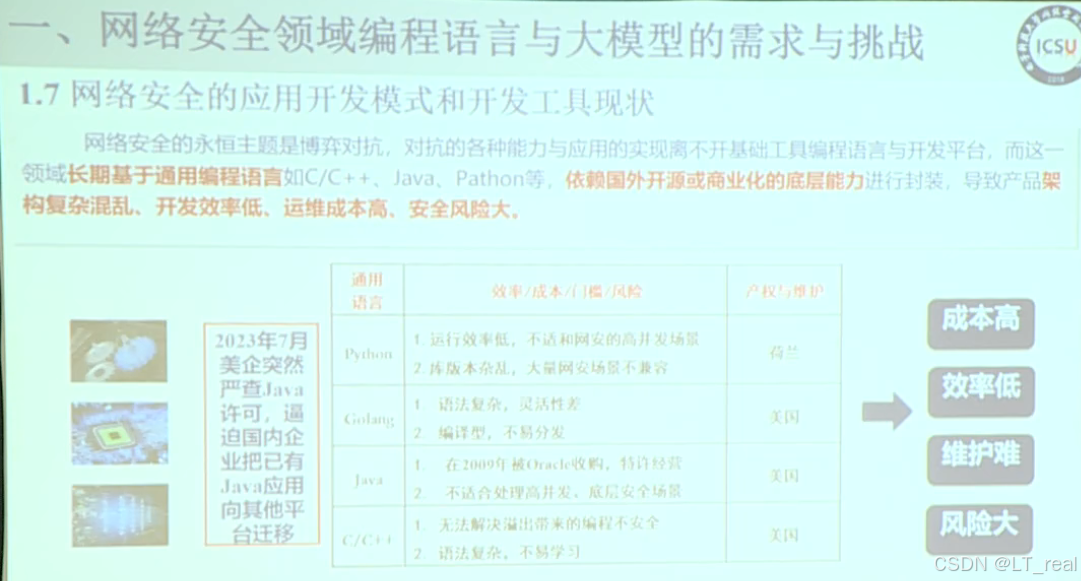

网络安全开发语言都基于通用语言,导致架构复杂、效率低、成本高、风险大

2.编程语言的创新实践

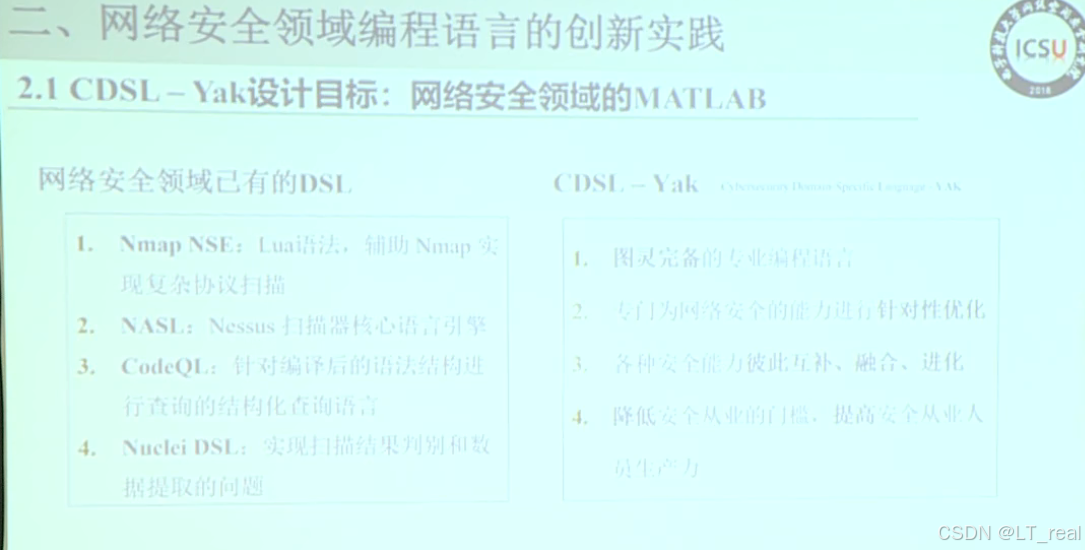

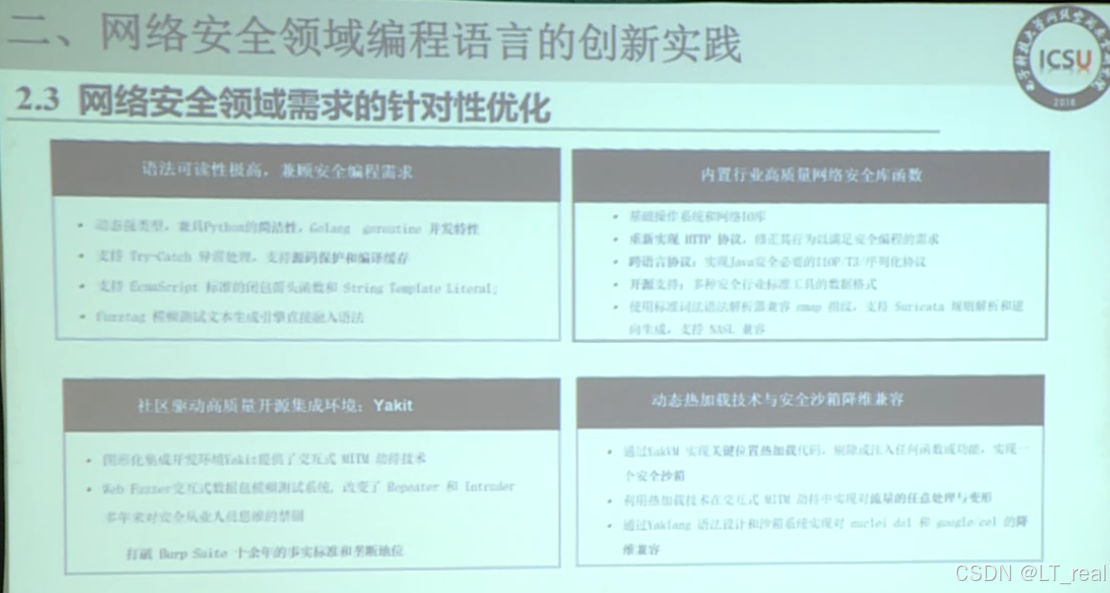

目标:实现快速搭建网络安全的统一语言,提高效能,不是做一个通用语言,做一个DSL,

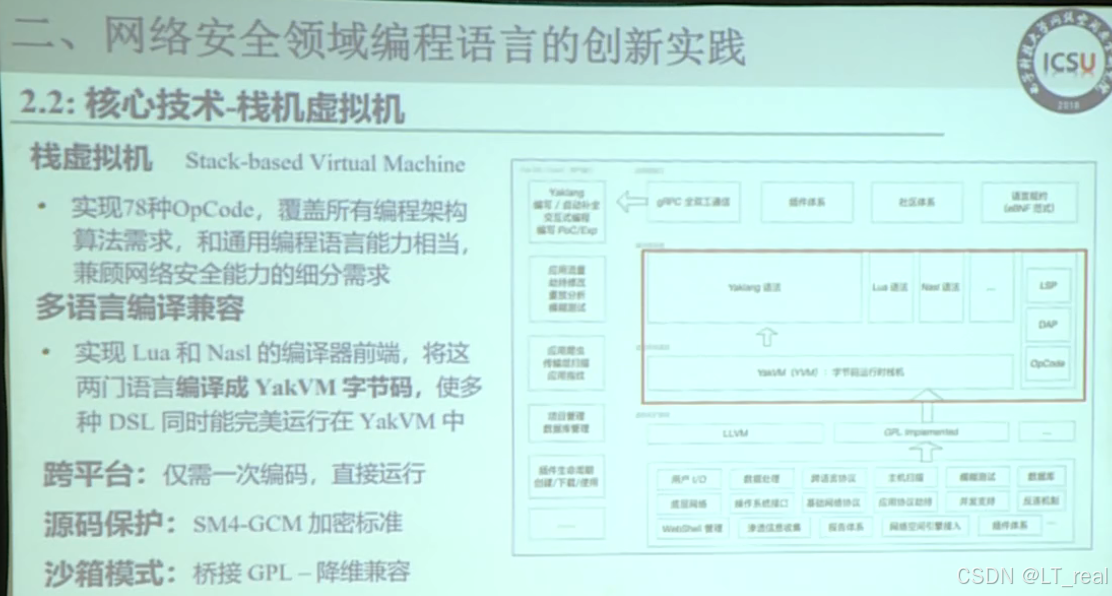

编译平台、实现多语言兼容,完成跨平台运行、使用加密进行保护,对标编译语言:

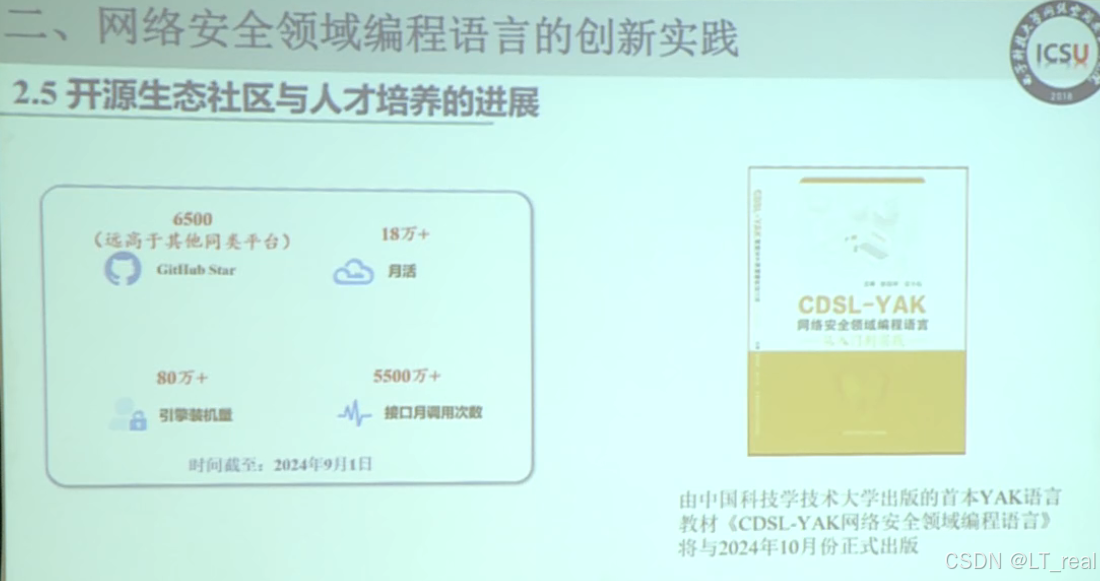

开源编程环境:

3.技术的创新实践

多智能体

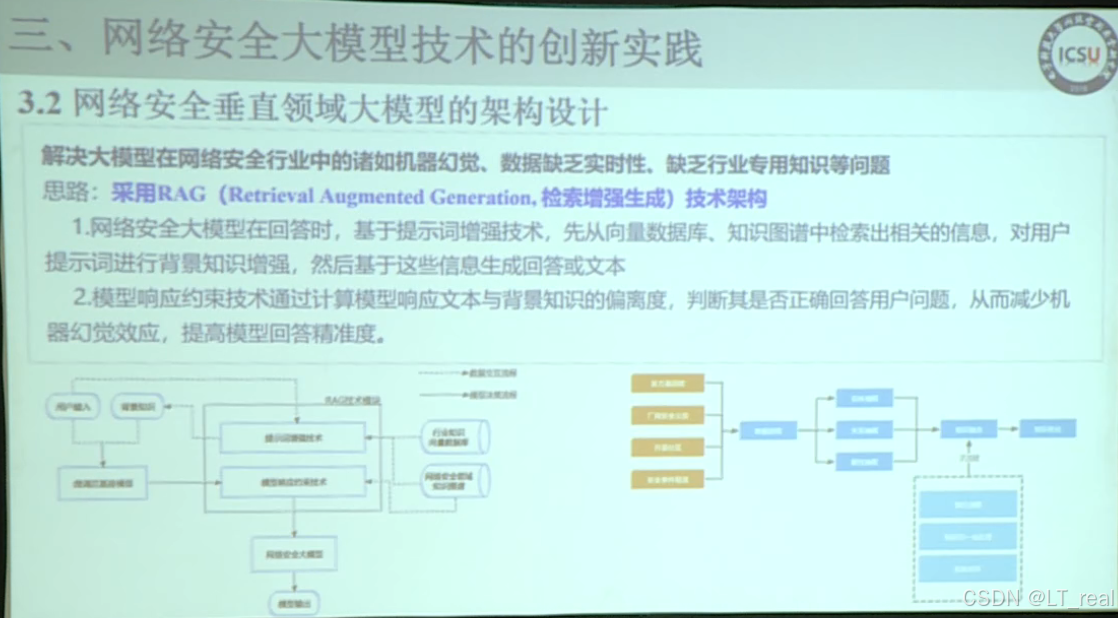

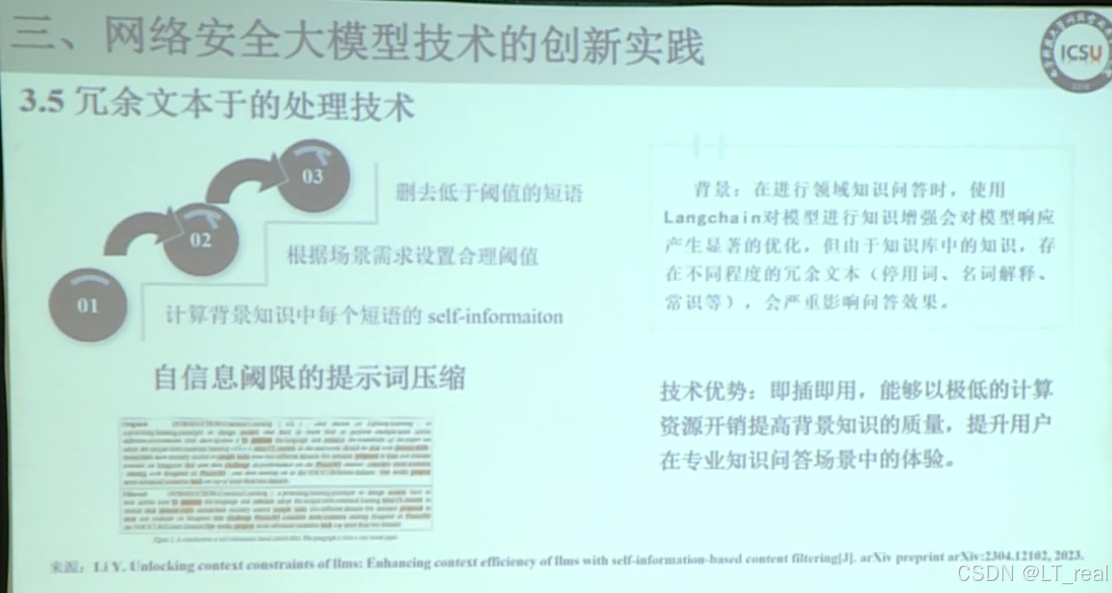

解决幻觉,使用RAG:

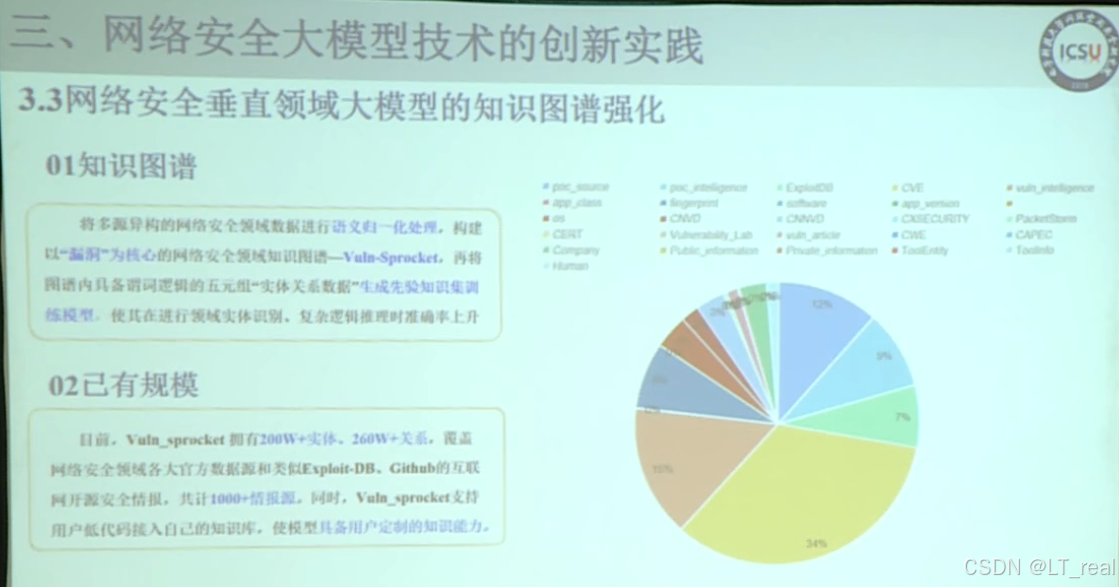

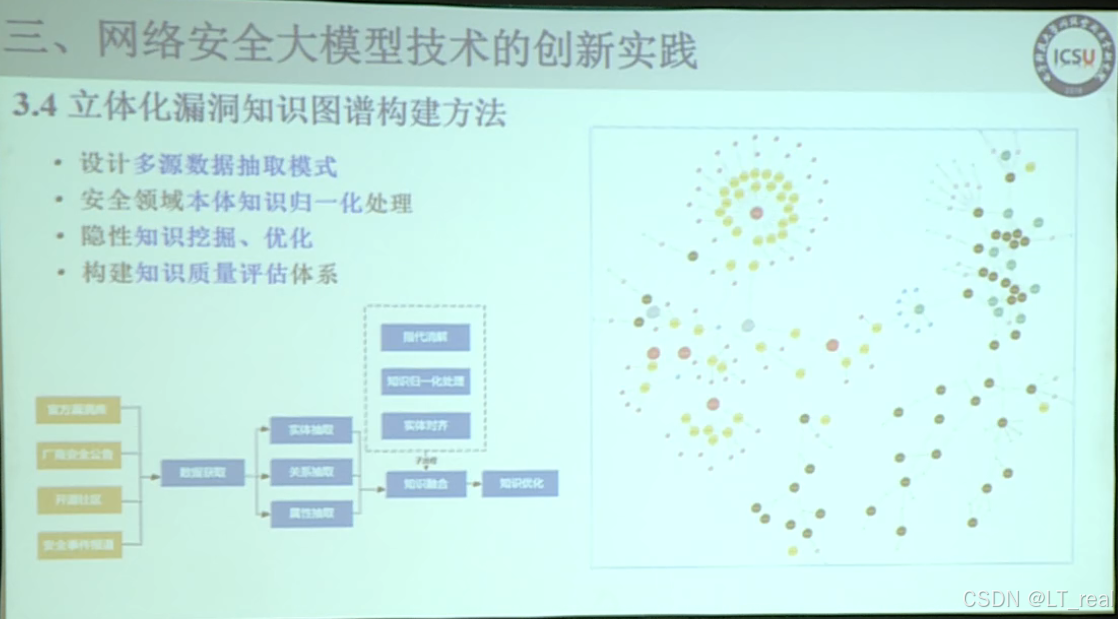

知识强化,建立语义归一化的知识图谱

设计高质量知识图谱建立方式:

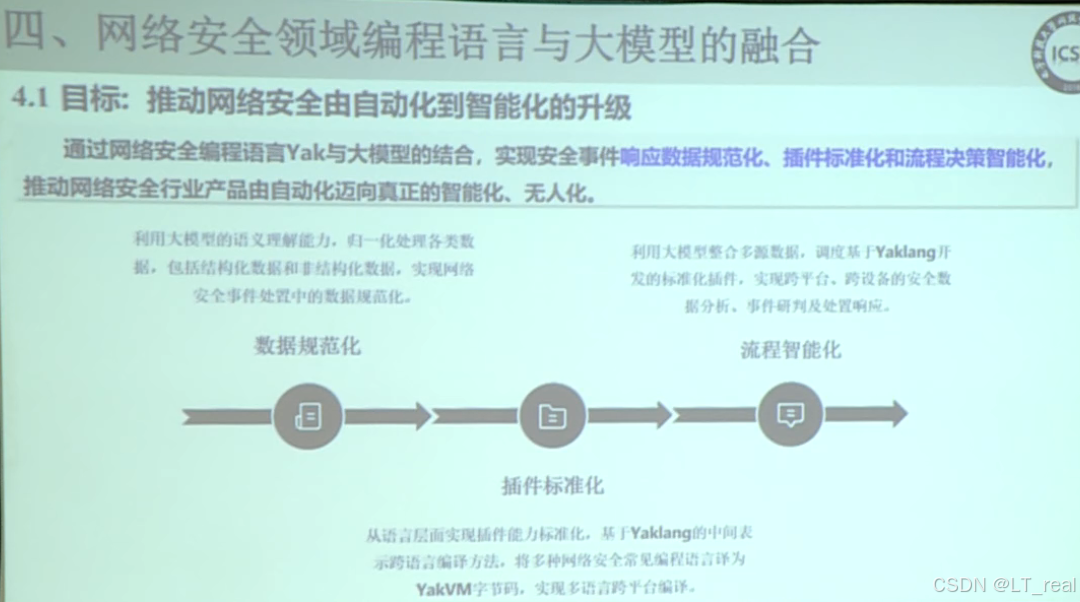

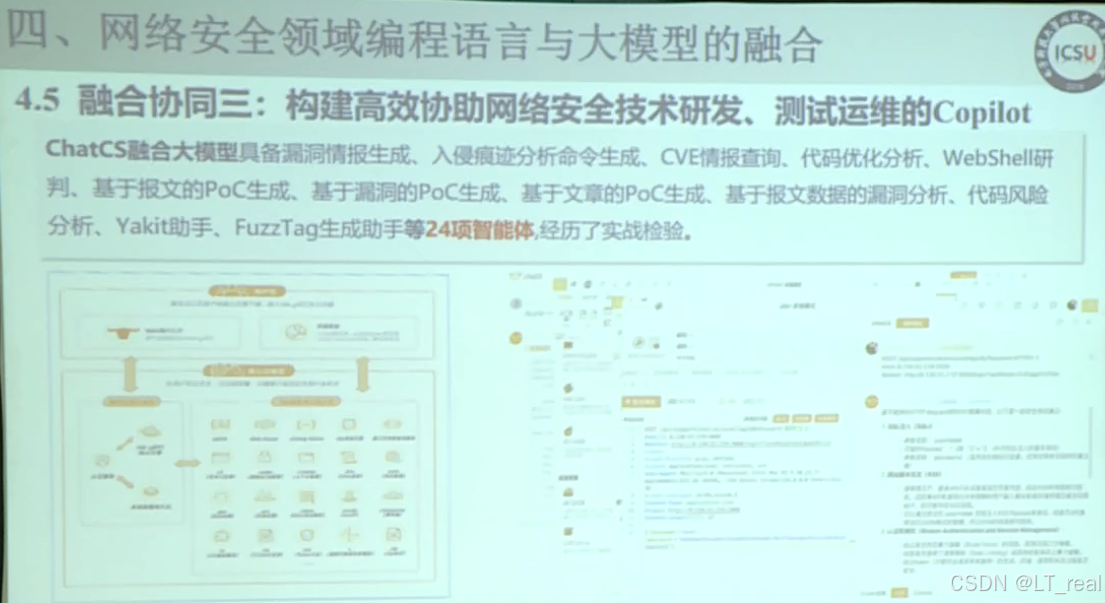

4.与LLM的融合

融合目标是推动人工-半自动-全自动-智能化的升级,把智能体与编程语言联通,用自然语言就能构建网络安全功能

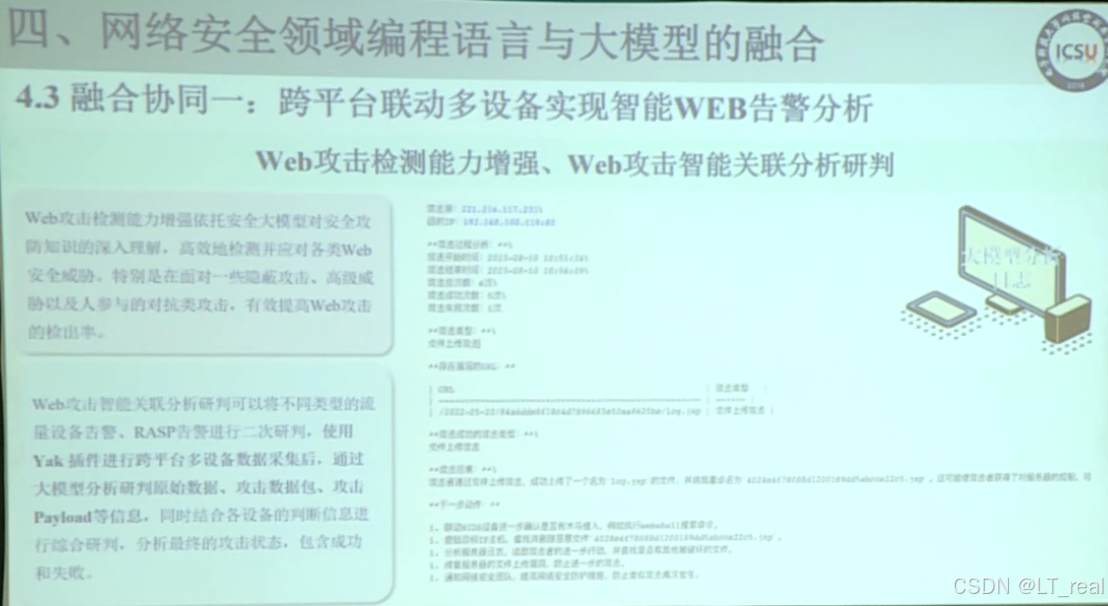

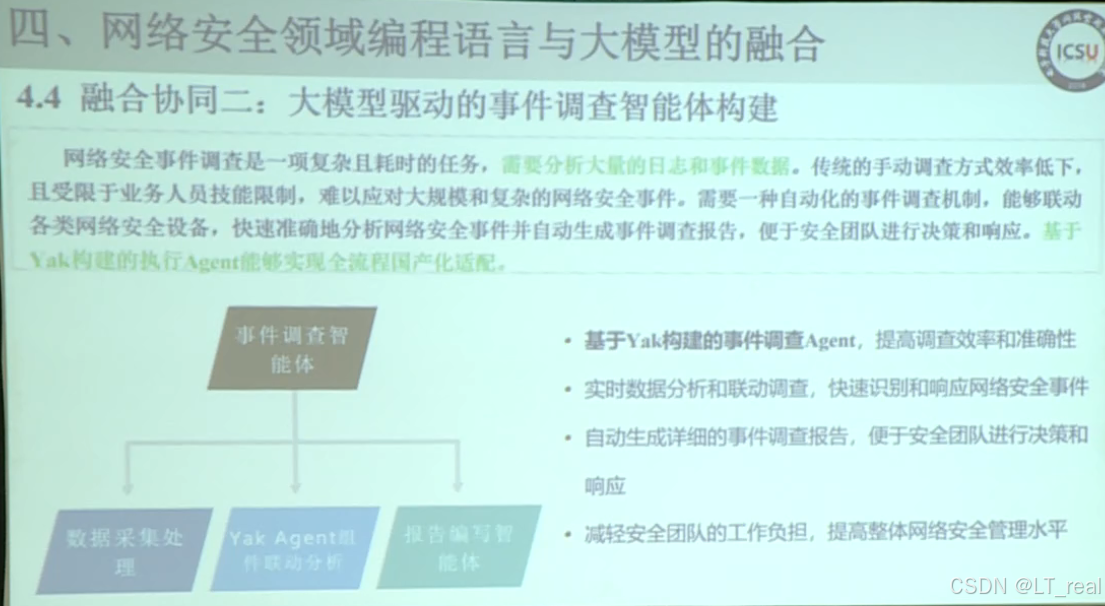

融合协调三方面:

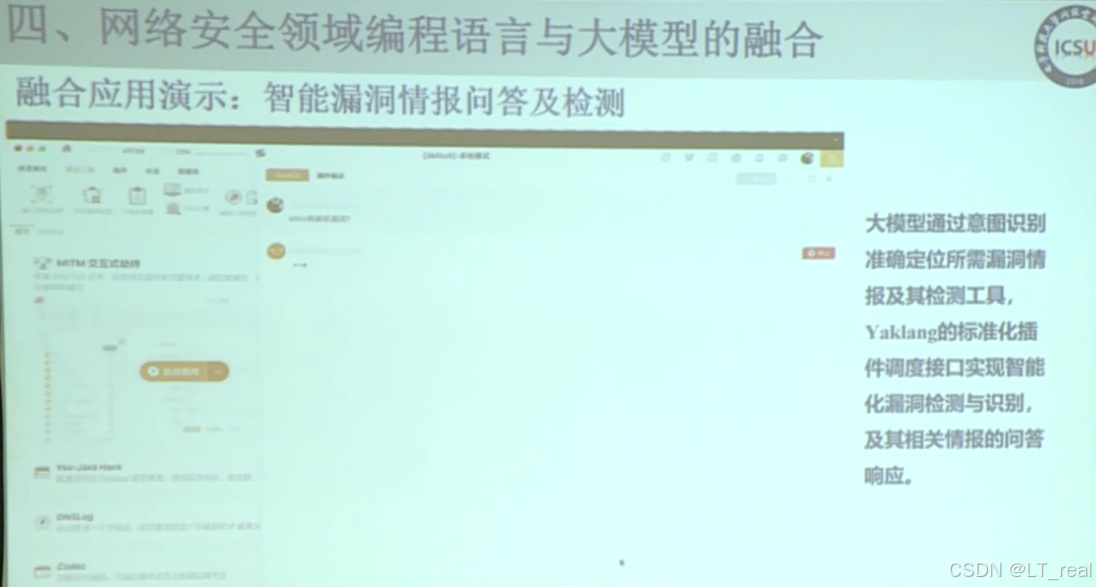

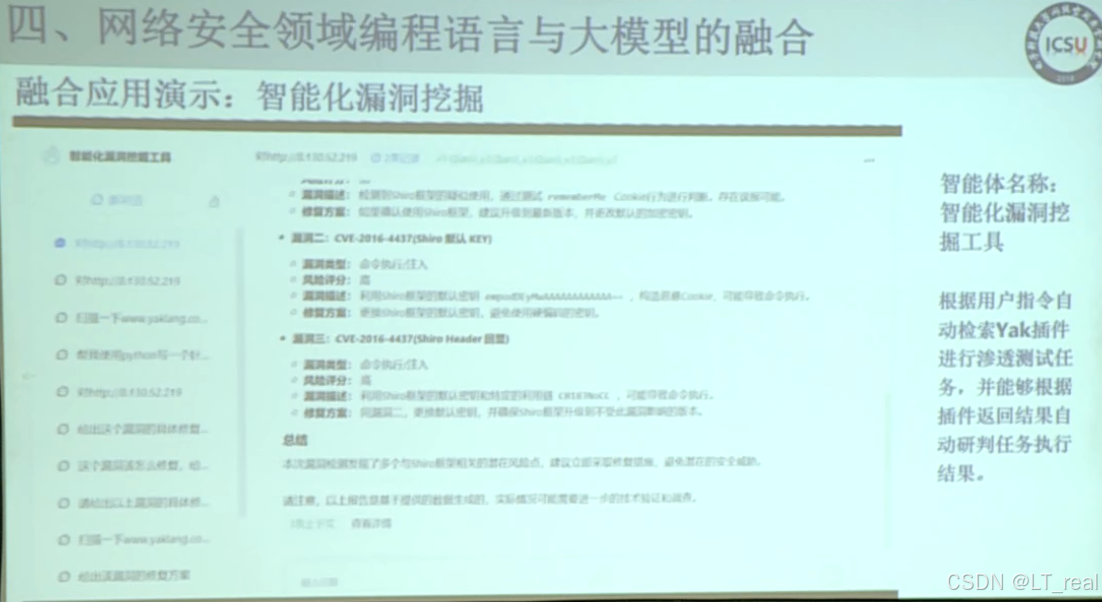

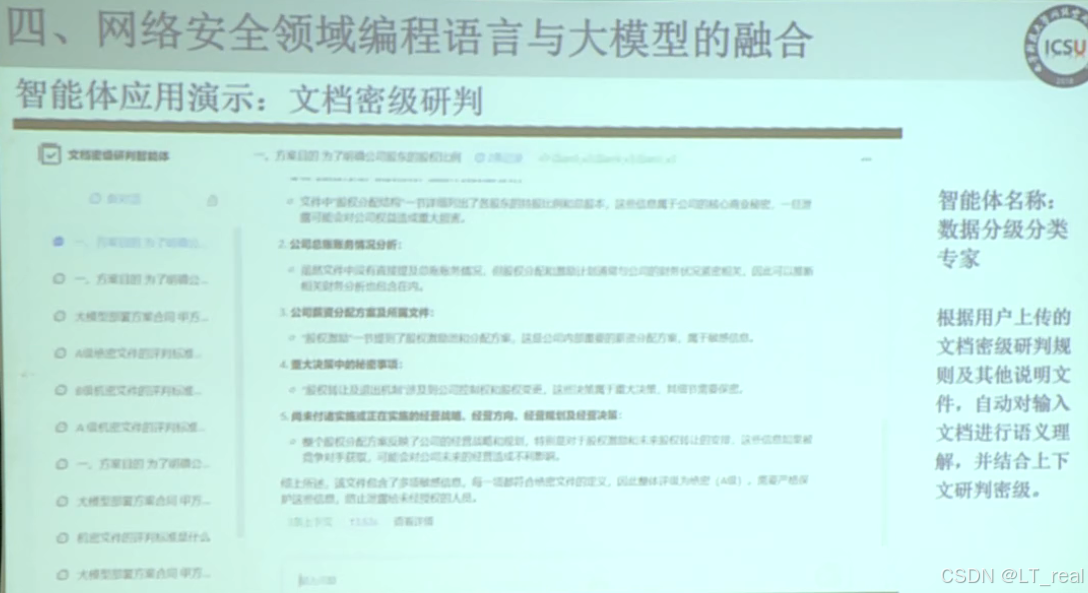

演示:通过问答的漏洞自动检查、挖掘,实现红蓝队、CTF的AI教练、文档密级研判

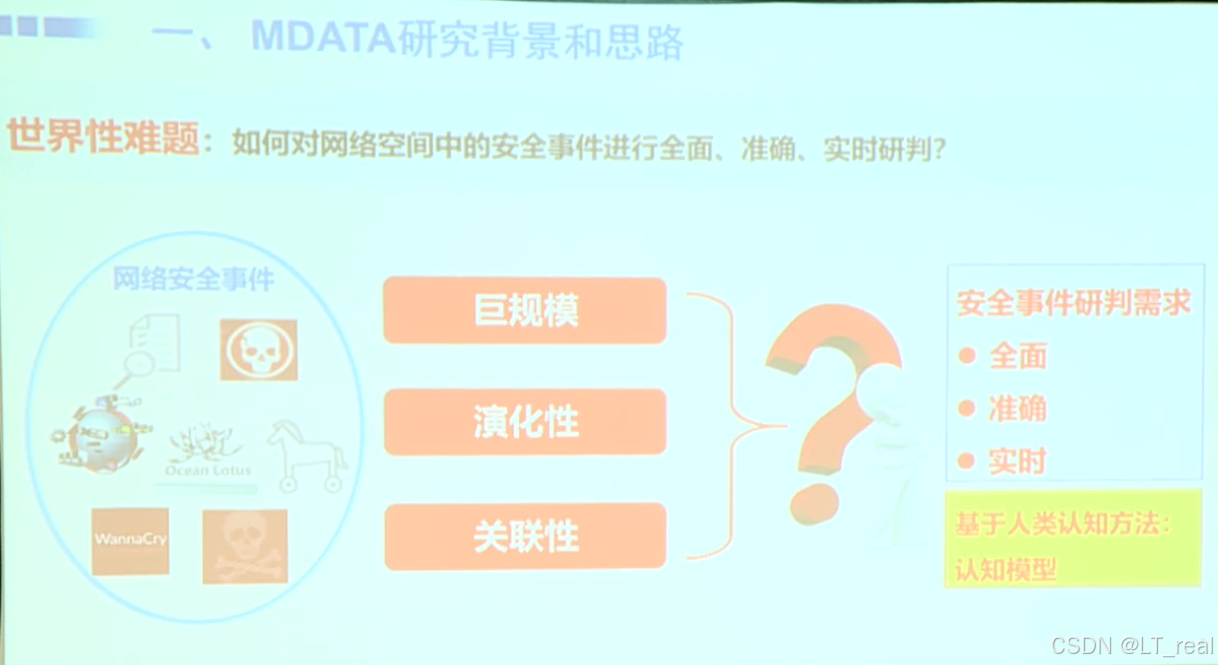

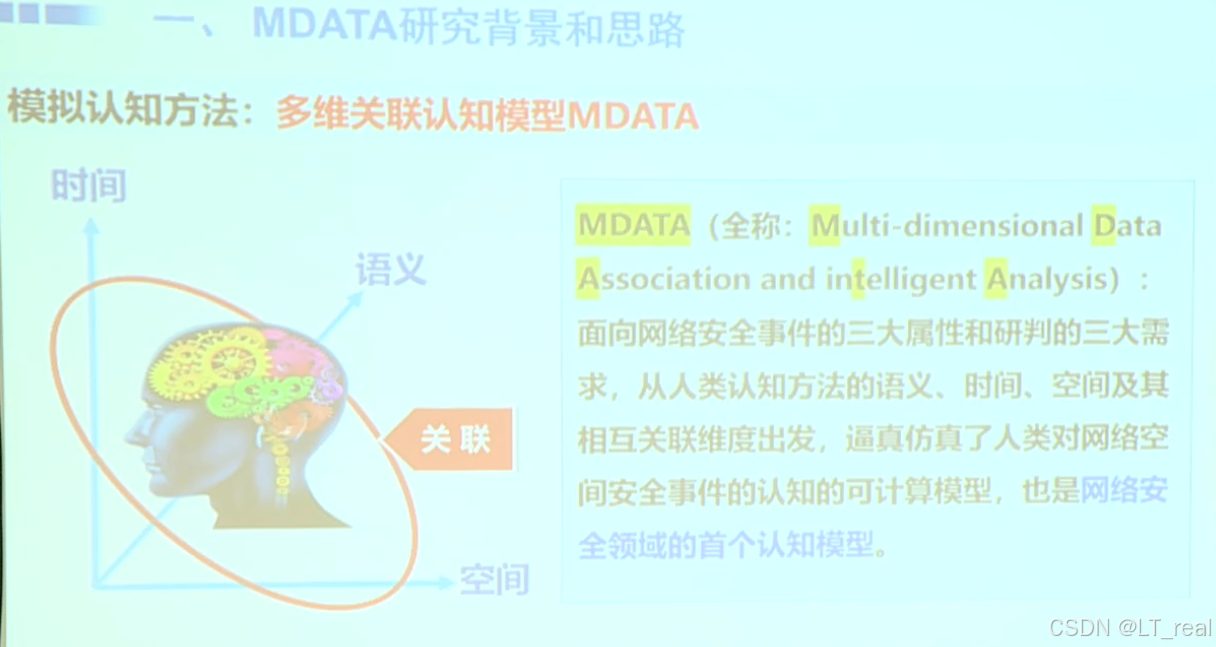

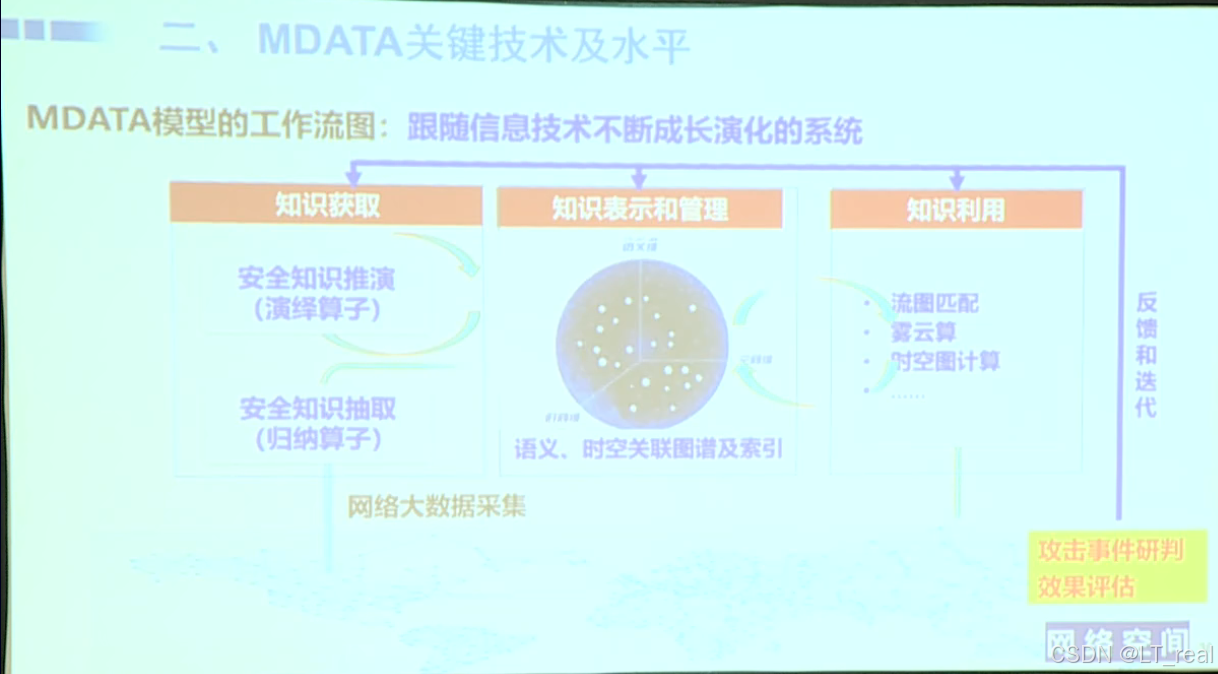

三、贾 焰 《多维关联认知模型MDATA及其在网络安全事件研判中的应用》

1.提出

安全事件研判难题:

认知模型:基于人脑(缺乏人类认知过程的支撑)、基于学习(难以支撑不断演化的场景)

现在提出 模拟认知方法(增加时空关联)

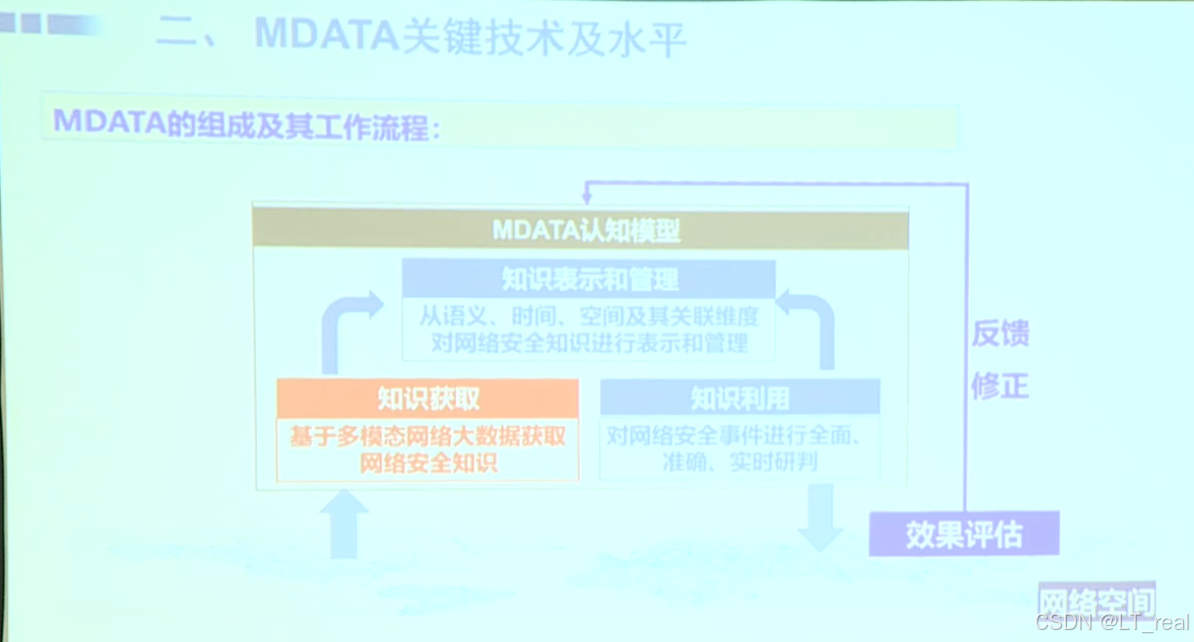

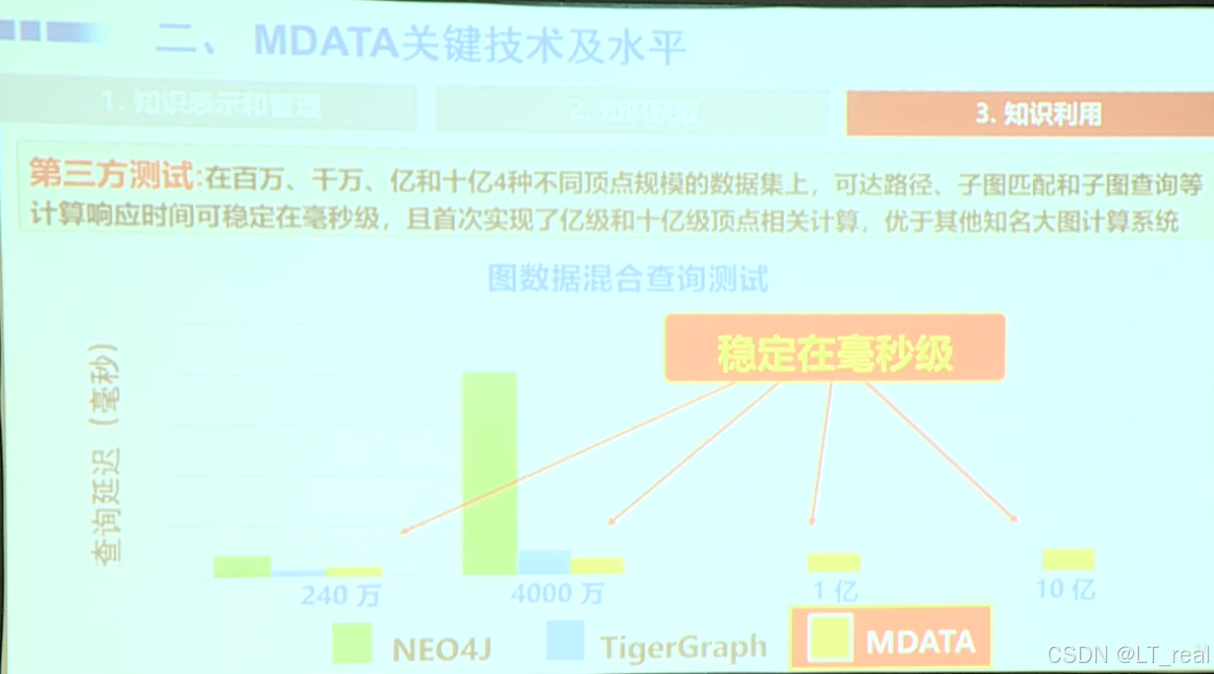

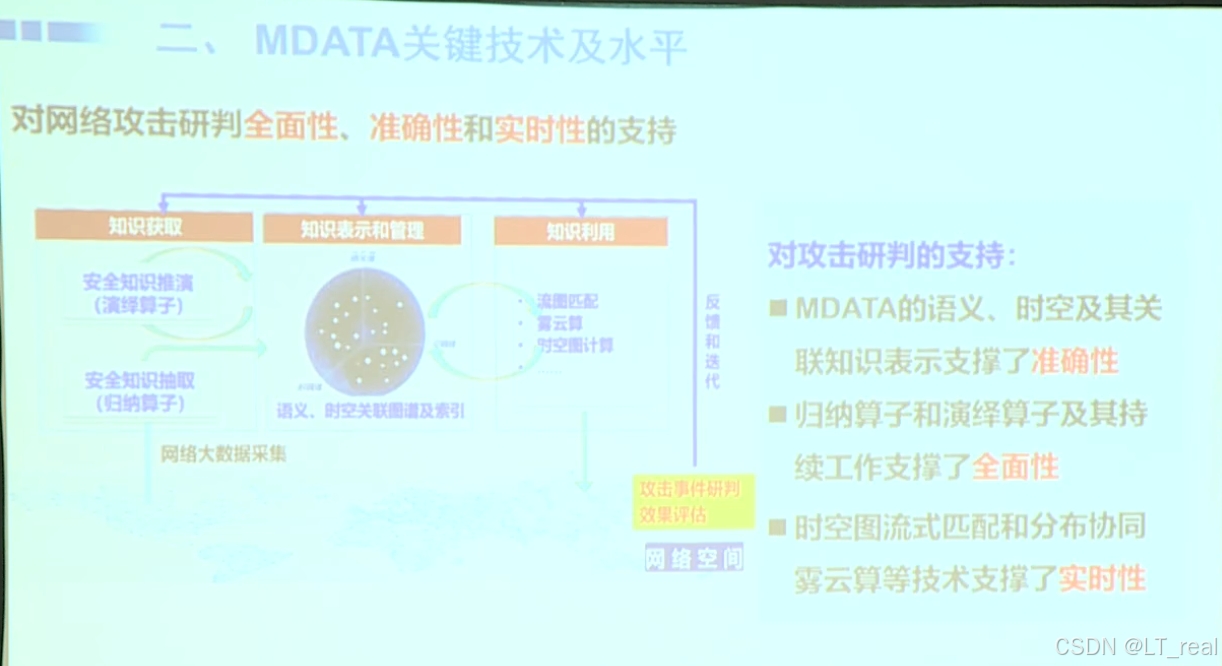

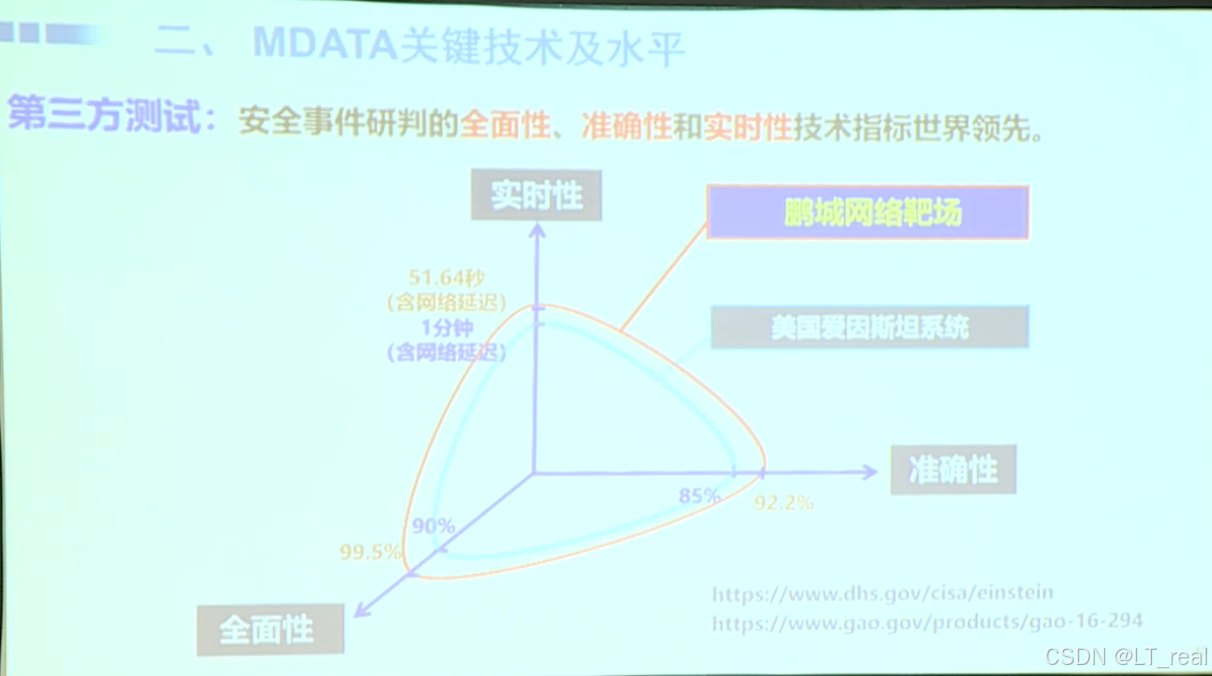

2.关键技术

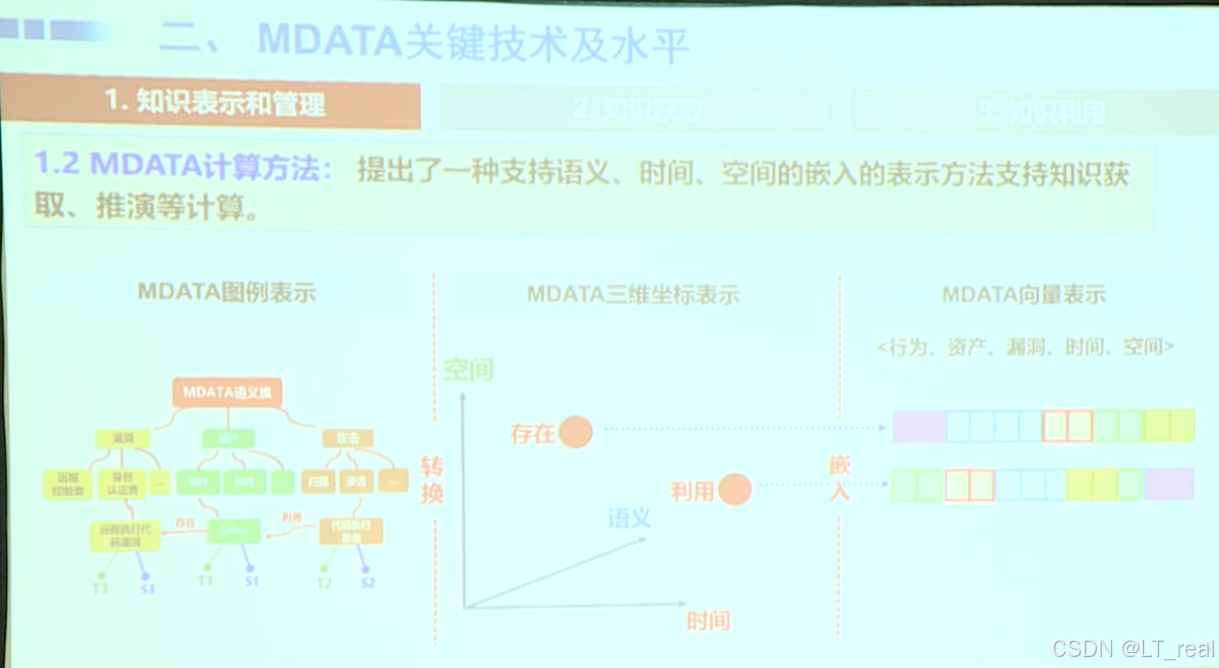

知识表示和管理的三个难点:可理解、可计算、可管理

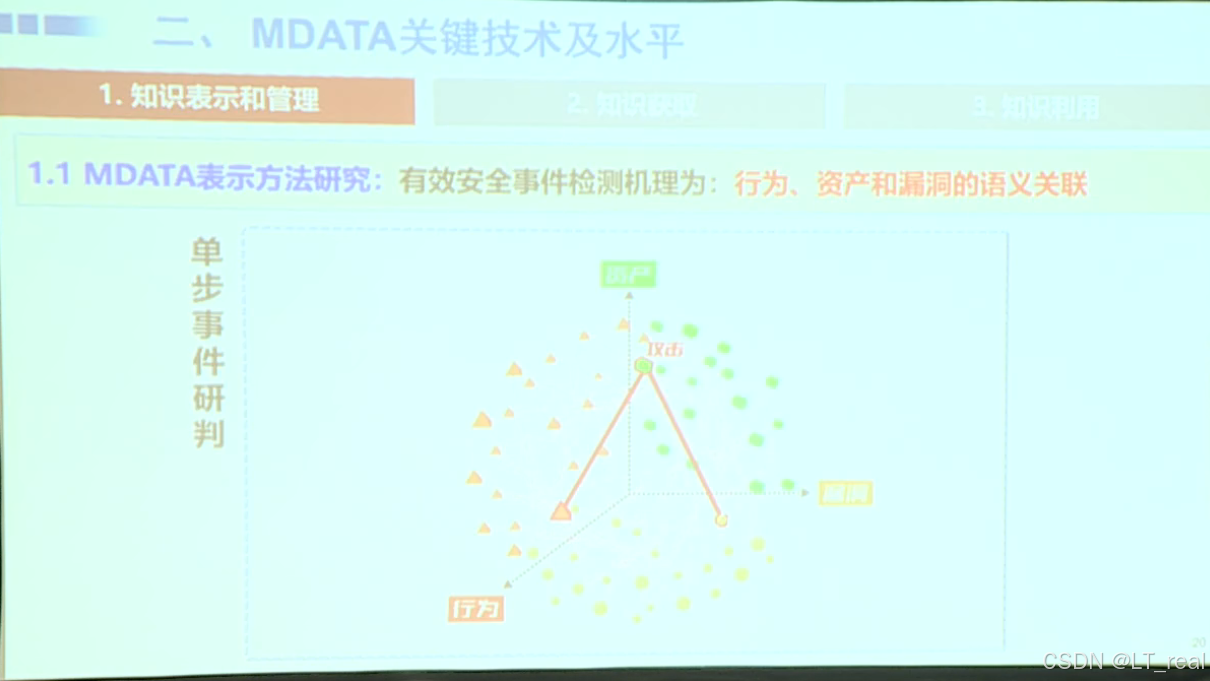

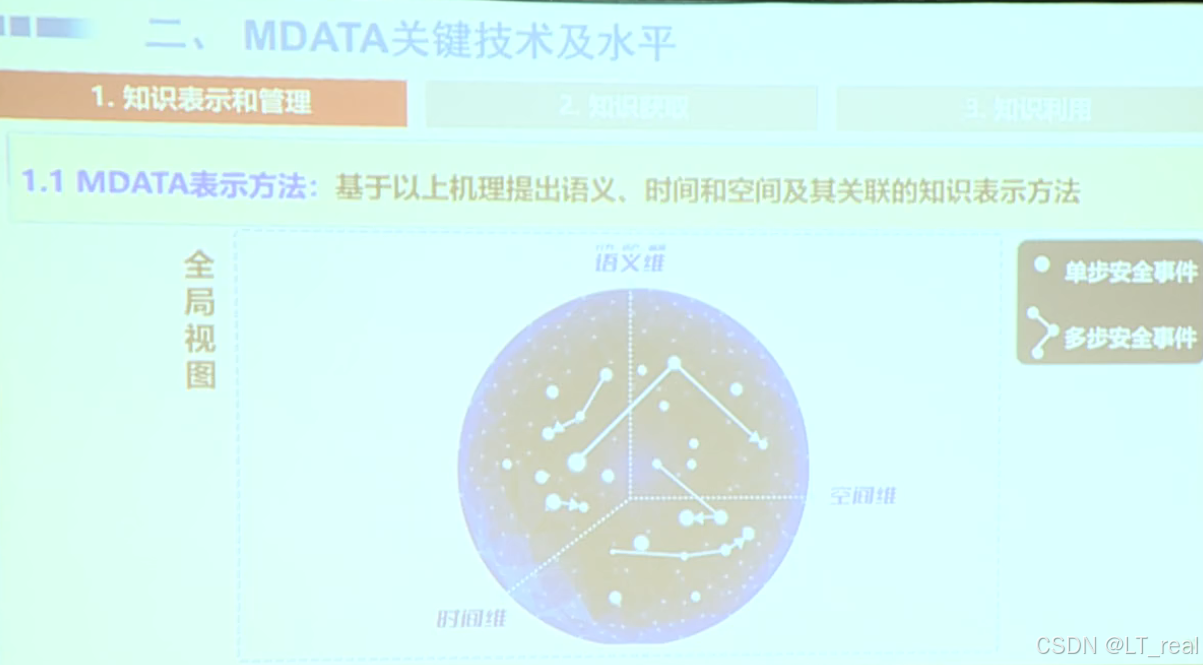

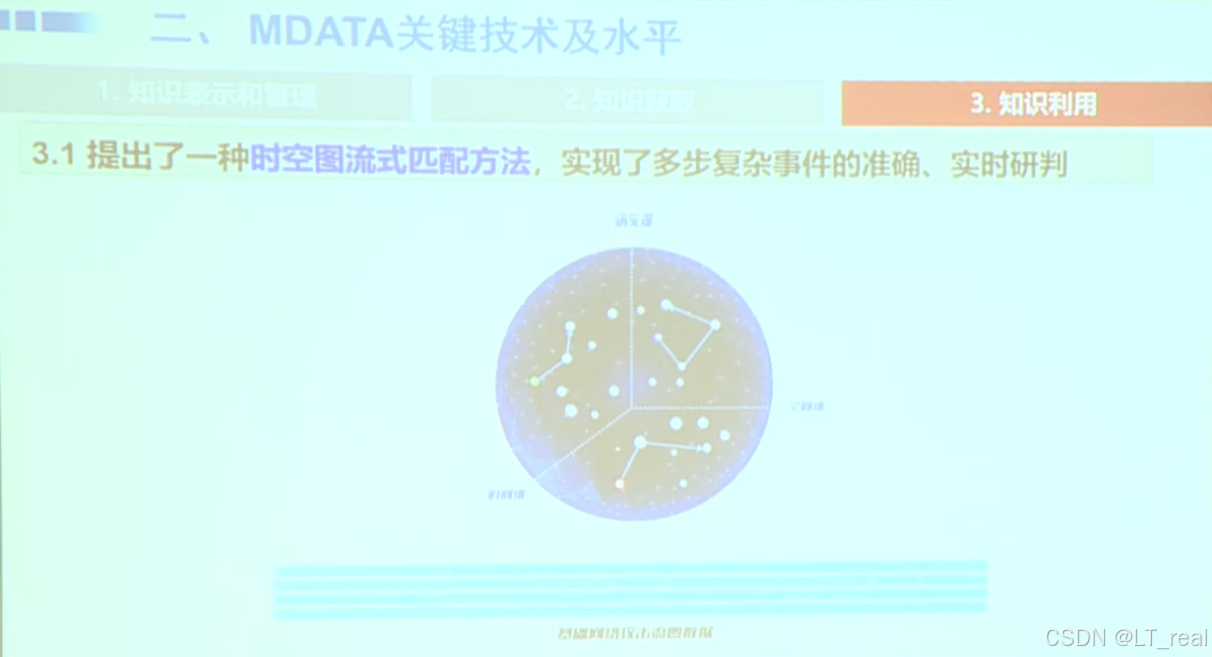

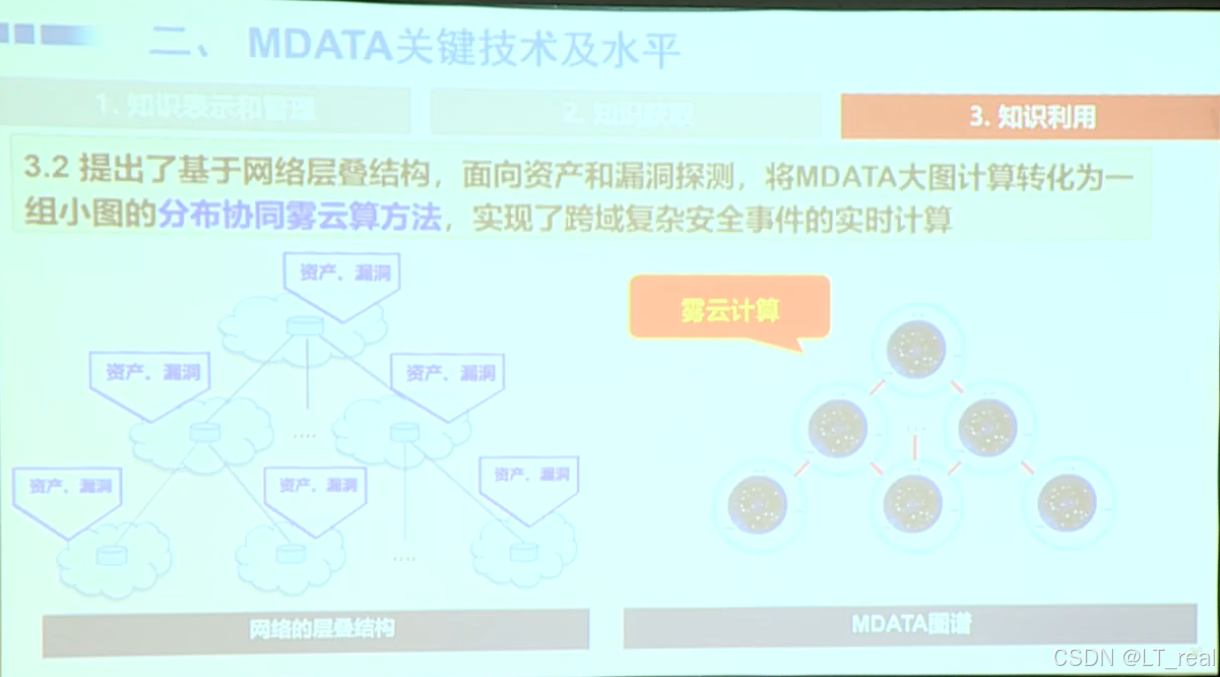

有效单步攻击只用三维度,而多步攻击就要关联时空:

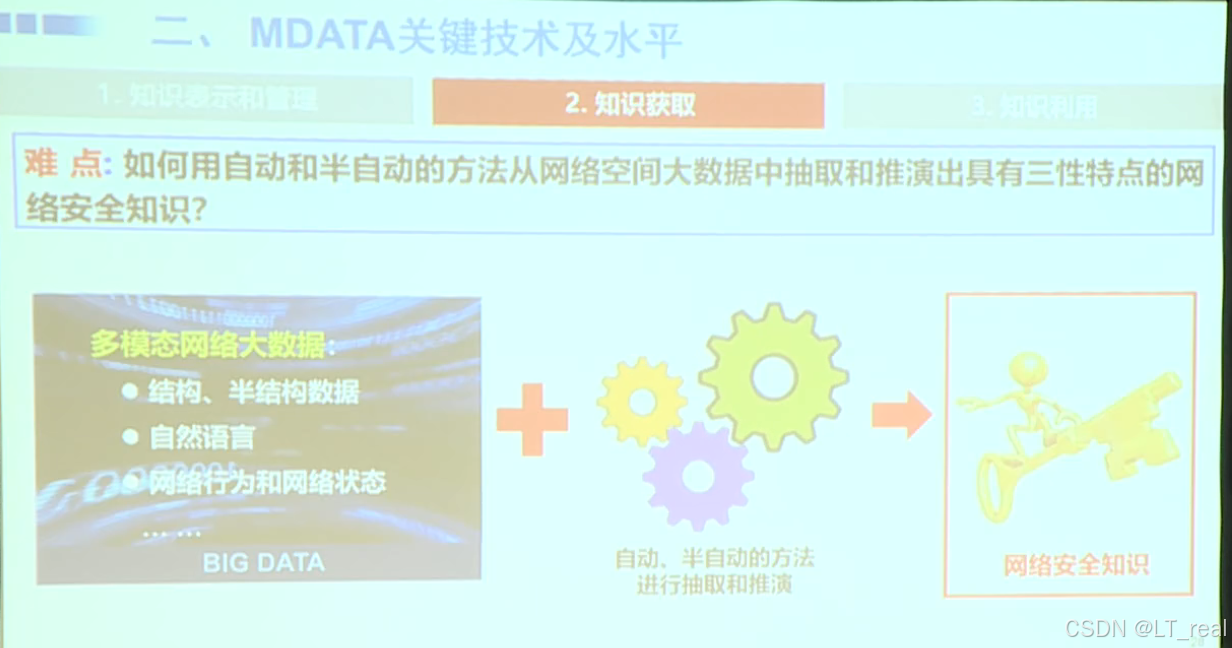

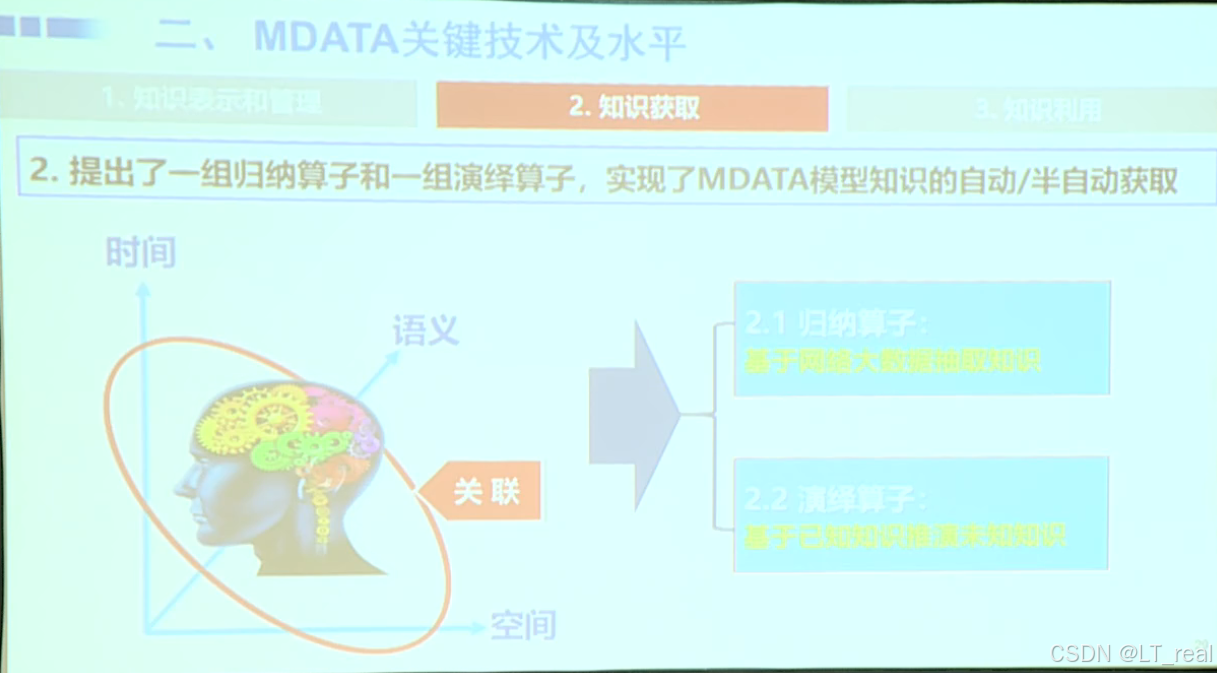

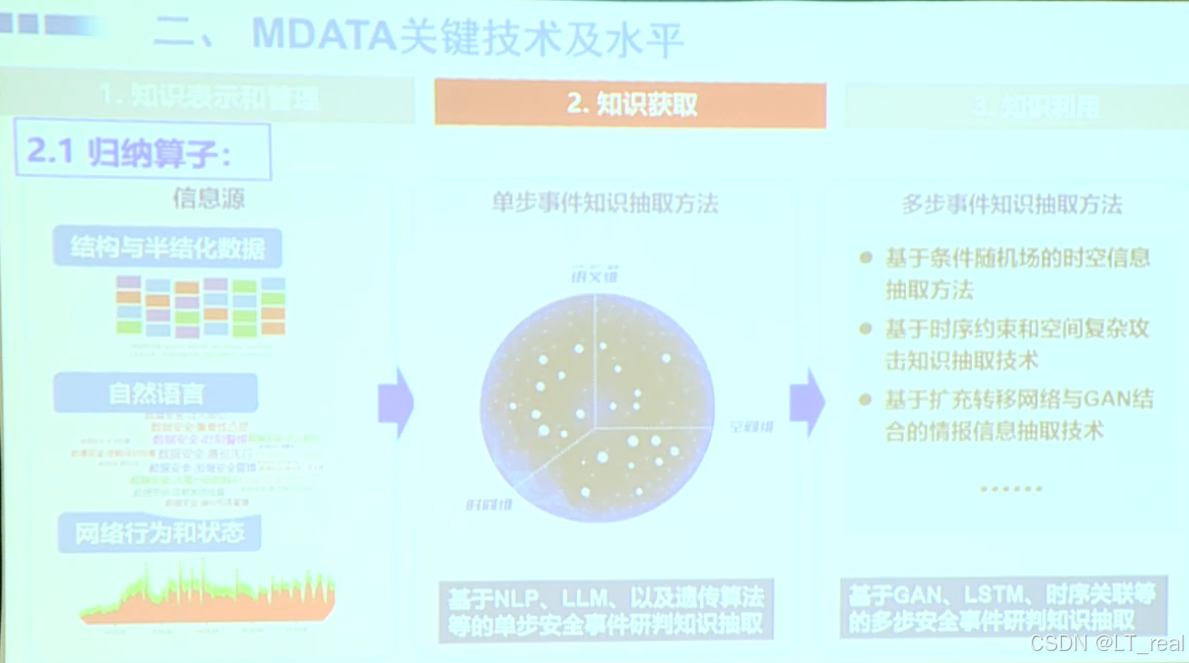

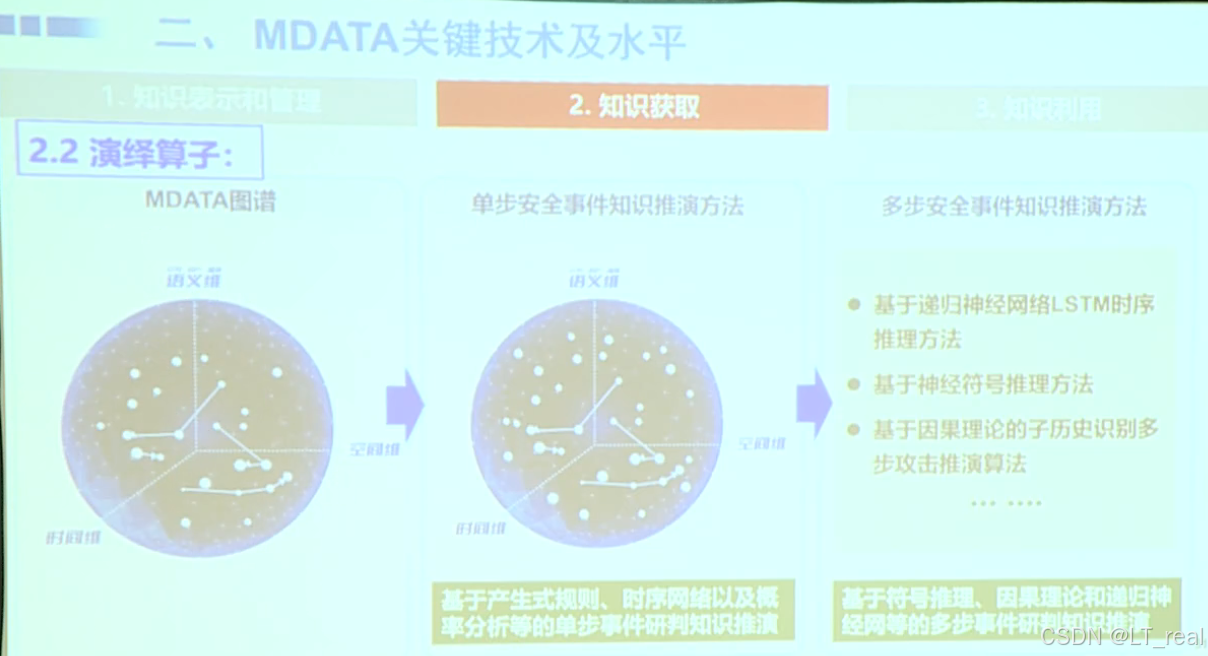

知识获取,设计了两种方法:

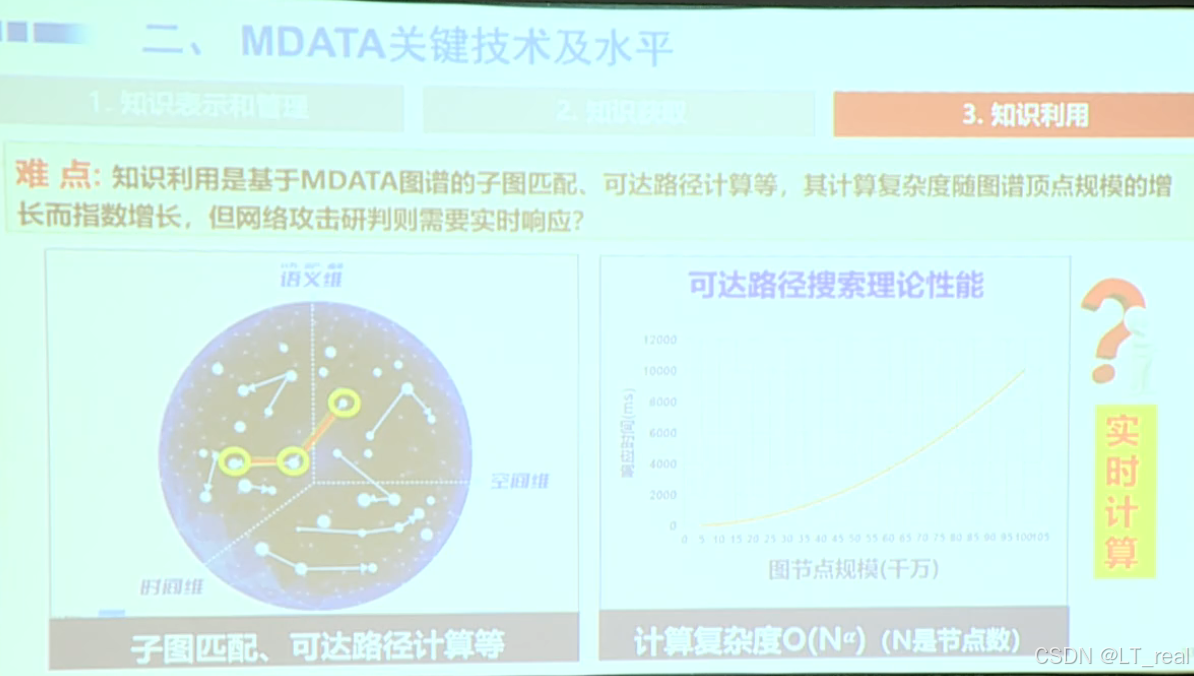

知识利用,两种方法

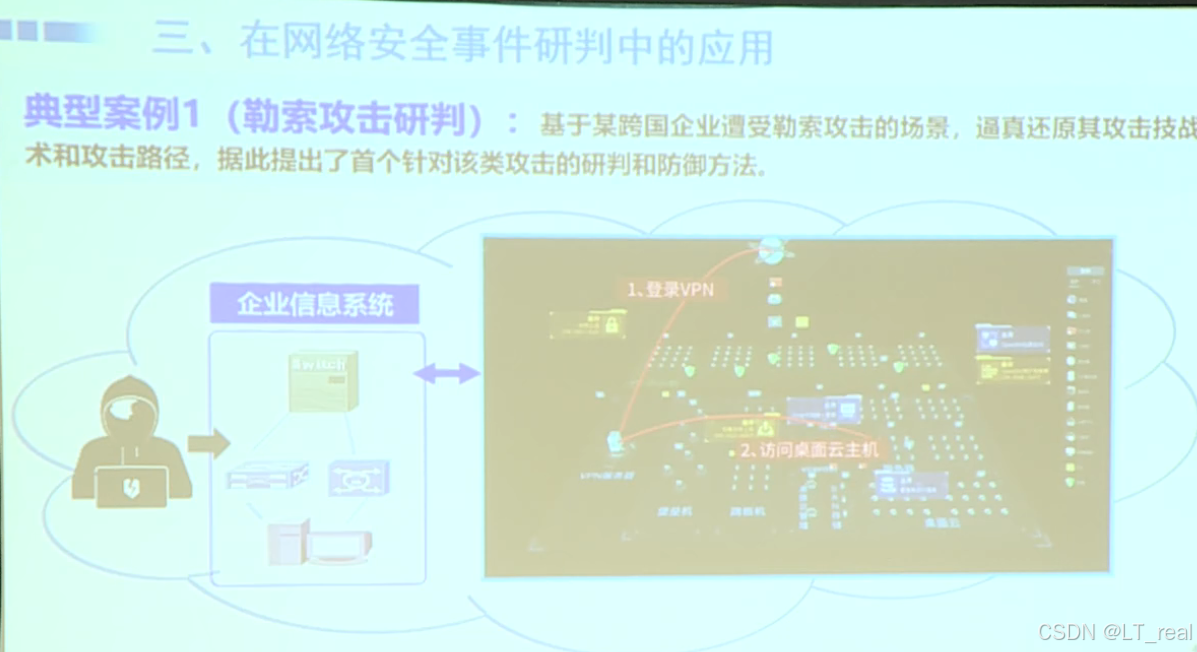

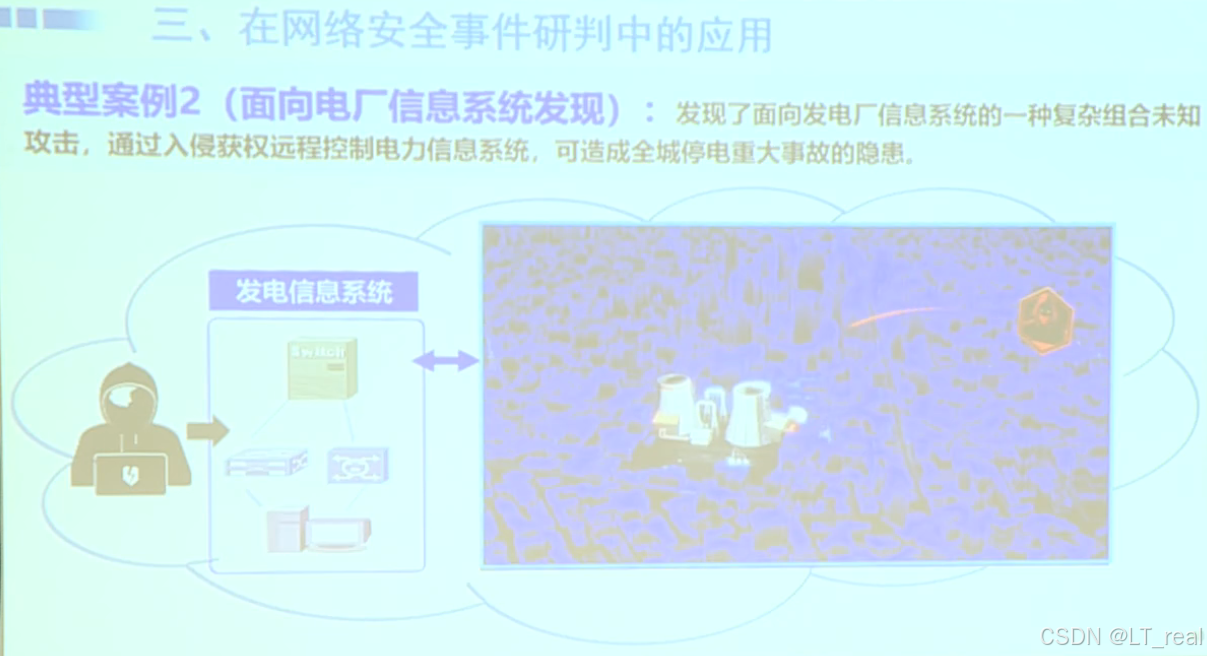

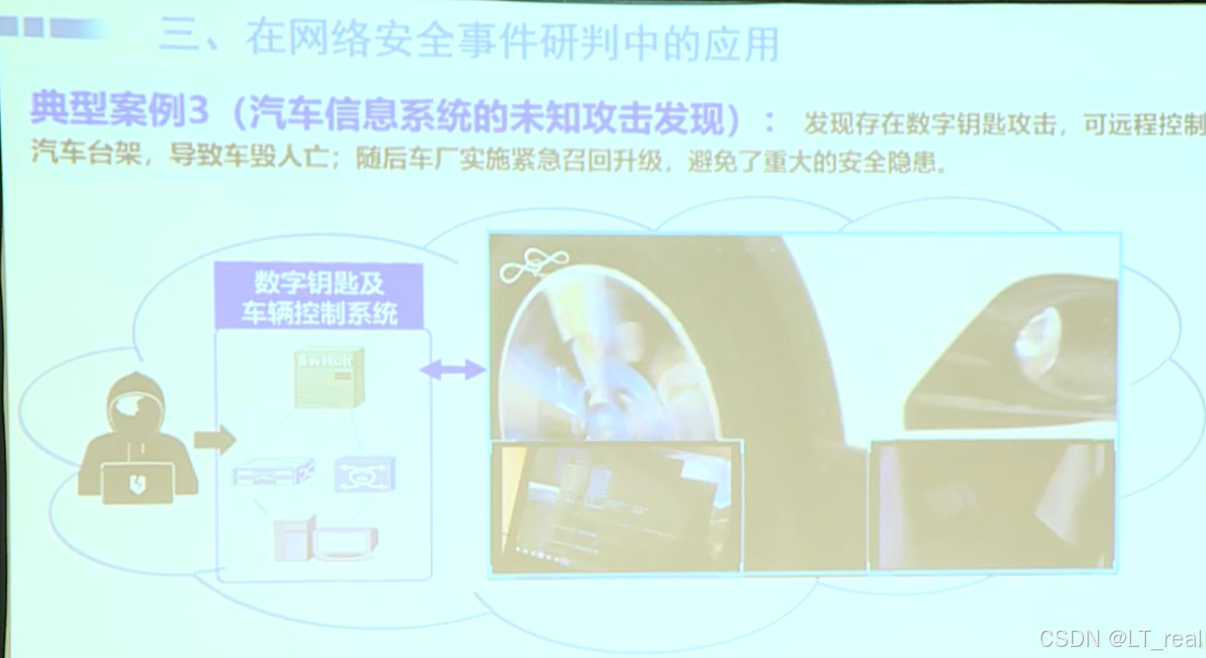

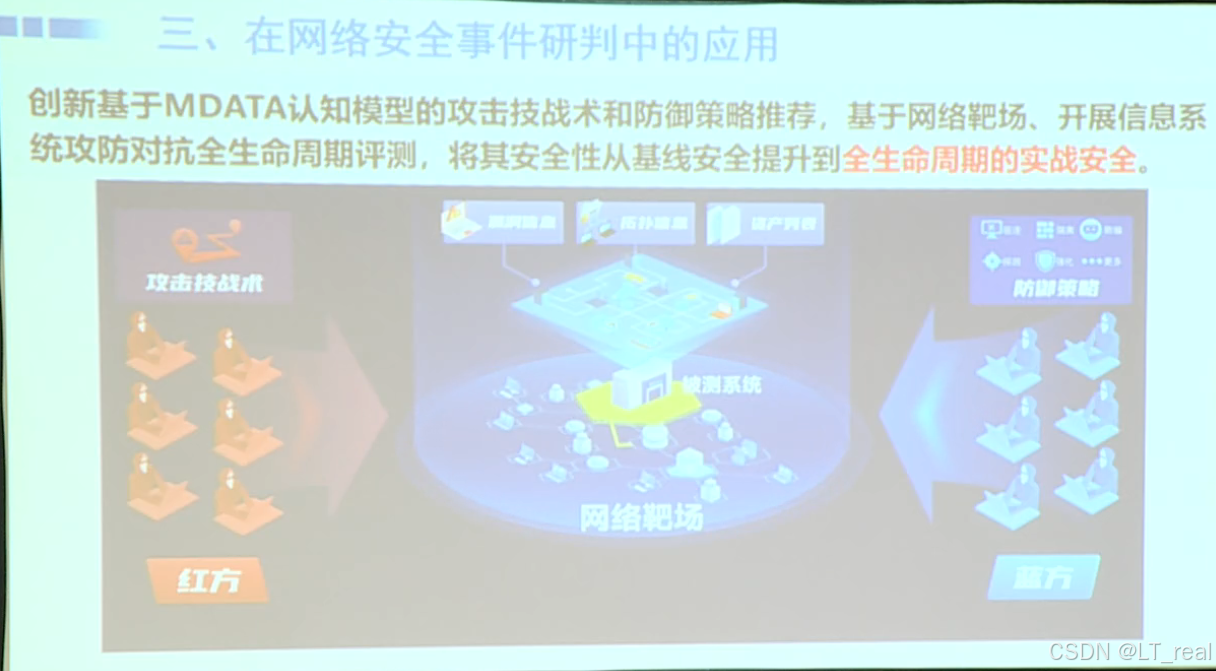

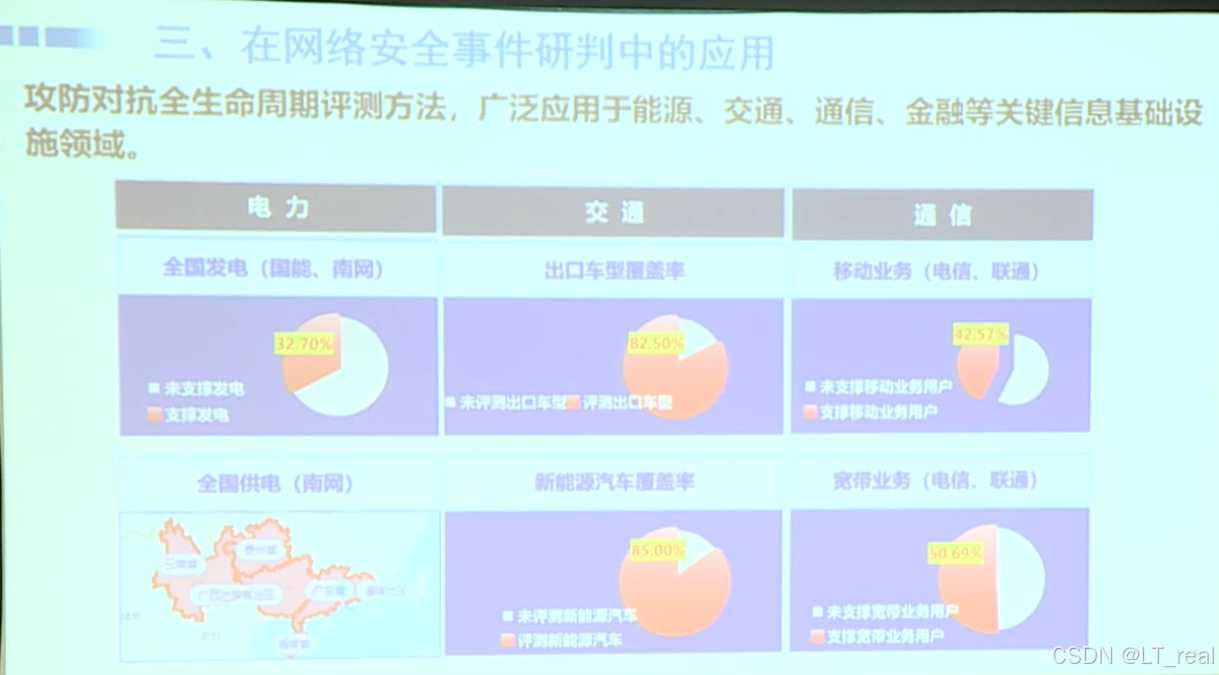

3.应用:

提出一种新评测方法,如果在靶场中没有被打倒则为安全的:

在智能车中广泛应用,人工智能已经被运用到各行各业多年,全新视角展现多维关联的大模型。

中场点评

1.张院士:处理安全问题f(x)中的f,工作有产品,未来是系统对抗、智能对抗,人工智能本身的安全;

2.大模型赋能网络安全,但是不能确保网络安全,其能力边界需要探索(适用场景、小样本);

3.在矛盾中前进,积极利用新技术,但也要考虑其引入的新问题。

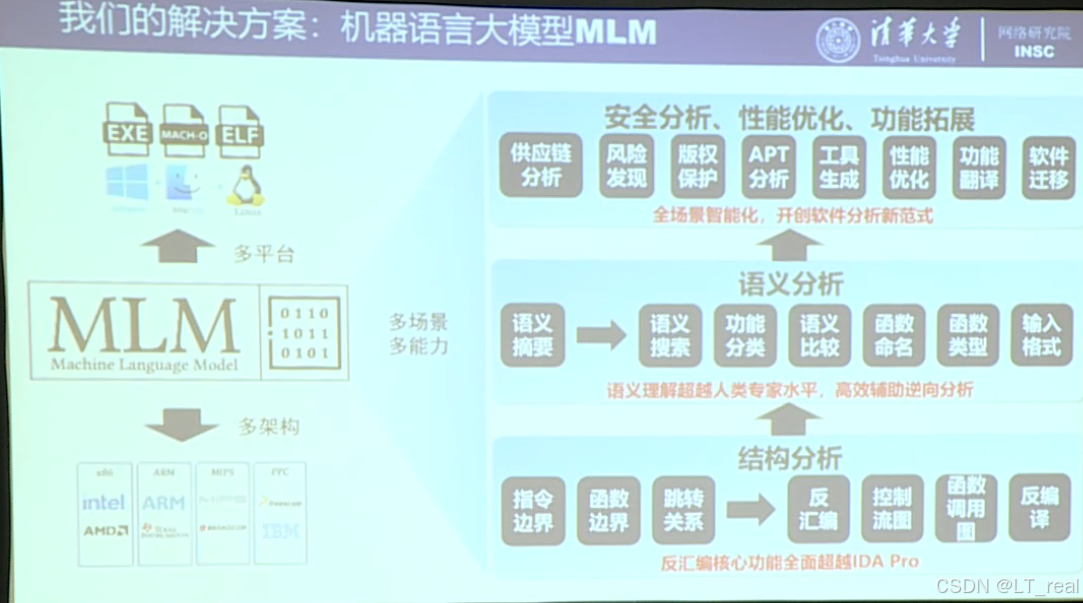

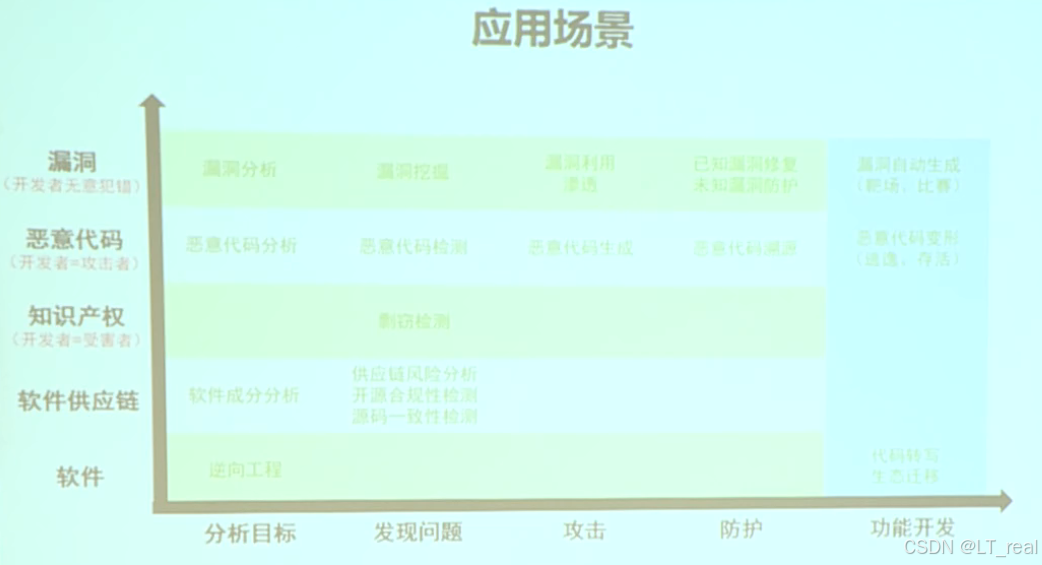

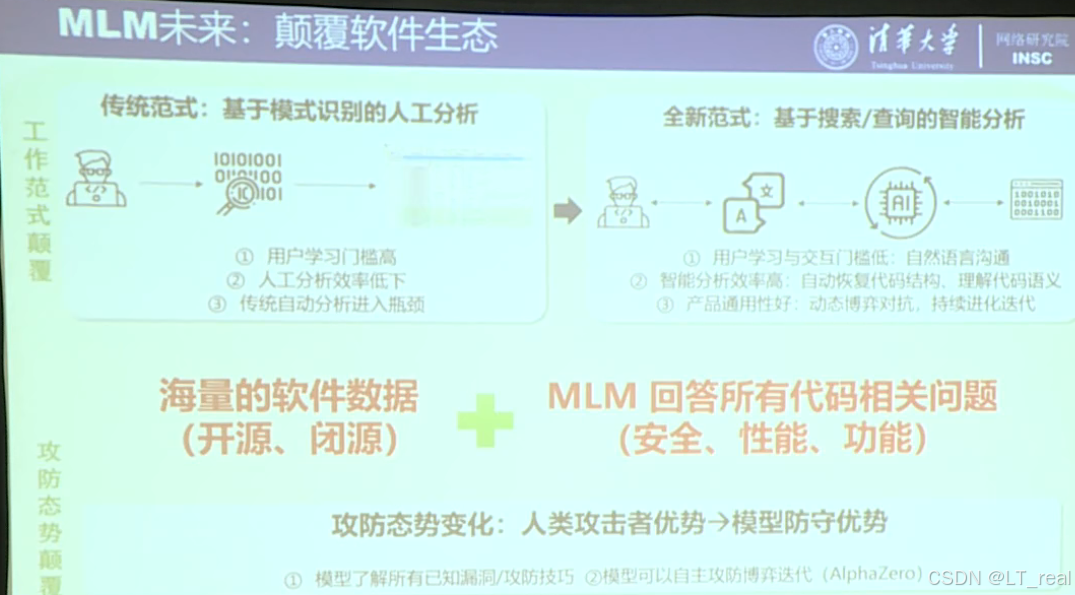

四、张 超 《机器语言大模型赋能软件自主可控与安全可信》

问题分析

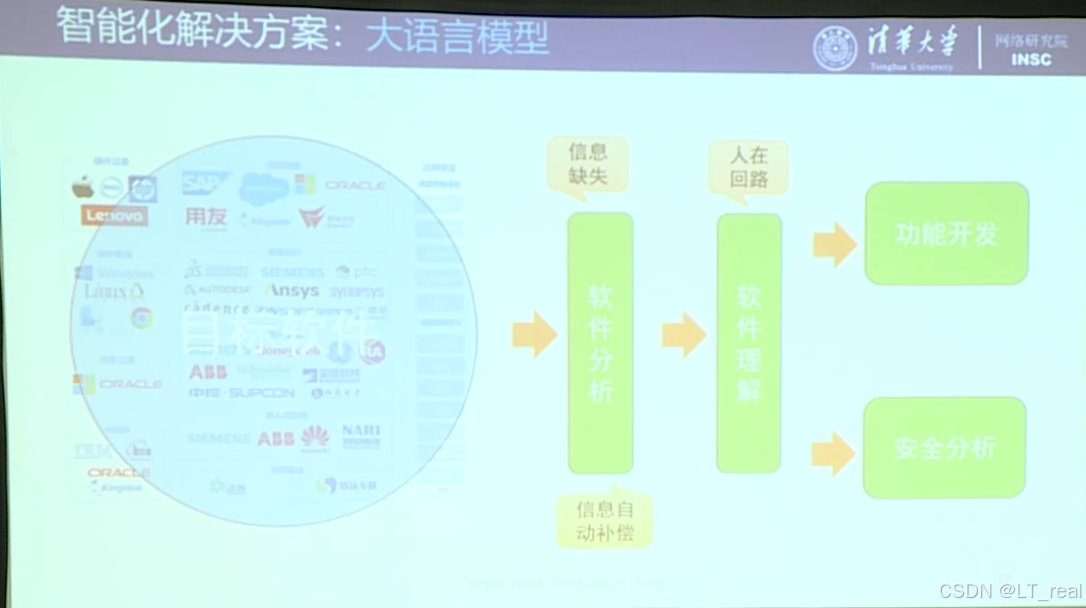

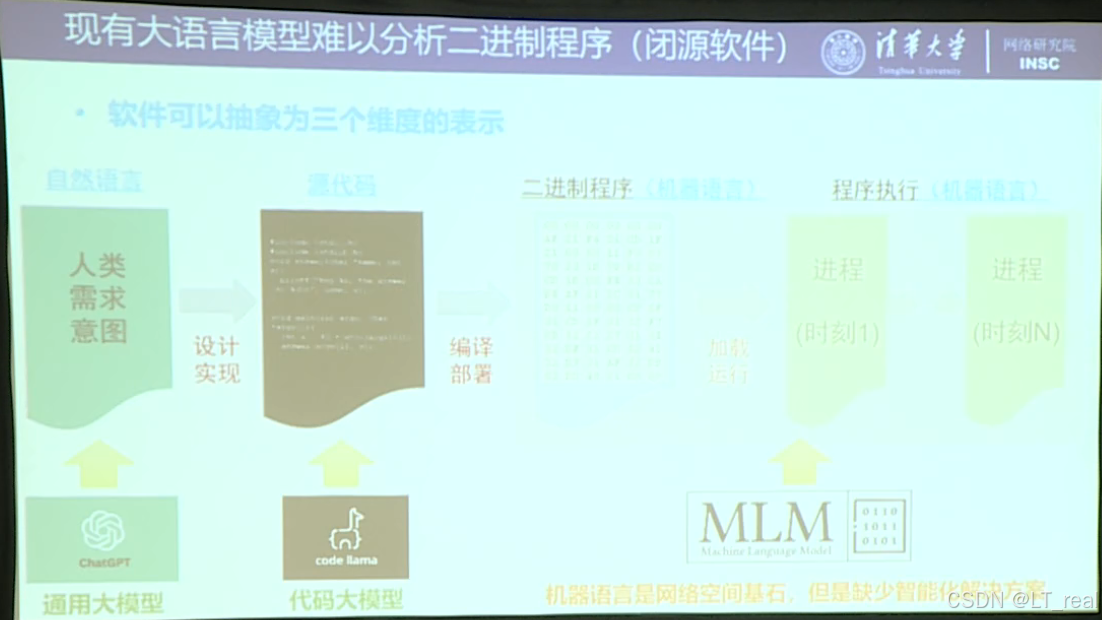

1.目前软件现状主要是国外引领,国内缺失,在自主可控软件、风险发现方面仍需继续发展,如何分析、理解闭源软件、二进制软件是一个困难;

2.在软件理解方面,严重依赖人工,当前技术不能自动化分析,需要有人的高度参与,同时大模型在软件分析在源代码方面表现好,但在二进制程序表现不好(反汇编)。

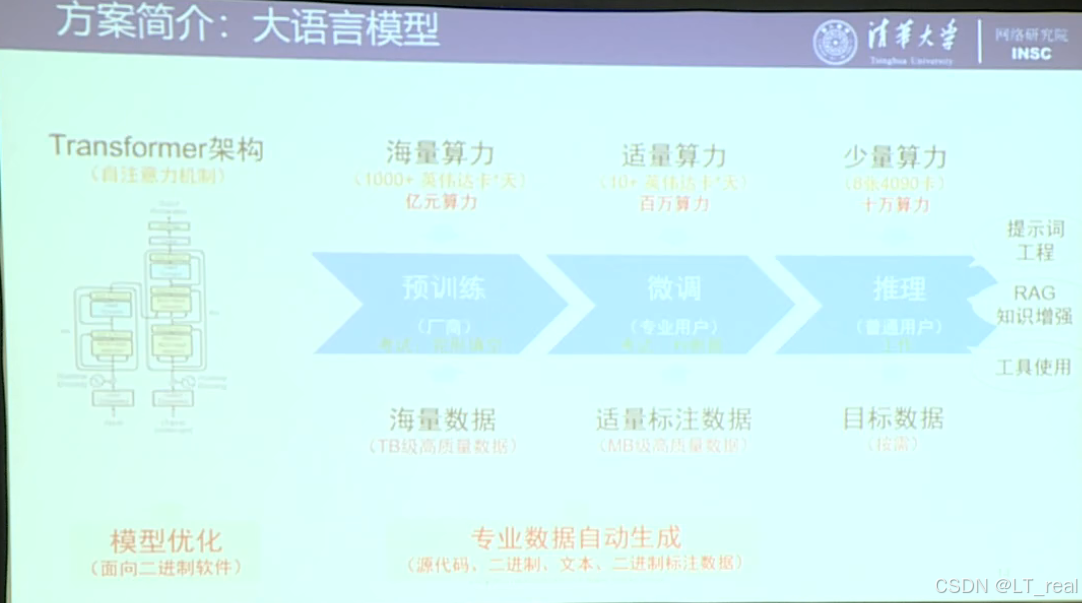

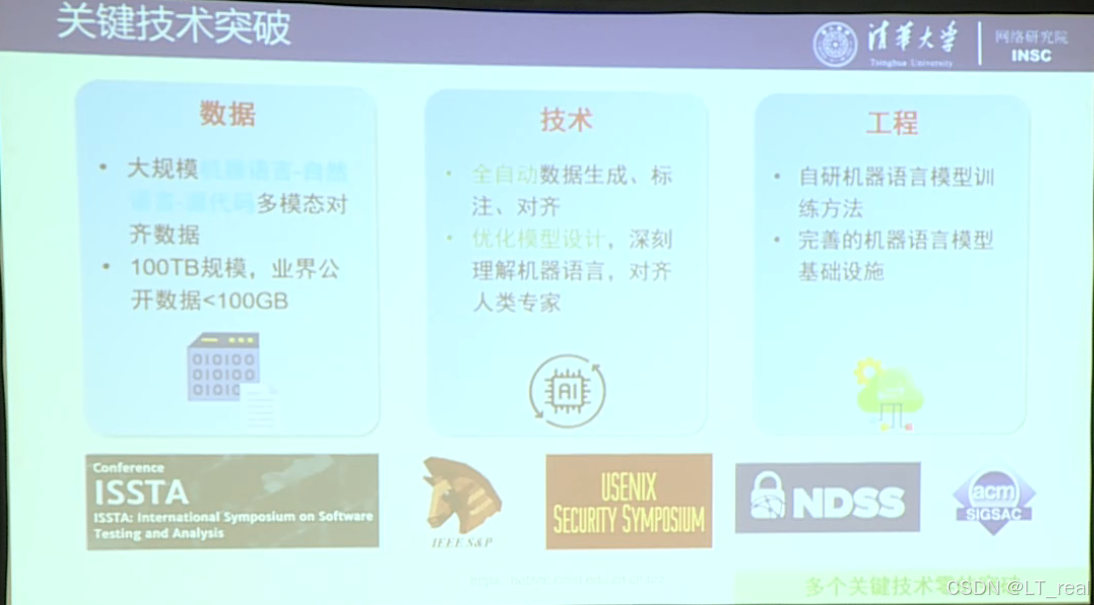

智能化解决方案:

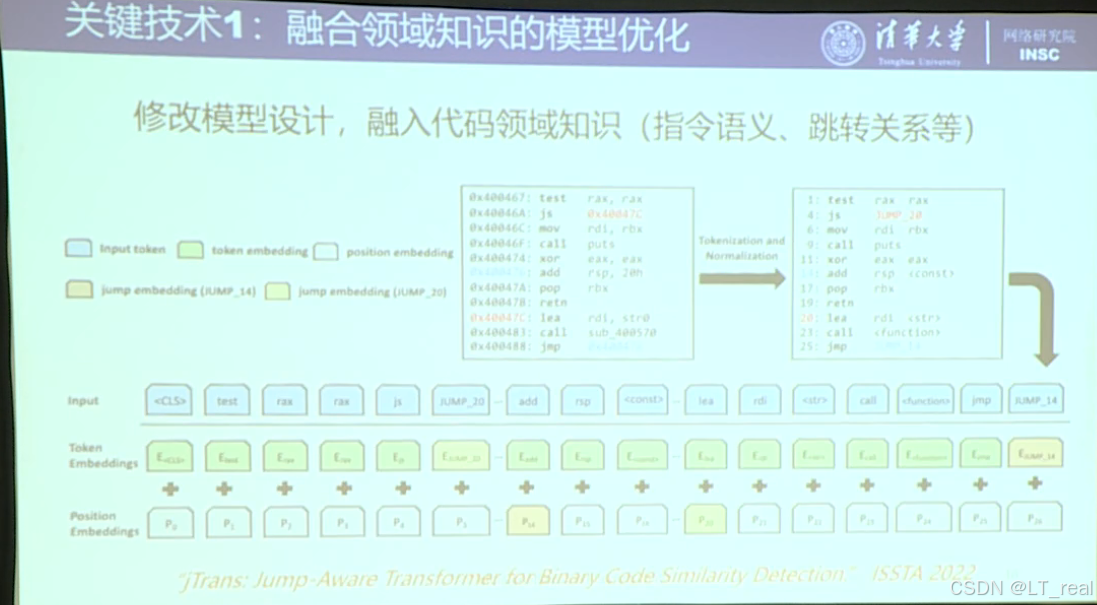

优化模型理解跳转语义

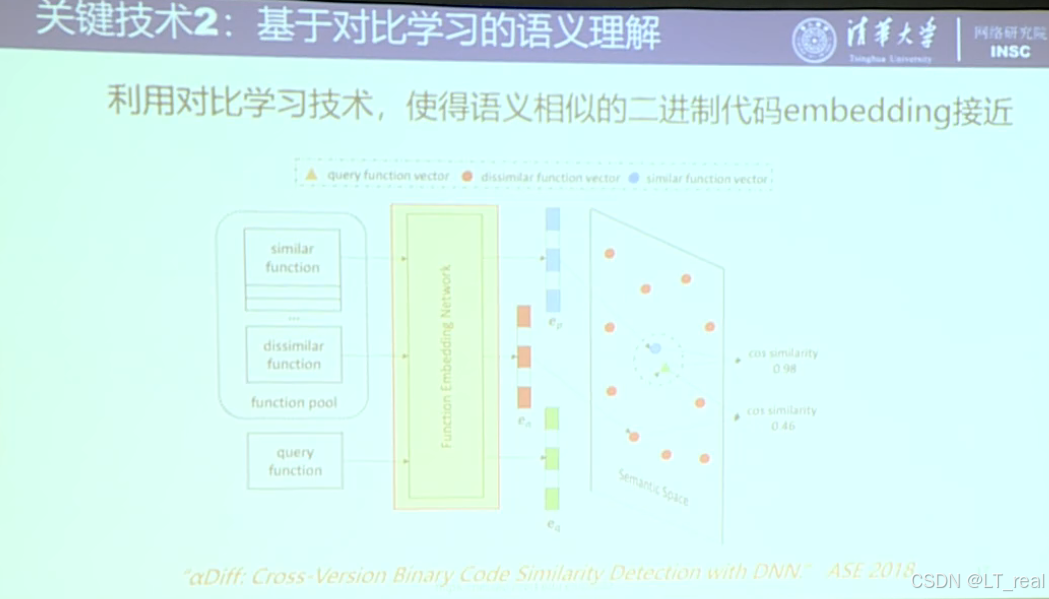

对比学习优化代码语义理解,对其进行区分

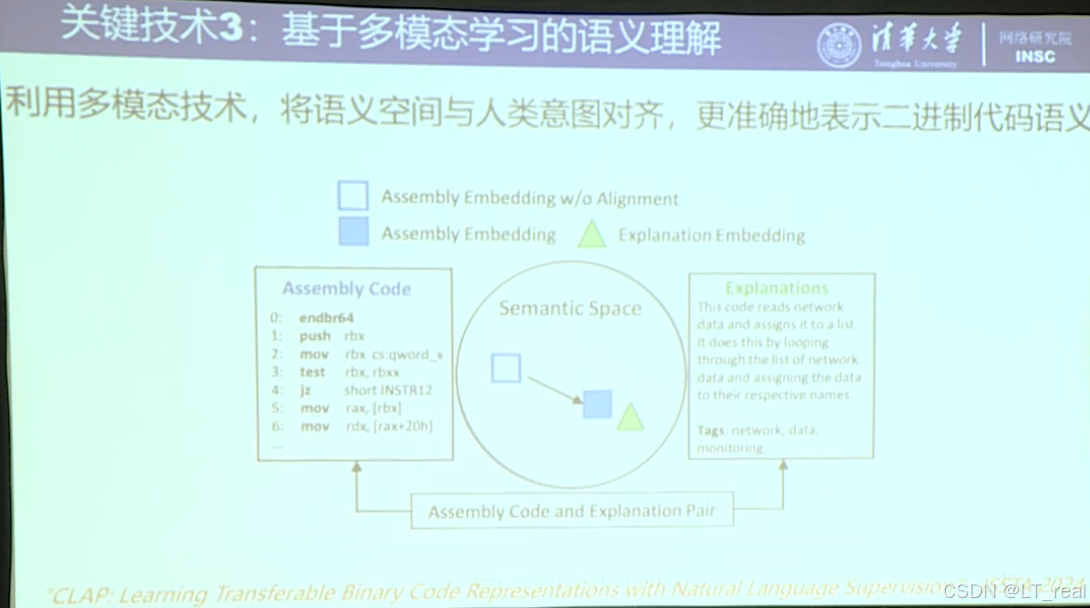

优化模型,贴近语义

应用效果

主要在漏洞挖掘方面,已经完成漏洞挖掘大模型,在利用方面还可以提高

在软件方面,有逆向工程,方便查询

在软件供应链方面,可以分析二进制软件、闭源软件上下游组件对应漏洞,并提高数据准确率

在知识产权方面,识别代码剽窃

最后是自主可控,实现跨语言、跨平台转写

大模型防御成本高,目前没有方法落地。

提问环节

1.模型自博弈中非对称博弈行为,如何套用AlphaGO对称模式?

虽然攻防双方能力不对等,但双方都各有相应优势,人的攻击能力还可以进行超越,目前趋势是模型优于人类,还无法判断模型攻击和模型防御的优劣。

2.漏洞方面已有工作积累,目前在AI方面有新方向,图表示是否有前景?

只用图的效果一般,但可以融入大模型中运用,图与代码语义不对等,目前大模型刻画语义是更好的。

3.二进制同源分析、代码剽窃、闭源分析进展?

该领域成熟度较高,大模型理解二进制代码语义,区分细微语义差别,再转成文本输出,目前大模型对比函数间差异效果都不错,但需要海量数据库对比才有效果。

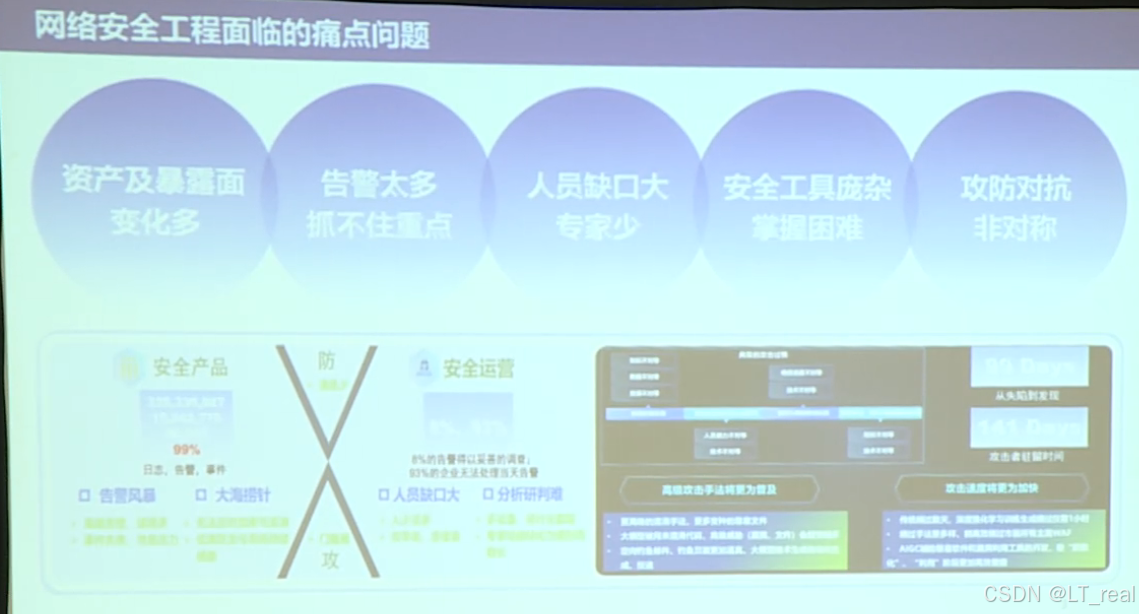

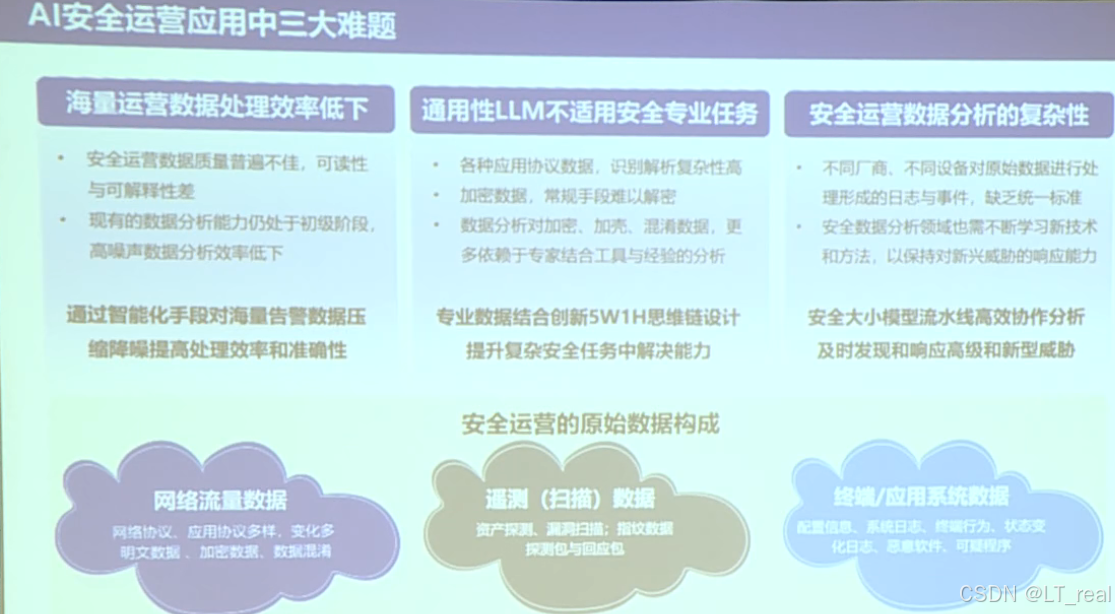

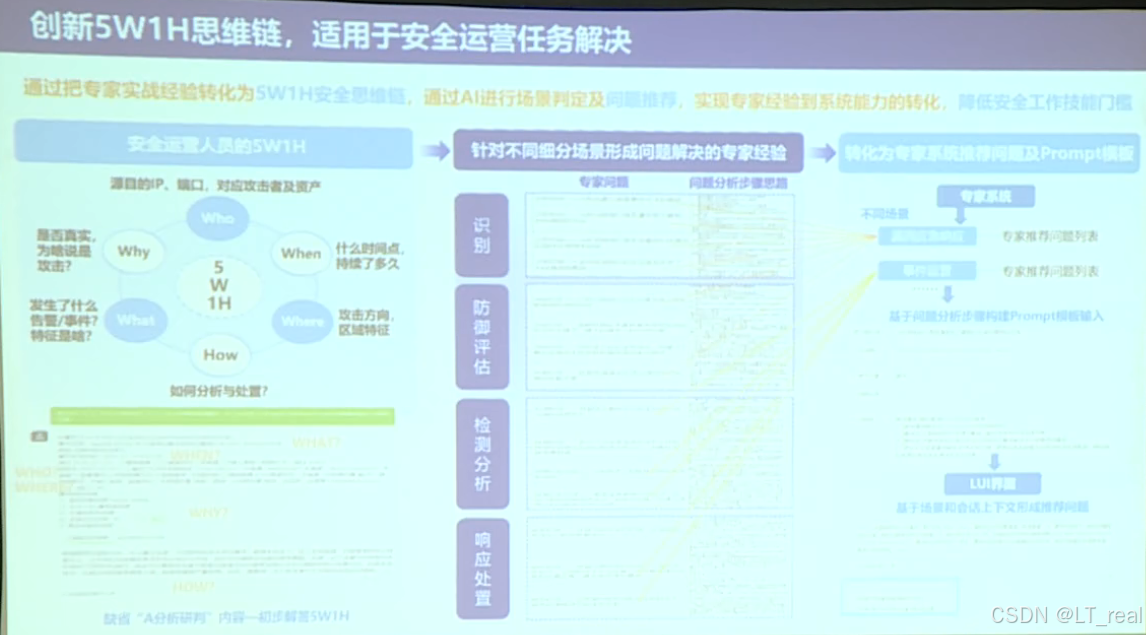

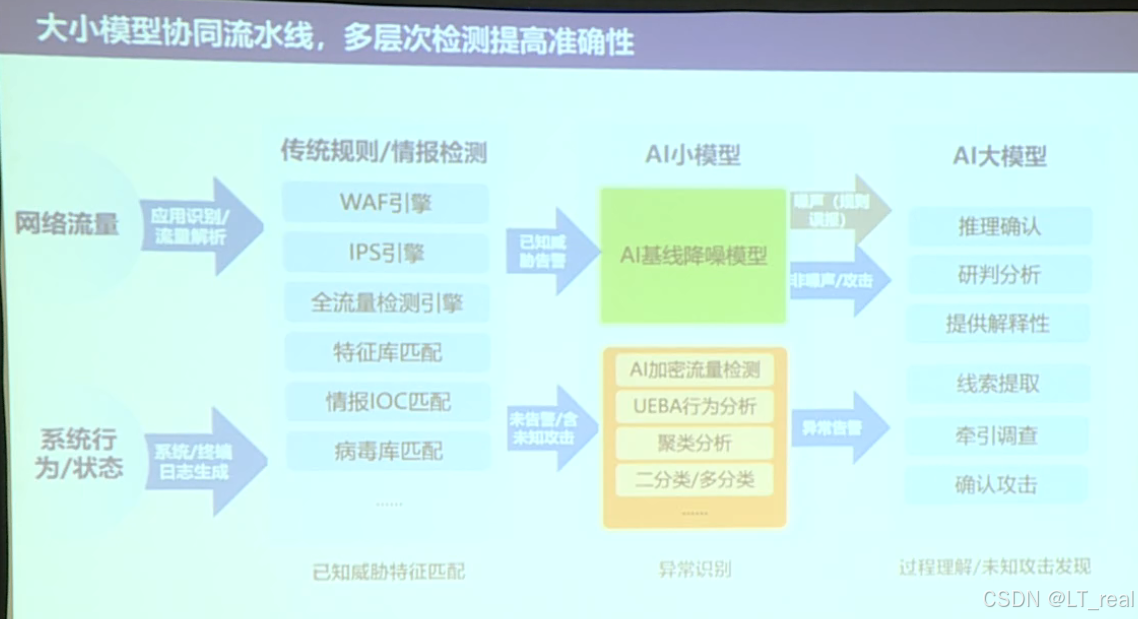

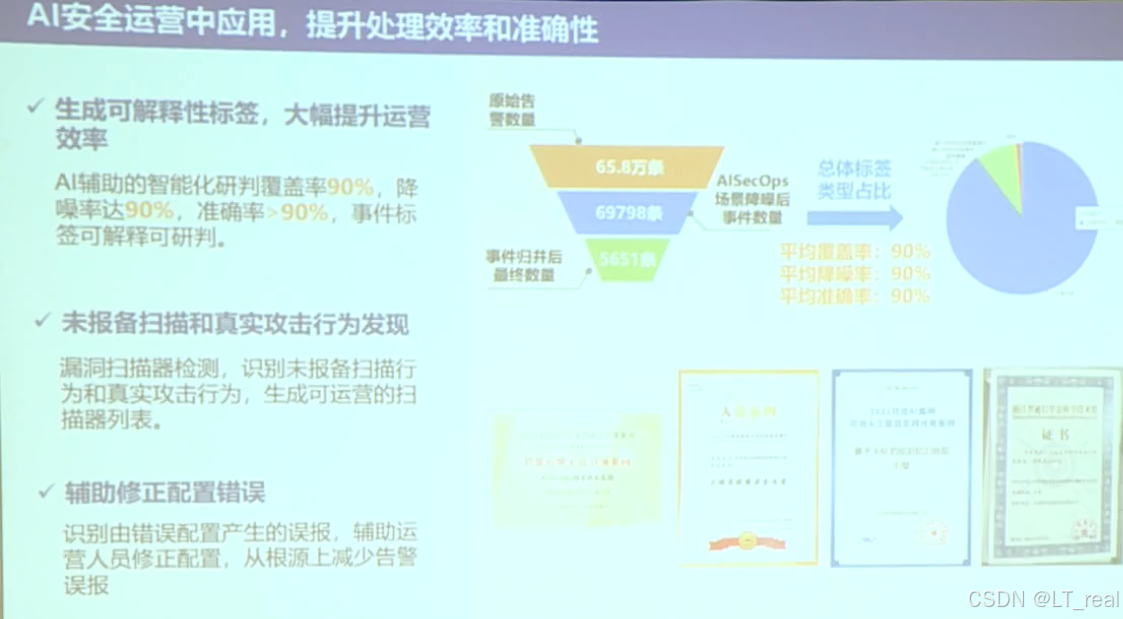

五、叶晓虎 《大模型赋能网络安全运营和对抗中应用进展和问题》

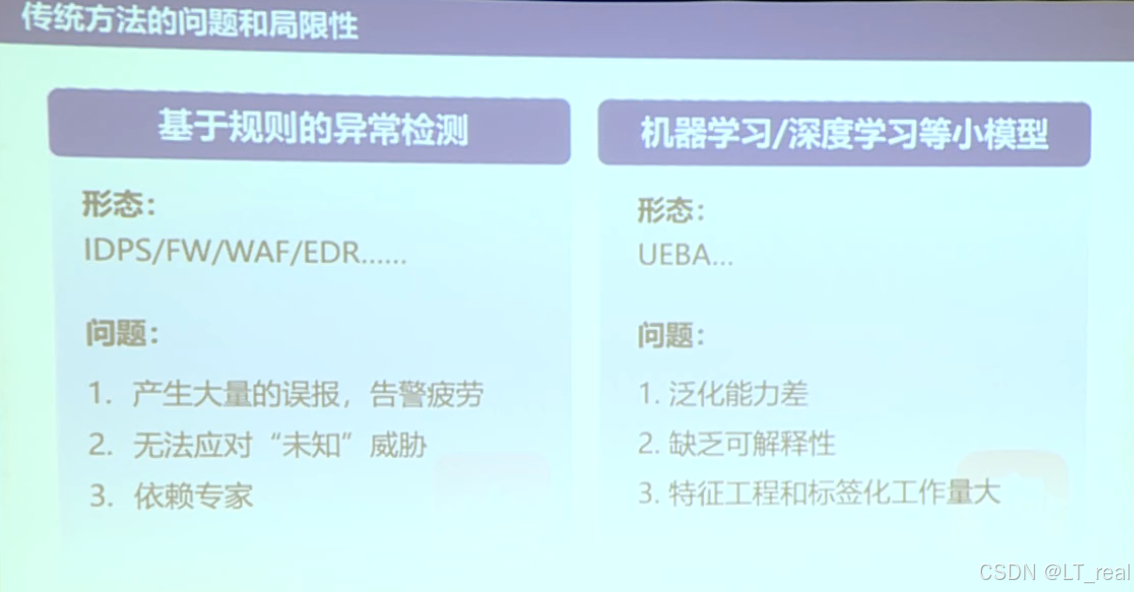

当前的问题,传统方法有局限性

两大收益:新方法更高效、新能力解决新问题

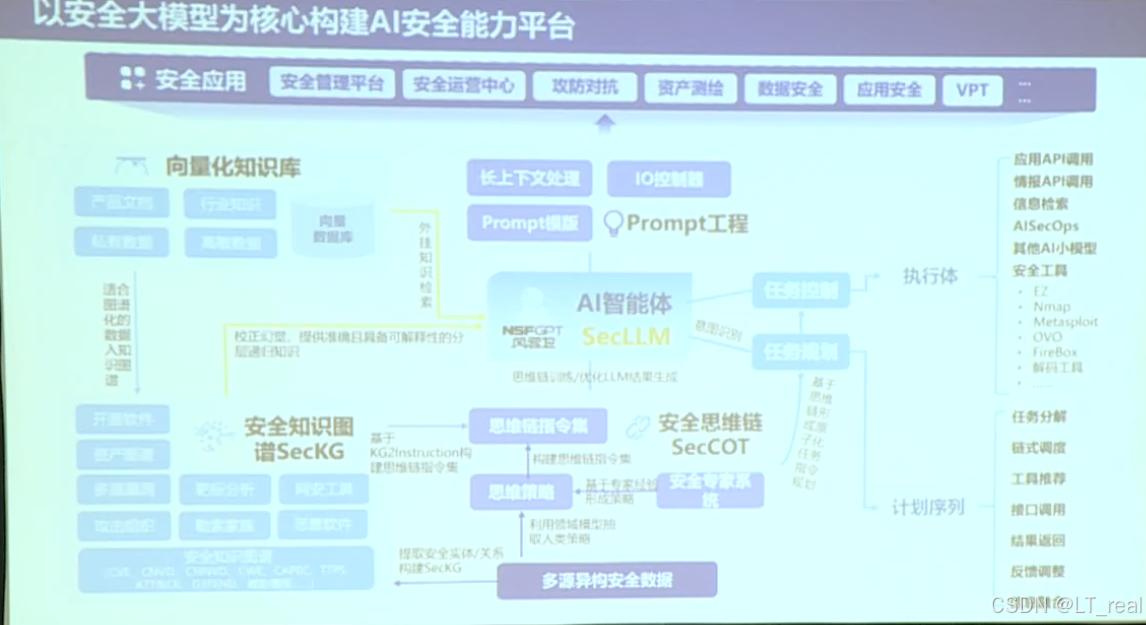

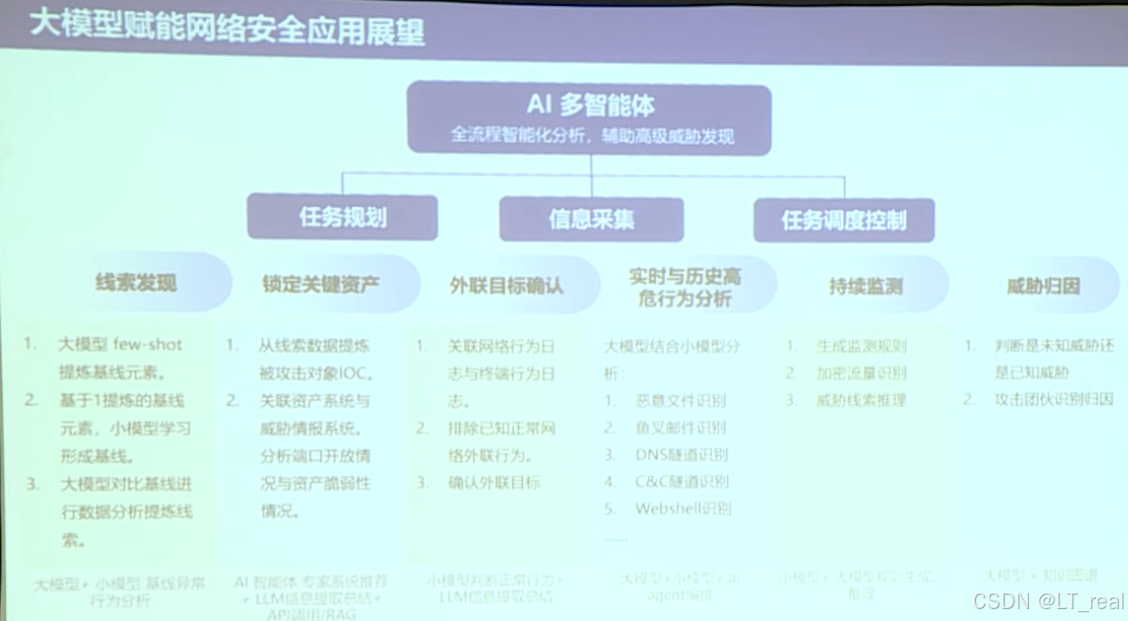

AI安全能力平台

用户需要的是以大模型为核心的安全工具

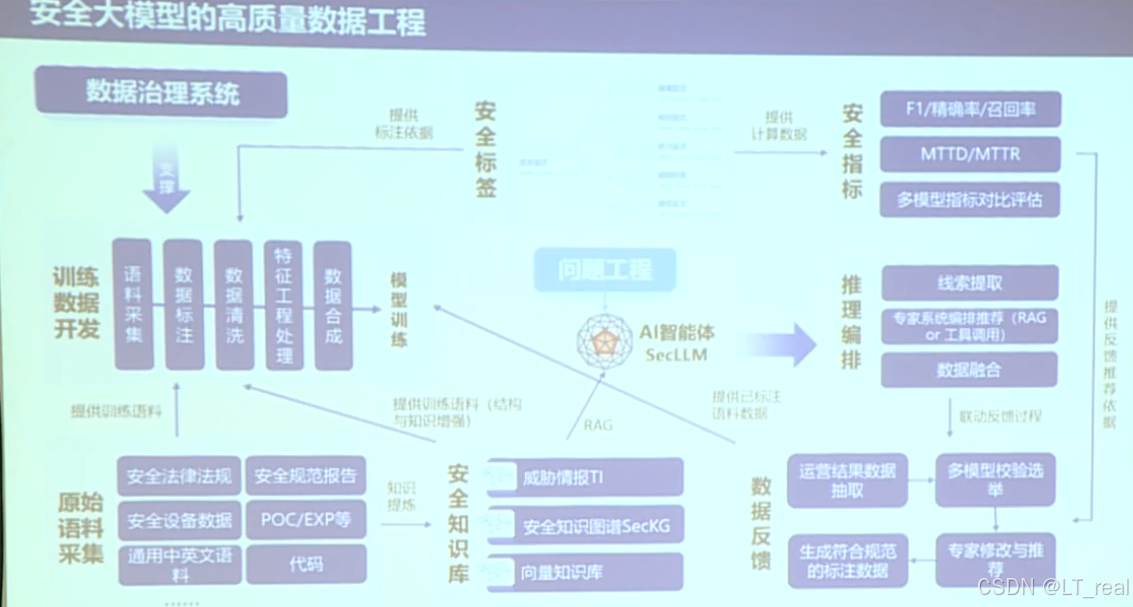

安全知识图谱积累数据多,对训练大模型、构建思维链、设计下游任务有很大帮助,实际运行中反馈,有对应标签矫正,从而更新训练数据

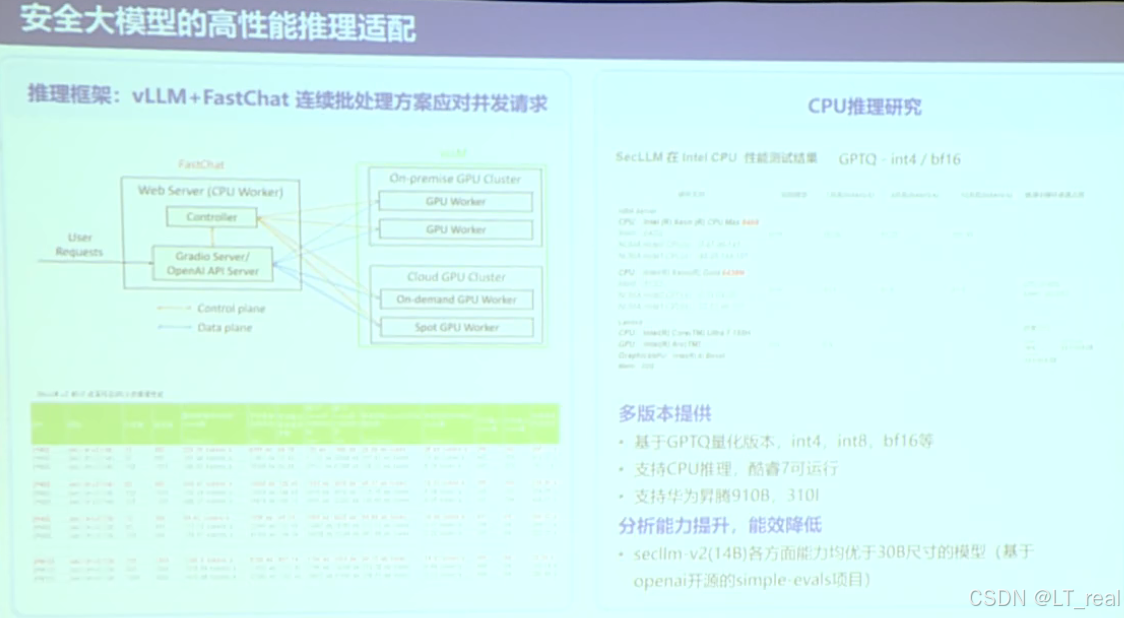

降低训练成本,优化推理能力,在配置低的机器仍能保证工作

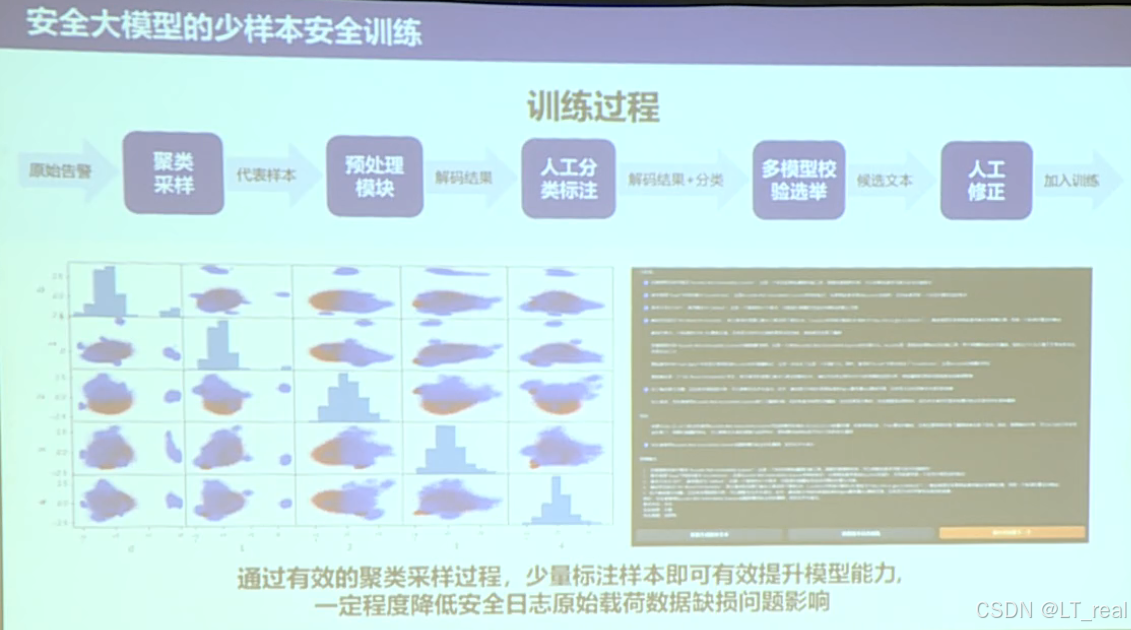

在数据不够的情况下,利用少样本训练高质量模型

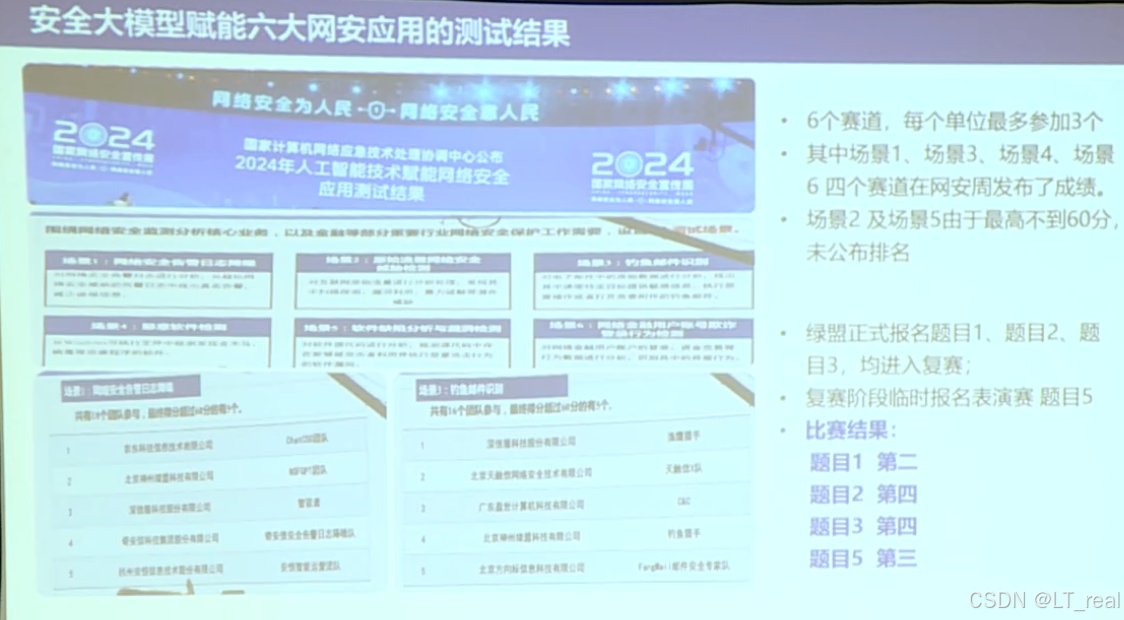

安全运营应用情况

大模型结合传统方法

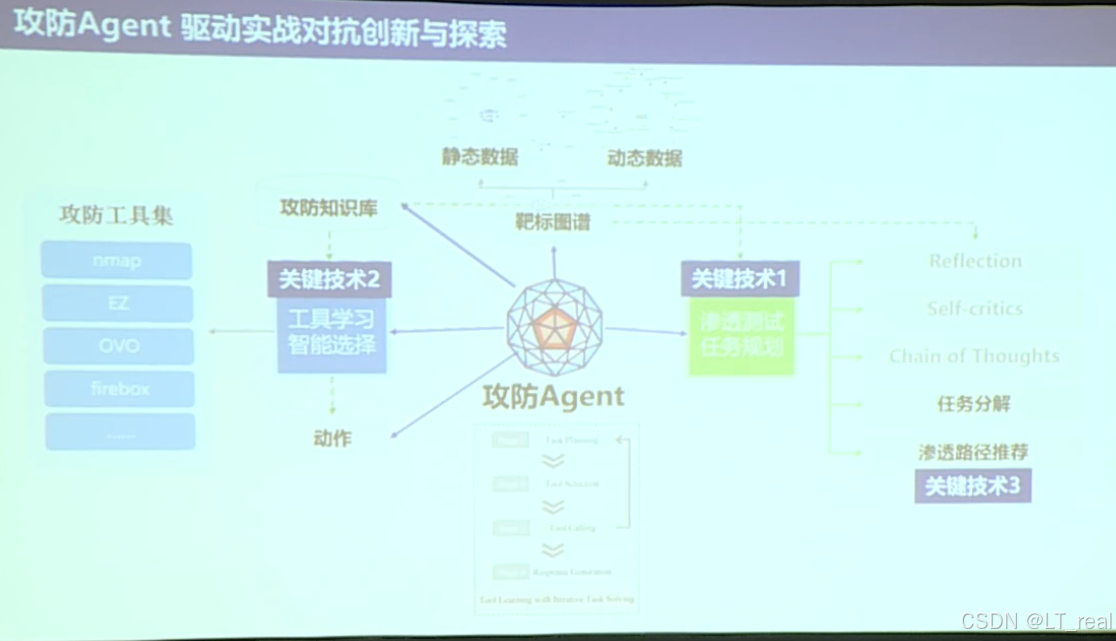

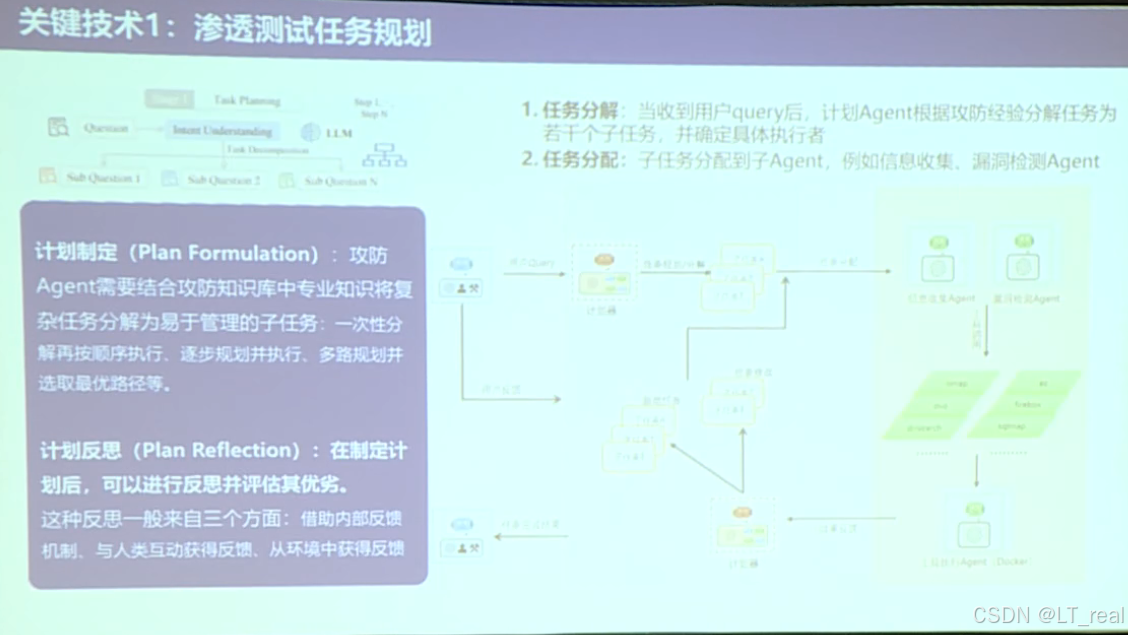

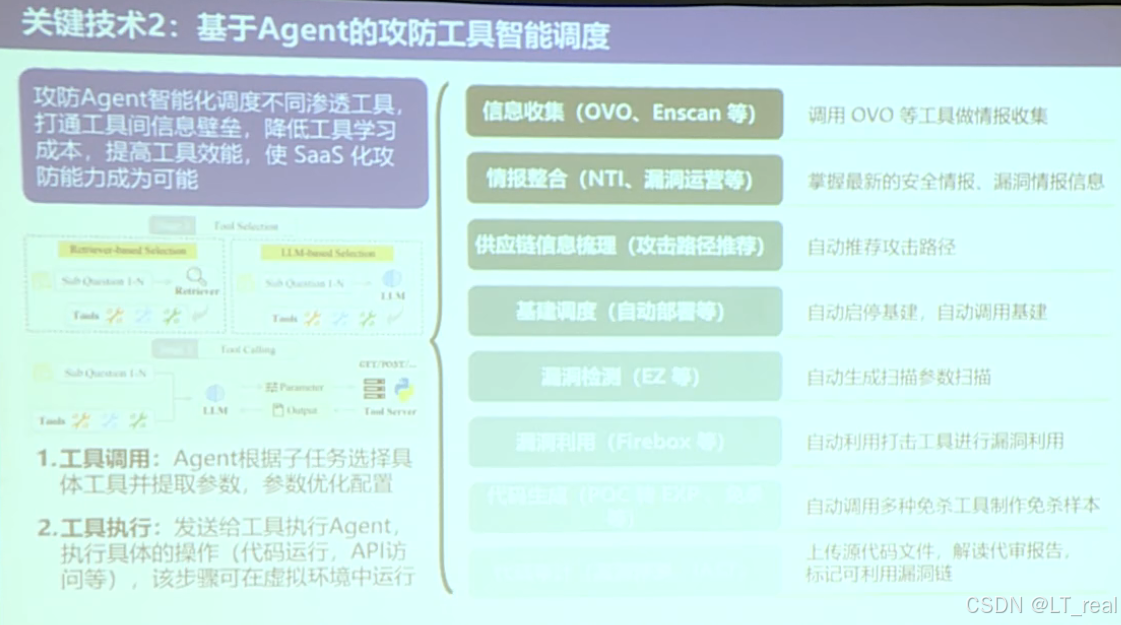

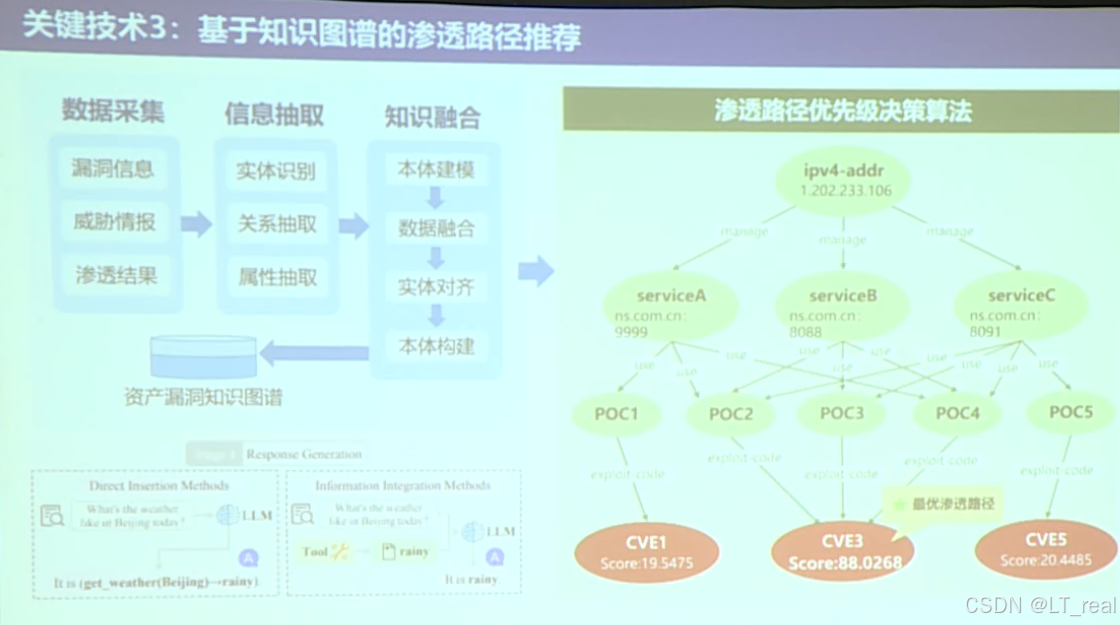

网络对抗应用情况

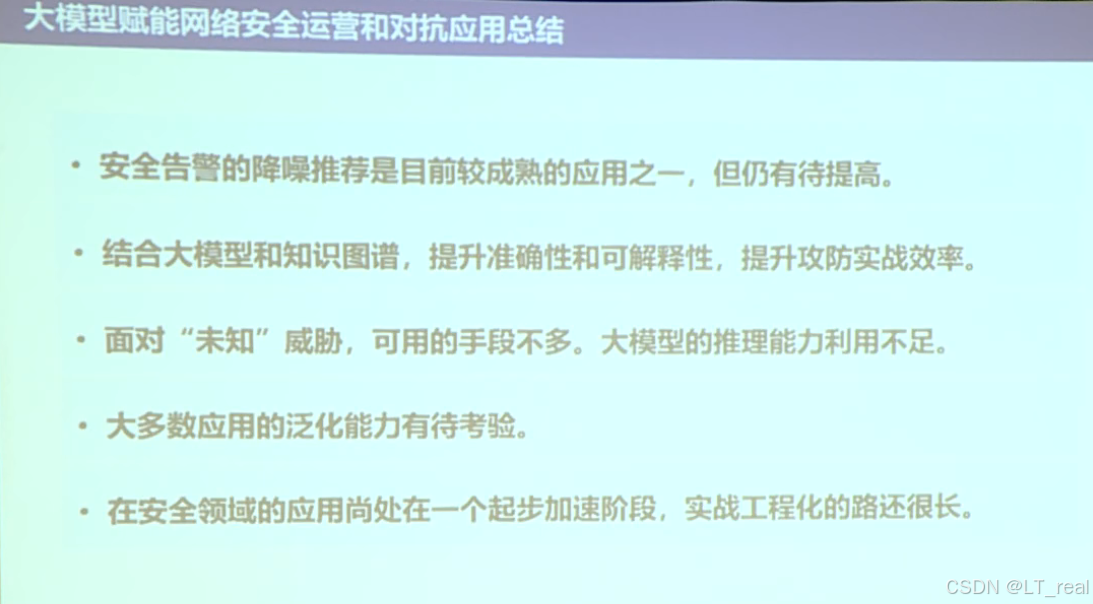

总结

在什么场景中可以做到什么事,但还是缺少标准测试集,所以不能下定论。

提问

1.基层网安薄弱,针对单兵设备的工作;大模型结合小模型,已经足够解决大部分问题。在能源行业有无相关实践案例?

主要应用在渗透测试,其他邻域还需探索。

2.大模型应用中,利用已训练的模型还是自己预训练的模型好?

实践角度来看,模型功能需要细分,还需进一步工作。

3.用大模型识别发现分析漏洞,那发现问题后,利用进行防御研究方向?可解释性工作的探索?

行业中已经有一定的未基于大模型的工作,目前利用大模型生成能力辅助,还需进一步研究。

4.实践中,大模型与小模型使用的选择趋向?

大模型的重要作用是综合判断,组织相关信息。目前方法对已知威胁检测能力是足够的,主要问题是选择太多,人手太少,大模型可以用于辅助选择处理流程以开展工作。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?