本地原来fastgpt为4.8.6版本,现更新到目前最新版本,有很多区别,这里加以记录:

1.更新

在原先的docker-compose文件中,修改fastgpt的image版本:

fastgpt:

container_name: fastgpt

# image: ghcr.io/labring/fastgpt:v4.8.6 # git

image: registry.cn-hangzhou.aliyuncs.com/fastgpt/fastgpt:v4.8.21-fix 在该文件目录中执行即可:

docker-compose pull

docker-compose up -d2.接入模型

2.1 embedding模型

由老版本更新过来,点击知识库会提示索引模型未部署,因为20后的版本将原先在config文件中接入模型的方式统一做到模型提供功能中,需要我们修改:

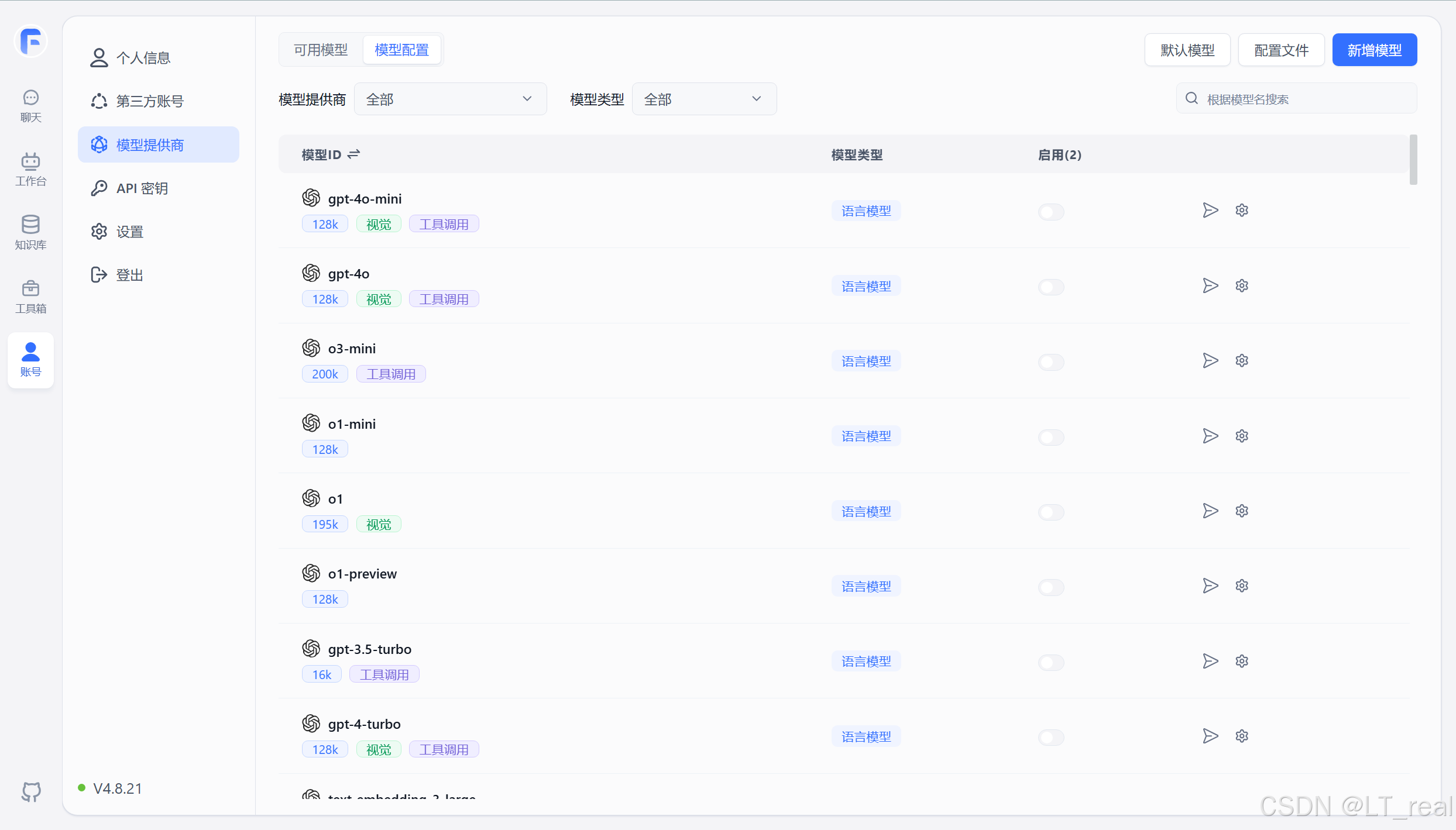

官方已经内置大量模型,我们只需在模型配置中寻找我们所需的模型,启动即可:

然鹅我们是本地化部署,这样操作只是提供了一个接口,并没有实际功能,我们需要本地部署对应模型,再接入,这里以m3e模型为例子:

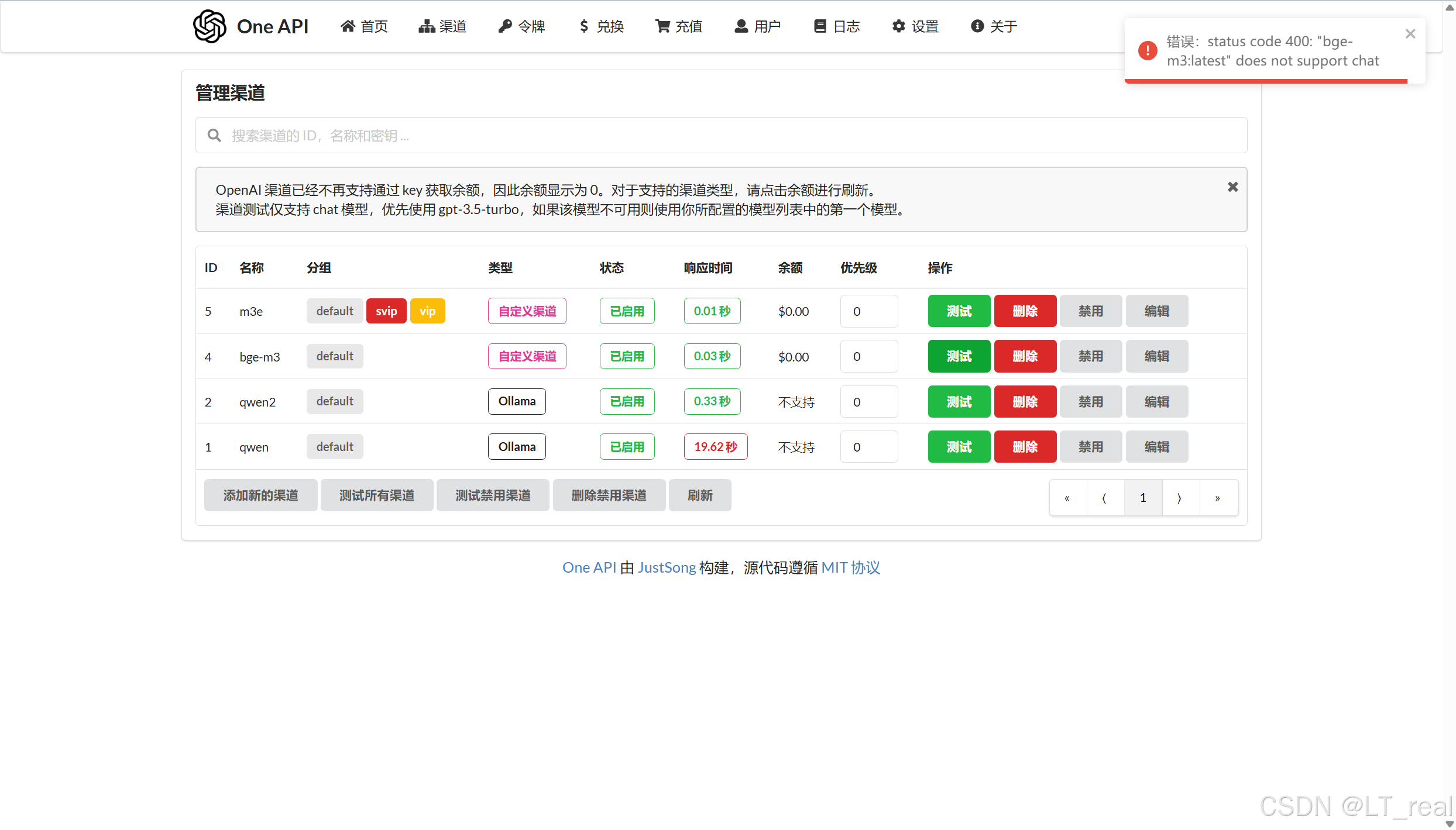

docker run -d -p 6008:6008 --gpus all --name m3e --network fastgpt_fastgpt stawky/m3e-large-api这里需要用到前面提到的docker内部网络名字,后续就可以用m3:6008来调用,在oneapi中填写如下,记得要填写密钥,测试显示如右上角即可:

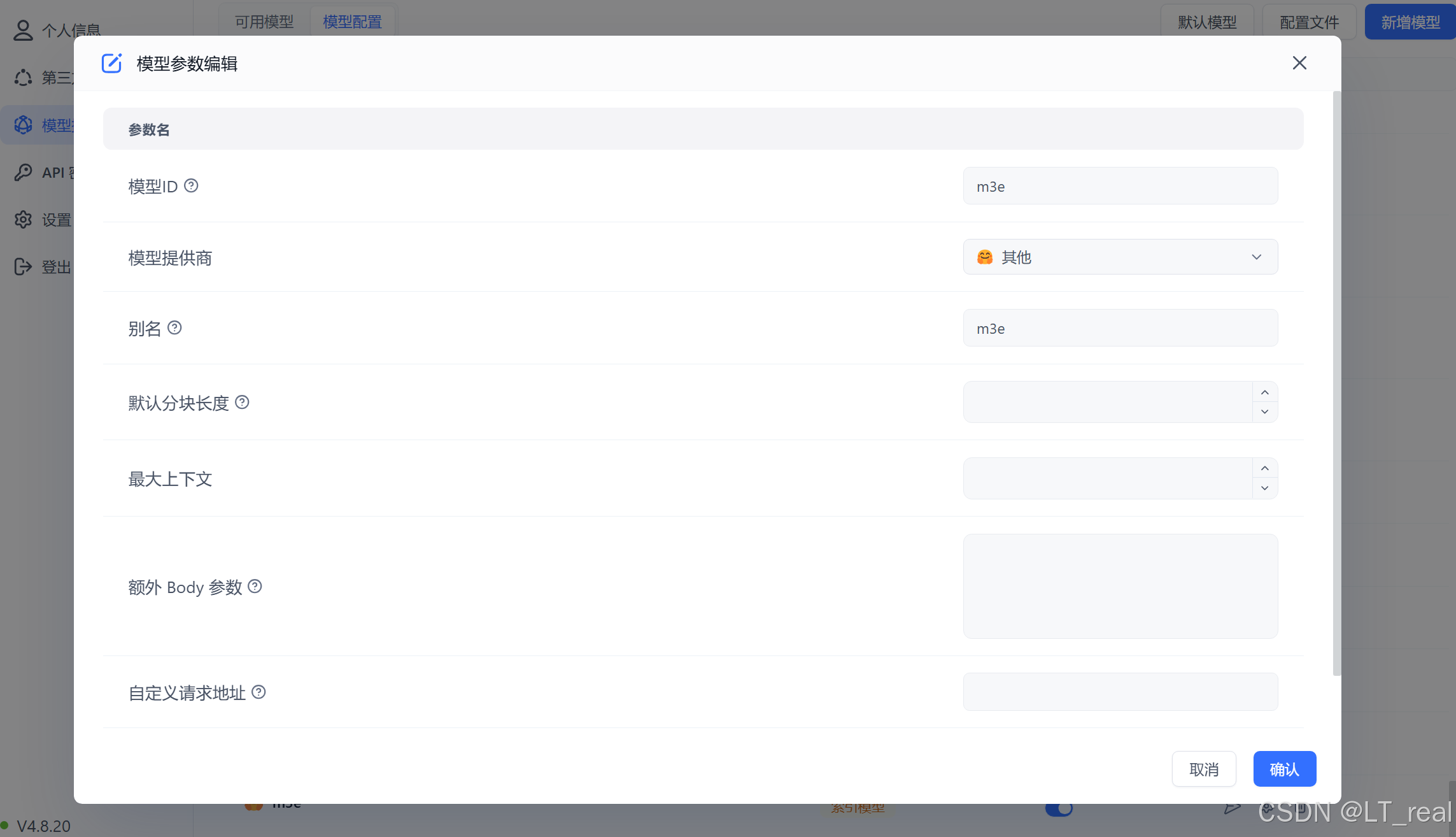

在fastgpt中点击新增模型-索引模型,如此填写即可:

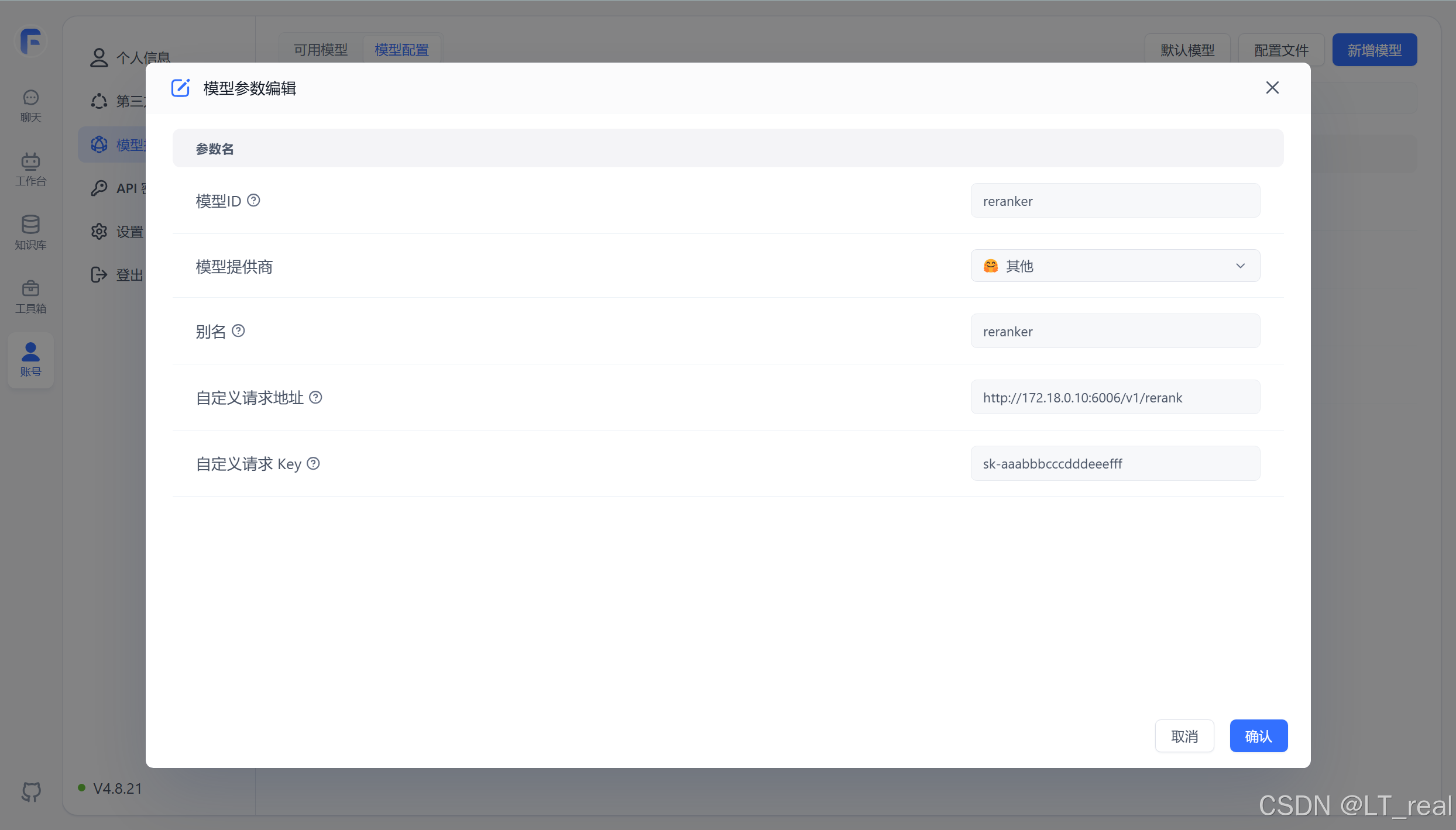

2.2 重排模型

同样,下载bge重排模型:(官方文档中是v0.1,这里需要改为v0.2

docker run -d --name reranker -p 6006:6006 -e ACCESS_TOKEN=sk-aaabbbcccdddeeefff --gpus all --network fastgpt_fastgpt registry.cn-hangzhou.aliyuncs.com/fastgpt/rerank:v0.2再去fastgpt的config文件中添加

"reRankModels": [

{

"model": "bge-reranker-base",

"name": "reranker",

"charsPointsPrice": 0,

"requestUrl": "https://172.18.0.10:6006/v1/rerank",

"requestAuth": "sk-aaabbbcccdddeeefff"

}

],记得在fastgpt设置界面填写key:

一般重排结果为True就说明成功了:(我电脑配置不够,运行很卡

错误方法小记录:

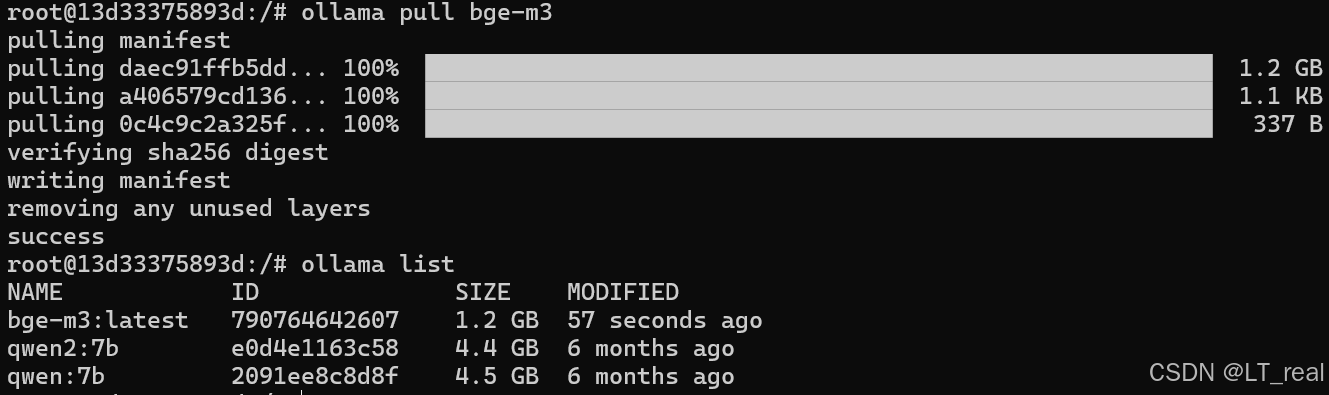

ollama+embedding模型的错误部署

再去oneapi中添加渠道,可以参考以前的操作,右上角这样一般就出错了:阿巴阿巴

参考:

使用docker-compose一键本地化部署fastgpt,并连接本地ollama部署的大模型_ollama docker-compose-CSDN博客

3773

3773

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?