一、导言:

Inception,又称GoogLeNet,不写为GoogleNet,是为了向Yann LeCuns设计的卷积网络先驱LeNet 5致敬。Inception是2014年由Christian Szegedy等人提出的一种全新的深度学习结构(Szegedy, Liu et al. 2015),获得2014年的 ILSVRC比赛冠军,后来又衍生出Inception v2(Ioffe and Szegedy 2015)、Inception v3(Szegedy, Vanhoucke et al. 2016)和Inception v4(Szegedy, Ioffe et al. 2017)等多个版本。

在Inception 出现之前,大部分流行CNN仅仅是把卷积层堆叠得越来越多,使网络越来越深,希望能够得到更好的性能。但层数的增加会带来很多负作用,比如过拟合、梯度消失、梯度爆炸等。

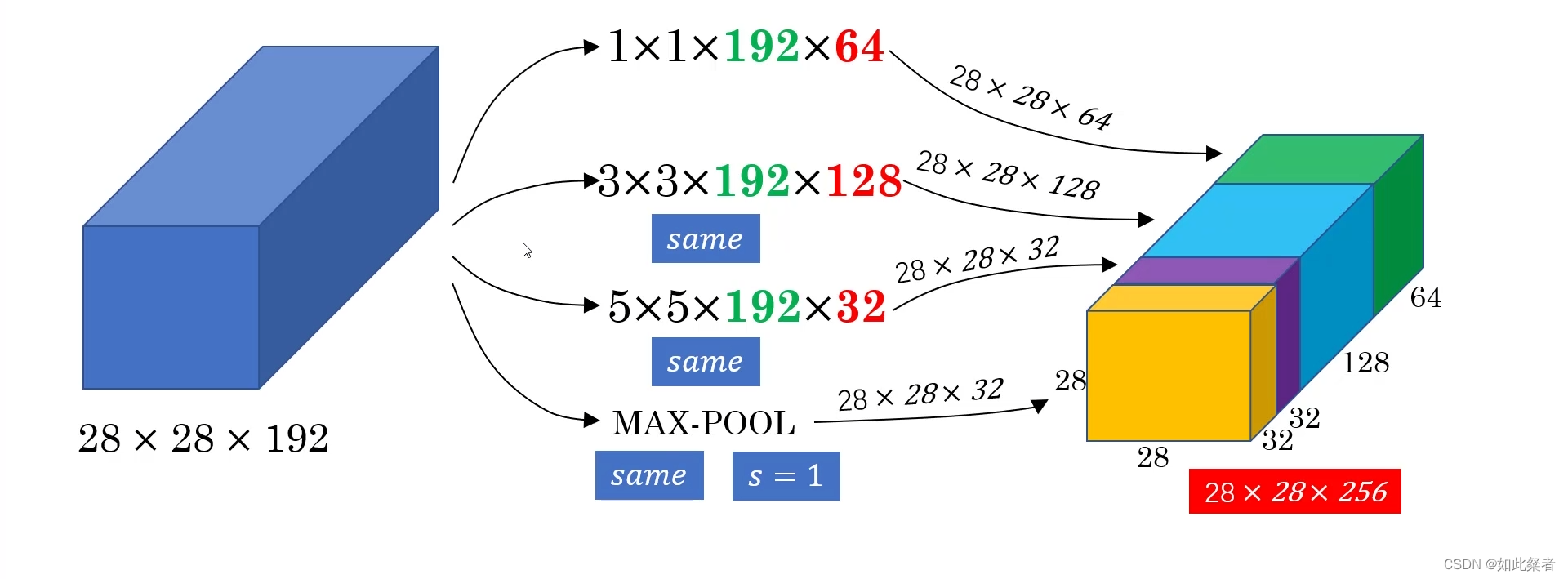

构建卷积网络时,往往需要决定如何配置参数,例如卷积核的尺寸、卷积核的个数、是否需要添加池化层等。Inception网络的优势是在同一层上并联多种卷积方法,当然这种并联结构也增加了复杂性。

二、讲解

有了Inception模块,你就可以输入某个量,因为它累加了所有数字,这里的最终输出为32+32+128+64=256。Inception模块的输入为28×28×192,输出为28×28×256。这就是Inception网络的核心内容。

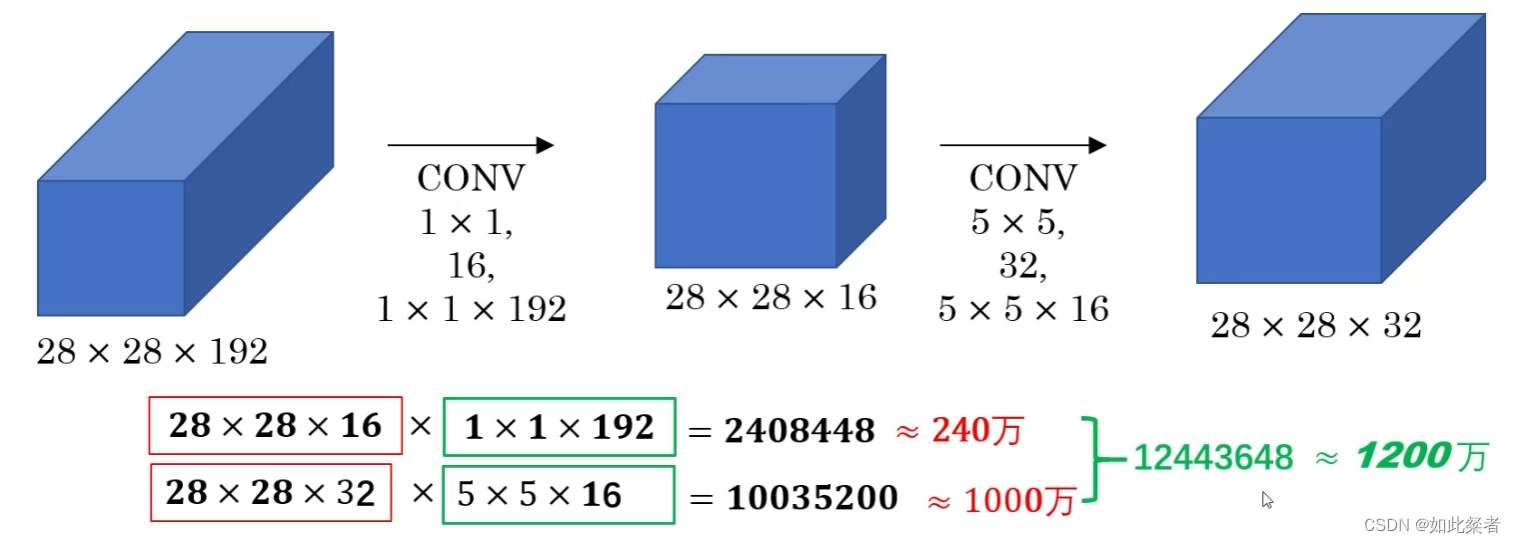

基本思想是Inception网络不需要人为决定使用哪个过滤器或者是否需要池化,而是由网络自行确定这些参数,你可以给网络添加这些参数的所有可能值,然后把这些输出连接起来,让网络自己学习它需要什么样的参数,采用哪些过滤器组合。这里所描述的Inception层有一个问题,就是计算成本。

我们可以通过1x1卷积降维来减少计算成本,计算量从1.2亿减小到原来的十分之一

Inception模块会将之前层的激活或者输出作为它的输入。inception卷积的基本结构:

下面是一张取自Szegety et al的论文中关于Inception网络的图片,你会发现图中有许多重复的模块,可能整张图看上去很复杂,但如果你只截取其中一个环节(如编号1),就会发现这就是上面讲的Inception模块。

我们深入看看里边的一些细节,编号2是另一个Inception模块,编号3也是一个Inception模块。这里有一些额外的最大池化层(编号6)来修改高和宽的维度。编号4是另外一个Inception模块,编号7是另外一个最大池化层,它改变了高和宽。而编号5又是另一个Inception模块。

所以Inception网络只是很多这些你学过的模块在不同的位置重复组成的网络,所以如果你理解了之前所学的Inception模块,你就也能理解Inception网络。

事实上,如果你读过论文的原文,你就会发现,这里其实还有一些分支,这些分支有什么用呢?在网络的最后几层,通常称为全连接层,在它之后是一个softmax层(编号1)来做出预测,这些分支(编号2)所做的就是通过隐藏层(编号3)来做出预测,所以这其实是一个softmax输出(编号2),编号1也是。这是另一条分支(编号4),它也包含了一个隐藏层,通过一些全连接层,然后有一个softmax来预测,输出结果的标签。

你应该把它看做Inception网络的一个细节,它确保了即便是隐藏单元和中间层(编号5)也参与了特征计算,它们也能预测图片的分类。它在Inception网络中,起到一种调整的效果,并且能防止网络发生过拟合。

参考:

4644

4644

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?