一、使用Excel实现

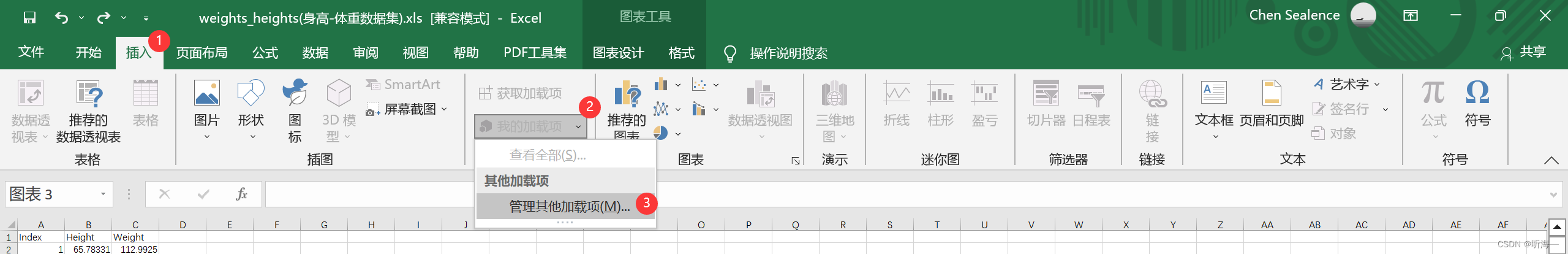

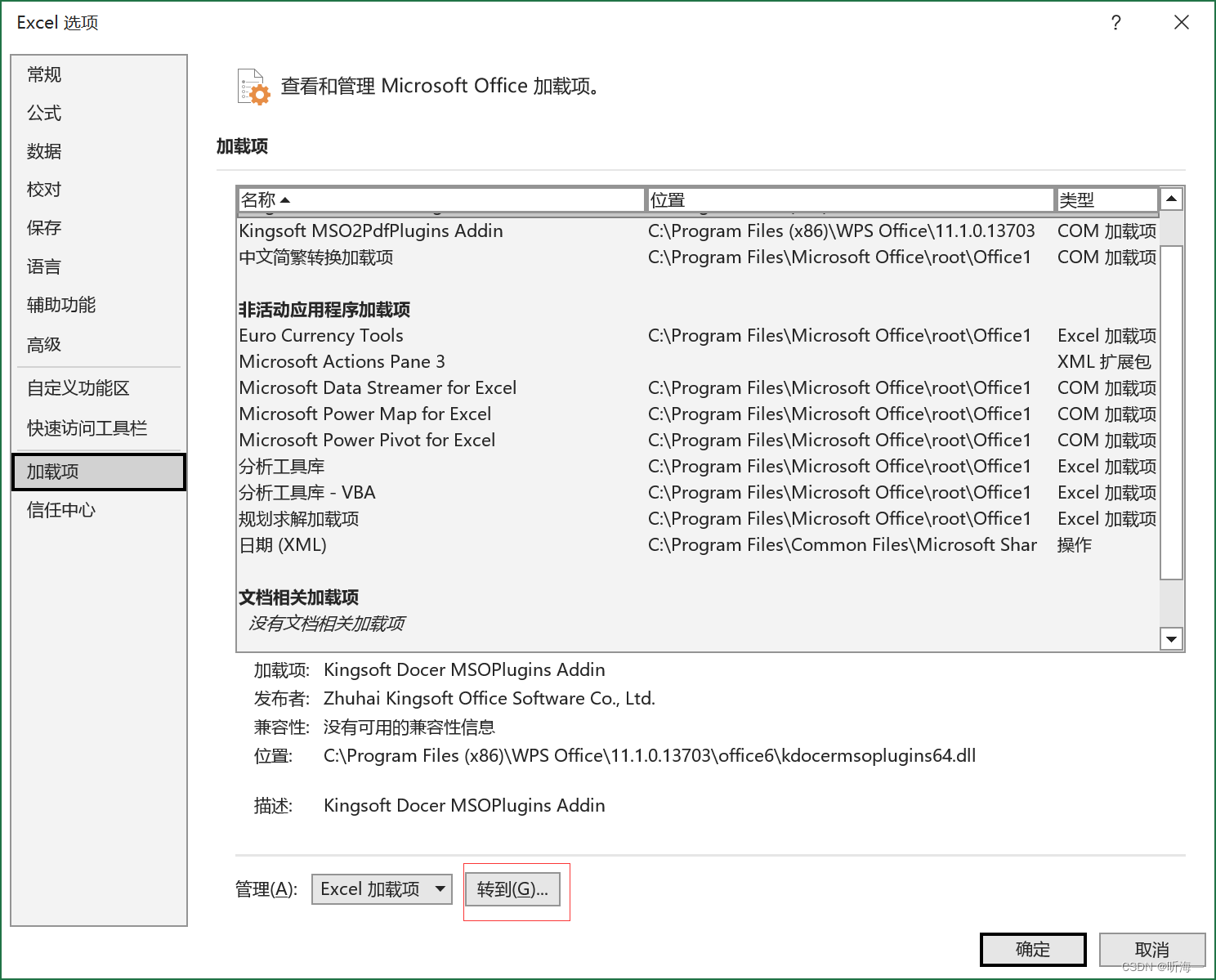

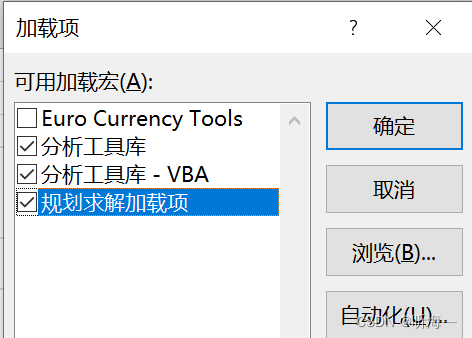

1. 添加工具

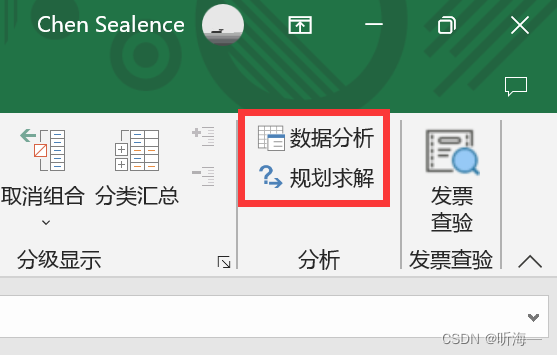

成功后此处会多出两个选项。

2. 模型测算

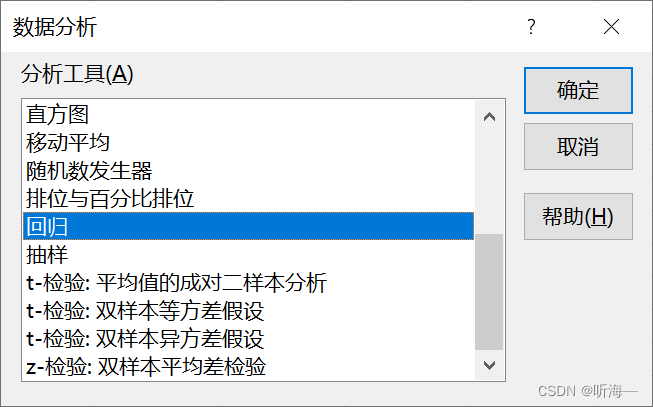

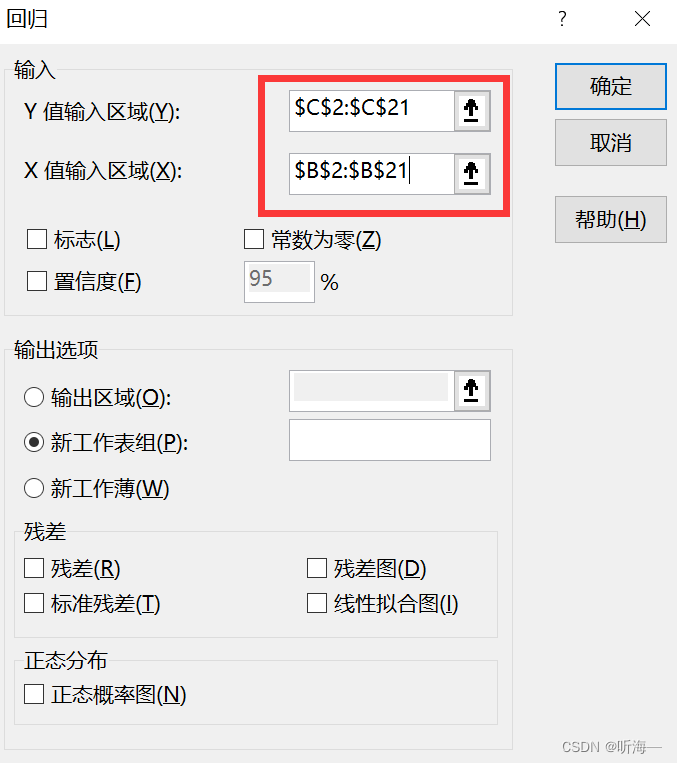

打开weights_heights(身高-体重数据集).xsl,菜单选择数据->数据分析->回归->确定:

$C

2

:

2:

2:C$21

$B

2

:

2:

2:B$21

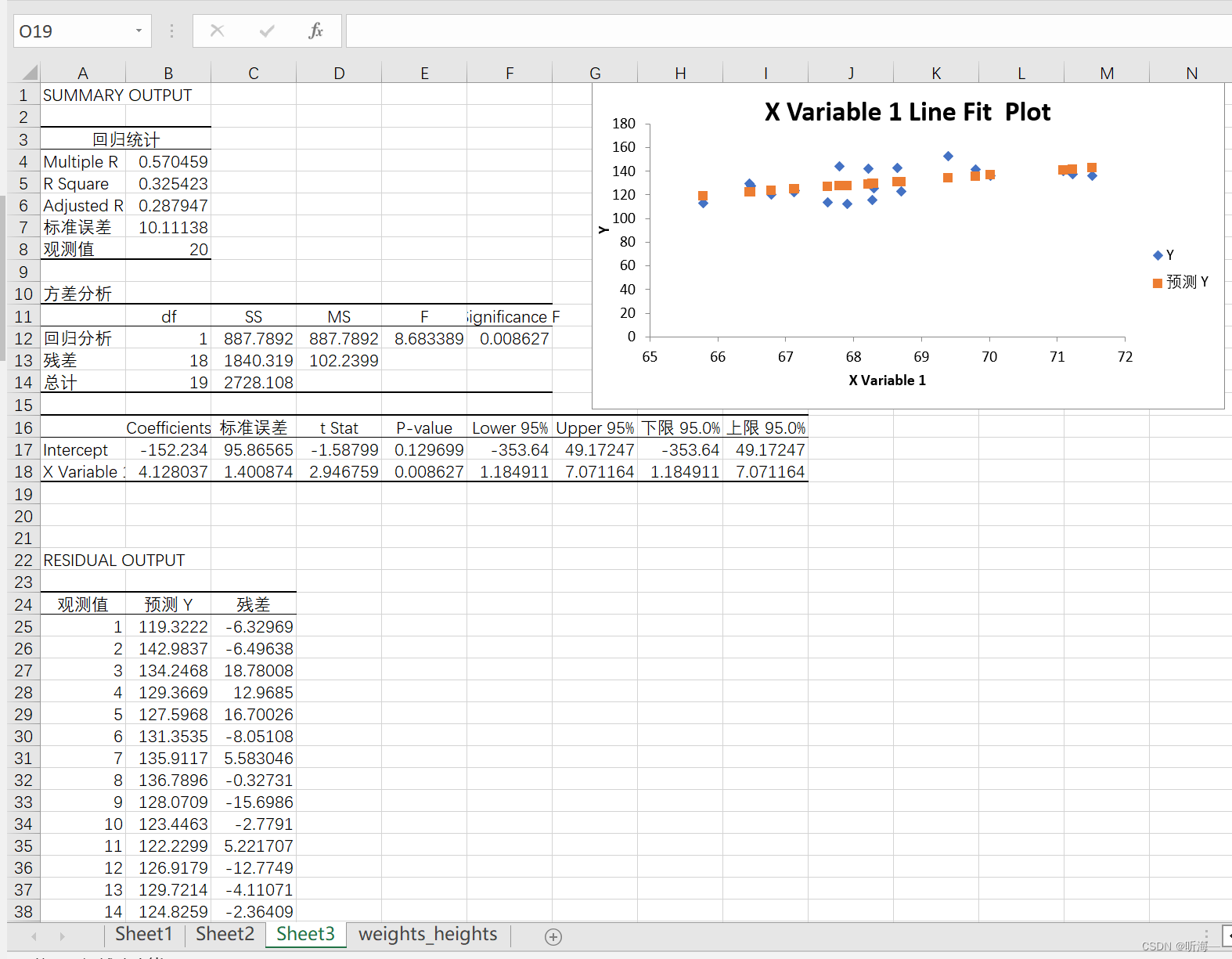

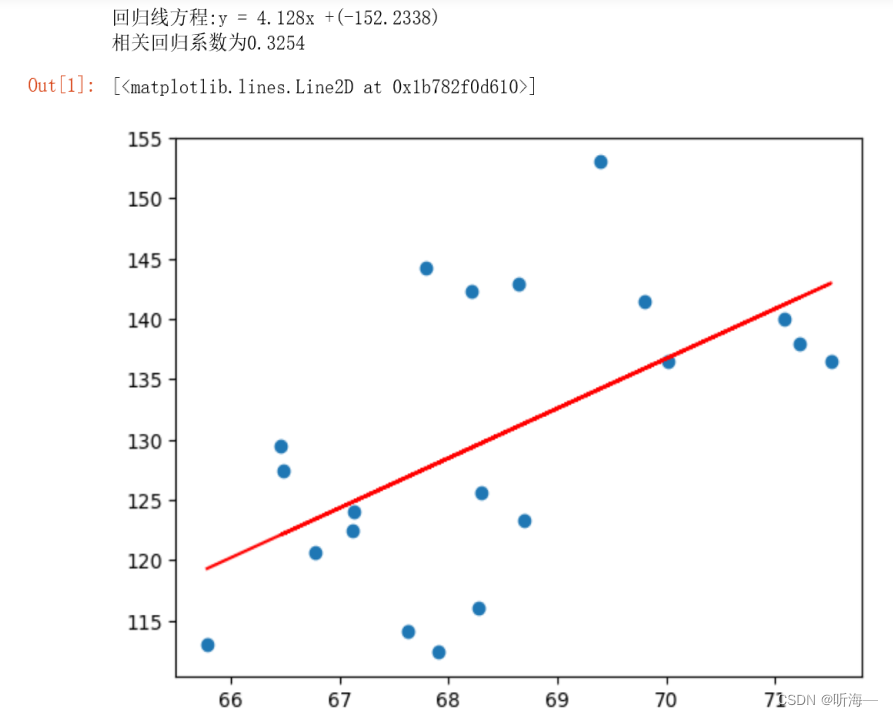

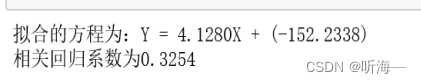

线性回归方程:y=4.128x-152.23

相关系数:R^2=0.3254

20组数据

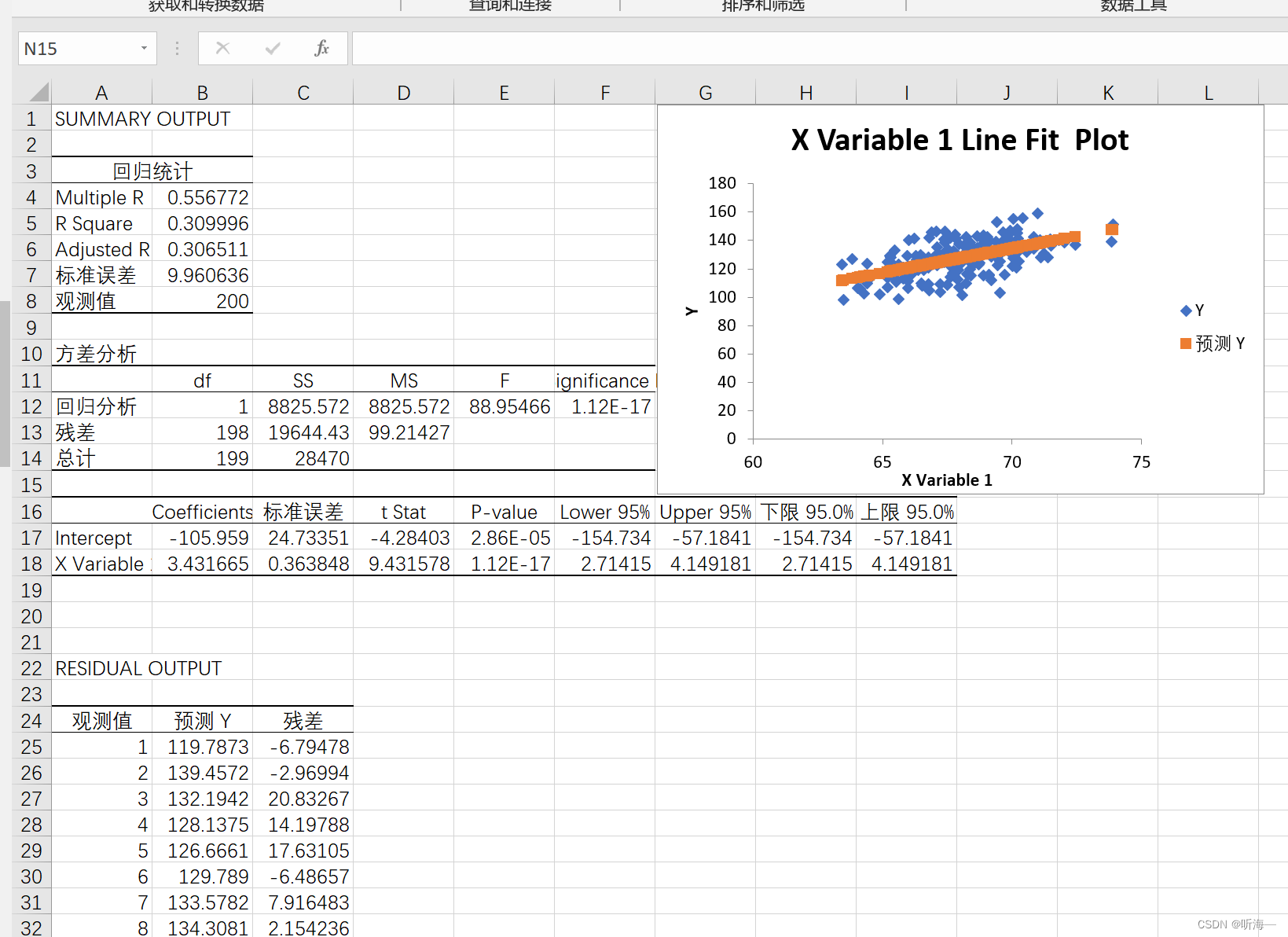

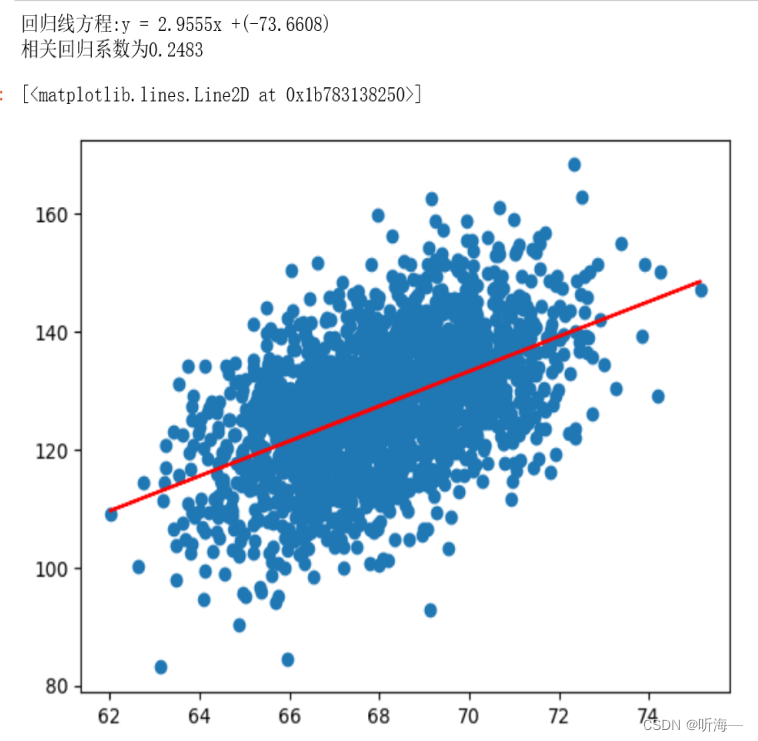

200组数据

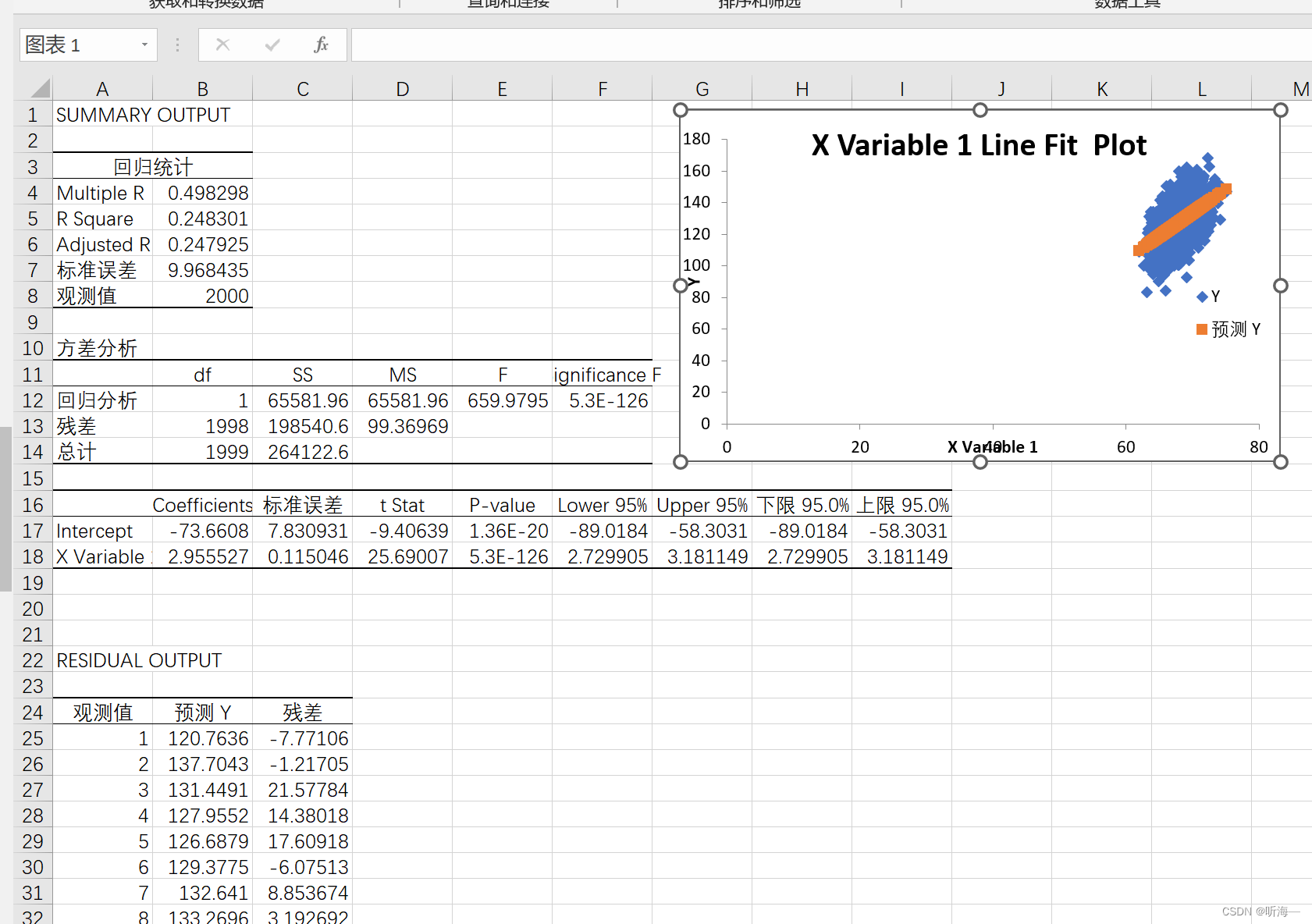

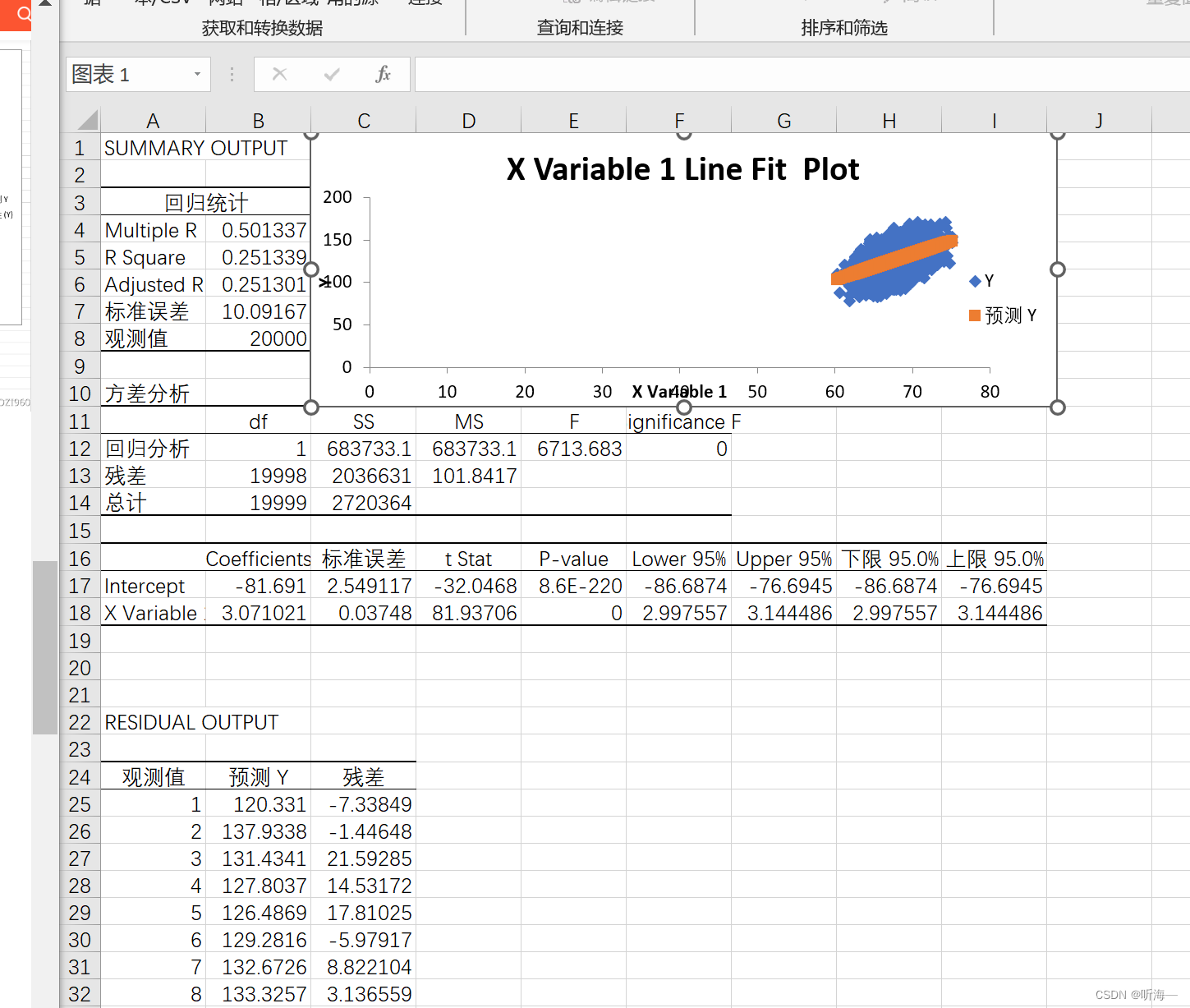

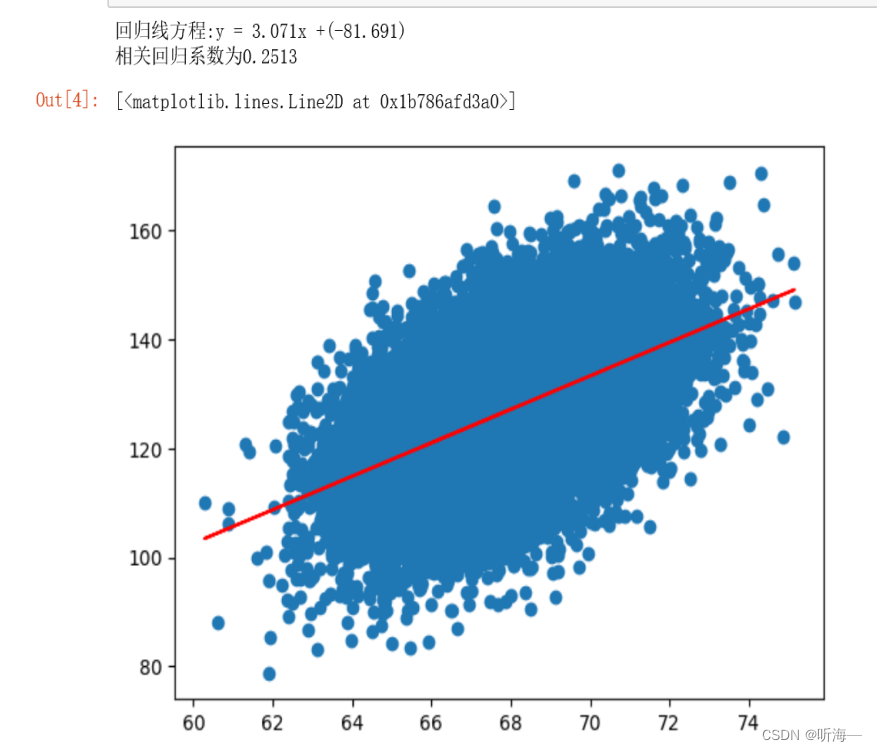

2000组数据

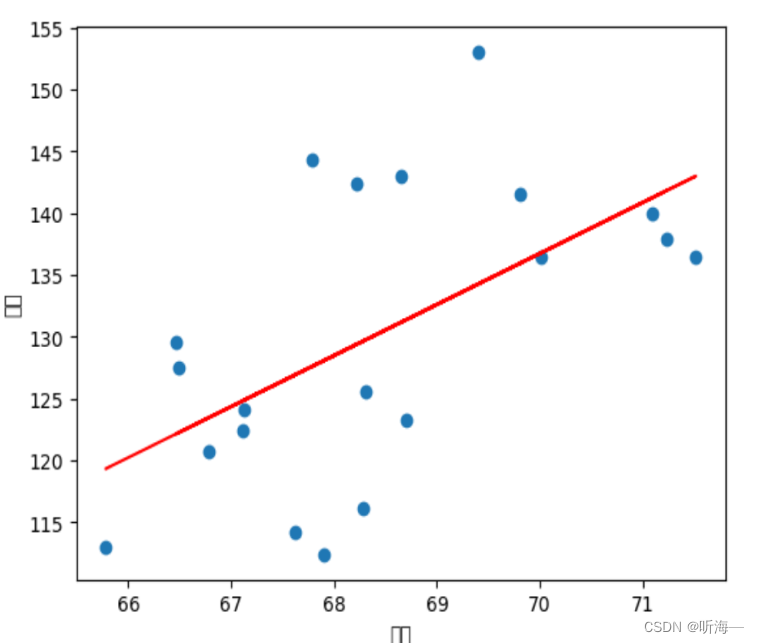

20000组数据

二、使用jupyter实现

1. 最小二乘法

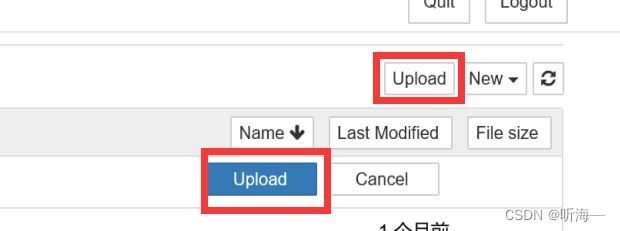

添加数据文件

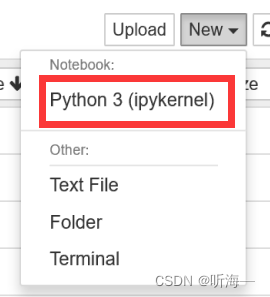

新建一个python文件:

20组数据:

import pandas as pd

import numpy as np

import math

#准备数据

p=pd.read_excel('weights_heights(身高-体重数据集).xls','weights_heights')

#读取20行数据

p1=p.head(20)

x=p1["Height"]

y=p1["Weight"]

# 平均值

x_mean = np.mean(x)

y_mean = np.mean(y)

#x(或y)列的总数(即n)

xsize = x.size

zi=((x-x_mean)*(y-y_mean)).sum()

mu=((x-x_mean)*(x-x_mean)).sum()

n=((y-y_mean)*(y-y_mean)).sum()

# 参数a b

a = zi / mu

b = y_mean - a * x_mean

#相关系数R的平方

m=((zi/math.sqrt(mu*n))**2)

# 这里对参数保留4位有效数字

a = np.around(a,decimals=4)

b = np.around(b,decimals=4)

m = np.around(m,decimals=4)

print(f'回归线方程:y = {a}x +({b})')

print(f'相关回归系数为{m}')

#借助第三方库skleran画出拟合曲线

y1 = a*x + b

plt.scatter(x,y)

plt.plot(x,y1,c='r')

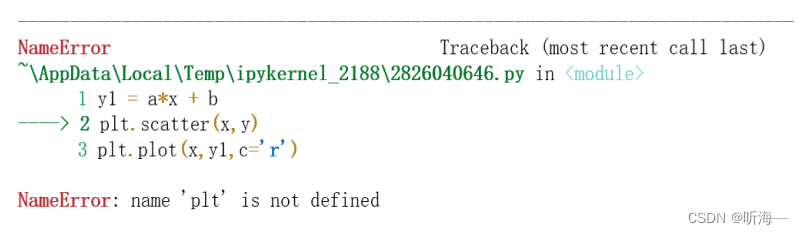

注意:如果你没有导入pyplot,将会得到以下界面:

添加:

// 导入pyplot并将其命名为plt

import matplotlib.pyplot as plt;

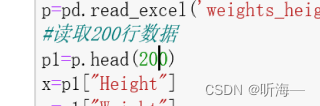

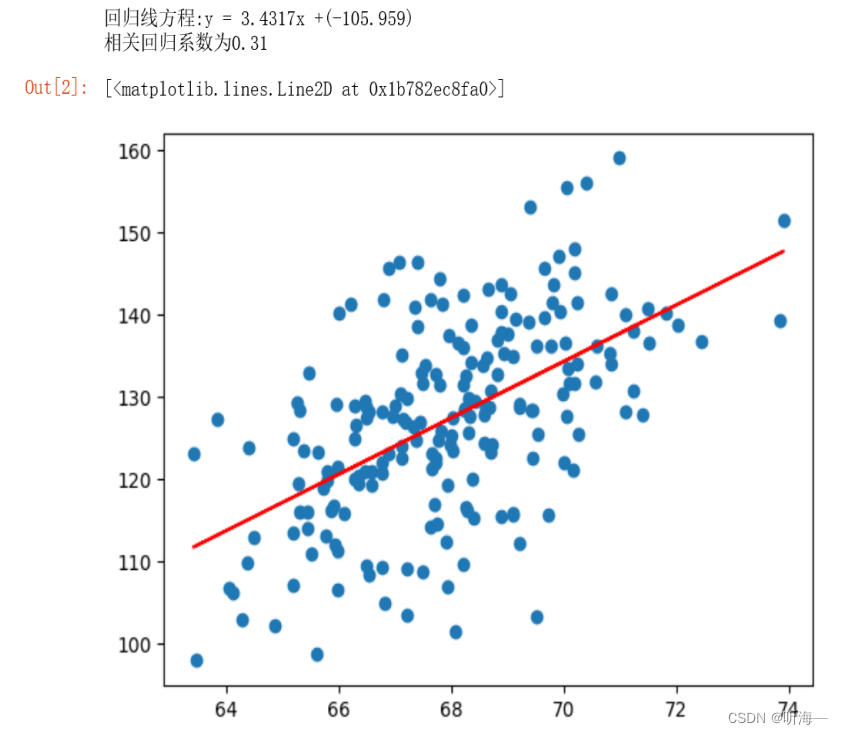

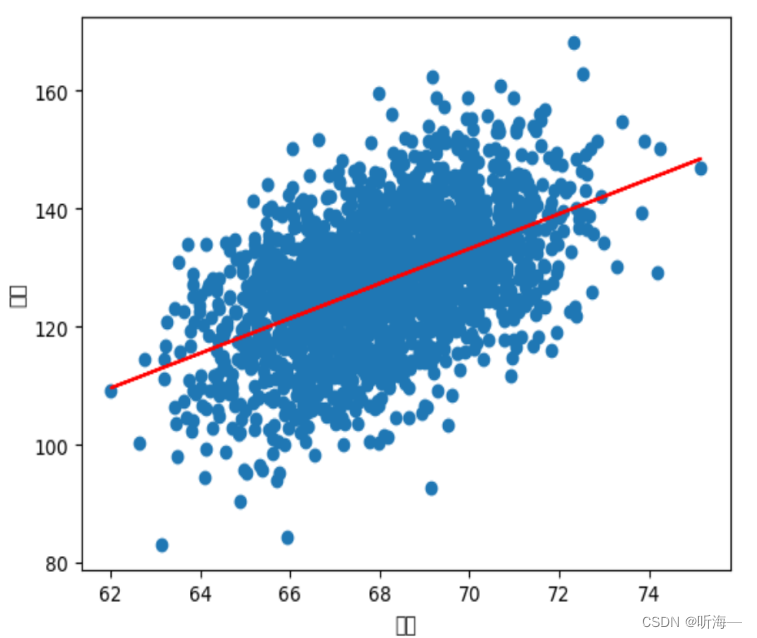

200组数据

修改此处:

2000行数据

20000行数据

2. 使用skeran库

# 导入所需的模块

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

from sklearn.linear_model import LinearRegression

p=pd.read_excel('weights_heights(身高-体重数据集).xls','weights_heights')

#读取数据行数

p1=p.head(20)

x=p1["Height"]

y=p1["Weight"]

# 数据处理

# sklearn 拟合输入输出一般都是二维数组,这里将一维转换为二维。

y = np.array(y).reshape(-1, 1)

x = np.array(x).reshape(-1, 1)

# 拟合

reg = LinearRegression()

reg.fit(x,y)

a = reg.coef_[0][0] # 系数

b = reg.intercept_[0] # 截距

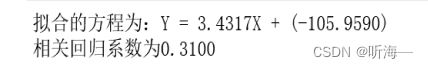

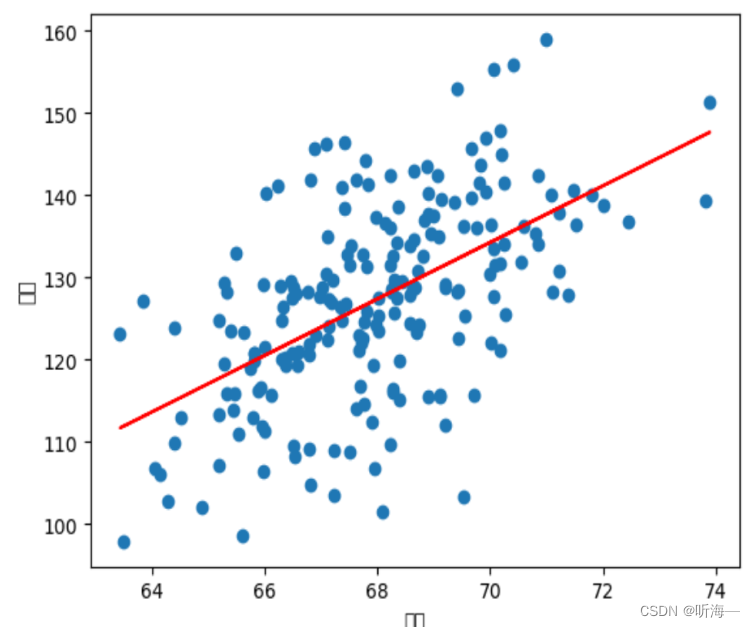

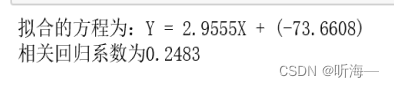

print('拟合的方程为:Y = %.4fX + (%.4f)' % (a, b))

c=reg.score(x,y) # 相关系数

print(f'相关回归系数为%.4f'%c)

# 可视化

prediction = reg.predict(y) # 根据高度,按照拟合的曲线预测温度值

plt.xlabel('身高')

plt.ylabel('体重')

plt.scatter(x,y)

y1 = a*x + b

plt.plot(x,y1,c='r')

20组数据

200组数据

修改此处:

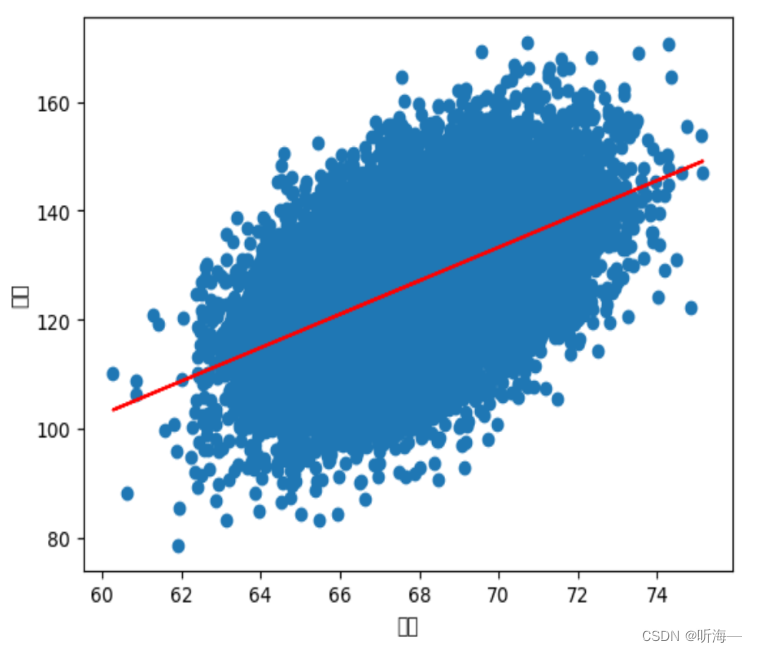

2000组数据

20000组数据

—

总结

一个简单的小实验,却让我见识到了excel和python的强大之处,我增加了对excel工具和python的熟练度。即使会熟练使用强大的工具,我们仍不能忽略,这么做最基本的原理——最小二乘法,才能锻炼自己的思维能力。

608

608

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?