一、决策树

优点:

1.决策树易于理解和实现,人们在在学习过程中不需要使用者了解很多的背景知识,这同时是它的能够直接体现数据的特点,只要通过解释后都有能力去理解决策树所表达的意义。

2.对于决策树,数据的准备往往是简单或者是不必要的,而且能够同时处理数据型和常规型属性,在相对短的时间内能够对大型数据源做出可行且效果良好的结果。

3.易于通过静态测试来对模型进行评测,可以测定模型可信度;如果给定一个观察的模型,那么根据所产生的决策树很容易推出相应的逻辑表达式。

缺点:

1.对连续性的字段比较难预测。

2.对有时间顺序的数据,需要很多预处理的工作。

3.当类别太多时,错误可能就会增加的比较快。

4.一般的算法分类的时候,只是根据一个字段来分类。

二 、ID3算法

(一)特征选择

特征选择也即选择最优划分属性,从当前数据的特征中选择一个特征作为当前节点的划分标准。 随着划分过程不断进行,希望决策树的分支节点所包含的样本尽可能属于同一类别,即节点的“纯度”越来越高。

(二)熵(entropy)

熵表示事务不确定性的程度,也就是信息量的大小(一般说信息量大,就是指这个时候背后的不确定因素太多),熵的公式如下:

其中,![]() 是分类 出现的概率,n是分类的数目。可以看出,熵的大小只和变量的概率分布有关。

是分类 出现的概率,n是分类的数目。可以看出,熵的大小只和变量的概率分布有关。

对于在X的条件下Y的条件熵,是指在X的信息之后,Y这个变量的信息量(不确定性)的大小,计算公式如下:

所以当Entropy最大为1的时候,是分类效果最差的状态,当它最小为0的时候,是完全分类的状态。因为熵等于零是理想状态,一般实际情况下,熵介于0和1之间 。

熵的不断最小化,实际上就是提高分类正确率的过程。

(四)信息增益(information gain)

信息增益:在划分数据集之前之后信息发生的变化,计算每个特征值划分数据集获得的信息增益,获得信息增益最高的特征就是最好的选择。

定义属性A对数据集D的信息增益为infoGain(D|A),它等于D本身的熵,减去 给定A的条件下D的条件熵,即

信息增益的意义:引入属性A后,原来数据集D的不确定性减少了多少。

计算每个属性引入后的信息增益,选择给D带来的信息增益最大的属性,即为最优划分属性。一般,信息增益越大,则意味着使用属性A来进行划分所得到的的“纯度提升”越大。

(五)步骤

- 从根节点开始,计算所有可能的特征的信息增益,选择信息增益最大的特征作为节点的划分特征;

- 由该特征的不同取值建立子节点;

- 再对子节点递归1-2步,构建决策树;

- 直到没有特征可以选择或类别完全相同为止,得到最终的决策树。

(六)代码实现

为使用sklearn

1.数据

2.导入包

import numpy as np

import pandas as pd

import math

import collections

3.导入数据4

def import_data():

data = pd.read_csv('路径')

data.head(10)

data=np.array(data).tolist()

# 特征值列表

labels = ['色泽', '根蒂', '敲击', '纹理', '脐部', '触感']

# 特征对应的所有可能的情况

labels_full = {}

for i in range(len(labels)):

labelList = [example[i] for example in data]

uniqueLabel = set(labelList)

labels_full[labels[i]] = uniqueLabel

return data,labels,labels_full

4.调用函数获取数据

data,labels,labels_full=import_data()

5.计算初始的信息熵

def calcShannonEnt(dataSet):

"""

计算给定数据集的信息熵(香农熵)

:param dataSet:

:return:

"""

# 计算出数据集的总数

numEntries = len(dataSet)

# 用来统计标签

labelCounts = collections.defaultdict(int)

# 循环整个数据集,得到数据的分类标签

for featVec in dataSet:

# 得到当前的标签

currentLabel = featVec[-1]

# # 如果当前的标签不再标签集中,就添加进去(书中的写法)

# if currentLabel not in labelCounts.keys():

# labelCounts[currentLabel] = 0

#

# # 标签集中的对应标签数目加一

# labelCounts[currentLabel] += 1

# 也可以写成如下

labelCounts[currentLabel] += 1

# 默认的信息熵

shannonEnt = 0.0

for key in labelCounts:

# 计算出当前分类标签占总标签的比例数

prob = float(labelCounts[key]) / numEntries

# 以2为底求对数

shannonEnt -= prob * math.log2(prob)

return shannonEnt

6.查看初始信息熵

print(calcShannonEnt(data)) # 输出为:0.9975025463691153

7.获取每个特征值的数量,这是为后面计算信息增益做准备8

def splitDataSet(dataSet, axis, value):

"""

按照给定的特征值,将数据集划分

:param dataSet: 数据集

:param axis: 给定特征值的坐标

:param value: 给定特征值满足的条件,只有给定特征值等于这个value的时候才会返回

:return:

"""

# 创建一个新的列表,防止对原来的列表进行修改

retDataSet = []

# 遍历整个数据集

for featVec in dataSet:

# 如果给定特征值等于想要的特征值

if featVec[axis] == value:

# 将该特征值前面的内容保存起来

reducedFeatVec = featVec[:axis]

# 将该特征值后面的内容保存起来,所以将给定特征值给去掉了

reducedFeatVec.extend(featVec[axis + 1:])

# 添加到返回列表中

retDataSet.append(reducedFeatVec)

return retDataSet

8.计算信息增益来确定最好的数据集划分

def chooseBestFeatureToSplit(dataSet, labels):

"""

选择最好的数据集划分特征,根据信息增益值来计算

:param dataSet:

:return:

"""

# 得到数据的特征值总数

numFeatures = len(dataSet[0]) - 1

# 计算出基础信息熵

baseEntropy = calcShannonEnt(dataSet)

# 基础信息增益为0.0

bestInfoGain = 0.0

# 最好的特征值

bestFeature = -1

# 对每个特征值进行求信息熵

for i in range(numFeatures):

# 得到数据集中所有的当前特征值列表

featList = [example[i] for example in dataSet]

# 将当前特征唯一化,也就是说当前特征值中共有多少种

uniqueVals = set(featList)

# 新的熵,代表当前特征值的熵

newEntropy = 0.0

# 遍历现在有的特征的可能性

for value in uniqueVals:

# 在全部数据集的当前特征位置上,找到该特征值等于当前值的集合

subDataSet = splitDataSet(dataSet=dataSet, axis=i, value=value)

# 计算出权重

prob = len(subDataSet) / float(len(dataSet))

# 计算出当前特征值的熵

newEntropy += prob * calcShannonEnt(subDataSet)

# 计算出“信息增益”

infoGain = baseEntropy - newEntropy

#print('当前特征值为:' + labels[i] + ',对应的信息增益值为:' + str(infoGain)+"i等于"+str(i))

#如果当前的信息增益比原来的大

if infoGain > bestInfoGain:

# 最好的信息增益

bestInfoGain = infoGain

# 新的最好的用来划分的特征值

bestFeature = i

#print('信息增益最大的特征为:' + labels[bestFeature])

return bestFeature

9.判断各个样本集的各个属性是否一致

def judgeEqualLabels(dataSet):

"""

判断数据集的各个属性集是否完全一致

:param dataSet:

:return:

"""

# 计算出样本集中共有多少个属性,最后一个为类别

feature_leng = len(dataSet[0]) - 1

# 计算出共有多少个数据

data_leng = len(dataSet)

# 标记每个属性中第一个属性值是什么

first_feature = ''

# 各个属性集是否完全一致

is_equal = True

# 遍历全部属性

for i in range(feature_leng):

# 得到第一个样本的第i个属性

first_feature = dataSet[0][i]

# 与样本集中所有的数据进行对比,看看在该属性上是否都一致

for _ in range(1, data_leng):

# 如果发现不相等的,则直接返回False

if first_feature != dataSet[_][i]:

return False

return is_equal

10.绘制决策树,并打印

def createTree(dataSet, labels):

"""

创建决策树

:param dataSet: 数据集

:param labels: 特征标签

:return:

"""

# 拿到所有数据集的分类标签

classList = [example[-1] for example in dataSet]

# 统计第一个标签出现的次数,与总标签个数比较,如果相等则说明当前列表中全部都是一种标签,此时停止划分

if classList.count(classList[0]) == len(classList):

return classList[0]

# 计算第一行有多少个数据,如果只有一个的话说明所有的特征属性都遍历完了,剩下的一个就是类别标签,或者所有的样本在全部属性上都一致

if len(dataSet[0]) == 1 or judgeEqualLabels(dataSet):

# 返回剩下标签中出现次数较多的那个

return majorityCnt(classList)

# 选择最好的划分特征,得到该特征的下标

bestFeat = chooseBestFeatureToSplit(dataSet=dataSet, labels=labels)

print(bestFeat)

# 得到最好特征的名称

bestFeatLabel = labels[bestFeat]

print(bestFeatLabel)

# 使用一个字典来存储树结构,分叉处为划分的特征名称

myTree = {bestFeatLabel: {}}

# 将本次划分的特征值从列表中删除掉

del(labels[bestFeat])

# 得到当前特征标签的所有可能值

featValues = [example[bestFeat] for example in dataSet]

# 唯一化,去掉重复的特征值

uniqueVals = set(featValues)

# 遍历所有的特征值

for value in uniqueVals:

# 得到剩下的特征标签

subLabels = labels[:]

subTree = createTree(splitDataSet(dataSet=dataSet, axis=bestFeat, value=value), subLabels)

# 递归调用,将数据集中该特征等于当前特征值的所有数据划分到当前节点下,递归调用时需要先将当前的特征去除掉

myTree[bestFeatLabel][value] = subTree

return myTree

mytree=createTree(data,labels)

print(mytree)

11.绘制可视化树

import matplotlib.pylab as plt

import matplotlib

# 能够显示中文

matplotlib.rcParams['font.sans-serif'] = ['SimHei']

matplotlib.rcParams['font.serif'] = ['SimHei']

# 分叉节点,也就是决策节点

decisionNode = dict(boxstyle="sawtooth", fc="0.8")

# 叶子节点

leafNode = dict(boxstyle="round4", fc="0.8")

# 箭头样式

arrow_args = dict(arrowstyle="<-")

def plotNode(nodeTxt, centerPt, parentPt, nodeType):

"""

绘制一个节点

:param nodeTxt: 描述该节点的文本信息

:param centerPt: 文本的坐标

:param parentPt: 点的坐标,这里也是指父节点的坐标

:param nodeType: 节点类型,分为叶子节点和决策节点

:return:

"""

createPlot.ax1.annotate(nodeTxt, xy=parentPt, xycoords='axes fraction',

xytext=centerPt, textcoords='axes fraction',

va="center", ha="center", bbox=nodeType, arrowprops=arrow_args)

def getNumLeafs(myTree):

"""

获取叶节点的数目

:param myTree:

:return:

"""

# 统计叶子节点的总数

numLeafs = 0

# 得到当前第一个key,也就是根节点

firstStr = list(myTree.keys())[0]

# 得到第一个key对应的内容

secondDict = myTree[firstStr]

# 递归遍历叶子节点

for key in secondDict.keys():

# 如果key对应的是一个字典,就递归调用

if type(secondDict[key]).__name__ == 'dict':

numLeafs += getNumLeafs(secondDict[key])

# 不是的话,说明此时是一个叶子节点

else:

numLeafs += 1

return numLeafs

def getTreeDepth(myTree):

"""

得到数的深度层数

:param myTree:

:return:

"""

# 用来保存最大层数

maxDepth = 0

# 得到根节点

firstStr = list(myTree.keys())[0]

# 得到key对应的内容

secondDic = myTree[firstStr]

# 遍历所有子节点

for key in secondDic.keys():

# 如果该节点是字典,就递归调用

if type(secondDic[key]).__name__ == 'dict':

# 子节点的深度加1

thisDepth = 1 + getTreeDepth(secondDic[key])

# 说明此时是叶子节点

else:

thisDepth = 1

# 替换最大层数

if thisDepth > maxDepth:

maxDepth = thisDepth

return maxDepth

def plotMidText(cntrPt, parentPt, txtString):

"""

计算出父节点和子节点的中间位置,填充信息

:param cntrPt: 子节点坐标

:param parentPt: 父节点坐标

:param txtString: 填充的文本信息

:return:

"""

# 计算x轴的中间位置

xMid = (parentPt[0]-cntrPt[0])/2.0 + cntrPt[0]

# 计算y轴的中间位置

yMid = (parentPt[1]-cntrPt[1])/2.0 + cntrPt[1]

# 进行绘制

createPlot.ax1.text(xMid, yMid, txtString)

def plotTree(myTree, parentPt, nodeTxt):

"""

绘制出树的所有节点,递归绘制

:param myTree: 树

:param parentPt: 父节点的坐标

:param nodeTxt: 节点的文本信息

:return:

"""

# 计算叶子节点数

numLeafs = getNumLeafs(myTree=myTree)

# 计算树的深度

depth = getTreeDepth(myTree=myTree)

# 得到根节点的信息内容

firstStr = list(myTree.keys())[0]

# 计算出当前根节点在所有子节点的中间坐标,也就是当前x轴的偏移量加上计算出来的根节点的中心位置作为x轴(比如说第一次:初始的x偏移量为:-1/2W,计算出来的根节点中心位置为:(1+W)/2W,相加得到:1/2),当前y轴偏移量作为y轴

cntrPt = (plotTree.xOff + (1.0 + float(numLeafs))/2.0/plotTree.totalW, plotTree.yOff)

# 绘制该节点与父节点的联系

plotMidText(cntrPt, parentPt, nodeTxt)

# 绘制该节点

plotNode(firstStr, cntrPt, parentPt, decisionNode)

# 得到当前根节点对应的子树

secondDict = myTree[firstStr]

# 计算出新的y轴偏移量,向下移动1/D,也就是下一层的绘制y轴

plotTree.yOff = plotTree.yOff - 1.0/plotTree.totalD

# 循环遍历所有的key

for key in secondDict.keys():

# 如果当前的key是字典的话,代表还有子树,则递归遍历

if isinstance(secondDict[key], dict):

plotTree(secondDict[key], cntrPt, str(key))

else:

# 计算新的x轴偏移量,也就是下个叶子绘制的x轴坐标向右移动了1/W

plotTree.xOff = plotTree.xOff + 1.0/plotTree.totalW

# 打开注释可以观察叶子节点的坐标变化

# print((plotTree.xOff, plotTree.yOff), secondDict[key])

# 绘制叶子节点

plotNode(secondDict[key], (plotTree.xOff, plotTree.yOff), cntrPt, leafNode)

# 绘制叶子节点和父节点的中间连线内容

plotMidText((plotTree.xOff, plotTree.yOff), cntrPt, str(key))

# 返回递归之前,需要将y轴的偏移量增加,向上移动1/D,也就是返回去绘制上一层的y轴

plotTree.yOff = plotTree.yOff + 1.0/plotTree.totalD

def createPlot(inTree):

"""

需要绘制的决策树

:param inTree: 决策树字典

:return:

"""

# 创建一个图像

fig = plt.figure(1, facecolor='white')

fig.clf()

axprops = dict(xticks=[], yticks=[])

createPlot.ax1 = plt.subplot(111, frameon=False, **axprops)

# 计算出决策树的总宽度

plotTree.totalW = float(getNumLeafs(inTree))

# 计算出决策树的总深度

plotTree.totalD = float(getTreeDepth(inTree))

# 初始的x轴偏移量,也就是-1/2W,每次向右移动1/W,也就是第一个叶子节点绘制的x坐标为:1/2W,第二个:3/2W,第三个:5/2W,最后一个:(W-1)/2W

plotTree.xOff = -0.5/plotTree.totalW

# 初始的y轴偏移量,每次向下或者向上移动1/D

plotTree.yOff = 1.0

# 调用函数进行绘制节点图像

plotTree(inTree, (0.5, 1.0), '')

# 绘制

plt.show()

if __name__ == '__main__':

createPlot(mytree)

def makeTreeFull(myTree, labels_full, default):

"""

将树中的不存在的特征标签进行补全,补全为父节点中出现最多的类别

:param myTree: 生成的树

:param labels_full: 特征的全部标签

:param parentClass: 父节点中所含最多的类别

:param default: 如果缺失标签中父节点无法判断类别则使用该值

:return:

"""

# 这里所说的父节点就是当前根节点,把当前根节点下不存在的特征标签作为子节点

# 拿到当前的根节点

root_key = list(myTree.keys())[0]

# 拿到根节点下的所有分类,可能是子节点(好瓜or坏瓜)也可能不是子节点(再次划分的属性值)

sub_tree = myTree[root_key]

# 如果是叶子节点就结束

if isinstance(sub_tree, str):

return

# 找到使用当前节点分类下最多的种类,该分类结果作为新特征标签的分类,如:色泽下面没有浅白则用色泽中有的青绿分类作为浅白的分类

root_class = []

# 把已经分好类的结果记录下来

for sub_key in sub_tree.keys():

if isinstance(sub_tree[sub_key], str):

root_class.append(sub_tree[sub_key])

# 找到本层出现最多的类别,可能会出现相同的情况取其一

if len(root_class):

most_class = collections.Counter(root_class).most_common(1)[0][0]

else:

most_class = None# 当前节点下没有已经分类好的属性

# print(most_class)

# 循环遍历全部特征标签,将不存在标签添加进去

for label in labels_full[root_key]:

if label not in sub_tree.keys():

if most_class is not None:

sub_tree[label] = most_class

else:

sub_tree[label] = default

# 递归处理

for sub_key in sub_tree.keys():

if isinstance(sub_tree[sub_key], dict):

makeTreeFull(myTree=sub_tree[sub_key], labels_full=labels_full, default=default)

用sklearn实现

1.导入包

import pandas as pd

from sklearn import tree

import graphviz

import numpy as np2.读取数据

df = pd.read_csv('watermalon.txt')

df.head(10)

3.将特征值全部转化为数字

df['色泽']=df['色泽'].map({'浅白':1,'青绿':2,'乌黑':3})

df['根蒂']=df['根蒂'].map({'稍蜷':1,'蜷缩':2,'硬挺':3})

df['敲声']=df['敲声'].map({'清脆':1,'浊响':2,'沉闷':3})

df['纹理']=df['纹理'].map({'清晰':1,'稍糊':2,'模糊':3})

df['脐部']=df['脐部'].map({'平坦':1,'稍凹':2,'凹陷':3})

df['触感'] = np.where(df['触感']=="硬滑",1,2)

df['好瓜'] = np.where(df['好瓜']=="是",1,0)

x_train=df[['色泽','根蒂','敲声','纹理','脐部','触感']]

y_train=df['好瓜']

print(df)

id3=tree.DecisionTreeClassifier(criterion='entropy')

id3=id3.fit(x_train,y_train)

print(id3)

4.训练并进行可视化

id3=tree.DecisionTreeClassifier(criterion='entropy')

id3=id3.fit(x_train,y_train)

labels = ['色泽', '根蒂', '敲击', '纹理', '脐部', '触感']

dot_data = tree.export_graphviz(id3

,feature_names=labels

,class_names=["好瓜","坏瓜"]

,filled=True

,rounded=True

)

graph = graphviz.Source(dot_data)

graph

三、C4.5算法

(一)简介

C4.5算法是用于生成决策树的一种经典算法,是ID3算法的一种延伸和优化。C4.5算法对ID3算法进行了改进 ,改进点主要有:

- 用信息增益率来选择划分特征,克服了用信息增益选择的不足,但信息增益率对可取值数目较少的属性有所偏好;

- 能够处理离散型和连续型的属性类型,即将连续型的属性进行离散化处理;

- 能够处理具有缺失属性值的训练数据;

- 在构造树的过程中进行剪枝;

(二)特征选择

特征选择也即选择最优划分属性,从当前数据的特征中选择一个特征作为当前节点的划分标准。 随着划分过程不断进行,希望决策树的分支节点所包含的样本尽可能属于同一类别,即节点的“纯度”越来越高。

(三)信息增益率

信息增益准则对可取值数目较多的属性有所偏好,为减少这种偏好可能带来的不利影响,C4.5算法采用信息增益率来选择最优划分属性。增益率公式

其中 ,K个值。若使用A来对样本集D进行划分,则会产生K个分支节点,其中第k个节点包含D中所有属性A上取值为 的样本,记为

。通常,属性A的可能取值数越多(即K越大),则IV(A)的值通常会越大。

信息增益率准则对可取值数目较少的属性有所偏好。所以,C4.5算法不是直接选择信息增益率最大的候选划分属性,而是先从候选划分属性中找出信息增益高于平均水平的属性,再从中选择信息增益率最高的。

(四)代码实现

在信息增益添加信息增益率

infoGain = infoGain/newEntropy

四、CART算法

(一)简介

Classification And Regression Tree,即分类回归树算法,简称CART算法,它是决策树的一种实现,通常决策树主要有三种实现,分别是ID3算法,CART算法和C4.5算法。 CART算法是一种二分递归分割技术,把当前样本划分为两个子样本,使得生成的每个非叶子结点都有两个分支,因此CART算法生成的决策树是结构简洁的二叉树。由于CART算法构成的是一个二叉树,它在每一步的决策时只能是“是”或者“否”,即使一个feature有多个取值,也是把数据分为两部分。在CART算法中主要分为两个步骤

(1)将样本递归划分进行建树过程

(2)用验证数据进行剪枝

(二)CART算法的原理

上面说到了CART算法分为两个过程,其中第一个过程进行递归建立二叉树,那么它是如何进行划分的 ?设代表单个样本的个属性,表示所属类别。CART算法通过递归的方式将维的空间划分为不重叠的矩形。划分步骤大致如下

(1)选一个自变量,再选取的一个值,把维空间划分为两部分,一部分的所有点都满足,另一部分的所有点都满足,对非连续变量来说属性值的取值只有两个,即等于该值或不等于该值。

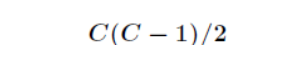

(2)递归处理,将上面得到的两部分按步骤(1)重新选取一个属性继续划分,直到把整个维空间都划分完。在划分时候有一个问题,它是按照什么标准来划分的 ? 对于一个变量属性来说,它的划分点是一对连续变量属性值的中点。假设个样本的集合一个属性有个连续的值,那么则会有个分裂点,每个分裂点为相邻两个连续值的均值。每个属性的划分按照能减少的杂质的量来进行排序,而杂质的减少量定义为划分前的杂质减去划分后的每个节点的杂质量划分所占比率之和。而杂质度量方法常用Gini指标,假设一个样本共有类,那么一个节点的Gini不纯度可定义为

其中pi表示属于第i类的概率,当Gini(A)=0时,所有样本属于同类,所有类在节点中以等概率出现时,Gini(A)最大化,此时。

(三)实现

1.导入包

import pandas as pd

from sklearn import tree

import graphviz

2.导入数据

df = pd.read_csv('watermalon.txt')

df.head(10)

3.特征值化数字

df['色泽']=df['色泽'].map({'浅白':1,'青绿':2,'乌黑':3})

df['根蒂']=df['根蒂'].map({'稍蜷':1,'蜷缩':2,'硬挺':3})

df['敲声']=df['敲声'].map({'清脆':1,'浊响':2,'沉闷':3})

df['纹理']=df['纹理'].map({'清晰':1,'稍糊':2,'模糊':3})

df['脐部']=df['脐部'].map({'平坦':1,'稍凹':2,'凹陷':3})

df['触感'] = np.where(df['触感']=="硬滑",1,2)

df['好瓜'] = np.where(df['好瓜']=="是",1,0)

x_train=df[['色泽','根蒂','敲声','纹理','脐部','触感']]

y_train=df['好瓜']

4.结果

参考:决策树算法--ID3算法 - 知乎 (zhihu.com)

8027

8027

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?