代码练习

MNIST数据集分类

transforms.ToTensor()是将图像转化为tensor格式并且数值范围变为0-1之间。

transforms.Normalize((0.1307,), (0.3081,))将数据转换为均值为0方差为1的数据分布。

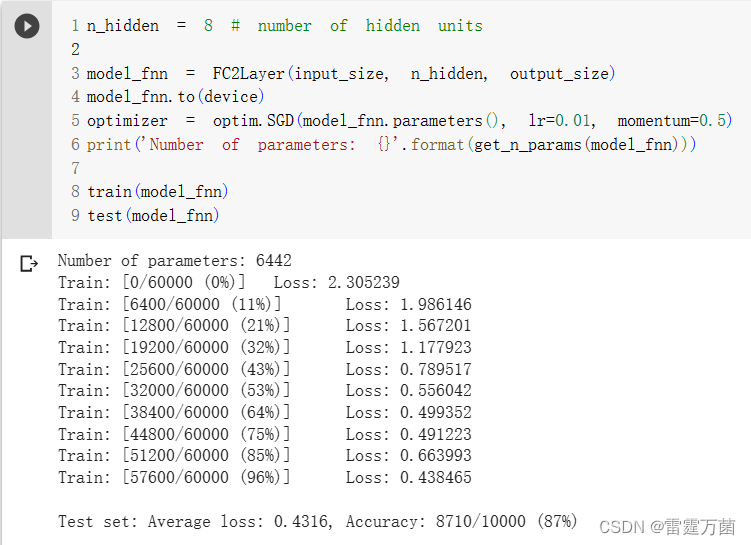

通过比较发现,在相同的参数量下卷积神经网络的效果要比全连接网络训练效果要好,准确率更高。

这里对图像的像素进行打乱,来进行接下来的测试。

从打乱像素顺序的实验结果来看,全连接网络训练的结果比卷积神经网络的训练的效果更好,最后得到的准确率也更高。

想法:卷积神经网络可以利用图像像素之间的联系,可以通过卷积提取到更好的特征方便处理,如果是对一些完全没有规律的数据处理,在参数量比较小的情况下可能比较难拟合,相对于全连接网络效果不好。

CIFAR10 数据集分类

上图展示了数据集的部分图片。

网络训练10个epoch,loss最后下降到0.775。

最后在10000张数据集上测试的正确率为62%。如果增加网络的深度可能准确率还会提升。

想法:之前尝试了一下在最后的网络的forward增加一个out=F.softmax(x,dim=1)可能会提高分类的准确率,结果发现准确率不仅没有提高还下降了,通过分析发现原来代码里的nn.CrossEntropyLoss()本身在计算损失时本身就会将输出的结果经过softmax来求出每个类别的概率值。

使用 VGG16 对 CIFAR10 分类

这里是修改过后的VGG网络结构。

上图是训练最后快训练完的loss值。

测试的准确率比之前的网络效果提升了不少。

问题总结

dataloader 里面 shuffle 取不同值有什么区别?

shuffle可以为true或者false。如果为true这每一轮数据集图片的顺序都会被打乱。可以增加网络训练的随机性,减少过拟合。shuffle为false代表不每一轮数据集图片的顺序都一样。

transform 里,取了不同值,这个有什么区别?

transform 是在数据加载时对图像进行预处理的操作。不同的 transform 参数会对图像进行不同的处理。例如,在图像分类任务中,常见的 transform 操作包括将图像转换为 Tensor 格式、对图像进行归一化、随机裁剪、随机翻转等。不同的 transform 操作会改变输入图像的数据分布和特征表示,从而影响模型的学习过程。

epoch 和 batch 的区别?

epoch代表网络一共需要训练多少轮。batch就是一次迭代送入多少张图片,一张一张的输入网络太慢了。

1x1的卷积和 FC 有什么区别?主要起什么作用?

1x1的卷积主要作用是降低维度,保留输入特征的空间信息等。FC层将输入数据展平成一维向量,丢失了空间信息,FC层通常用于最后的分类任务,将特征映射到类别概率上。

residual leanring 为什么能够提升准确率?

在传统的深层神经网络中,随着网络层数的增加,梯度会逐渐变小,导致梯度消失问题。而残差学习通过引入残差块,将输入和输出之间的残差作为学习目标,使得梯度在反向传播过程中能够更容易地传播到浅层,从而解决了梯度消失问题,使得深层网络能够更好地训练。残差块通过学习残差,相当于引入了一个恒等映射,允许网络在某些情况下直接传递输入信息,从而增加了网络的表达能力。这样的设计使得网络可以选择性地学习到更深层的特征,而不是迫使网络在每一层都必须学习到更抽象的特征,从而更灵活地适应不同的数据分布和任务。

代码练习二里,网络和1989年 Lecun 提出的 LeNet 有什么区别?

下面是LeNet的网络结构

class LeNet(nn.Module):

def __init__(self):

super(LeNet, self).__init__()

self.conv1 = nn.Conv2d(3, 16, 5)

self.pool1 = nn.MaxPool2d(2, 2)

self.conv2 = nn.Conv2d(16, 32, 5)

self.pool2 = nn.MaxPool2d(2, 2)

self.fc1 = nn.Linear(32*5*5, 120)

self.fc2 = nn.Linear(120, 84)

self.fc3 = nn.Linear(84, 10)

与代码二的区别是少了一个最大池化,以及网络参数比LeNet少。

代码练习二里,卷积以后feature map 尺寸会变小,如何应用 Residual Learning?

特征图的尺寸变小应该是无法应用残差的,可以卷积完尺寸变小以后再反卷积让特征的尺寸变大,这样就可以应用残差了。

有什么方法可以进一步提升准确率?

可以在卷积之后使用batchNorm来进行归一化,可以加速收敛并提高模型的稳定性。也可以通过数据增强来增广数据集提高数据集的多样性。也可以使用预训练模型,使用预训练模型可以提高模型的准确率。预训练模型是在大规模数据集上预先训练好的模型,可以作为初始化参数或进行微调来加速训练过程并提高准确率。

552

552

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?