一、基本概念

(一)Executor(执行器)

在集群工作节点上为某个应用启动的工作进程,该进程负责运行计算任务,并为应用程序存储数据。

(二)Task(任务)

运行main()方法并创建SparkContext的进程。

(三)Job(作业)

一个并行计算作业,由一组任务组成,并由Spark的行动算子(如:save、collect)触发启动。

(四)Stage(阶段)

每个Job可划分为更小的Task集合,每组任务被称为Stage。

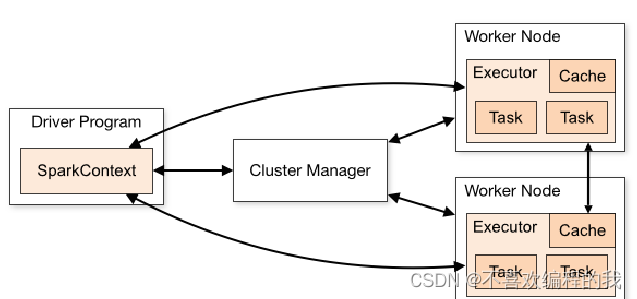

二、Spark集群运行架构

Spark运行架构主要由SparkContext、Cluster Manager和Worker组成,其中Cluster Manager负责整个集群的统一资源管理,Worker节点中的Executor是应用执行的主要进程,内部含有多个Task线程以及内存空间,通过下图深入了解Spark运行基本流程。

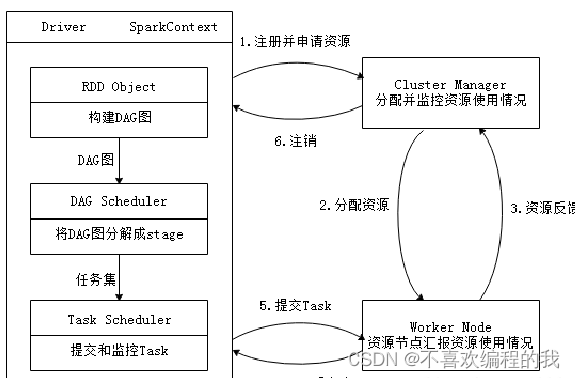

三、Spark运行基本流程

Spark应用在集群上作为独立的进程组来运行,具体运行流程如下图所示

步骤1、注册并申

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

471

471

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?