黏菌优化算法SMA优化广义神经网络GRNN做多特征输入,单个因变量输出的拟合预测模型。

程序内注释详细直接替换数据就可以用。

程序语言为matlab。

不会替换数据的可以免费指导替换数据。

ID:8635680120419658

Matlab建模

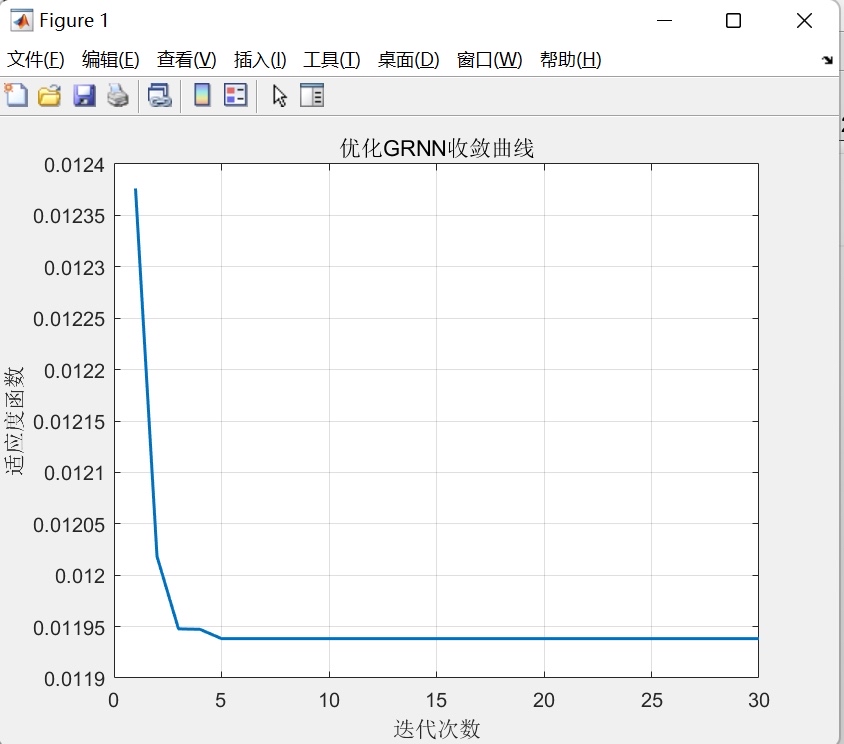

黏菌优化算法(SMA)是一种基于生物黏菌的启发式优化算法,它模拟了黏菌在寻找食物的过程中的行为。黏菌优化算法通过模拟这一行为,寻找最优解,广义神经网络(GRNN)是一种多层前向神经网络,具有简单、快速和高效的特点。本文将介绍如何将黏菌优化算法应用于广义神经网络,建立一个拟合预测模型,实现多特征输入和单个因变量输出。

首先,我们需要使用Matlab编写程序来实现黏菌优化算法和广义神经网络。在程序中,我们可以通过注释来详细说明代码的功能,并给出替换数据的方法。如果读者对数据替换操作不熟悉,我们可以提供免费的指导,帮助读者完成数据替换的过程。这样,读者就可以直接运行程序,获取拟合预测模型的结果。

黏菌优化算法的核心思想是通过模拟黏菌在食物寻找过程中的行为来优化目标函数。黏菌会在环境中释放并追踪黏液,通过不断迭代,寻找到最优解。在程序中,我们可以通过定义目标函数和迭代过程来实现黏菌优化算法。同时,我们需要考虑参数的设置和调整,以确保算法的效果。

广义神经网络是一种多层前向神经网络,它以快速、简单和高效的方式进行数据建模。在拟合预测模型中,我们可以将多个特征作为输入,然后通过神经网络的训练和优化,得到单个因变量的输出。在程序中,我们需要定义神经网络的结构和参数,然后使用数据进行训练和优化,最终得到一个准确的预测模型。

通过将黏菌优化算法和广义神经网络相结合,我们可以建立一个强大的拟合预测模型,实现多特征输入和单个因变量输出。这个模型可以在各种领域中应用,例如金融、医疗和工程等领域。通过优化算法的使用,我们可以提高模型的准确性和效率,为实际问题提供更好的解决方案。

总之,黏菌优化算法和广义神经网络的结合为我们提供了一个强大的工具,可以用于建立拟合预测模型。通过Matlab编程实现和数据替换,我们可以直接运行程序,得到模型的结果。希望本文的介绍对读者有所帮助,并鼓励读者在实践中探索更多创新的应用。

【相关代码 程序地址】: http://nodep.cn/680120419658.html

389

389

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?