感谢每一个认真阅读我文章的人,看着粉丝一路的上涨和关注,礼尚往来总是要有的:

① 2000多本Python电子书(主流和经典的书籍应该都有了)

② Python标准库资料(最全中文版)

③ 项目源码(四五十个有趣且经典的练手项目及源码)

④ Python基础入门、爬虫、web开发、大数据分析方面的视频(适合小白学习)

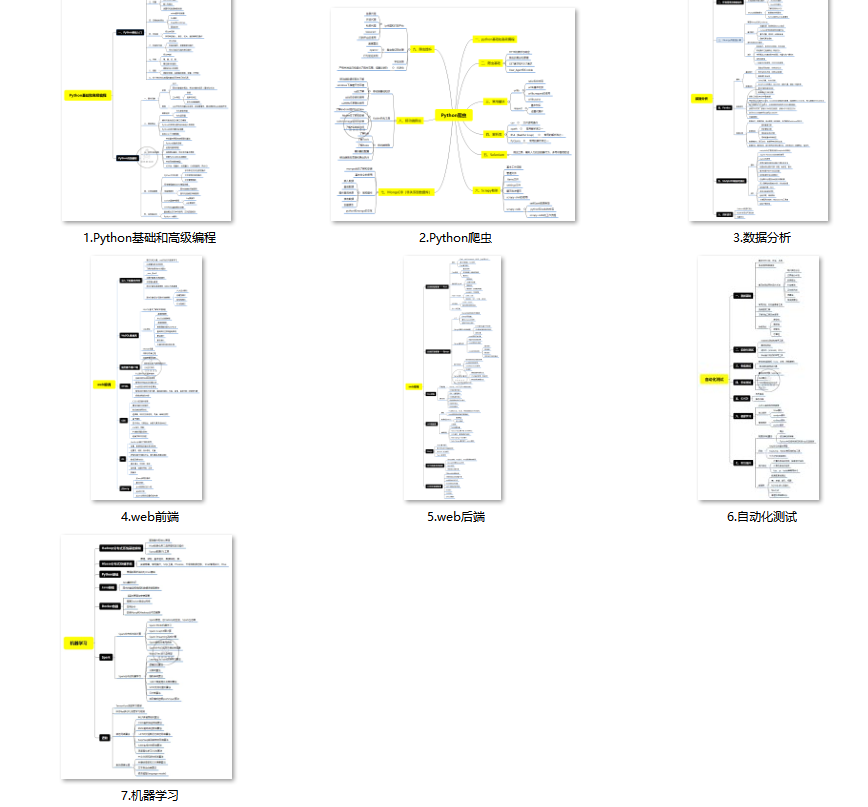

⑤ Python学习路线图(告别不入流的学习)

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

text:<property object at 0x00000257D64B2778>

css:<function Response.css at 0x00000257D64B46A8>

xpath:<function Response.xpath at 0x00000257D64B4730>

follow:<function Response.follow at 0x00000257D64B47B8>

dict:<attribute ‘dict’ of ‘Response’ objects>

weakref:<attribute ‘weakref’ of ‘Response’ objects>

doc:None

从上面我们会看到三个重要属性(url、body和text),再查看下Response类源码会发现如下代码

url = property(_get_url, obsolete_setter(_set_url, ‘url’))

body = property(_get_body, obsolete_setter(_set_body, ‘body’))

@property

def text(self):

“”“For subclasses of TextResponse, this will return the body

as text (unicode object in Python 2 and str in Python 3)

“””

raise AttributeError(“Response content isn’t text”)

url、body、text这就是我们在爬虫分析中需要用到的三个重要属性,都可与通过Response对象获得

**例子:**

‘’’

遇到问题没人解答?Python学习交流群:857662006 寻找有志同道合的小伙伴,互帮互助

群里还有不错的视频学习教程和PDF电子书!

‘’’

import scrapy

from lxml import etree

class CountrySpider(scrapy.Spider):

name = ‘country’

allowed_domains = [‘example.webscraping.com’]

start_urls = [‘http://example.webscraping.com/places/default/view/Afghanistan-1’]

#该函数名不能改变,因为scrapy源码中默认callback函数的函数名就是parse

def parse(self, response):

from bs4 import BeautifulSoup as bs

print(response.url)

soup = bs(response.body)

names = [i.string for i in soup.select('td.w2p_fl')]

values = [j.string for j in soup.select('td.w2p_fw')]

dic = dict(zip(names, values))

print(dic)

### 2. Spider类

(1)样的方法,线查看Spider类提供的属性

import scrapy

for key,val in scrapy.Spider.dict.items():

print(“{}:{}”.format(key,val))

module:scrapy.spiders

doc:Base class for scrapy spiders. All spiders must inherit from this

class.

name:None

custom_settings:None

init:<function Spider.init at 0x000001E161FFFD90>

logger:<property object at 0x000001E161785D18>

log:<function Spider.log at 0x000001E161FFFEA0>

from_crawler:<classmethod object at 0x000001E16178B208>

set_crawler:<function Spider.set_crawler at 0x000001E161FF8048>

_set_crawler:<function Spider._set_crawler at 0x000001E161FF80D0>

start_requests:<function Spider.start_requests at 0x000001E161FF8158>

make_requests_from_url:<function Spider.make_requests_from_url at 0x000001E161FF81E0>

parse:<function Spider.parse at 0x000001E161FF8268>

update_settings:<classmethod object at 0x000001E16178B240>

handles_request:<classmethod object at 0x000001E16178B278>

close:<staticmethod object at 0x000001E161FF7E80>

str:<function Spider.str at 0x000001E161FF8488>

repr:<function Spider.str at 0x000001E161FF8488>

dict:<attribute ‘dict’ of ‘Spider’ objects>

weakref:<attribute ‘weakref’ of ‘Spider’ objects>

(2)接下来对其中几个重要的属性和方法进行说明:

start\_requests()

该 方法会默认读取start\_urls属性中定义的网址,为每一个网址生成一个Request请求对象,并返回可迭代对象

make\_request\_from\_url(url)

该方法会被start\_request()调用,该方法负责实现生成Request请求对象

close(reason)

关闭Spider时,该方法会被调用

log(message[,level,component])

使用该方法可以实现在Spider中添加log

(3)上面几个函数对应的源码

‘’’

遇到问题没人解答?Python学习交流群:857662006 寻找有志同道合的小伙伴,互帮互助

群里还有不错的视频学习教程和PDF电子书!

‘’’

def start_requests(self):

cls = self.class

if method_is_overridden(cls, Spider, ‘make_requests_from_url’):

warnings.warn(

"Spider.make_requests_from_url method is deprecated; it "

"won’t be called in future Scrapy releases. Please "

“override Spider.start_requests method instead (see %s.%s).” % (

cls.module, cls.name

),

)

for url in self.start_urls:

yield self.make_requests_from_url(url)

else:

for url in self.start_urls:

yield Request(url, dont_filter=True)

def make_requests_from_url(self, url):

""" This method is deprecated. """

return Request(url, dont_filter=True)

def log(self, message, level=logging.DEBUG, **kw):

"""Log the given message at the given log level

This helper wraps a log call to the logger within the spider, but you

can use it directly (e.g. Spider.logger.info('msg')) or use any other

Python logger too.

"""

self.logger.log(level, message, **kw)

(4)例子:重写start\_request()方法

import scrapy

from lxml import etree

class CountrySpider(scrapy.Spider):

name = ‘country’

allowed_domains = [‘example.webscraping.com’]

start_urls = [‘http://example.webscraping.com/places/default/view/Afghanistan-1’,

“http://example.webscraping.com/places/default/view/Aland-Islands-2”]

#重写start_request()方法

def start_requests(self):

for url in self.start_urls:

yield self.make_requests_from_url(url)

#该函数名不能改变,因为scrapy源码中默认callback函数的函数名就是parse

def parse(self, response):

from bs4 import BeautifulSoup as bs

print(response.url)

soup = bs(response.body)

names = [i.string for i in soup.select('td.w2p_fl')]

values = [j.string for j in soup.select('td.w2p_fw')]

dic = dict(zip(names, values))

print(dic)

![[外链图片转存失败(img-Q7ieuUjw-1564730141711)(https://img2018.cnblogs.com/blog/1117865/201811/1117865-20181122152940804-696716032.png)]](https://img-blog.csdnimg.cn/20190802151720877.?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3NpbmF0XzM4NjgyODYw,size_16,color_FFFFFF,t_70)

### 3. pipines的编写

在项目被蜘蛛抓取后,它被发送到项目管道,它通过顺序执行的几个组件来处理它。

每个项目管道组件(有时称为“Item Pipeline”)是一个实现简单方法的Python类。他们接收一个项目并对其执行操作,还决定该项目是否应该继续通过流水线或被丢弃并且不再被处理。

简单理解就是将item的内容进行处理或保存

class CrawlerPipeline(object):

def process_item(self, item, spider):

country_name = item["country_name"]

country_area = item["country_area"]

# 后续处理,可以写进文件

return item

新手必遇到文件,发现process\_item没有被调用,解决方案:

(1)在setting.py中进行配置

做了那么多年开发,自学了很多门编程语言,我很明白学习资源对于学一门新语言的重要性,这些年也收藏了不少的Python干货,对我来说这些东西确实已经用不到了,但对于准备自学Python的人来说,或许它就是一个宝藏,可以给你省去很多的时间和精力。

别在网上瞎学了,我最近也做了一些资源的更新,只要你是我的粉丝,这期福利你都可拿走。

我先来介绍一下这些东西怎么用,文末抱走。

* * *

**(1)Python所有方向的学习路线(新版)**

这是我花了几天的时间去把Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

最近我才对这些路线做了一下新的更新,知识体系更全面了。

**(2)Python学习视频**

包含了Python入门、爬虫、数据分析和web开发的学习视频,总共100多个,虽然没有那么全面,但是对于入门来说是没问题的,学完这些之后,你可以按照我上面的学习路线去网上找其他的知识资源进行进阶。

**(3)100多个练手项目**

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。

**(4)200多本电子书**

这些年我也收藏了很多电子书,大概200多本,有时候带实体书不方便的话,我就会去打开电子书看看,书籍可不一定比视频教程差,尤其是权威的技术书籍。

基本上主流的和经典的都有,这里我就不放图了,版权问题,个人看看是没有问题的。

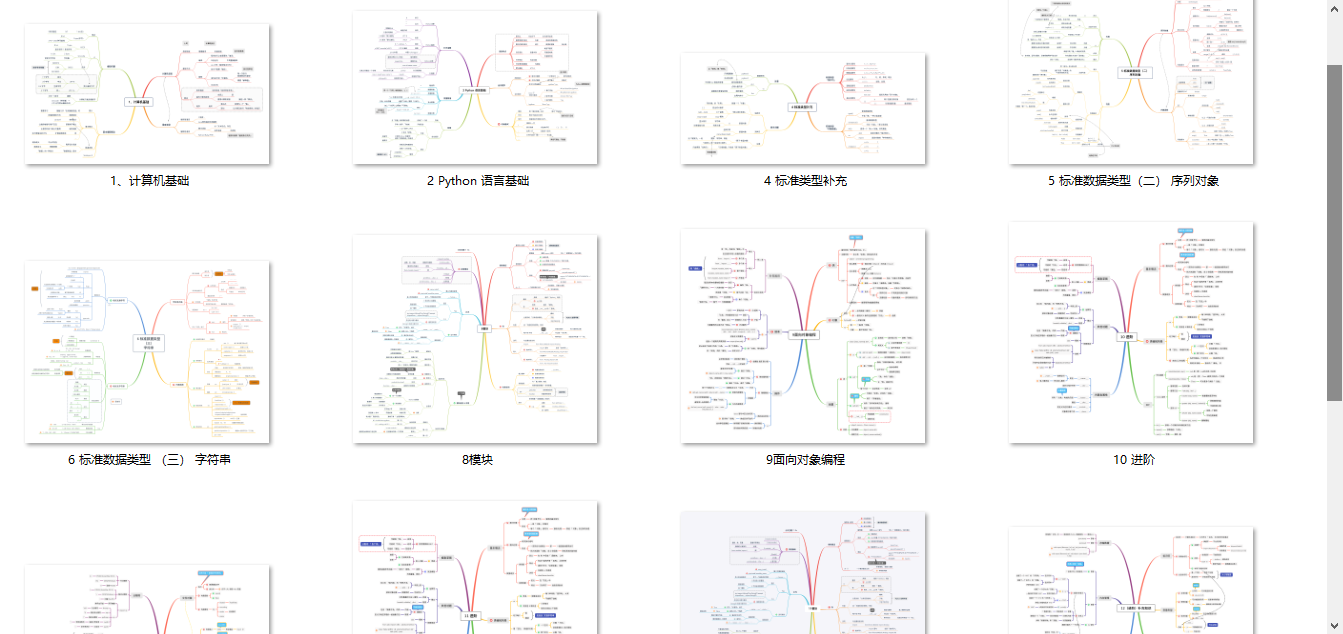

**(5)Python知识点汇总**

知识点汇总有点像学习路线,但与学习路线不同的点就在于,知识点汇总更为细致,里面包含了对具体知识点的简单说明,而我们的学习路线则更为抽象和简单,只是为了方便大家只是某个领域你应该学习哪些技术栈。

**(6)其他资料**

还有其他的一些东西,比如说我自己出的Python入门图文类教程,没有电脑的时候用手机也可以学习知识,学会了理论之后再去敲代码实践验证,还有Python中文版的库资料、MySQL和HTML标签大全等等,这些都是可以送给粉丝们的东西。

**这些都不是什么非常值钱的东西,但对于没有资源或者资源不是很好的学习者来说确实很不错,你要是用得到的话都可以直接抱走,关注过我的人都知道,这些都是可以拿到的。**

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化学习资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618317507)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?