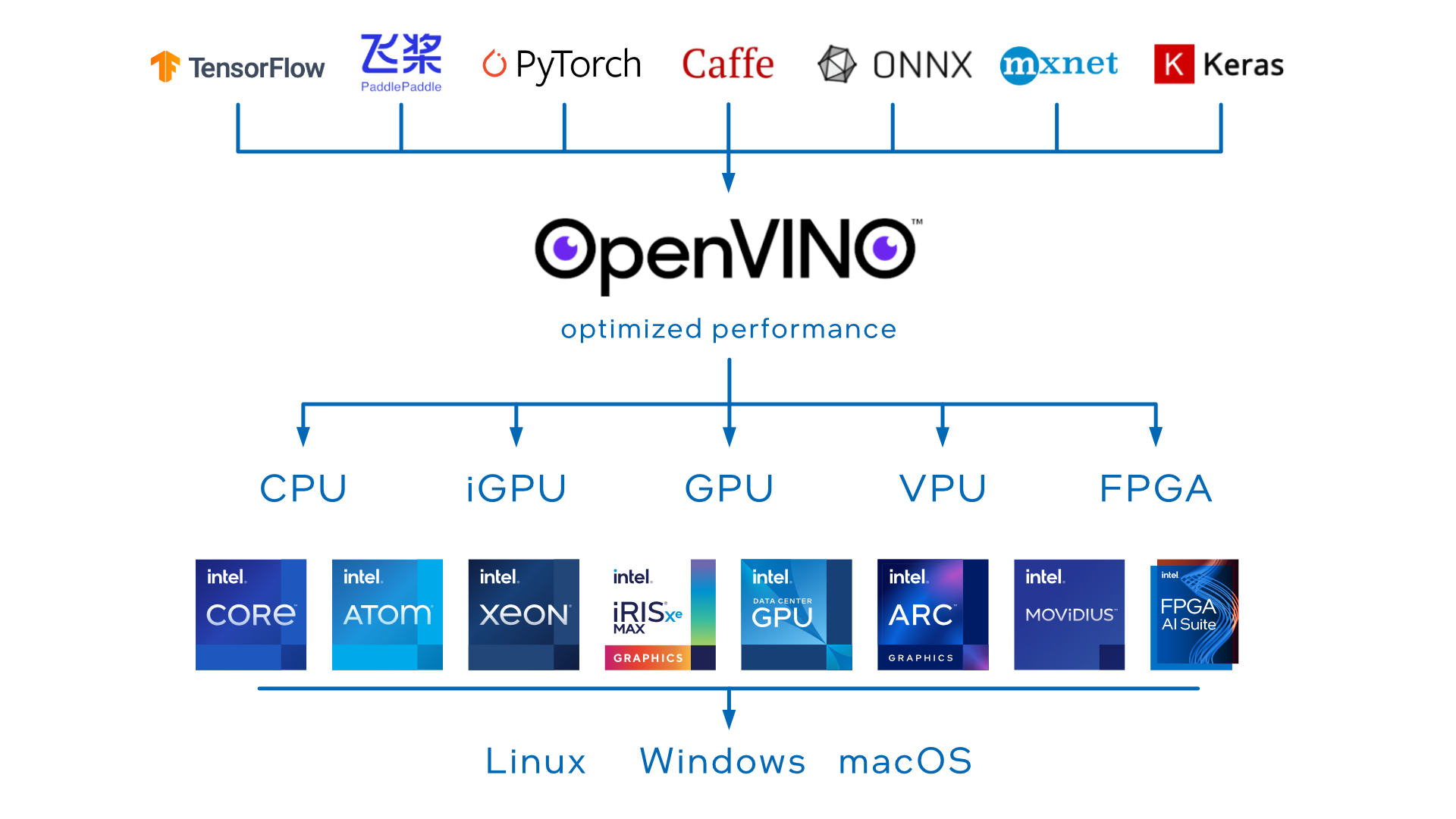

OpenVINO 是一个用于优化和部署深度学习模型的开源工具包。它为来自 TensorFlow、PyTorch 等流行框架的视觉、音频和语言模型提供了增强的深度学习性能。

概述

penVINO 使您能够优化几乎任何框架的深度学习模型,并在一系列英特尔处理器和其他硬件平台上以一流的性能部署它。 OpenVINO 的典型工作流程如下所示。

High-Performance Deep Learning

OpenVINO Runtime 使用积极的图形融合、内存重用、负载平衡以及跨 CPU、GPU、VPU 等的推理并行性自动优化深度学习管道。您可以集成其他操作并将其卸载到加速器中,以进行预处理和后处理,以减少端到端延迟并提高吞吐量。

Model Quantization and Compression

使用 OpenVINO 的训练后优化工具和神经网络压缩框架中提供的量化和其他最先进的压缩技术,进一步提高模型的速度。这些技术还可以降低模型大小和内存要求,使其能够部署在资源受限的边缘硬件上。

Local Inferencing & Model Serving

您可以直接与 OpenVINO 运行时链接以在本地运行推理,也可以使用 OpenVINO 模型服务从单独的服务器或 Kubernetes 环境中提供模型推理

Improved Application Portability

一次编写应用程序,即可部署到任何位置,从而从硬件实现最高性能。自动设备发现可实现卓越的部署灵活性。OpenVINO 运行时支持 Linux、Windows 和 MacOS,并提供 Python、C++ 和 C API。使用您的首选语言和操作系统。

Minimal External Dependencies

在设计时将外部依赖关系降至最低,从而减少了应用程序占用空间,简化了安装和依赖关系管理。流行的软件包管理器使应用程序依赖项能够轻松安装和升级。针对特定模型的自定义编译可进一步减小最终的二进制大小。

Enhanced App Start-Up Time

在需要快速启动的应用中,OpenVINO 使用 CPU 进行初始推理,然后在模型编译并加载到内存后切换到 GPU 或 VPU,从而显著降低首次推理延迟。编译后的模型被缓存以进一步缩短启动时间。

Supported Devices

OpenVINO 在各种硬件平台上均受支持。

有关兼容 OpenVINO 的平台的完整列表,请访问支持的设备页面。

查看性能基准测试页面,了解 OpenVINO 在各种处理器上运行流行模型的速度。OpenVINO 支持在 Windows、Linux 和 macOS 上部署。

4801

4801

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?