csv_writer.writeheader()

- 保存图片

def save_img(img_urls):

for i in img_urls:

img_url = ‘http://news.cqu.edu.cn’ + i

img_content = get_html(img_url).content

img_name = img_url.split(‘/’)[-1]

with open(‘新闻图片\’ + img_name, mode=‘wb’) as f:

f.write(img_content)

- 主函数

def main(url):

html_data = get_html(url).text

selector = get_pars(html_data)

lis = selector.css(‘body > div:nth-child(4) > div > div.lists .title a::attr(href)’).getall()

for li in lis:

content_data = get_html(li).text

li_selector = get_pars(content_data)

title = li_selector.css(‘.dtitle::text’).get() # 新闻标题

article = li_selector.css(‘.acontent’).get() # 新闻内容

name_list = li_selector.css(‘.dinfoa a::text’).getall() # 作者

name = ‘|’.join(name_list)

date_list = li_selector.css(‘.ibox span::text’).getall()

date_str = ‘’.join(date_list) # 新闻日期

img_urls = li_selector.css(‘.acontent p img::attr(src)’).getall() # 获取新闻内图片

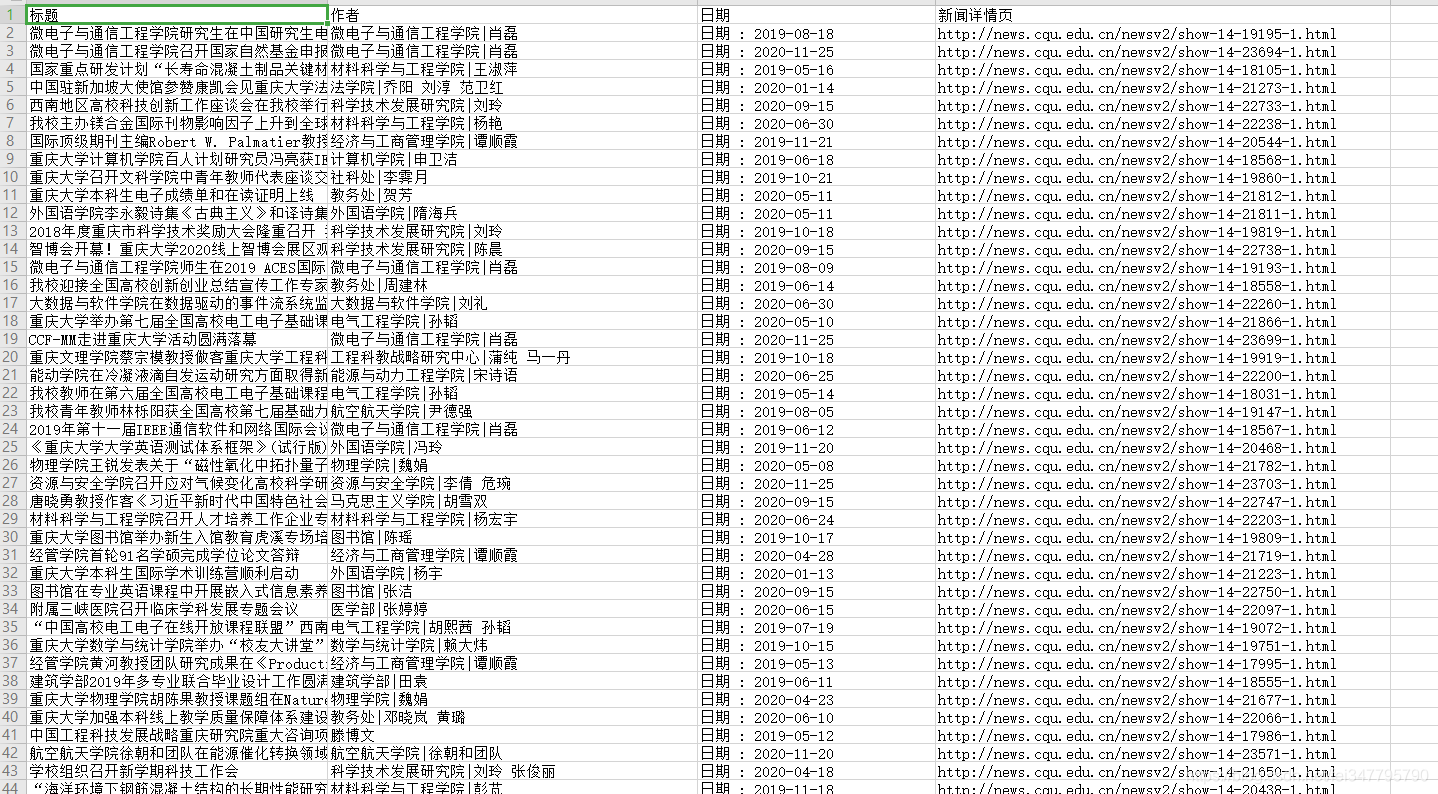

dit = {

‘标题’: title,

‘作者’: name,

‘日期’: date_str,

‘新闻详情页’: li,

}

csv_writer.writerow(dit)

save_article(article, title)

save_img(img_urls)

if name == ‘main’:

for page in range(1, 11):

url = ‘https://news.cqu.edu.cn/newsv2/news-127.html?&page={}’.format(page)

main_thread = threading.Thread(target=main, args=(url,))

main_thread.start()

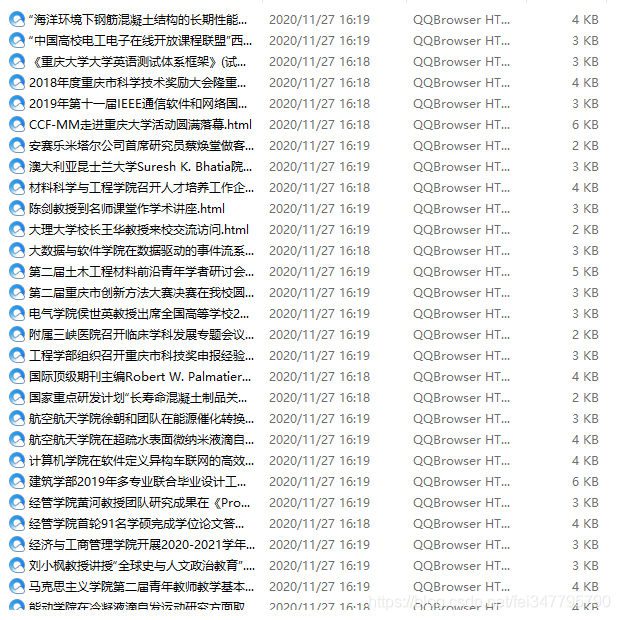

- 文件PDF

- 详情页url

- 相关图片

图片可以按照标题后缀数字123命名,这个地方可以优化

- csv文件数据

import requests

import parsel

import pdfkit

import csv

import threading

f = open(‘新闻.csv’, mode=‘a’, encoding=‘utf-8-sig’, newline=‘’)

csv_writer = csv.DictWriter(f, fieldnames=[‘标题’, ‘作者’, ‘日期’, ‘新闻详情页’])

csv_writer.writeheader()

headers = {

‘user-agent’: ‘Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/81.0.4044.138 Safari/537.36’

}

html_str = “”"

<!doctype html>

{article}

“”"

def get_html(html_url):

response = requests.get(url=html_url, headers=headers)

return response

def get_pars(html_data):

selector = parsel.Selector(html_data)

return selector

def save_article(article, title):

html_path = ‘重庆新闻\’ + title + ‘.html’

pdf_path = ‘重庆新闻pdf\’ + title + ‘.pdf’

html = html_str.format(article=article)

with open(html_path, mode=‘w’, encoding=‘utf-8’) as f:

f.write(html)

print(‘{}已下载完成’.format(title))

exe 文件存放的路径

config = pdfkit.configuration(wkhtmltopdf=‘C:\Program Files\wkhtmltopdf\bin\wkhtmltopdf.exe’)

把 html 通过 pdfkit 变成 pdf 文件

pdfkit.from_file(html_path, pdf_path, configuration=config)

def save_img(img_urls):

for i in img_urls:

img_url = ‘http://news.cqu.edu.cn’ + i

img_content = get_html(img_url).content

img_name = img_url.split(‘/’)[-1]

with open(‘新闻图片\’ + img_name, mode=‘wb’) as f:

f.write(img_content)

def main(url):

最后

不知道你们用的什么环境,我一般都是用的Python3.6环境和pycharm解释器,没有软件,或者没有资料,没人解答问题,都可以免费领取(包括今天的代码),过几天我还会做个视频教程出来,有需要也可以领取~

给大家准备的学习资料包括但不限于:

Python 环境、pycharm编辑器/永久激活/翻译插件

python 零基础视频教程

Python 界面开发实战教程

Python 爬虫实战教程

Python 数据分析实战教程

python 游戏开发实战教程

Python 电子书100本

Python 学习路线规划

小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数初中级Python工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Python爬虫全套学习资料》送给大家,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

由于文件比较大,这里只是将部分目录截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频

如果你觉得这些内容对你有帮助,可以添加下面V无偿领取!(备注:python)

师,想要提升技能,往往是自己摸索成长或者是报班学习,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!**

因此收集整理了一份《2024年Python爬虫全套学习资料》送给大家,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

由于文件比较大,这里只是将部分目录截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频

如果你觉得这些内容对你有帮助,可以添加下面V无偿领取!(备注:python)

[外链图片转存中…(img-6dJ0QIqI-1711199098853)]

8363

8363

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?