-

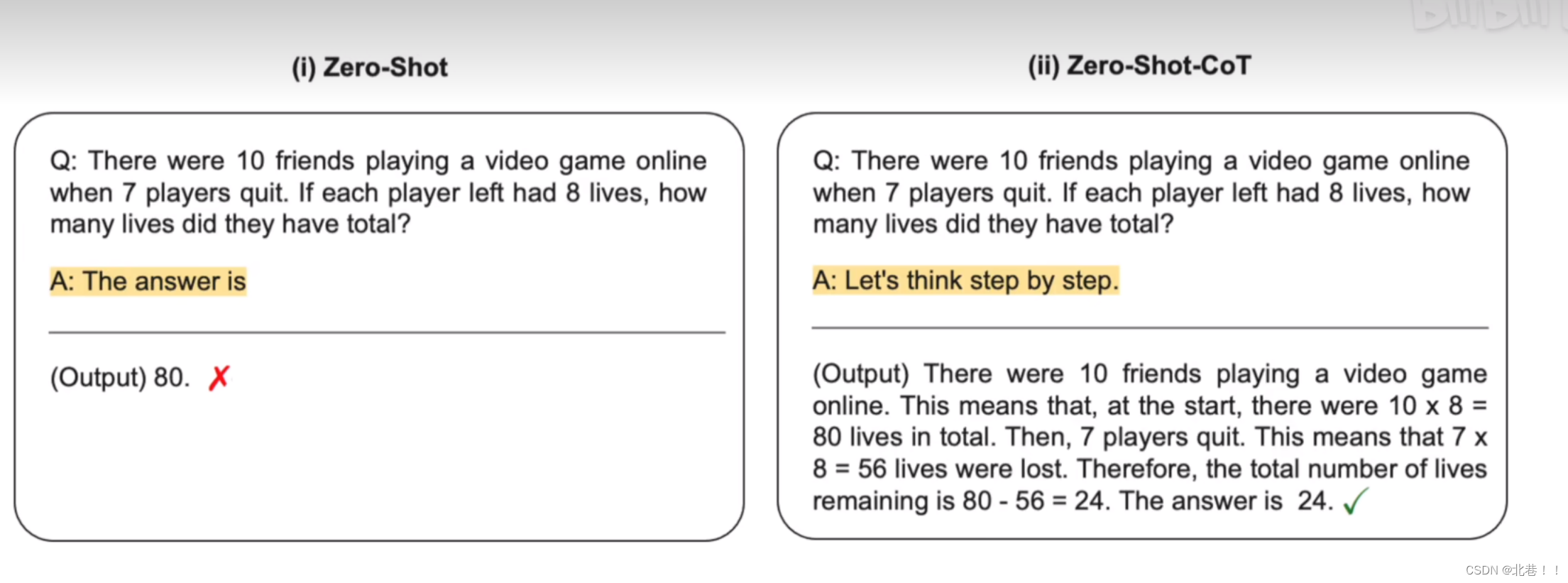

让我们一步一步来思考(给AI一个鼓励)

-

Zero-Shot

-

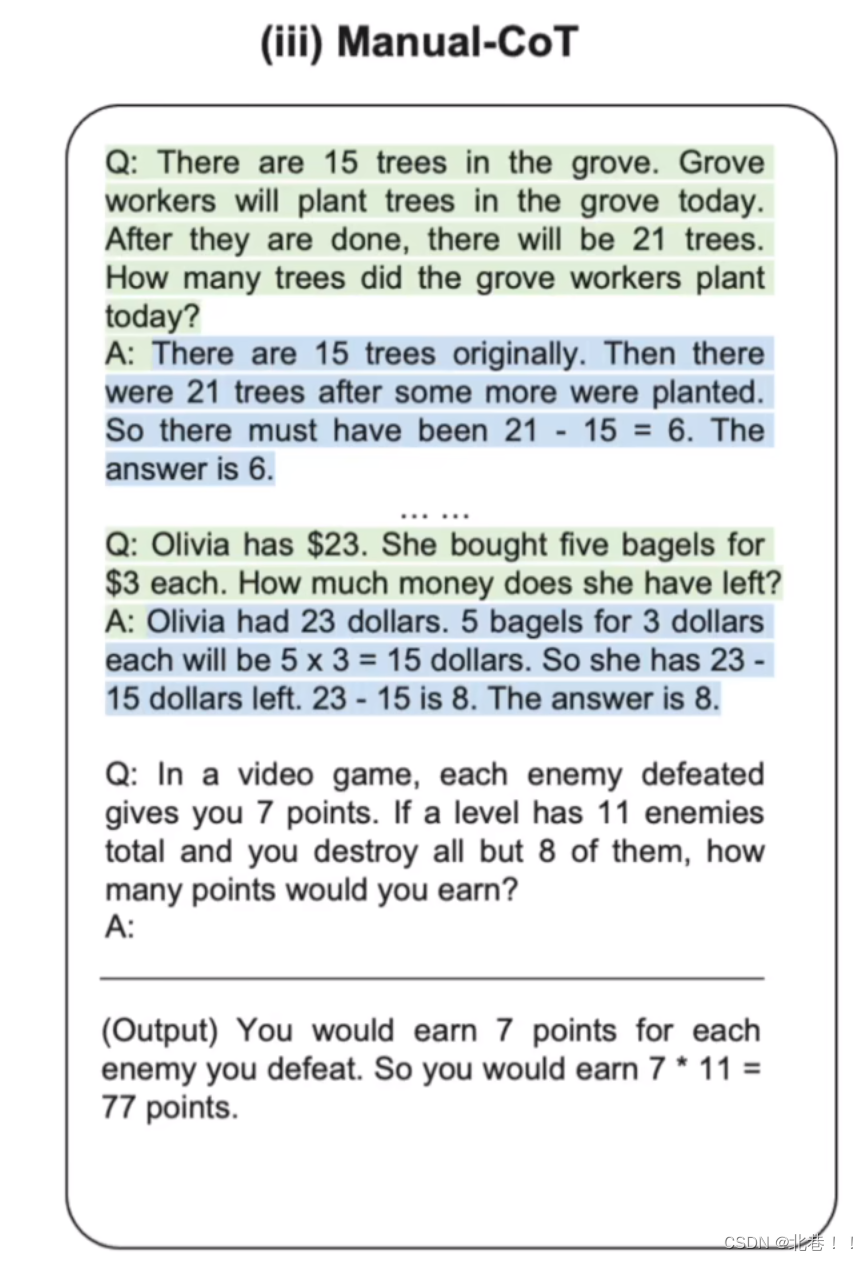

Manual-CoT(手动设计一些问题和样例,也就是高亮部分,比zero-Shot性能好)

-

把设计的问题和答案和最后要问的问题拼接给字符串,让它回答。

-

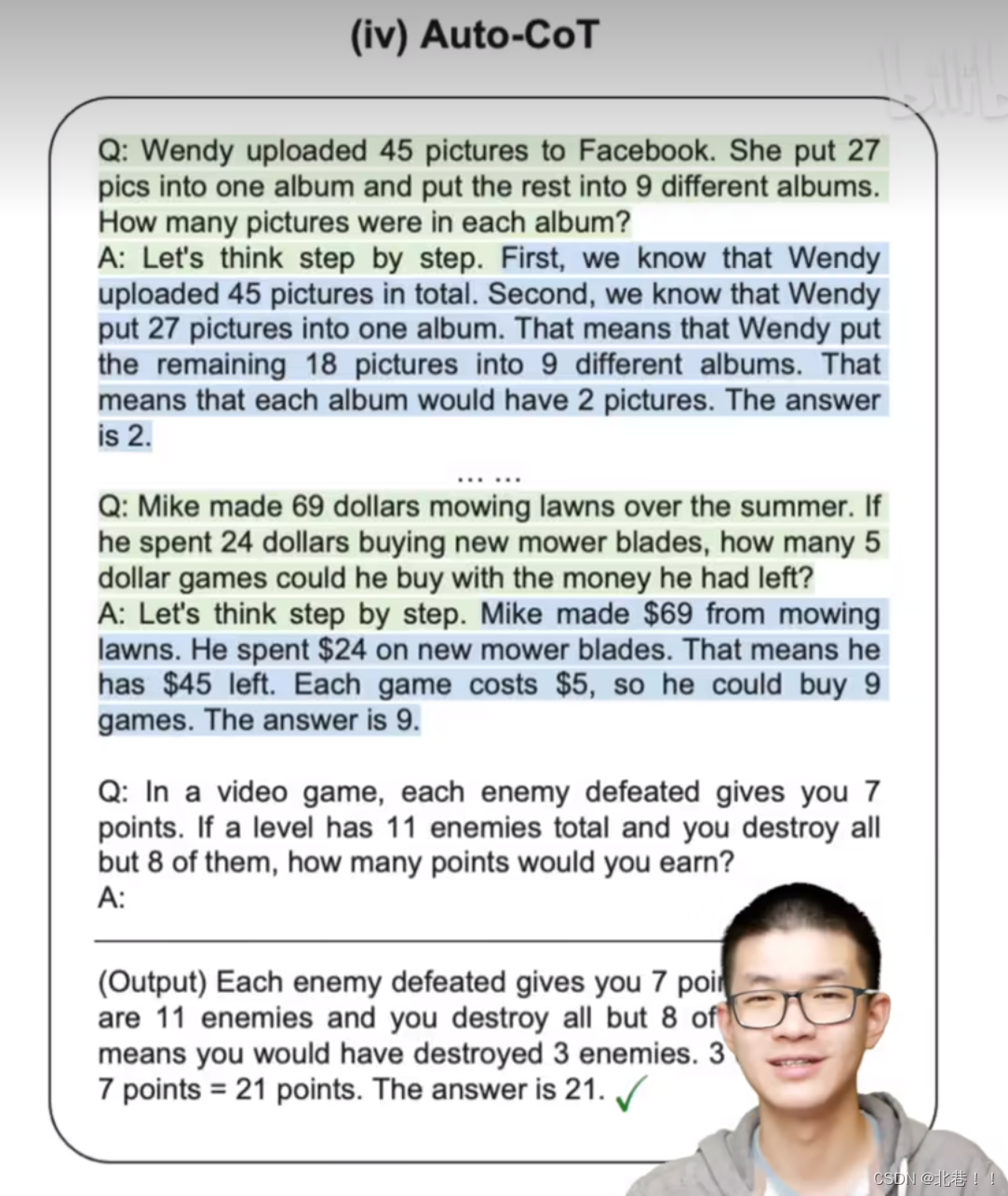

Auto-CoT(把人工设计的few-shot由模型自动构建,让大模型帮助生成最终问题和答案)

-

在10个数据集上,Auto-CoT比Manual-CoT的性能还要好。印证了CoT领域有很多未解之谜。

-

为什么要使用COT

问题可以分为两类,一类是容易回答的,没有太多逻辑推理,比如:天气如何。另一类是需要长链条的逻辑推理的问题:数学等。

当语言模型的规模指数级增大时,它解决常规问题的能力有了很大的提升,然而它解决逻辑推理的问题的能力却提升很小。而CoT就是帮助解决这样的问题,它的核心思想是;不要光给出答案,把推理过程也给出来。 -

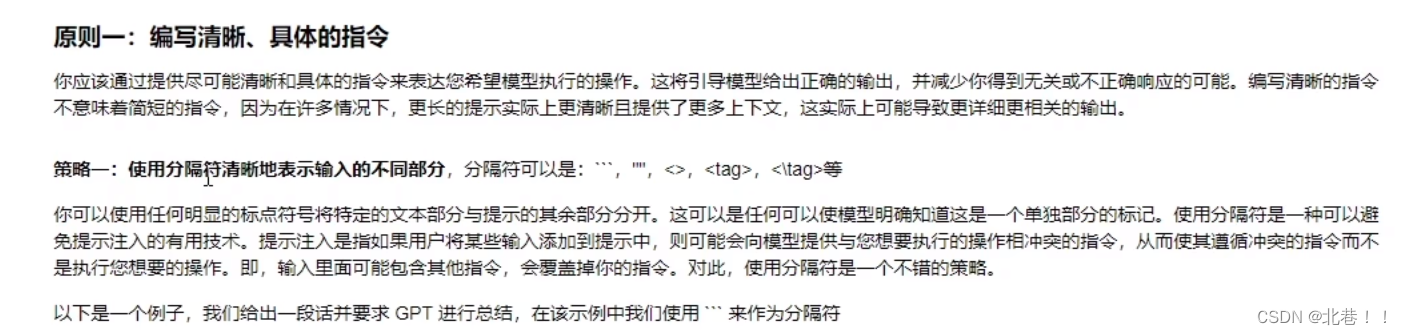

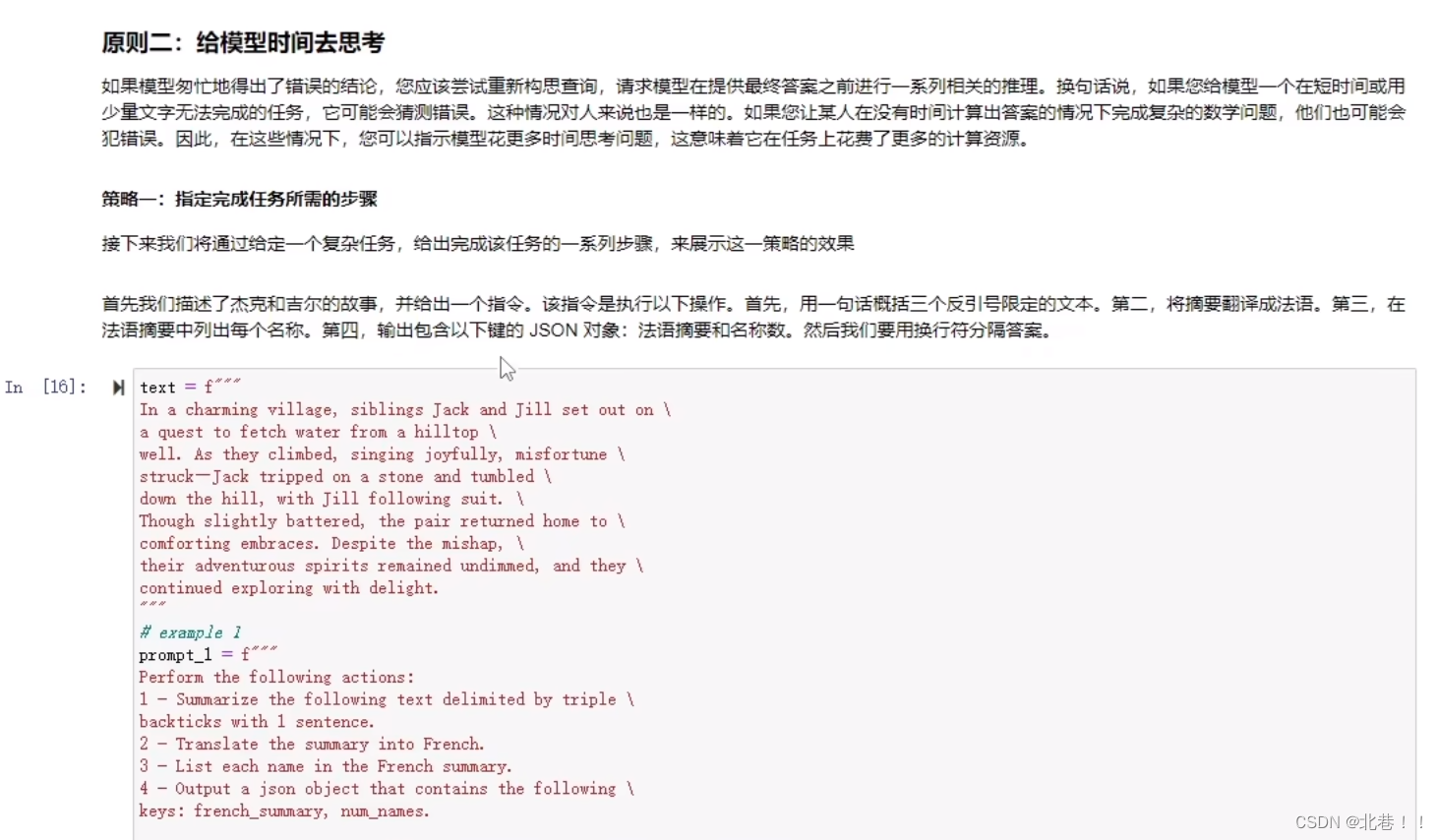

提示词的技巧(吴恩达大佬提示教程https://github.com/datawhalechina/prompt-engineering-for-developers/blob/main/content/Building%20Systems%20with%20the%20ChatGPT%20API/10.Evaluation-part2.ipynb)

-

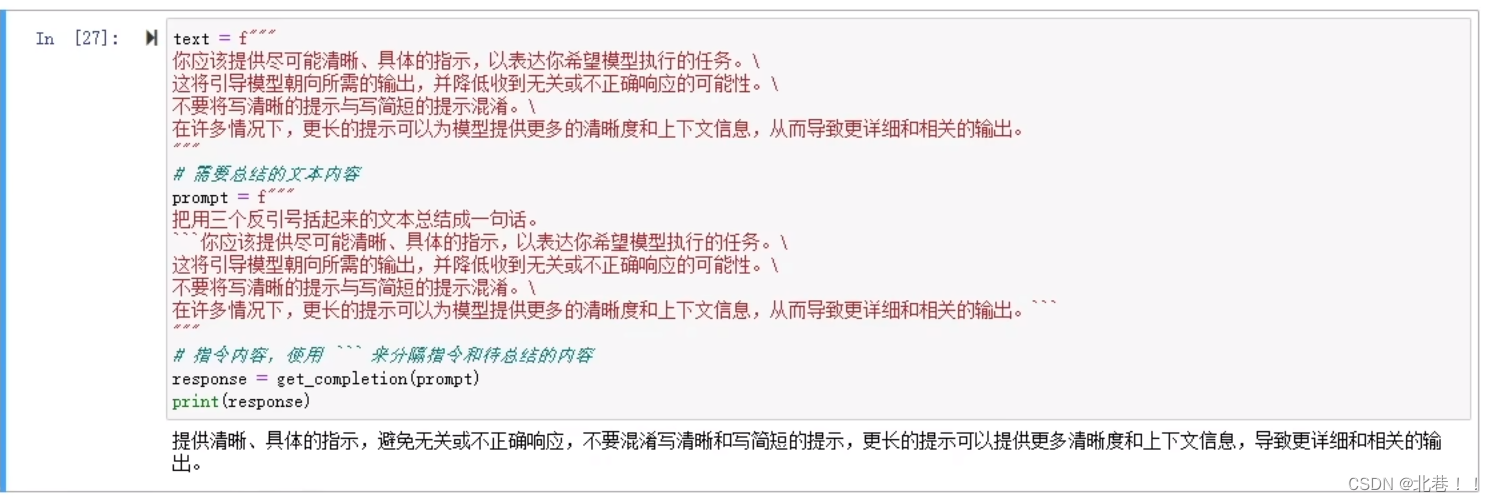

利用分隔符分割指令和内容

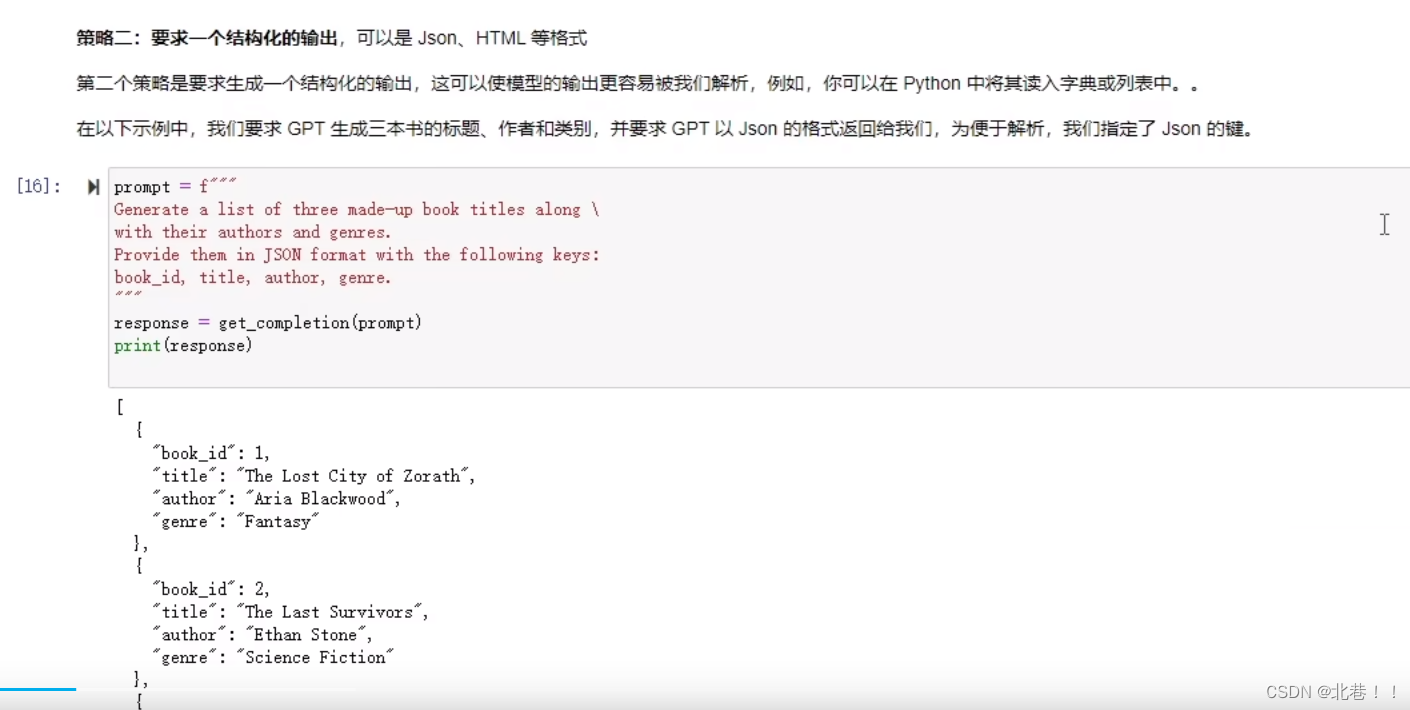

- 要求一个结构化的输出

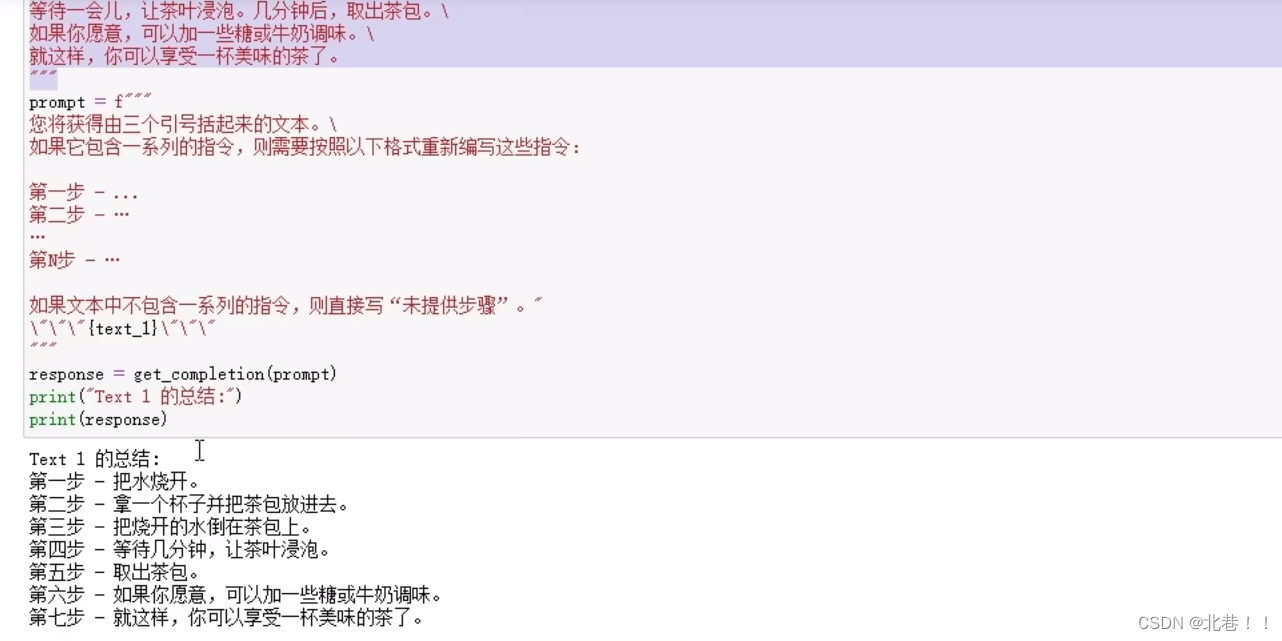

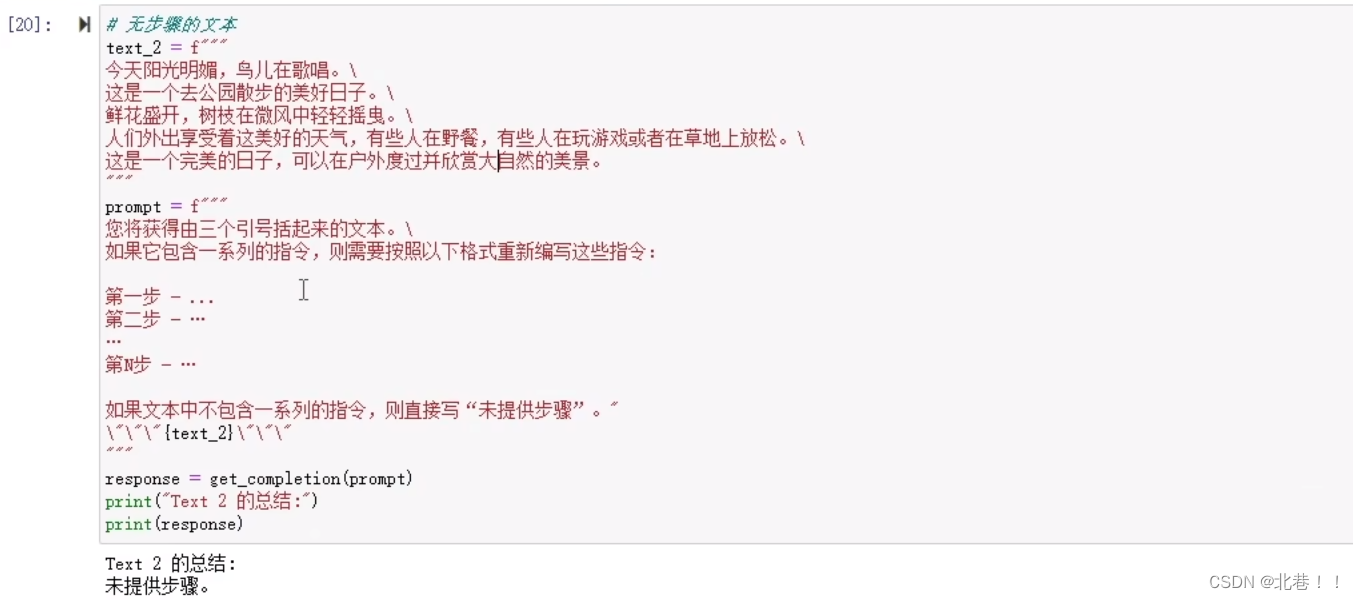

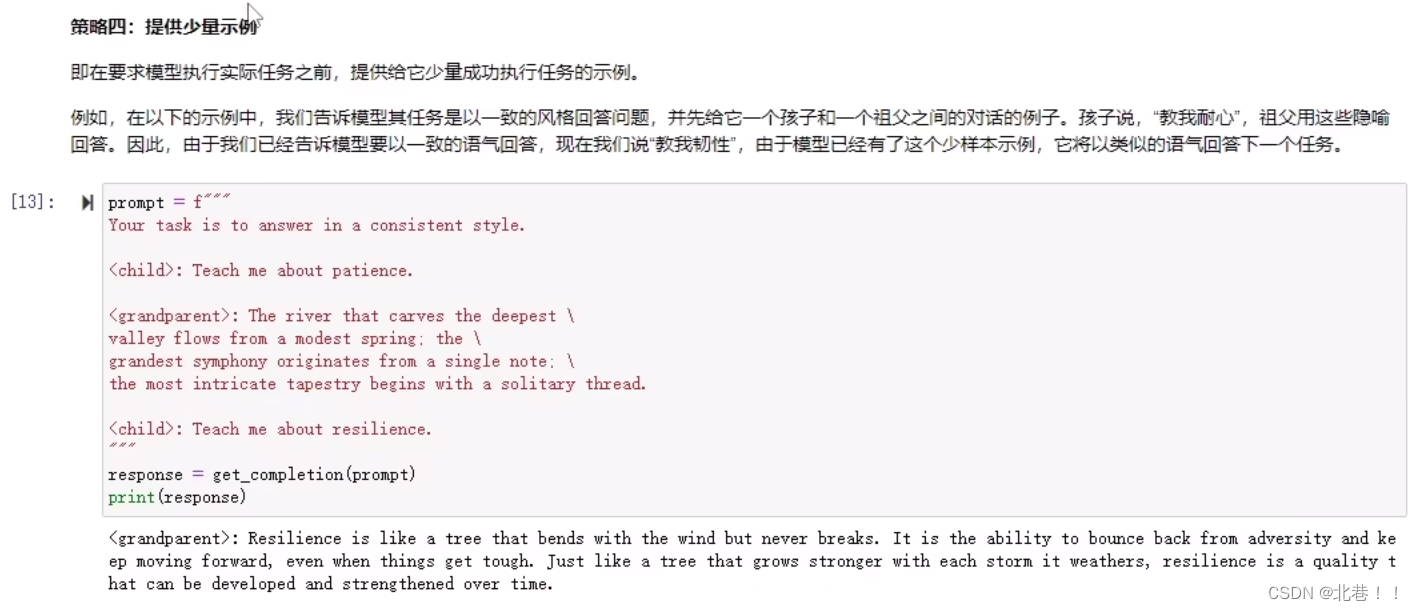

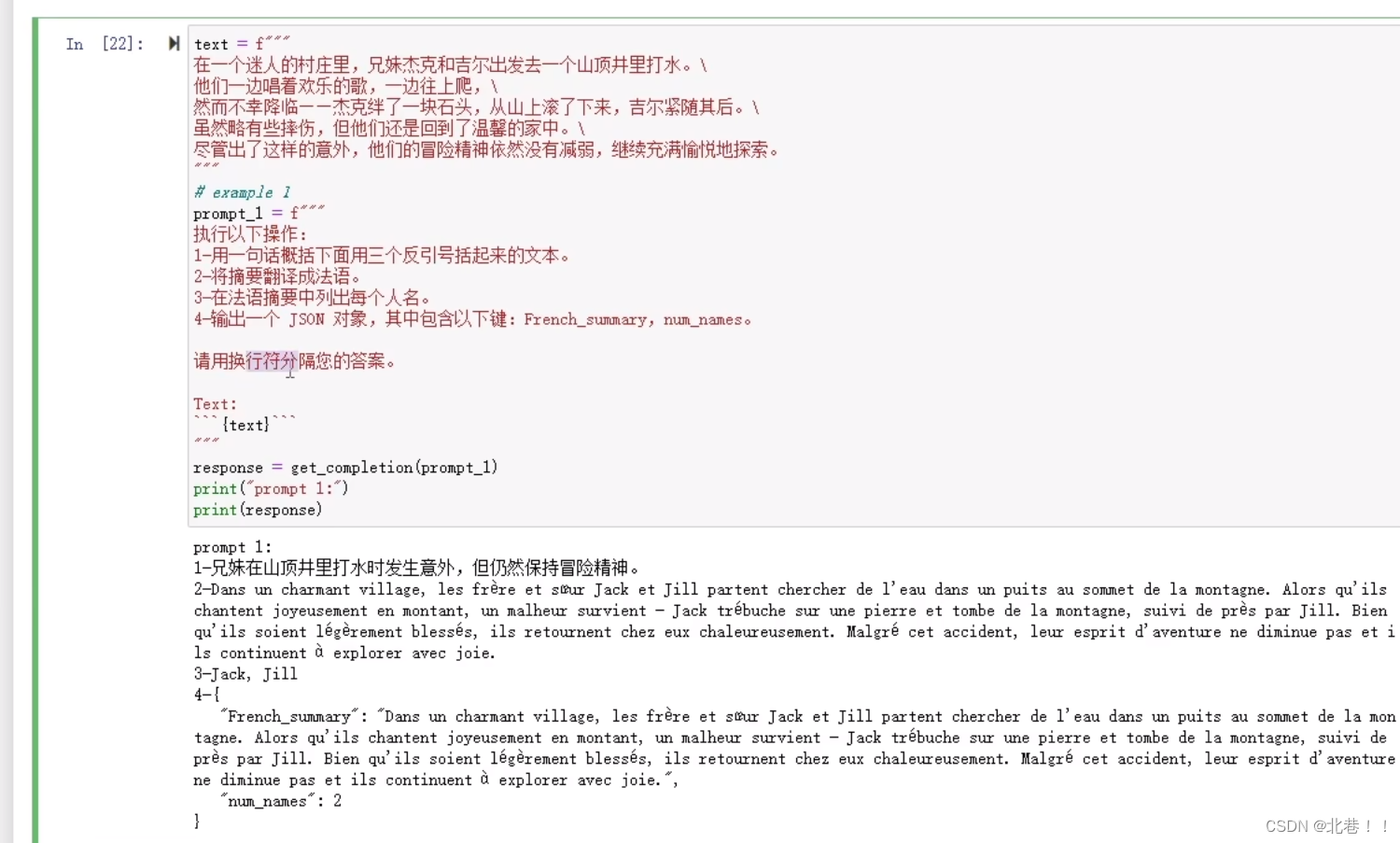

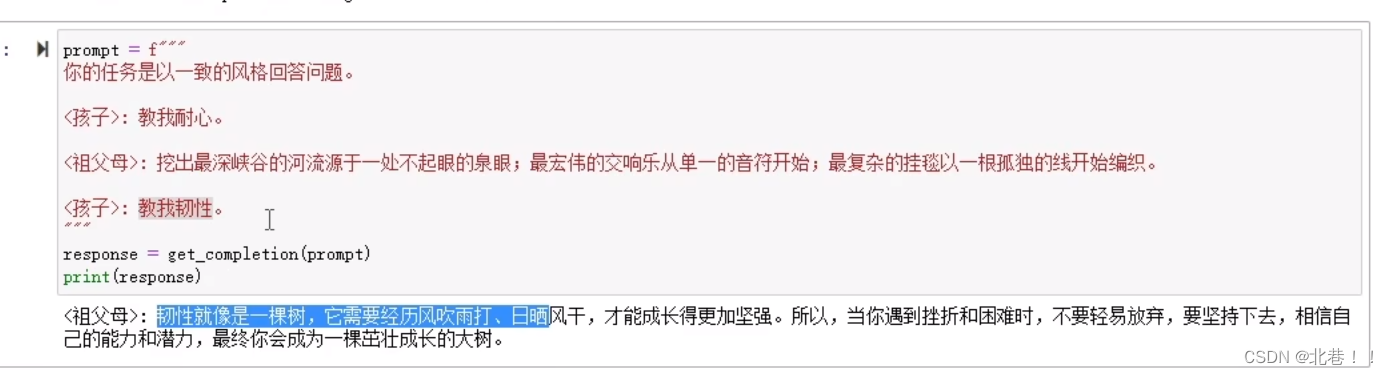

- 提供少量的实例

- 给他一些知识

732

732

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?