对于从事统计自然语言处理来说,了解概率论、信息论以及语言学知识都是很有必要的。

下面内容主要介绍了在统计自然语言处理中需要了解的概率论基础。

概率

如果P(A)作为事件A的概率,Ω是试验的样本空间,则概率函数满足下面三条公理:

- 非负性 P(A) >= 0

- 规范性 P(Ω) = 1

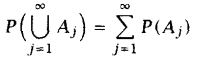

- 可列可加性:对于不相交的集合Aj ∈F

条件概率和独立性

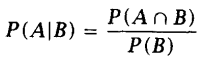

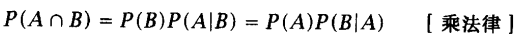

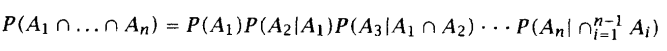

假设事件B的概率已知,那么事件A发生的条件概率为(P(B) > 0):

在统计自然语言处理中,上面那个链式法则很有用处,比如推导马尔可夫模型的性质。

贝叶斯定理

由条件概率和链式规则推得:

本文探讨了统计自然语言处理中的概率论基础知识,包括概率、条件概率与独立性、贝叶斯定理、随机变量、期望与方差、联合分布和条件分布以及二项分布和正态分布等概念。在NLP中,这些概率概念被用于模型建立和分析,如马尔可夫模型,以及在处理语料库时进行独立性假设。

本文探讨了统计自然语言处理中的概率论基础知识,包括概率、条件概率与独立性、贝叶斯定理、随机变量、期望与方差、联合分布和条件分布以及二项分布和正态分布等概念。在NLP中,这些概率概念被用于模型建立和分析,如马尔可夫模型,以及在处理语料库时进行独立性假设。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3185

3185

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?