问题阐述:

pytorch在训练过程中由于dataloader 多进程加载数据 导致的死锁, 使得程序训练暂停。该问题在pytorch的官方github上的issue上有提到, 这里不再赘述。

https://github.com/pytorch/pytorch/issues/1355

问题出现的平台

我这边出现的平台,不限于

- pytorch 1.1

- python 3.6

- CUDA 9.0

问题解决办法:

一个肯定能解决的办法: 将dataloader的num_worker 设置为 0

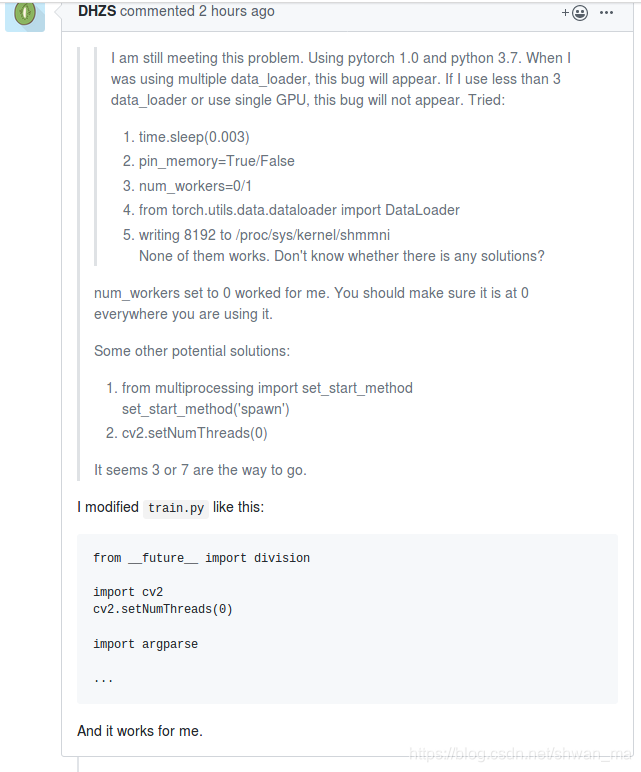

其他的:(但对我来说,都不work, 图来自 https://github.com/pytorch/pytorch/issues/1355#issuecomment-563765333)

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?