梯度下降调用fminunc函数

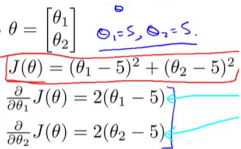

先列出theta、cost function、以及cost function对各theta的偏导数

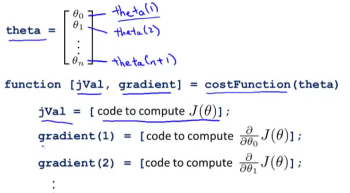

在octave中创建一个costFunction,表示为

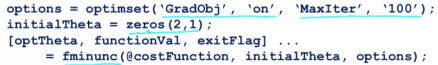

调用fminunc

Optimset : GradObj on:梯度下降打开。MaxIter:设置最大迭代次数100;

opTheta:自动选择各种算法,返回值为theta最优解

exitFlag:显示是否收敛,1为是

@指向定义的costFunction函数

initialTheta 必须>=2维

应用到逻辑回归:

需要定义一个costFunction ,jVal返回值用来计算J(theta);

gradient返回值用来计算代价函数对相应theta的偏导数

969

969

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?