统计学习方法由三要素构成:模型,策略和算法。

支持向量机的三要素:

模型:分离超平面 w*x+b=0 和决策函数 f(x)=sign(w*x+b)

策略:结构风险最小化,具体对于SVM是间隔最大化

算法:凸二次规划

对于支持向量机的模型和算法,都比较好理解,那它的策略间隔最大化,为什么是结构风险最小化呢

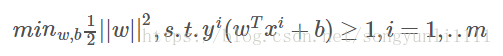

对于SVM原始的约束最优化问题:

w^2就是参数向量的L2范数,也就是正则化项,但还不是结构风险,因为其没有经验风险这一项

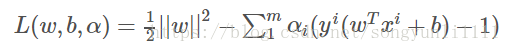

对于SVM的约束对偶最优化问题:

从该式就可以看出,右式第一项是正则化项,第二项是经验风险。因此SVM的策略就是结构风险最小化,其自带正则项。

SVM的过拟合问题

在完全线性可分的数据集下,支持向量机没有过拟合问题,因为它的解是唯一的。而在非线性不可分的情况下,虽然SVM的目标函数采用结构风险最小化策略,但是由于允许误分类的存在核引入了核函数,SVM仍会有过拟合的问题:

实际中应用的SVM模型都是核函数+软间隔的支持向量机,那么,有以下原因导致SVM过拟合:

1)选择的核函数过于powerful

2)要求的间隔过大,即在软间隔支持向量机中C的参数过大时,表示比较重视间隔,坚持要数据完全分离,当C趋于无穷大时,相当于硬间隔SVM

174

174

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?