Spark集群运行WordCount程序,程序基本同练习(一),区别在于注释//.setMaster("local[*]"),改为集群运行,

将注释打开,res.saveAsTextFile(args(1)),保存结果到文件,具体程序如下:

package cn.allengao.hellospark

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

/*

参数设置:

Name:SparkWC

Name class:cn.allengao.hellospark.SparkWC

arguments: hdfs://hadoop001:9000/user/hadoop/input/wc hdfs://hadoop001:9000/output/wc

*/

object SparkWC {

def main(args: Array[String]): Unit = {

//配置信息类

val conf :SparkConf = new SparkConf().setAppName("SparkWC")//.setMaster("local[*]")

//上下文对象

val sc: SparkContext = new SparkContext(conf)

//读取数据

val lines = sc.textFile(args(0))

//处理数据

val words: RDD[String] = lines.flatMap(_.split(" "))

val paired: RDD[(String, Int)] = words.map((_, 1))

//把相同key的value值聚合到一起。

val reduced: RDD[(String, Int)] = paired.reduceByKey(_+_)

//以value作为排序方式,false表示倒序排列,true表示正序排列

val res: RDD[(String, Int)] = reduced.sortBy(_._2, false)

//保存

res.saveAsTextFile(args(1))

// toBuffer转换成可变数组,就可以打印出来了。

// println(res.collect().toBuffer)

//结束任务

sc.stop()

}

}

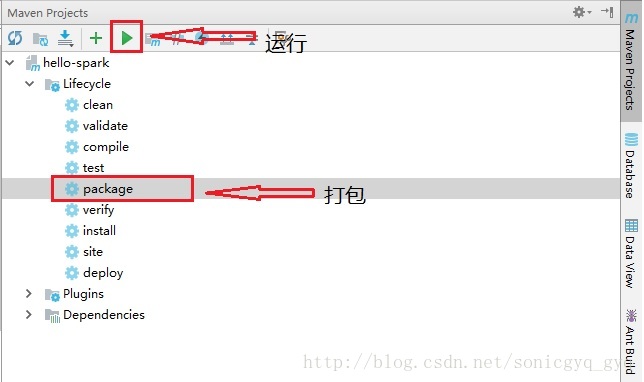

将程序进行打包。

将打好的包上传到spark集群中。

启动hadoop,启动spark。

进入安装好的hadoop目录,执行 ./sbin/start-dfs.sh ./sbin/start-yarn.sh ,启动hadoop集群。

进入安装好的spark目录,执行./sbin/start-all.sh ,启动spark集群。

在spark中运行命令,首先确定入口类,cn.allengao.hellospark.SparkWC ,指定master的地址,指定需要多大的内存运行,指定集群运行需要的核数cores,指定运行的jar包,指定读取数据路径,输出数据路径。

./spark-submit --class cn.allengao.hellospark.SparkWC --master spark://hadoop001:7077 --executor-memory 512M --total-executor-cores 2 /home/hadoop/app/hello-spark-1.0.jar hdfs://hadoop001:9000/user/hadoop/input/wc hdfs://hadoop001:9000/output/wc

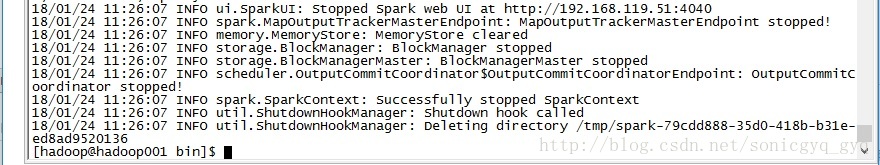

之后开始运行。运行结果如下:

启动浏览器,输入http://192.168.119.51:8080 ,可以看到运行成功的项目如下:

启动浏览器,输入http://192.168.119.51:50070 ,可以在Hadoop中看到运行成功的结果如下:

在centos中运行命令查看文件内容:

[hadoop@hadoop001 bin]$ hadoop fs -cat /output/wc/part-00000

(hello,9)

[hadoop@hadoop001 bin]$ hadoop fs -cat /output/wc/part-00001

(tom,3)

(java,3)

(jerry,2)

(scala,1)

至此,wordcount程序在spark集群中运行测试完毕。

4100

4100

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?