开”怼“…

1 安装 scala

这次我是安装到了 /usr/local/share 目录下:

1.1 解压

[root@master share]# pwd

/usr/local/share

[root@master share]# tar -zxvf scala-2.11.8.tgz

...

[root@master share]# ll

total 28028

drwxr-xr-x. 2 root root 4096 Sep 20 04:54 applications

drwxr-xr-x. 2 root root 4096 Sep 23 2011 info

drwxr-xr-x. 21 root root 4096 Sep 20 04:49 man

drwxrwxr-x 6 1001 1001 4096 Mar 4 2016 scala-2.11.8

-rw-r--r-- 1 root root 28678231 Nov 18 09:14 scala-2.11.8.tgz

[root@master share]# mv scala-2.11.8 scala

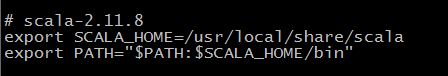

[root@master share]#1.2 配置环境变量

[root@master share]# vi /etc/profile

[root@master share]# source /etc/profile1.3 使用 scala -version 验证

[root@master share]# scala -version

Scala code runner version 2.11.8 -- Copyright 2002-2016, LAMP/EPFL

[root@master share]# 当出现这样的信息的时候就表示我们的 scala 安装成功了。

发送到其他节点上就可以了…

2 安装 spark

2.1 解压,配置环境变量…

快速飘过…

[root@master hadoop]# pwd

/usr/hadoop

[root@master hadoop]# tar -zxvf spark-2.0.1-bin-hadoop2.6.tgz

...

[root@master hadoop]# mv spark-2.0.1-bin-hadoop2.6.tgz spark-2.0.1

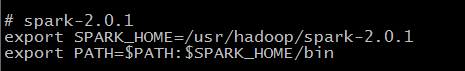

[root@master hadoop]# vi /etc/profile

[root@master hadoop]# source /etc/profile2.2 修改 spark 配置

进入到 conf 目录

2.2.1 修改 spark-env.sh

[root@master conf]# pwd

/usr/hadoop/spark-2.0.1/conf

[root@master conf]# cp spark-env.sh.template spark-env.sh

[root@master conf]# vi spark-env.sh

在 spark-env.sh 中添加

# scala的安装目录

export SCALA_HOME=/usr/local/share/scala

# java的安装目录

export JAVA_HOME=/usr/java/jdk1.8.0_91

# 每个worker默认分配的 内存.

# - SPARK_WORKER_MEMORY, to set how much total memory workers have to give executors (e.g. 1000m, 2g)

export SPARK_WORKER_MEMORY=1G

# hadoop的配置文件目录

export HADOOP_CONF_DIR=/usr/hadoop/hadoop-2.6.4/etc/hadoop

本文详细介绍了Spark 2.0.1的安装过程,包括Scala的安装、Spark的配置修改和集群启动。接着,通过WordCount实例展示了Spark的运行速度优势,整个流程包括数据准备、Spark客户端启动和结果验证。通过本文,读者可以快速上手Spark并体验其高效性能。

本文详细介绍了Spark 2.0.1的安装过程,包括Scala的安装、Spark的配置修改和集群启动。接着,通过WordCount实例展示了Spark的运行速度优势,整个流程包括数据准备、Spark客户端启动和结果验证。通过本文,读者可以快速上手Spark并体验其高效性能。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

101

101

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?