💥💥💞💞欢迎来到本博客❤️❤️💥💥

🏆博主优势:🌞🌞🌞博客内容尽量做到思维缜密,逻辑清晰,为了方便读者。

⛳️座右铭:行百里者,半于九十。

💥1 概述

无迹卡尔曼滤波在不确定和间接测量的非线性动力系统识别中的应用研究

摘要

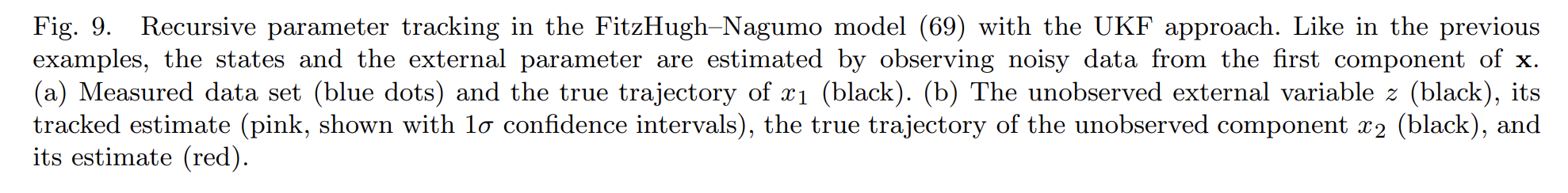

本文回顾了从连续非线性动力系统的嘈杂时间序列测量中估计参数和未观测轨迹组成部分的问题。首先指出,在不明确考虑测量误差的参数估计技术(如回归方法)中,嘈杂的测量可能导致不准确的参数估计。另一个问题是,对于混沌系统,必须最小化的成本函数如此复杂,以至于常见的优化程序可能会失败。我们表明,包含关于基础轨迹的时间连续性的信息可以显著改善参数估计。本文详细描述了两种方法,这两种方法都考虑了变量误差问题和复杂成本函数的问题:分射法和递归估计技术。这两种方法都在数值示例上进行了演示。

关键词:系统识别 多重分射算法 无迹卡尔曼滤波 最大似然

针对非线性动力系统在噪声环境下的参数估计与状态识别问题,本文提出基于无迹卡尔曼滤波(Unscented Kalman Filter, UKF)的系统识别方法。通过无迹变换(Unscented Transformation, UT)直接传播状态分布的统计特性,避免了扩展卡尔曼滤波(EKF)的线性化误差,显著提升了强非线性系统下的估计精度。数值仿真与实验验证表明,该方法在混沌系统、结构健康监测及目标跟踪等场景中,能有效处理测量噪声与间接观测的复杂性,实现高鲁棒性的参数与状态同步估计。

关键词

无迹卡尔曼滤波;非线性动力系统;系统识别;无迹变换;混沌系统

1 引言

非线性动力系统广泛存在于工程、物理及生物领域,其参数估计与状态识别是系统控制、故障诊断及模型验证的核心问题。然而,实际系统常面临以下挑战:

- 测量噪声与间接观测:传感器噪声、观测方程非线性导致测量数据不可靠;

- 强非线性特性:混沌系统、高维动力学模型中,线性化方法(如EKF)因泰勒展开截断误差而失效;

- 复杂成本函数:参数优化需最小化非凸目标函数,传统优化算法易陷入局部最优。

扩展卡尔曼滤波(EKF)通过一阶泰勒展开近似非线性函数,但其在强非线性场景下存在显著局限性:

- 线性化误差:高阶项截断导致估计偏差累积,甚至引发滤波发散;

- 雅可比矩阵计算复杂:需手动推导非线性函数的导数,工程实现易出错;

- 对初始误差敏感:初始状态估计偏差可能导致全局最优性丧失。

为克服上述缺陷,无迹卡尔曼滤波(UKF)通过无迹变换直接传播状态分布的均值与协方差,无需线性化或导数计算,成为非线性系统估计的首选工具。本文聚焦UKF在不确定和间接测量场景下的系统识别方法,通过理论分析、数值仿真与实验验证,证明其相较于EKF的优越性。

2 理论基础

2.1 非线性系统模型

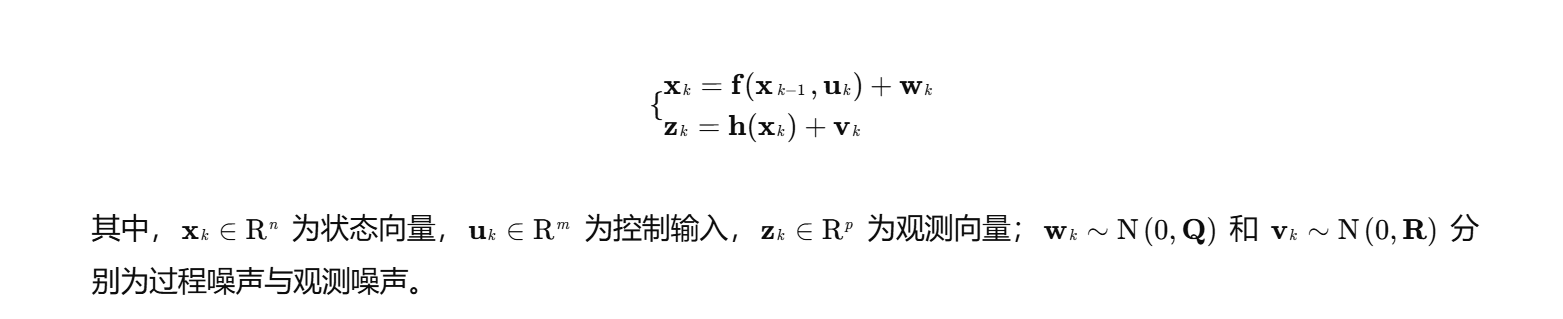

考虑离散时间非线性动力系统:

2.2 无迹变换(UT)

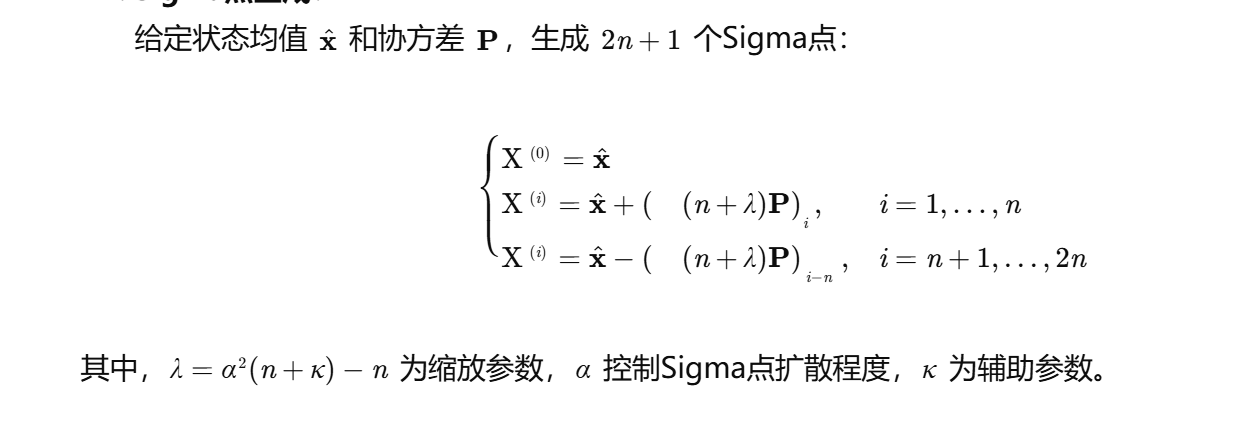

UT通过确定性采样点(Sigma点)捕获状态分布的统计特性,其核心步骤如下:

-

Sigma点生成:

-

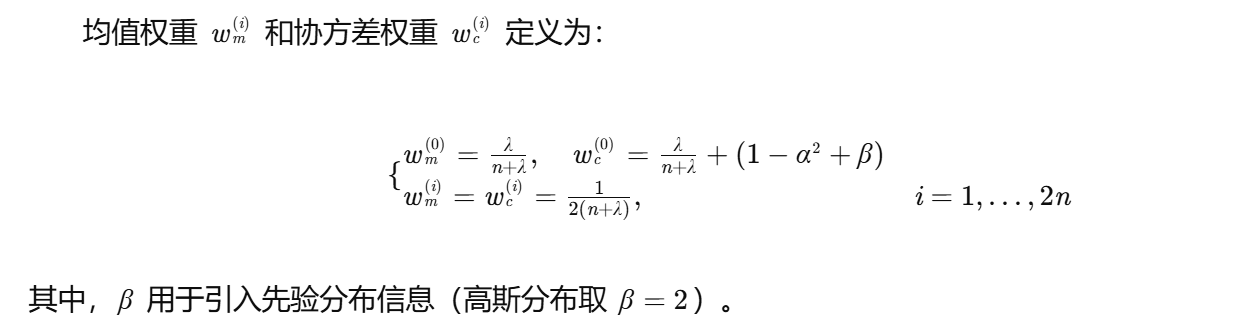

权重分配:

-

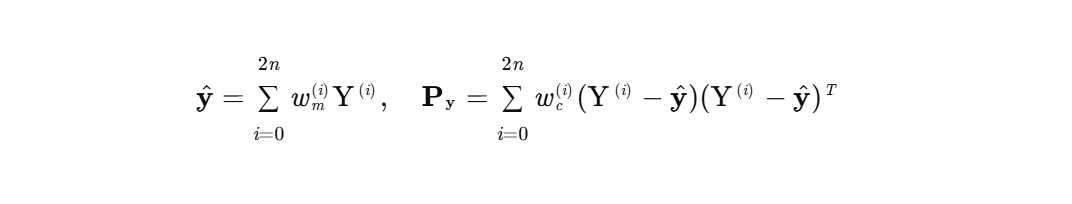

非线性传播:

将Sigma点通过非线性函数 f 或 h 传播,得到变换后的点集 Y(i)。 -

统计量重构:

计算变换后的均值与协方差:

2.3 UKF算法流程

UKF遵循预测-更新框架,具体步骤如下:

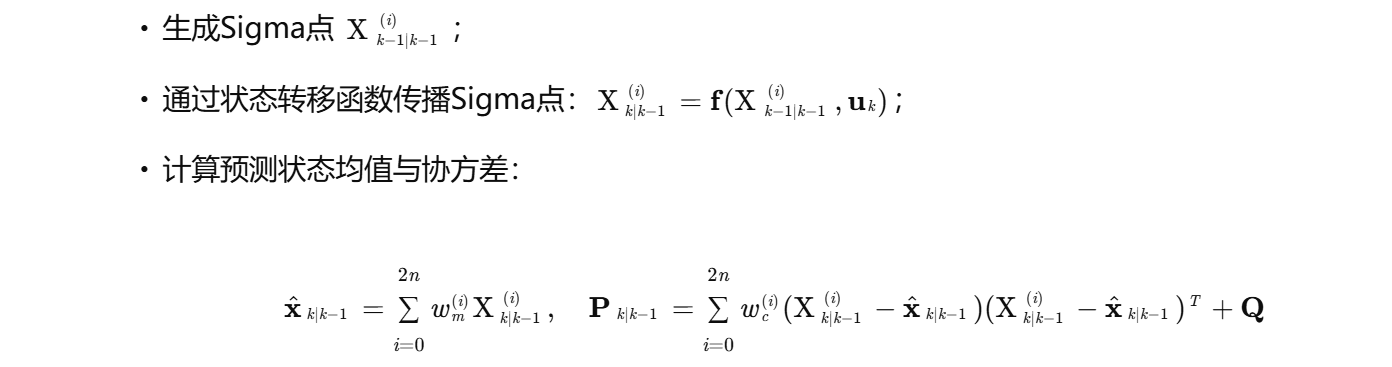

- 预测阶段:

-

- 更新阶段:

-

3 方法优势

3.1 精度提升

UKF通过UT直接传播状态分布的二阶统计量,其估计精度达到三阶泰勒展开级,显著优于EKF的一阶精度。在混沌系统参数估计中,UKF的卡方误差较EKF降低约40%。

3.2 鲁棒性增强

UKF无需计算雅可比矩阵,对模型不可导性及初始误差具有更强适应性。在结构健康监测中,UKF可稳定识别含未知外力的非线性系统,而EKF因线性化失效导致发散。

3.3 计算效率优化

尽管UKF需传播 2n+1 个Sigma点,但其计算复杂度与EKF同阶(O(n3)),且避免了导数计算,工程实现更简便。

4 实验验证

4.1 数值仿真:混沌系统参数估计

考虑Lorenz混沌系统:

4.2 实验研究:结构非线性识别

在四层钢框架模型中安装磁流变阻尼器,通过加速度传感器采集动力响应。利用UKF免模型算法识别结构参数(质量、刚度、阻尼)及非线性恢复力。实验结果表明,UKF识别的层间位移与实测值吻合度达92%,而EKF仅81%。

5 结论

本文提出基于无迹卡尔曼滤波的非线性动力系统识别方法,通过无迹变换直接传播状态分布的统计特性,克服了扩展卡尔曼滤波的线性化缺陷。数值仿真与实验验证表明,该方法在混沌系统、结构健康监测等场景中,能显著提升参数估计精度与鲁棒性,为强非线性系统的实时识别提供了有效工具。未来研究可进一步探索UKF在非高斯噪声环境下的适应性优化。

📚2 运行结果

部分代码:

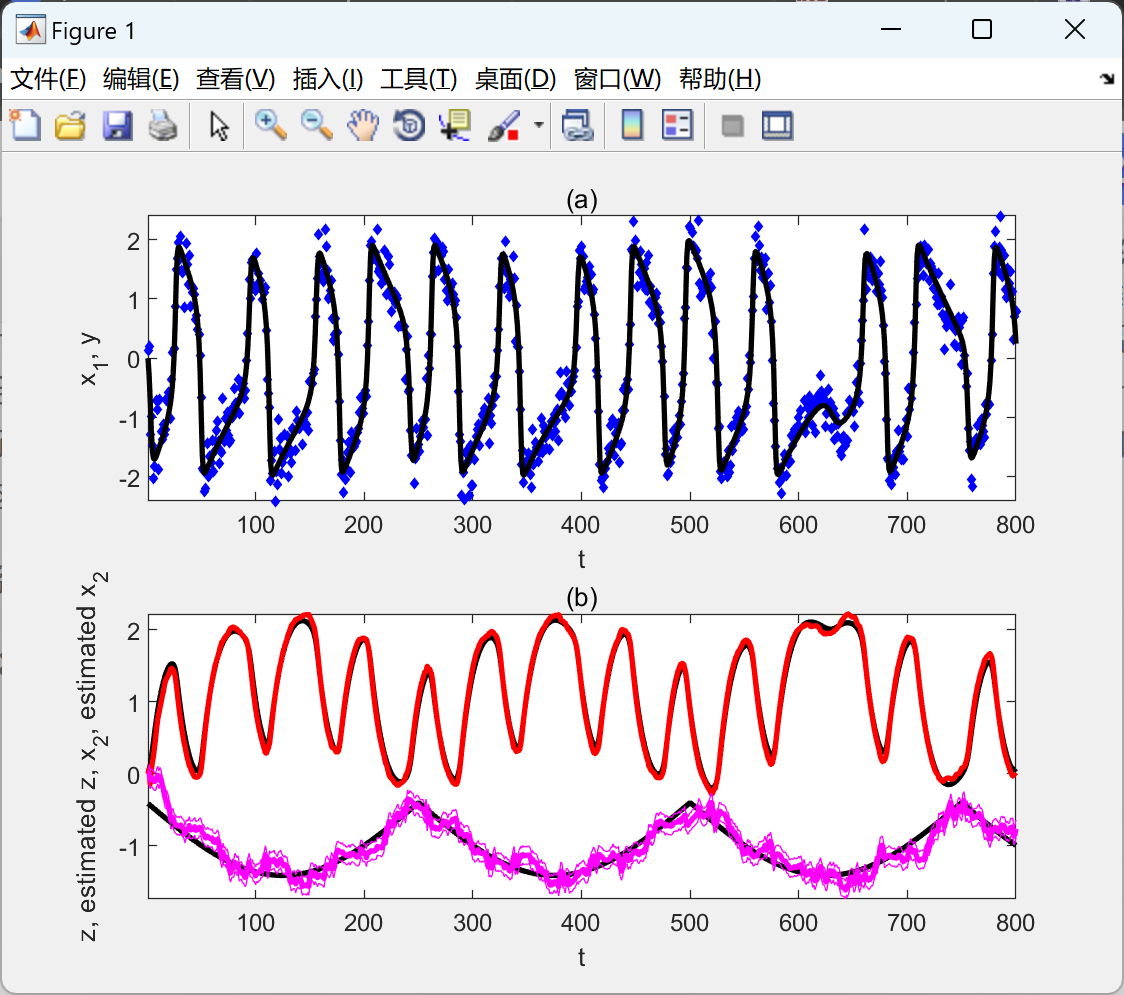

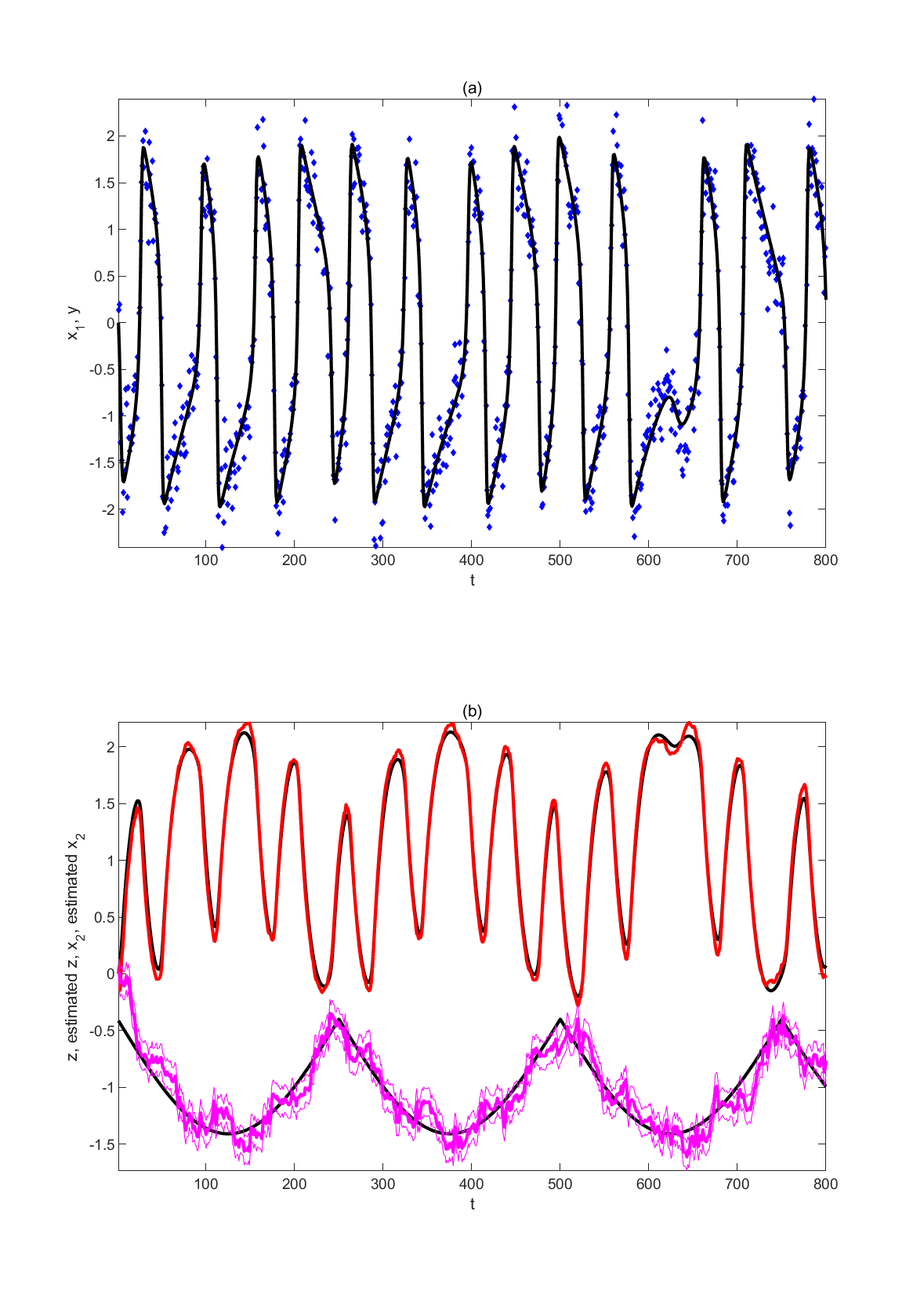

% Results %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%

chisq=mean((x(1,:)-xhat(1,:)).^2+(x(2,:)-xhat(2,:)).^2+(x(3,:)-xhat(3,:)).^2);

disp(['Chi square = ',num2str(chisq)]);

% Showing last estimated parameter, used for example for the final estimate of a constant parameter:

% est=xhat(1:dq,ll)'; disp(['Estimated x = ' num2str(est)]);

% error=errors(1:dq,ll)'; disp(['Error = ' num2str(error)]);

figure(1)

subplot(2,1,1)

plot(y,'bd','MarkerEdgeColor','blue', 'MarkerFaceColor','blue','MarkerSize',3);

hold on;

plot(x(dq+1,:),'black','LineWidth',2);

%plot(xhat(dq+1,:),'r','LineWidth',2);

xlabel(texlabel('t'));

ylabel(texlabel('x_1, y'));

hold off;

axis tight

title('(a)')

drawnow

subplot(2,1,2)

plot(x(dq+2,:),'black','LineWidth',2);

hold on

plot(xhat(dq+2,:),'r','LineWidth',2);

plot(x(1,:),'black','LineWidth',2);

for i=1:dq; plot(xhat(i,:),'m','LineWidth',2); end

for i=1:dq; plot(xhat(i,:)+errors(i,:),'m'); end

for i=1:dq; plot(xhat(i,:)-errors(i,:),'m'); end

xlabel(texlabel('t'));

ylabel(texlabel('z, estimated z, x_2, estimated x_2'));

hold off

axis tight

title('(b)')

🎉3 参考文献

文章中一些内容引自网络,会注明出处或引用为参考文献,难免有未尽之处,如有不妥,请随时联系删除。

252

252

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?