目录

ELFK= ES + logstash+filebeat+kibana

Elasticsearch 集群部署(在Node1、Node2节点上操作)

在 Logstash 组件所在节点上新建一个 Logstash 配置文件

ELFK= ES + logstash+filebeat+kibana

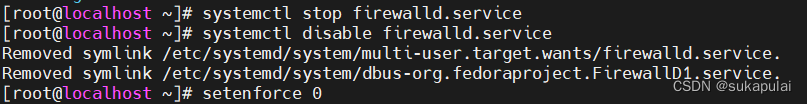

环境准备

所有节点

systemctl stop firewalld.service

systemctl disable firewalld.service

setenforce 0

Elasticsearch 集群部署(在Node1、Node2节点上操作)

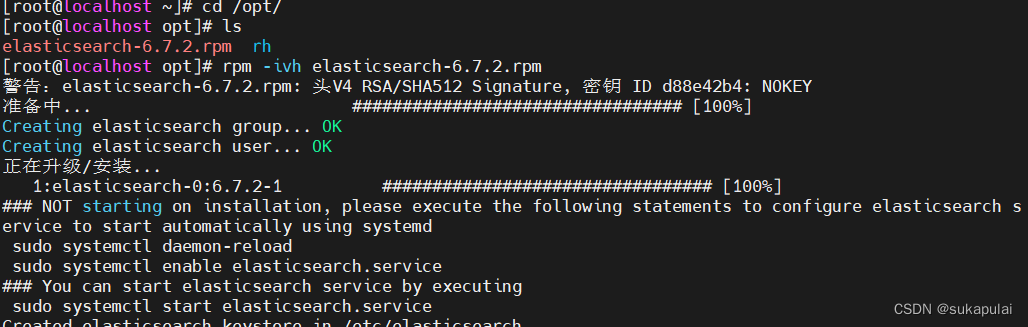

安装elasticsearch—rpm包

#上传elasticsearch-6.7.2.rpm到/opt目录下

cd /opt

rpm -ivh elasticsearch-6.7.2.rpm

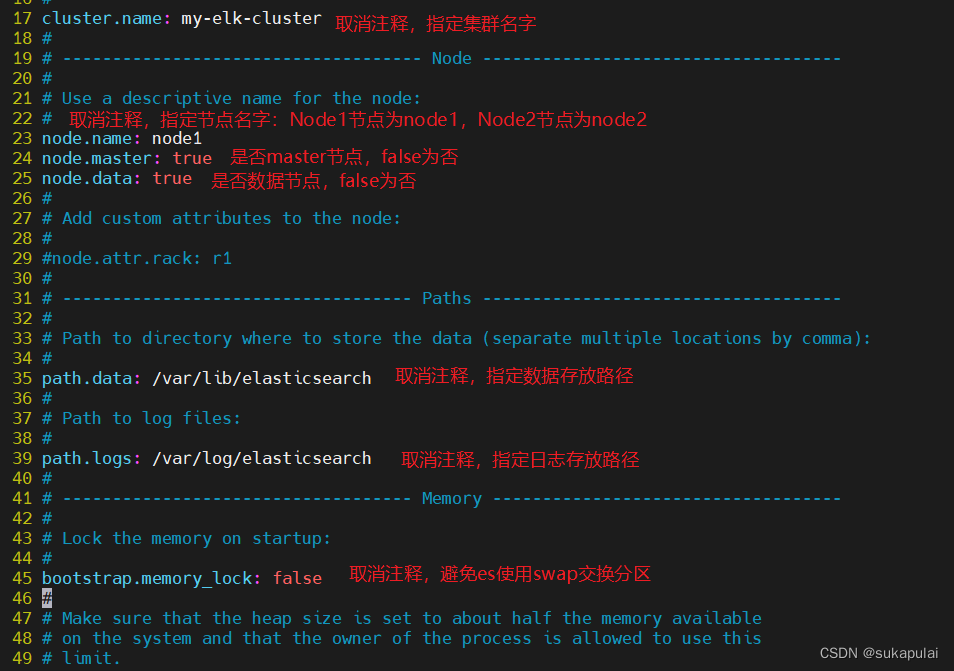

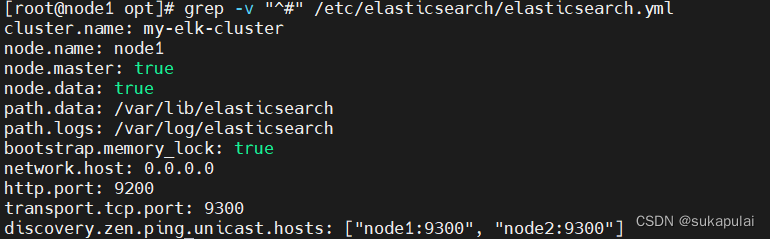

修改elasticsearch主配置文件

cp /etc/elasticsearch/elasticsearch.yml /etc/elasticsearch/elasticsearch.yml.bak

vim /etc/elasticsearch/elasticsearch.yml

--17--取消注释,指定集群名字

cluster.name: my-elk-cluster

--23--取消注释,指定节点名字:Node1节点为node1,Node2节点为node2

node.name: node1

node.master: true #是否master节点,false为否

node.data: true #是否数据节点,false为否

--35--取消注释,指定数据存放路径

path.data: /var/lib/elasticsearch

--39--取消注释,指定日志存放路径

path.logs: /var/log/elasticsearch

--45--取消注释,避免es使用swap交换分区

bootstrap.memory_lock: false

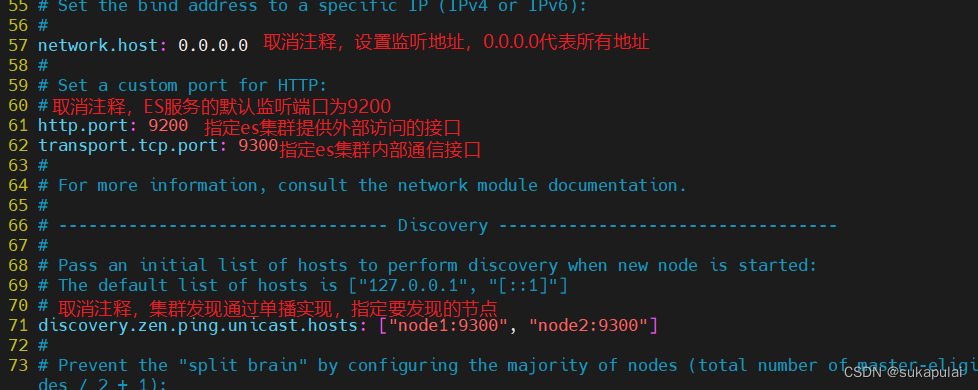

--57--取消注释,设置监听地址,0.0.0.0代表所有地址

network.host: 0.0.0.0

--51--取消注释,ES 服务的默认监听端口为9200

http.port: 9200 #指定es集群提供外部访问的接口

transport.tcp.port: 9300 #指定es集群内部通信接口

--71--取消注释,集群发现通过单播实现,指定要发现的节点

discovery.zen.ping.unicast.hosts: ["node1:9300", "node2:9300"]

grep -v "^#" /etc/elasticsearch/elasticsearch.yml

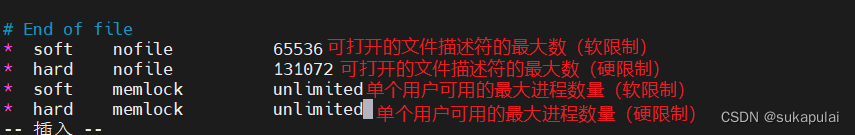

es 性能调优参数

优化最大内存大小和最大文件描述符的数量

vim /etc/security/limits.conf

......

* soft nofile 65536

* hard nofile 131072

* soft memlock unlimited

* hard memlock unlimited

systemctl daemon-reexec

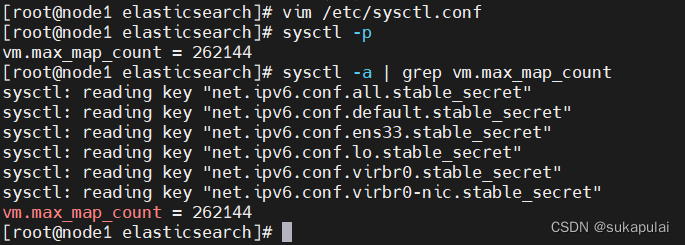

vim /etc/sysctl.conf

#一个进程可以拥有的最大内存映射区域数,参考数据(分配 2g/262144,4g/4194304,8g/8388608)

vm.max_map_count=262144

sysctl -p

sysctl -a | grep vm.max_map_count

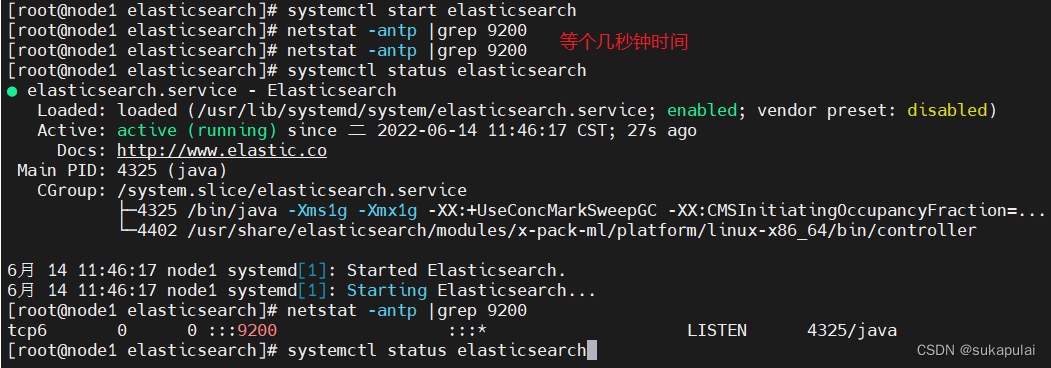

启动elasticsearch是否成功开启

systemctl start elasticsearch.service

systemctl enable elasticsearch.service

netstat -antp | grep 9200

查看节点信息

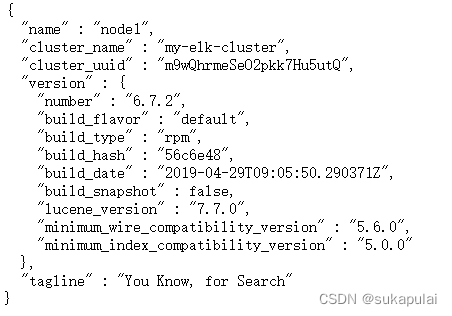

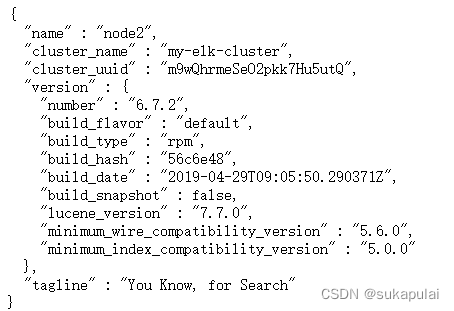

浏览器访问 http://192.168.217.100:9200 、 http://192.168.217.110:9200 查看节点 Node1、Node2 的信息

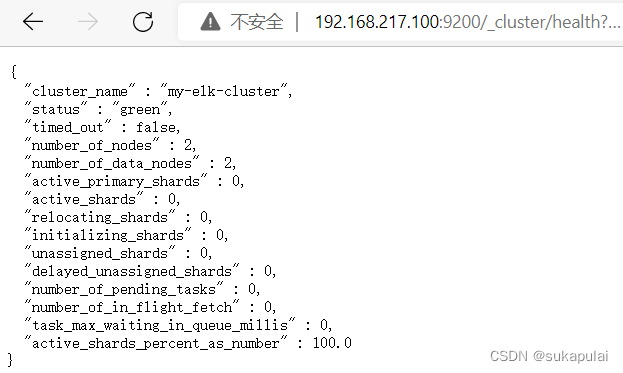

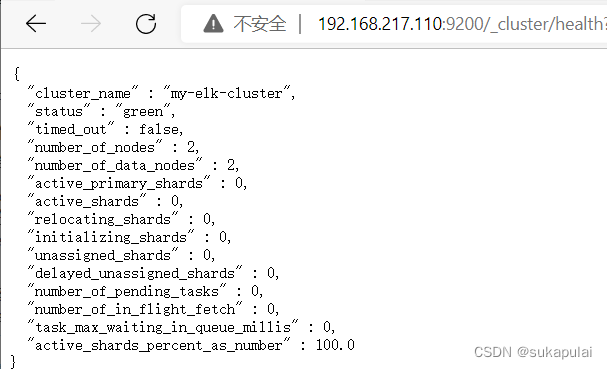

浏览器访问 http://192.168.217.100:9200/_cluster/health?pretty 、 http://192.168.217.110:9200/_cluster/health?pretty看群集的健康情况,可以看到 status 值为 green(绿色), 表示节点健康运行。

浏览器访问

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1099

1099

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?