本博客仅为学习笔记。

梯度下降法

有函数 x(θ) ,梯度下降法的迭代公式为:

xk+1=xk−agk

其中 gk 为 x(θ) 在x_k点的导数。

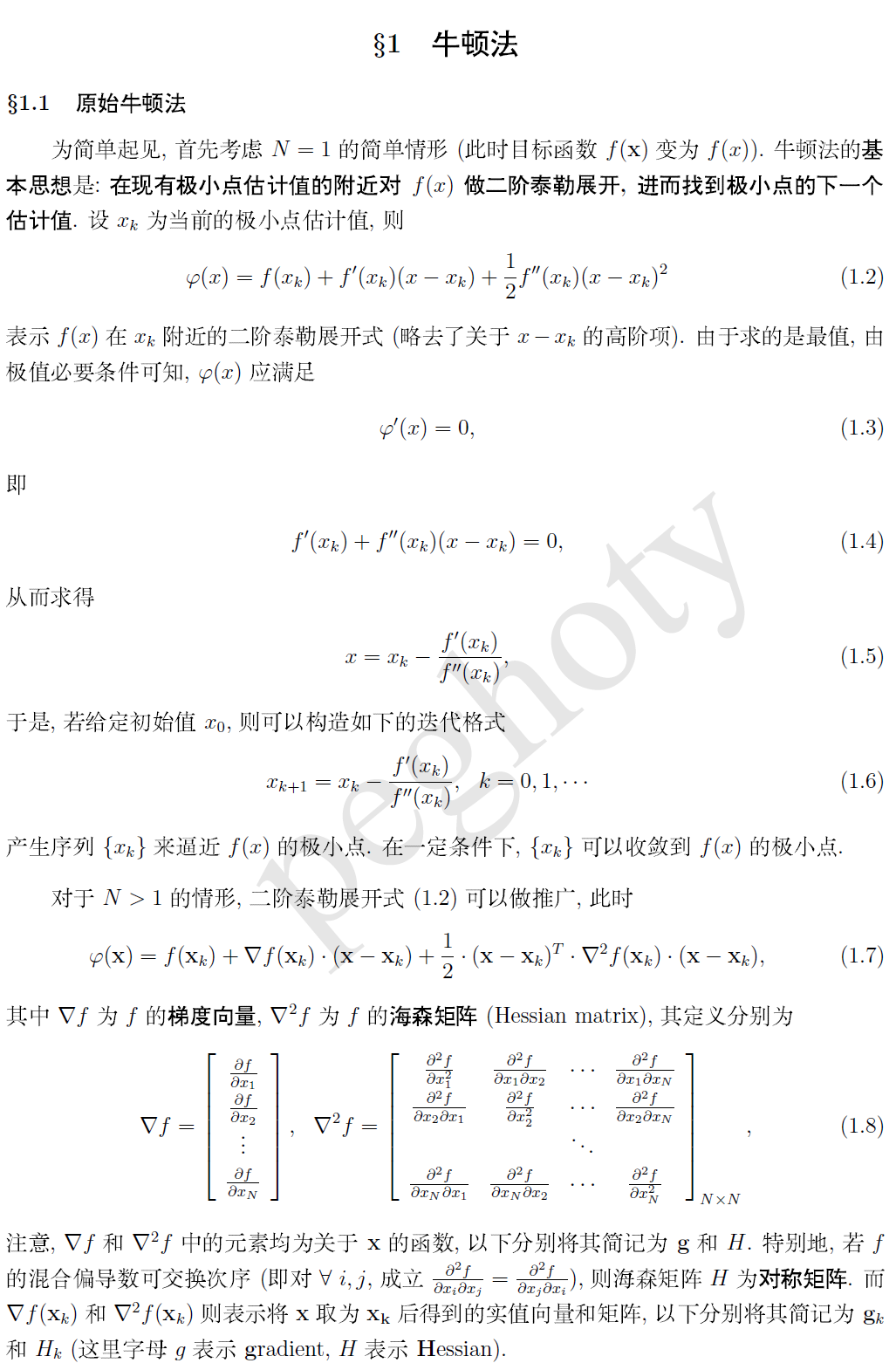

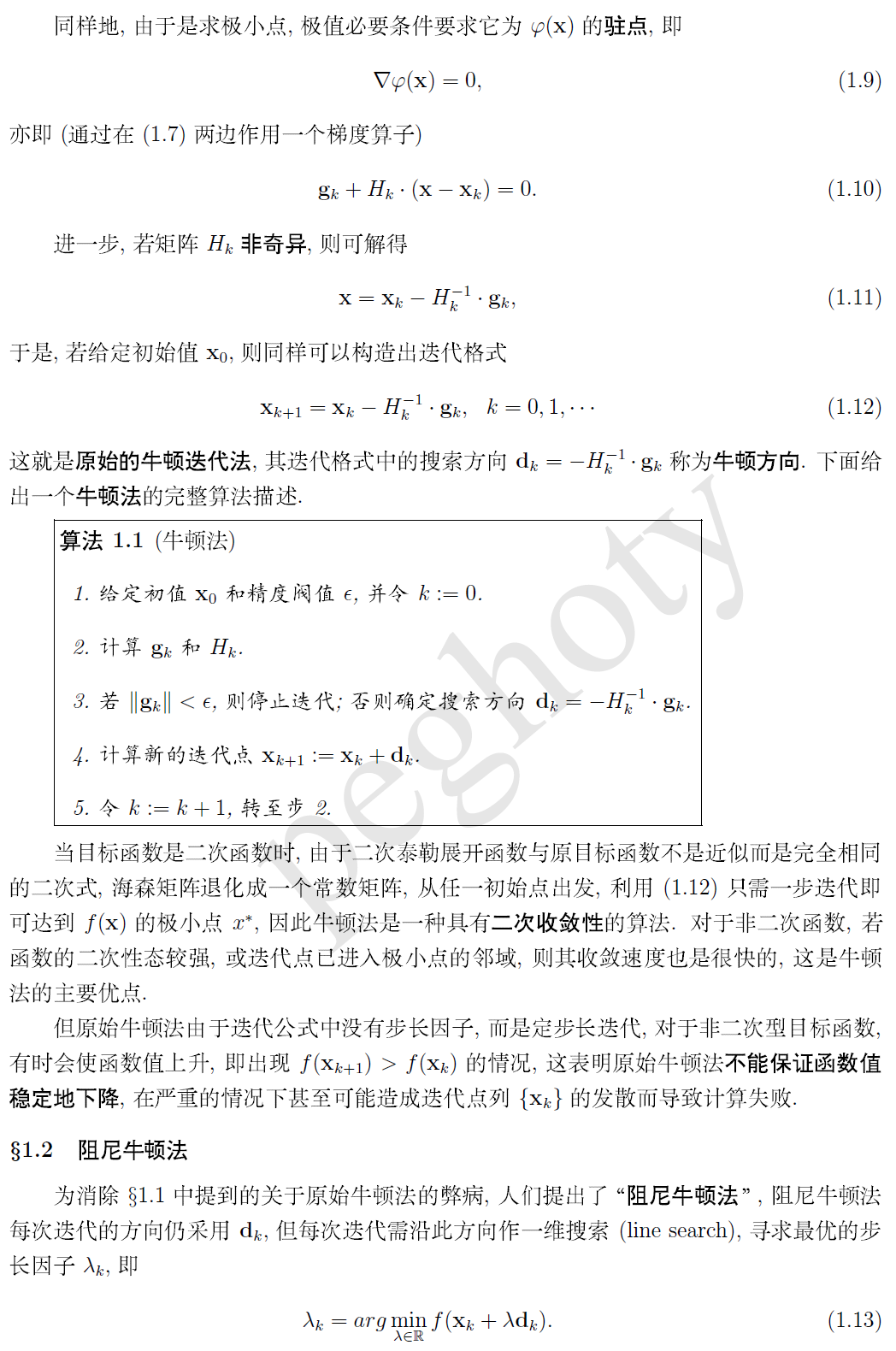

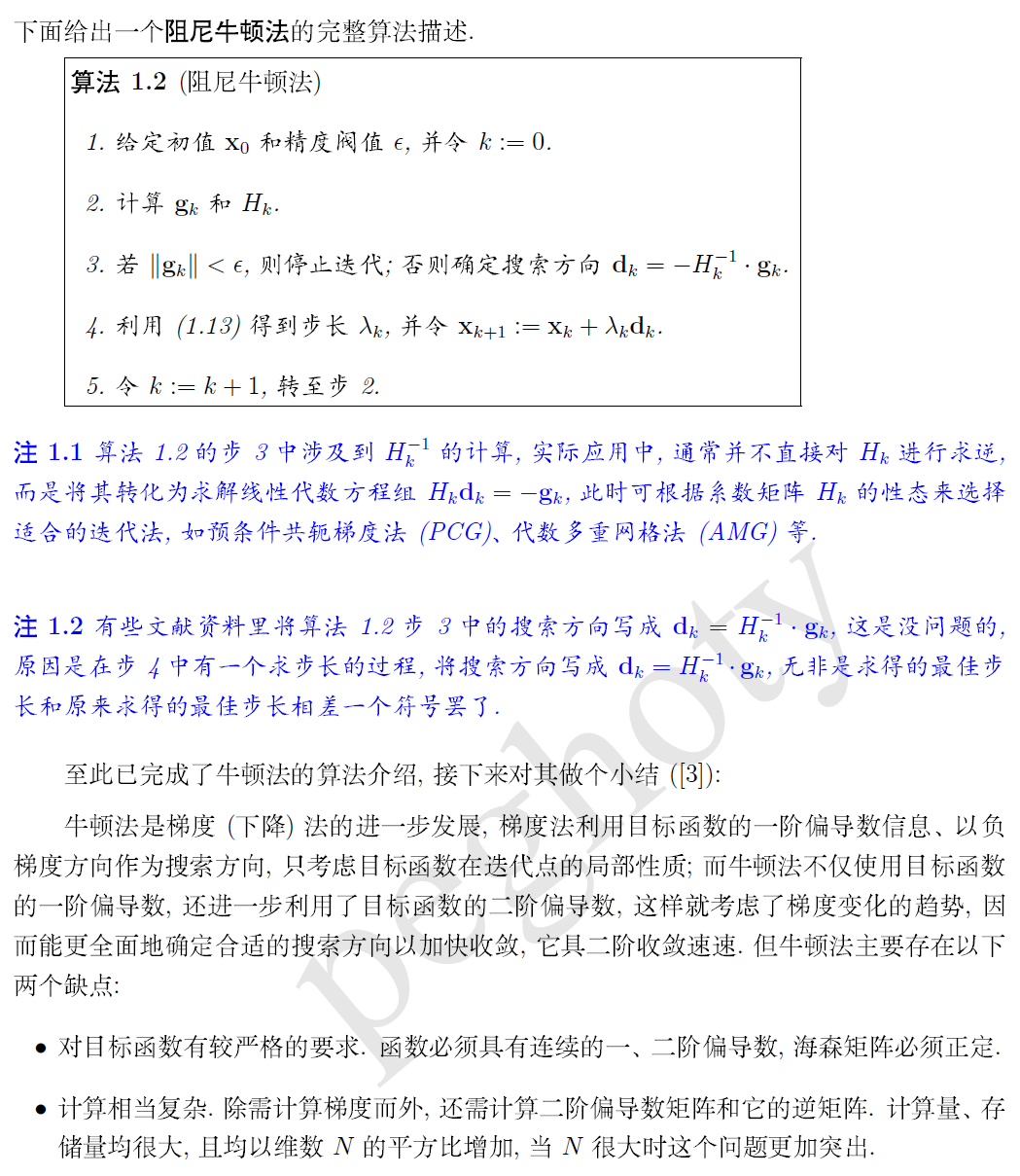

牛顿法

当x为标量时

xk+1=xk−x′x′′

当x为向量时:

xk+1=xk−H−1kgk

其中 H−1 为 Hession矩阵的逆函数,g为一阶导数向量。

L-BFS

在牛顿法中,每次都需要求

H−1k

, 每次求二阶导数,再求逆矩阵这个计算量是很大的。所以有人考虑使用迭代计算的方法计算每一个

H−1k

, 令

Bk=H−1k

找出一个公式 ,使得

Bk+1=Bk+δ

求出这个迭代用的 δ 。

1625

1625

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?