离散化是程序设计中一个非常常用的技巧,它可以有效地降低时间复杂度。其基本思想就是在众多可能的情况中“只考虑我需要用到的值”。下面用几个例子说明,如何运用离散化改进一个低效的,甚至根本不可能实现的算法。

先看UVA10173

[ http://acm.uva.es/p/v101/10173.html ]

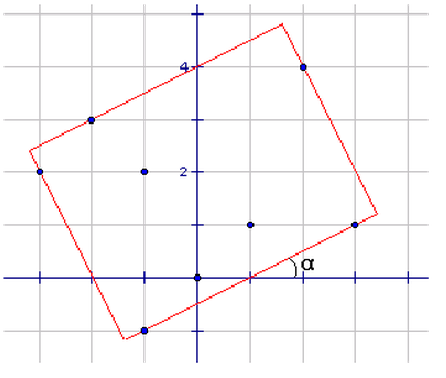

题目意思很简单,给定平面上n个点的坐标,求能够覆盖这些点的最小的矩形面积。

由于不知道这个矩形到底有倾斜多少度,所以先从倾斜0度的矩形开始考虑:要使覆盖这些点的矩形面积最小,那么这个矩形的每一条边上必定都存在至少一个点。转换成代码就是:对于所有的点坐标进行查找,选出其中x最小,y最小,x最大,y最大的值,所围成的矩形就是当前倾角为0°时的最小面积。

然而这只考虑当倾角为0°时的情况,想要求出所有可能的情况,当然是很自然地想到,枚举所有矩形可能的倾角,对于每一个倾角,都能计算出最小的矩形面积,最后取其中的最小值。

这个算法是否是正确的呢?且不说是否正确,它从理论上甚至根本不可能实现。矩形的倾角是一个实数,它有无数种可能,你永远不可能枚举出每一种可能的情况。也就是说,这个倾角是一个连续的变量,“连续”自然是无法枚举倾角的根本原因。我们需要一种方法,把这个连续的变量变成一个一个的值,也就是“离散”的变量。这个过程就是我们所说的离散化。

经过思考可以证明,最小面

离散化是程序设计中降低时间复杂度的有效方法。通过将连续变量转化为离散值,可以解决无法枚举的问题。文章通过UVA10173题目的例子,说明如何使用离散化解决寻找最小矩形面积的问题。此外,还介绍了在处理大范围坐标和小数量矩形覆盖问题时,如何通过离散化降低二维数组的规模,从而减少空间复杂度。离散化思想的关键在于将无限可能性归纳到有限空间,优化算法效率。

离散化是程序设计中降低时间复杂度的有效方法。通过将连续变量转化为离散值,可以解决无法枚举的问题。文章通过UVA10173题目的例子,说明如何使用离散化解决寻找最小矩形面积的问题。此外,还介绍了在处理大范围坐标和小数量矩形覆盖问题时,如何通过离散化降低二维数组的规模,从而减少空间复杂度。离散化思想的关键在于将无限可能性归纳到有限空间,优化算法效率。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?