笔者刚开始学习Andew Ng老师的机器学习课程,由于自己基础不是很好,写的笔记可能会出现一些错误,欢迎大家批评指正,互相交流。

第一个note主要讲了监督学习,分为四个部分:线性回归、逻辑回归(分类问题)、广义线性模型。监督学习,顾名思义,就是在有指导方向(就是输出y)的前提下学习,也就是说在训练集中每个样本都有对应的输出。学习的过程就是找出输入和输出(也称目标变量)的映射函数,这个函数就叫假设。当目标变量是连续的,这个学习过程称为回归;当目标变量是离散的,就是分类问题。整个课程介绍了学习模型,损失函数的定义以及原因,最后一节说明了线性回归和逻辑回归中假设函数 h 形式提出的根据 。

Linear regression

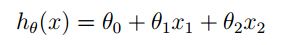

作者举了个预测房屋价格的例子。给出一些房屋的面积和每个卧室间数(两个特征)以及它们的价格,要求出一个假设/函数h 来预测另外的房屋价格:

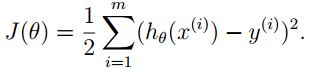

再定义一个损失函数来评价这个假设逼近实际价格y的程度:

我们的目的就是求出使J(θ)最小的θ,代入h 算出来的就是预测的房屋价格。要使 J 最小,有两种方法,梯度下降和Normal Equation。

1. LMS algorigthm(Widrow-Hoff or Least Mean Squares)

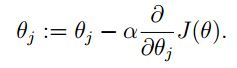

梯度下降算法,它可以每次都在 J 下降最快的方向迭代,直到达到最小值。它的参数更新规则是:

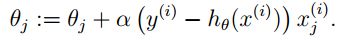

其中α是学习速率。假设只有一个样本,计算出

这个公式就是LMS更新规则。要扩展到多个训练样本,有两种方式:

本文是作者学习Andrew Ng机器学习课程的笔记,主要涵盖线性回归和逻辑回归。线性回归部分讲解了LMS算法、正规方程、概率解释和局部加权线性回归。逻辑回归则涉及梯度上升法和另一种最大化似然函数的算法。此外,还介绍了广义线性模型的基本概念。

本文是作者学习Andrew Ng机器学习课程的笔记,主要涵盖线性回归和逻辑回归。线性回归部分讲解了LMS算法、正规方程、概率解释和局部加权线性回归。逻辑回归则涉及梯度上升法和另一种最大化似然函数的算法。此外,还介绍了广义线性模型的基本概念。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?