最近正在看递归神经网络,看了网上很多博文,算是鱼龙混杂,并且基本都是使用Python实现,要不就是使用Matlab中的函数库newelm()等。对于使用Matlab的同学,甚为不方便。所以我将结合实例,使用matlab语言,完成Elman递归神经网络程序的编写(BPTT)。本人菜鸡一枚,如有错误还望各路大神,指正教导。另外,关于理论推导算法步骤,等我过几天有时间更新。

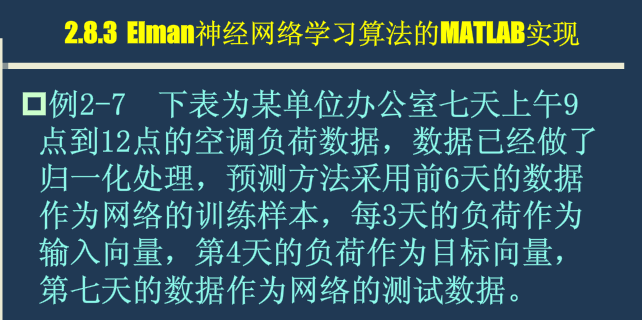

一、问题描述

二、相关数据

三、程序代码:`

Elman_BPTT_mian.m

%%%使用BPTT算法完成Elman网络的训练

%%%作者:xd.wp

%%%时间:2016.10.06 16:44

%% 程序说明

% 1、数据为7天,四个时间点的空调功耗,用前三个推测第四个训练,依次类推。第七天作为检验

% 2、Elman网络输入结点为12,输出结点为4个,隐藏结点18个

clear all;

clc;

%% 加载数据并进行归一化处理

[train_data,test_data]=Elman_data_process();

data_length=size(train_data,1); %每个样本的长度

data_num=size(train_data,2); %样本数目

%% 网络参数初始化

%结点数目设置

input_layer_num=data_length;

hidden_layer_num=18;

output_layer_num=size(test_data,1);

%权重初始化

weight_input_hidden=rand(hidden_layer_num,input_layer_num)/1000;

weight_prehidden_hidden=rand(hidden_layer_num,hidden_layer_num)/1000;

weight_hidden_output=rand(output_layer_num,hidden_layer_num)/1000;

output_state=zeros(output_layer_num,3);

%% 网络训练学习部分 采用BPTT算法

yita=0.001; %每次迭代的步进

for num=1:4000

for t=1:3 %%时间步,使用三推一

%从输入到隐层

if (t==1)

pre_hidden_state=weight_input_hidden*train_data(:,t);

else

pre_hidden_state=weight_input_hidden*train_data(:,t)+weight_prehidden_hidden*hidden_state(:,t-1);

这篇博客介绍了如何在MATLAB中实现Elman递归神经网络,通过BPTT(Backpropagation Through Time)算法进行训练。作者分享了程序代码,包括`Elman_BPTT_mian.m`、`Elman_data_process.m`和`updata_weight.m`,并展示了程序结果和Error_cost曲线图,讨论了初次预测时由于缺乏历史信息导致的误差问题。

这篇博客介绍了如何在MATLAB中实现Elman递归神经网络,通过BPTT(Backpropagation Through Time)算法进行训练。作者分享了程序代码,包括`Elman_BPTT_mian.m`、`Elman_data_process.m`和`updata_weight.m`,并展示了程序结果和Error_cost曲线图,讨论了初次预测时由于缺乏历史信息导致的误差问题。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

7650

7650

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?