首先要了解kafka的理论基本概念,否则看起来可能会读不懂的。建议先网上学习一下kafka基础知识。能看懂下面的图

集群的搭建-主要是kafka集群(broker) 与 zookeeper

注意:启动时要先启动zookeeper再启动broker(即kafka主机)(代理机器较多,写shell脚本一键启动)

关闭时先关闭broker 再关闭zookeeper

(上图右下角,0.9版本以后offset存储在本地意思是存储在kafka集群,可能是某个topic下面,所以查询命令也有所不同)

在服务器上安装kafka(官网下载源码包,解压即可)

接下来重点是修改 配置文件哦

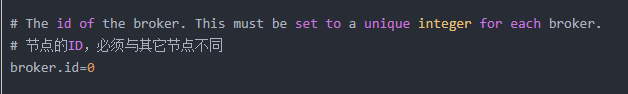

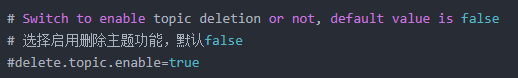

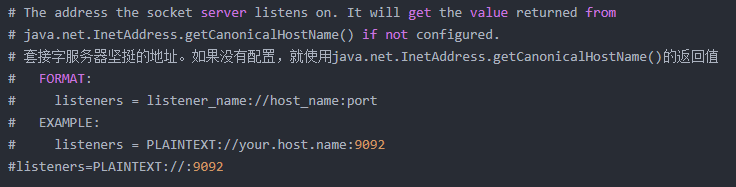

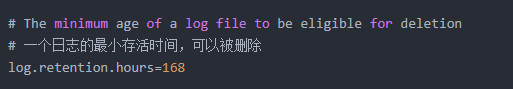

(重头戏来了kafka/config/server.properties,说一下可能需要我们修改的参数)

broker.id 只能是整型数字,每个kafka服务器的id都不同。所以每个都要单独修改哦。

监听服务及端口

log.dirs 这个目录其实是存储的数据信息,不是kafka的日志文件!

数据保存时间

zookeeper.connect 配置zk信息,如果需配置多个用逗号分割。

配置修改好之后

想配置也可以配置一下环境变量。

分发安装包 xsync kafka/ (分发完以后去其它的服务器上修改配置文件里的broker.id)

接下来先启动zookeeper

启动命令:zk.sh start

查看一下kafka的命令都有哪些。进入kafka的bin目录。了解一下常用的就可以了。

启动命令(守护进程模式启动):

kafka-server-start.sh -daemon config/server.properties后面就是上面修改的配置文件(server.properties)

关闭命令:kafka-server-stop.sh stop挨个启动太麻烦了,写个群起脚本吧,写法如下:

kafka 群起脚本:

#!/bin/bash

case $1 in

"start"){

for i in hadoop102 hadoop103 hadoop104

do

echo "***************$i****************"

ssh $i "/opt/module/kafka/bin/kafka-server-start.sh --daemon /opt/modele/kafka/config/server.properties"

done

};;

"stop"){

for i in hadoop102 hadoop103 hadoop104

do

echo "***************$i****************"

ssh $i "/opt/module/kafka/bin/kafka-server-stop.sh"

done

};;

esac

保存为test.sh

chmod 777 test.sh (赋权限)

执行:

test.sh start

test.sh stop

博主准备以后一遍学习,一遍整理分享学习笔记,感兴趣的小伙伴扫码关注我的公众号吆。

230

230

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?