Nutch笔记

1.学习nutch的启动shell脚本分析

$NUTCH_HOME/runtiom/deploy/bin/nutch

这是nutch在hadoop上运行时的启动脚本,有一个nutch.job 文件,就是把这个文件放在hadoop上运行的

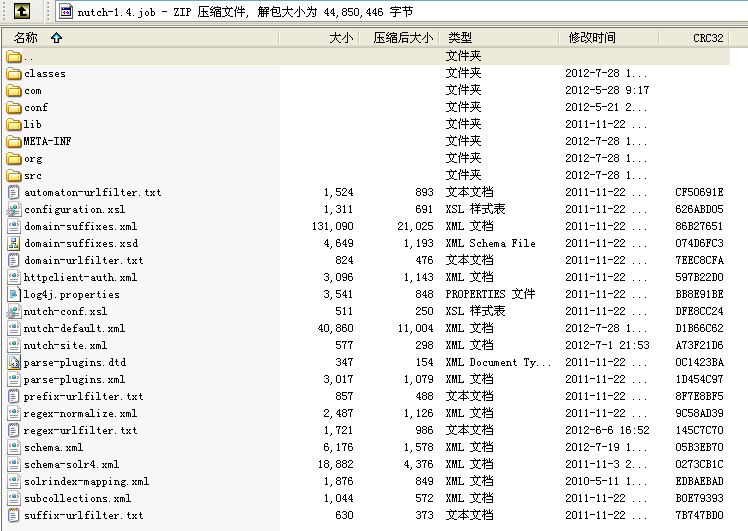

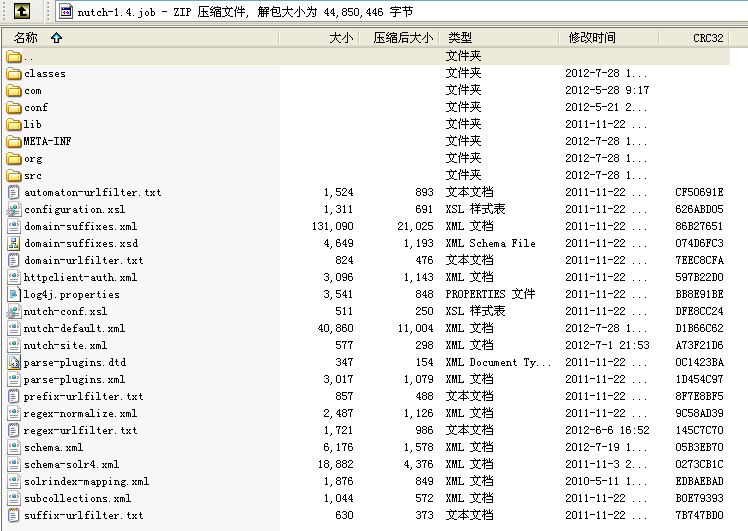

如上图所示为nutch1.4的内容,所以在改变nutch 的配置文件后需要Ant重新编译,把.job文件替换。

下面开始看脚本源代码

# resolve links - $0 may be a softlink

THIS="$0"

while [ -h "$THIS" ]; do

#文件存在并是一个符号链接

ls=`ls -ld "$THIS"`

link=`expr "$ls" : '.*-> \(.*\)$'`

#匹配一个链接文件

if expr "$link" : '.*/.*' > /dev/null; then

#隐藏文件

THIS="$link"

else

THIS=`dirname "$THIS"`/"$link"

fi

done

看注释可以知道这是防止$0是软连接。

expr :求表达式变量 ,上面是正则匹配,匹配所有链接文件->

dirname :获得路径 如果是dirname /home/zal 为/home

/home/zal/test.sh 为/home/zal

if [ $# = 0 ]; then

#很明显判断参数个数

。。。。。。。。

# get arguments

COMMAND=$1

#运行哪个命令 nutch Crawl

shift

# some directories

THIS_DIR=`dirname "$THIS"`

#获得脚本的目录

NUTCH_HOME=`cd "$THIS_DIR/.." ; pwd`

#返回上一层目录 pwd 将nutch.job的目录找到

# some Java parameters

if [ "$NUTCH_JAVA_HOME" != "" ]; then

#设置的环境变量

#echo "run java in $NUTCH_JAVA_HOME"

JAVA_HOME=$NUTCH_JAVA_HOME

fi

if [ "$JAVA_HOME" = "" ]; then

echo "Error: JAVA_HOME is not set."

#所以运行nutch必须要设置这两个环境变量之一

exit 1

fi

local=true

#默认是在本地运行 看下面参数运用

# NUTCH_JOB

if [ -f ${NUTCH_HOME}/nutch-*.job ]; then

#判断job存在与否,存在就是在hadoop上运行,最后执行的时候

用hadoop的命令

local=false

for f in $NUTCH_HOME/nutch-*.job; do

#获得文件名

NUTCH_JOB=$f;

done

fi

# cygwin path translation

if $cygwin; then

#这个应该是在window环境下用的吧

NUTCH_JOB=`cygpath -p -w "$NUTCH_JOB"`

fi

JAVA=$JAVA_HOME/bin/java

#这个要注意设置JAVA_HOME

JAVA_HEAP_MAX=-Xmx1000m #虚拟机所占内存吧

# check envvars which might override default args

if [ "$NUTCH_HEAPSIZE" != "" ]; then

#echo "run with heapsize $NUTCH_HEAPSIZE"

JAVA_HEAP_MAX="-Xmx""$NUTCH_HEAPSIZE""m"

#echo $JAVA_HEAP_MAX

fi

# CLASSPATH initially contains $NUTCH_CONF_DIR, or defaults to $NUTCH_HOME/conf

CLASSPATH=${NUTCH_CONF_DIR:=$NUTCH_HOME/conf}

CLASSPATH=${CLASSPATH}:$JAVA_HOME/lib/tools.jar

# so that filenames w/ spaces are handled correctly in loops below

IFS=

#IFS的全名为Internal Field Separator,用来在变量扩展后进行单词分割,其默认值是

#<spaces><tab><newline>

#防止修改过IFS,真全面

# add libs to CLASSPATH

#在本地运行时,要把nutch用到的jar加到classpath中

if $local; then

for f in $NUTCH_HOME/lib/*.jar; do

CLASSPATH=${CLASSPATH}:$f;

done

# local runtime

# add plugins to classpath

#把各种插件加入classpath

if [ -d "$NUTCH_HOME/plugins" ]; then

CLASSPATH=${NUTCH_HOME}:${CLASSPATH}

fi

fi

# restore ordinary behaviour

unset IFS

#恢复

# default log directory & file

if [ "$NUTCH_LOG_DIR" = "" ]; then

NUTCH_LOG_DIR="$NUTCH_HOME/logs"

fi

if [ "$NUTCH_LOGFILE" = "" ]; then

NUTCH_LOGFILE='hadoop.log'

fi

#Fix log path under cygwin

if $cygwin; then

NUTCH_LOG_DIR=`cygpath -p -w "$NUTCH_LOG_DIR"`

fi

NUTCH_OPTS="$NUTCH_OPTS -Dhadoop.log.dir=$NUTCH_LOG_DIR"

NUTCH_OPTS="$NUTCH_OPTS -Dhadoop.log.file=$NUTCH_LOGFILE"

# figure out which class to run

#下面就是制定要执行的类 其实用case是不是好点呢

if [ "$COMMAND" = "crawl" ] ; then

CLASS=org.apache.nutch.crawl.Crawl

。。。。。。。。。。。。。

# distributed mode

#很显然 在hadoop上运行

EXEC_CALL="hadoop jar $NUTCH_JOB"

if $local; then

#这边可以看到直接运行java命令执行类,classpath必须要指定正确,可以在

#local/lib下找到所有包,如果你修改了nutch源码,必须重新编译,替换下面的nutch.jar

EXEC_CALL="$JAVA $JAVA_HEAP_MAX $NUTCH_OPTS -classpath $CLASSPATH"

else

# check that hadoop can be found on the path

#这边hadoop_home一定要指定啊

if

[ $(which hadoop | wc -l ) -eq 0 ]; then

#以后写脚本记得判断环境变量有没有设置

echo "Can't find Hadoop executable. Add HADOOP_HOME/bin to the path or run in local mode."

exit -1;

fi

fi

# run it

exec $EXEC_CALL $CLASS "$@" #exec shell中运行命令

184

184

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?