一. eclipse 中 hadoop 环境部署概览

eclipse 中部署 Hadoop 包括两大部分:Hdfs 环境部署和 MapReduce 任务执行环境部署。一般 Hdfs 环境部署比较简单,部署后就可以在 eclipse 中像操作 windows 目录一样操作 Hdfs 文件。而 MapReduce 任务执行环境的部署就比较复杂一点,不同版本对环境的要求度高低不同就导致部署的复杂度大相径庭。例如 Hadoop1 包括以前的版本部署就比较简单,可在 Windows 和 Linux 执行部署运行,而 Hadoop2 及以上版本对环境要求就比较严格,一般只能在 Linux 中部署,如果需要在 windows 中部署需要使用 cygwin 等软件模拟 Linux 环境,该篇介绍在 Linux 环境中部署 Hadoop 环境。该篇假设 hadoop2.5.0-cdh5.3.2 集群已经部署完成,集群访问权限为 hadoop5 用户。这种在 eclipse 上操作 Hdfs 和提交 MapReduce 任务的方式为 Hadoop 客户端操作,故无须在该机器上配置 Hadoop 集群文件,也无须在该机器上启动 hadoop 相关进程。

二. 前期准备

1. 下载部署 eclipse

下载 eclipse ,笔者所用版本为 eclipse-jee-juno-SR2-linux-gtk-x86_64.tar

下载地址为:链接:http://pan.baidu.com/s/1qWVQbLi 密码:ea08

解压后,将 eclipse 压缩包放置在当前用户的 /home/hadoop5/softwares/tar_packages 路径下,然后解压到 ~/softwares/ 的路径下

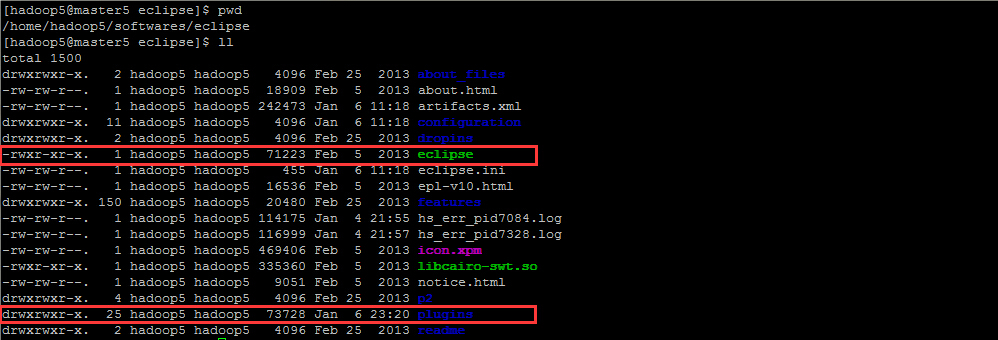

tar -zxvf eclipse-jee-juno-SR2-linux-gtk-x86_64.tar.gz -C ~/softwares/解压后的 eclipse 的路径目录如下图所示:

2. 下载插件

插件用的是 hadoop-eclipse-plugin-2.5.1.jar

下载地址:http://download.csdn.net/detail/u011414200/9390800

将自己打包或者下载的 hadoop-eclipse 直接的插件导入 eclipse 的 plugins 目录(复制进去即可),该篇使用直接下载的插件 hadoop-eclipse-plugin-2.5.1.jar,然后启动 eclipse。

./eclipse 打开 eclipse 后,出现进程 org.eclipse.equinox.launcher_1.3.0.v20120522-1813.jar

Note: 建议安装第三方插件 FatJar,点击这里查看

三. 配置 Hadoop 开发环境

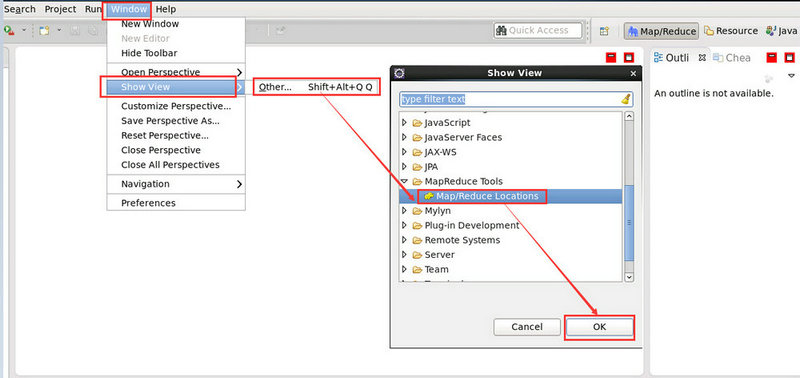

1. 切换到 Hadoop 的编程主界面

Window -> Show View -> Other -> Map/Reduce Locations

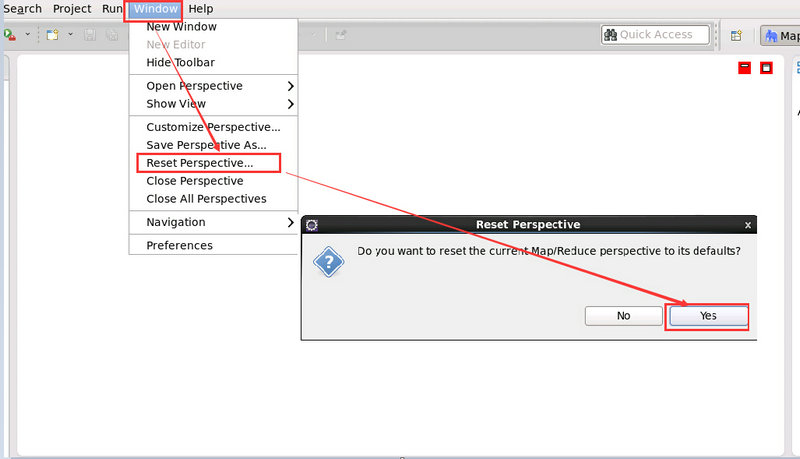

然后恢复到初始的 MapReduce 的编程界面

Window -> Reset Perspective -> Yes

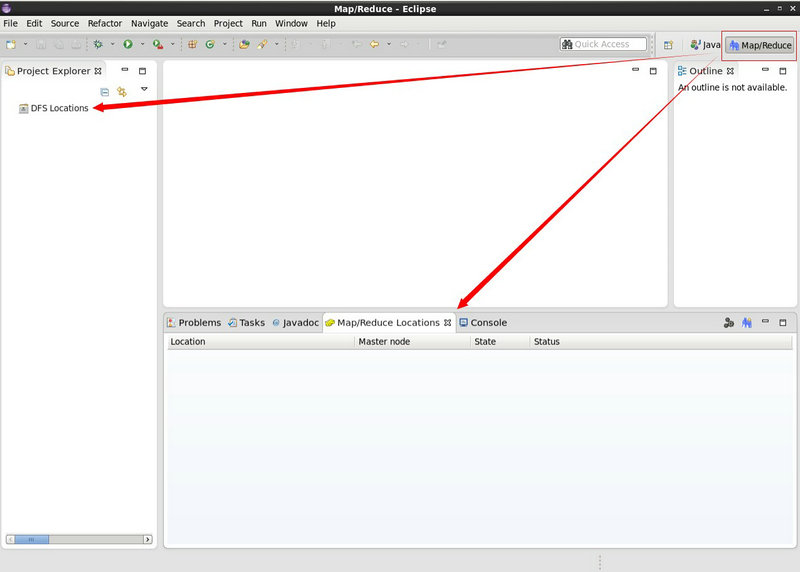

2. 可见 Hadoop-eclipse 插件已生效

将下载的 hadoop-eclipse-plugin-2.5.1.jar 文件放到 Eclipse 的 plugins 目录下,重启 Eclipse 即可看到该插件已生效,一个是 DFS 显示的位置,一个是 mapreduce 显示的位置,具体如下图所示:

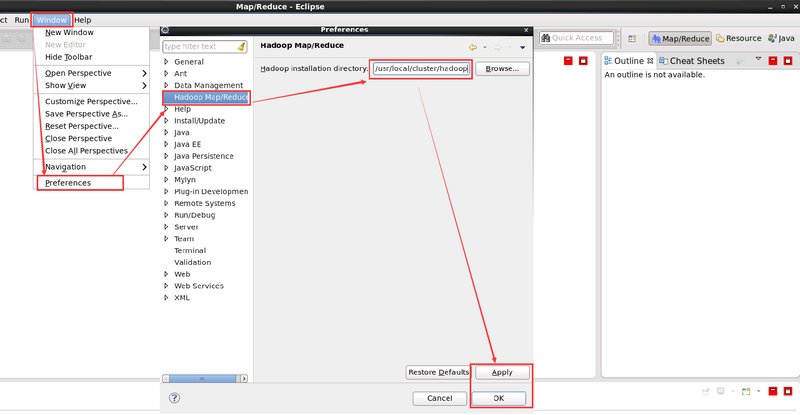

3. 选择 Hadoop 安装目录

在 eclipse 中配置 hadoop 安装目录:

Window—>Preference,选择 Hadoop Map/Reduce

红线圈出的部分为 Hadoop 的安装目录

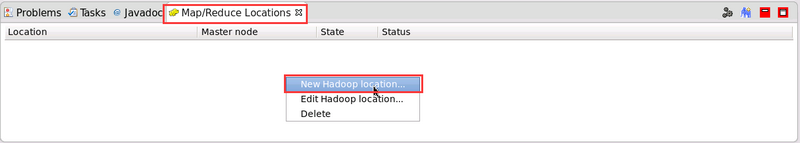

4. 创建 New hadoop location

在 MapReduce Locations 出处点击右键新建 mapreduce 配置环境,具体图示如下:

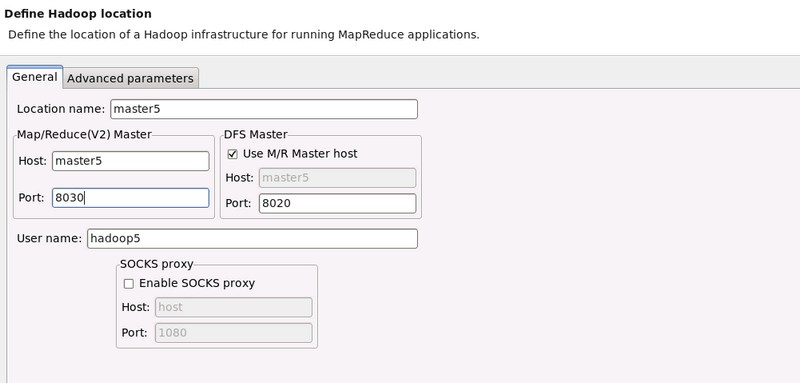

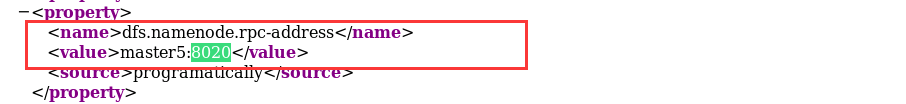

5. 配置新建的 New hadoop location

进入 mapreduce 配置环境,具体如下图所示。

- Location name 可任意填写

- Map/Reduce(V2) Master 中 Host 为 ResourceManager 机器 ip

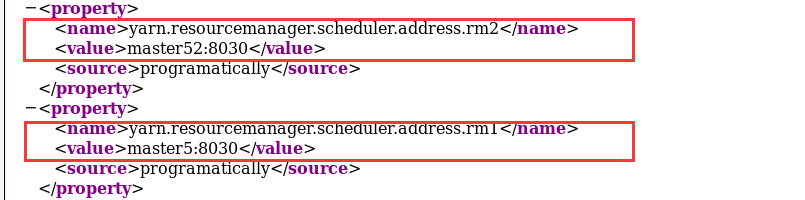

- Map/Reduce(V2) Master 中 Port 为 ResourceManager 接受任务的端口号,即 yarn-site.xml 文件中yarn.resourcemanager.scheduler.address配置项中端口号

- DFS Master 中的 Host 为 NameNode 机器 ip,Port 为 core-site.xml 文件中 fs.defaultFS 配置项中端口号

6. 查看最终连接效果

上一

本文详细介绍了如何在Eclipse中配置Hadoop开发环境,包括环境部署概览、前期准备、Hadoop环境配置、通过Eclipse直接提交MapReduce任务以及以Jar包方式运行。重点讲解了如何导入Hadoop-eclipse-plugin插件,配置Hadoop位置,以及新建Map/Reduce工程和Java工程。此外,还提到了使用FatJar插件打包和运行Hadoop程序的方法。

本文详细介绍了如何在Eclipse中配置Hadoop开发环境,包括环境部署概览、前期准备、Hadoop环境配置、通过Eclipse直接提交MapReduce任务以及以Jar包方式运行。重点讲解了如何导入Hadoop-eclipse-plugin插件,配置Hadoop位置,以及新建Map/Reduce工程和Java工程。此外,还提到了使用FatJar插件打包和运行Hadoop程序的方法。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

778

778

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?