Kibana与ik中文分词器的安装,Elasticsearch版本为6.4.3。

一、Kibana的安装

1.下载与安装

Kibana选择运行在Windows环境下。

- 选择与Elasticsearch相同的版本下载:https://www.elastic.co/downloads/past-releases

- 解压即可。

2.配置与启动

- 修改

kibana.yml中指向的elasticsearch的url:

elasticsearch.url: "http://192.168.58.128:9200" - 启动bin目录下的kibana.bat

- 访问kibana:http://127.0.0.1:5601 (默认5601端口)

二、ik分词器的安装与使用

ik分词器继续在linux下进行安装。

- 去github上直接下载zip文件。

→ https://github.com/medcl/elasticsearch-analysis-ik/releases

选择和已经下载的elasticsearch版本兼容的ik。

. 上传至之前安装的/home/learn/elasticsearch/plugins下,并进行解压与重命名:

unzip elasticsearch-analysis-ik-6.4.3.zip -d ik-analyzer

- 进入

elasticsearch/bin,执行./elasticsearch

控制台看到

然后就可以去使用了

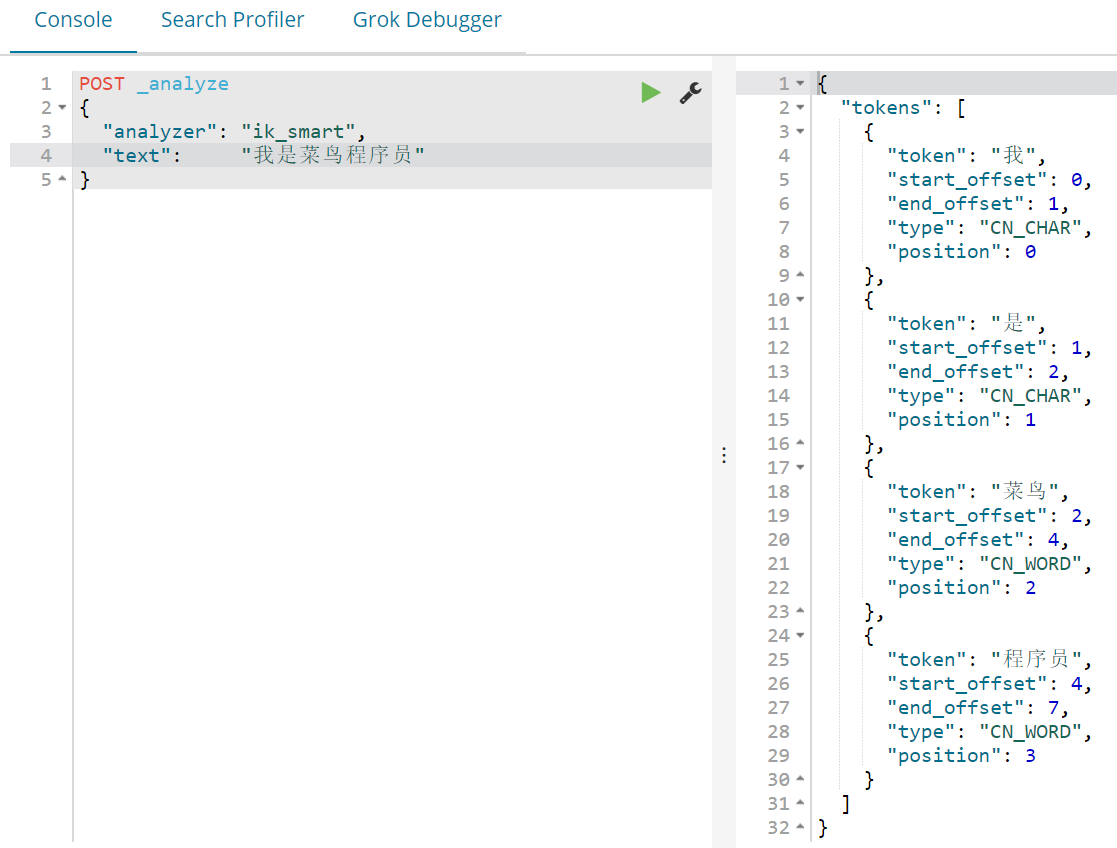

ik_max_word 是细粒度拆分

ik_smart 是粗粒度拆分

一般在索引时采用细粒度,搜索时采用粗粒度

"name": {

"type": "text",

"analyzer":"ik_max_word",

"search_analyzer":"ik_smart"

}

自定义词库:

在plugins下的ik下的config中,有一个IKAnalyzer.cfg.xml

指定自定义的扩展字典,然后创建该xxx.dic文件,把自定义的专用不想被拆分的词语添加进去,编码为utf-8,重启后生效。

具体可参考ik分词器本身的字库main.dic

459

459

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?