原文来自wiki百科

https://en.wikipedia.org/wiki/Perplexity

在信息论中,perplexity(复杂度)是用来评价一个语言模型预测一个样本是否很好的标准。它可以用来对比语言模型的性能。复杂度越低,代表模型的预测性能越好。

- 概率分布的复杂度

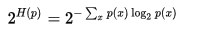

x为随机变量,p(x)为x的分布,x的复杂度定义为:

- 概率模型的复杂度

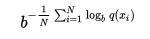

给定一个概率模型q, 用它来预测独立的样本x1,x2,…, xN。 如果模型很好,那么它会给样本分配较高的概率q(xi)。模型的复杂度定义为:

- 单词的复杂度

在自然语言处理中,复杂度用来评估语言模型。根据句子的复杂度的定义,比如,平均一个句子xi 在测试样本中可以使用190个比特数来编码,那么总共有个不同的句子。然而,更普遍的是将句子的长度归一化,只考虑每个单词的比特数。因此,如果一个测试样本的句子里包含1000个单词,并且可以使用7.95个比特数的单词量表示,也就是说这个模型的复杂度是

=247。

复杂度最低的模型已经发表在(Brown Corpus)https://en.wikipedia.org/wiki/Brown_Corpus, 每个单词的复杂度为247,或者说每个字母的比特数为1.75比特。

327

327

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?