因项目需求,尝试在windows中安装Hadoop

下载

官网下载hadoop (http://www.apache.org/dyn/closer.cgi/hadoop/common)

下载与hadoop版本相同的Hadoop Windows运行包 (https://github.com/cdarlint/winutils)

安装

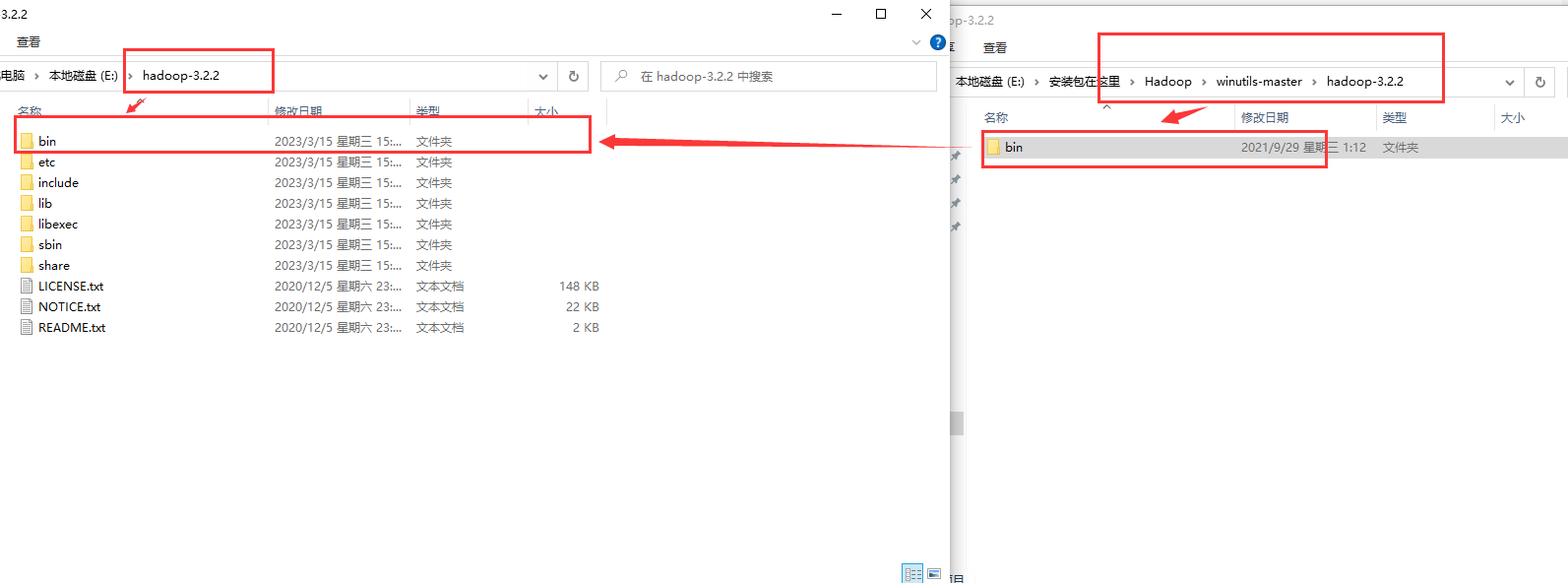

替换文件

解压之后,将官网Hadoop文件夹下的bin替换为windows 运行包中的bin

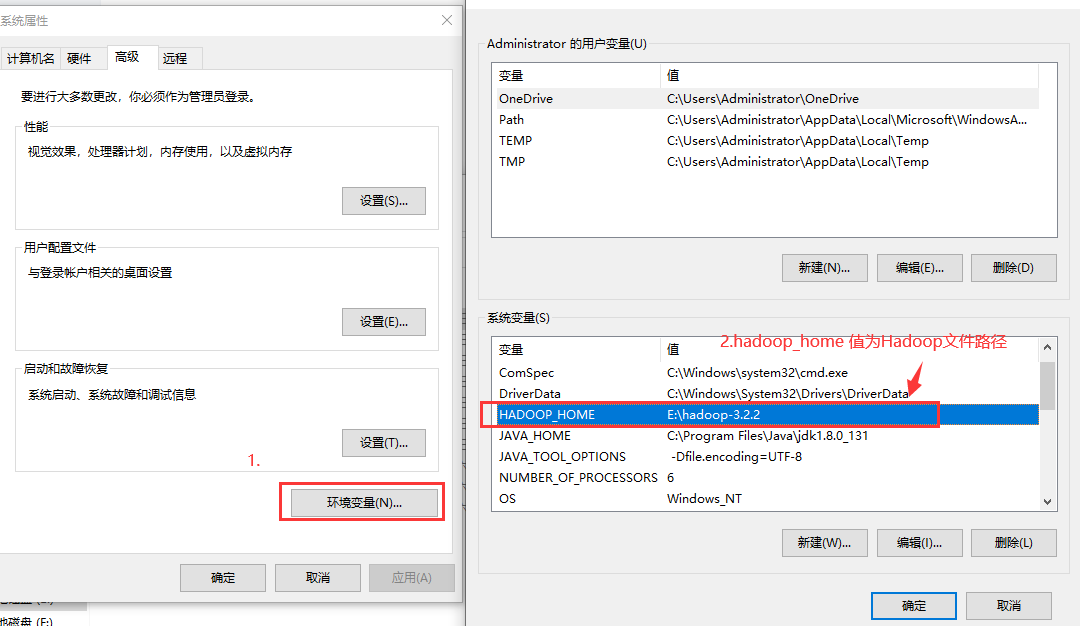

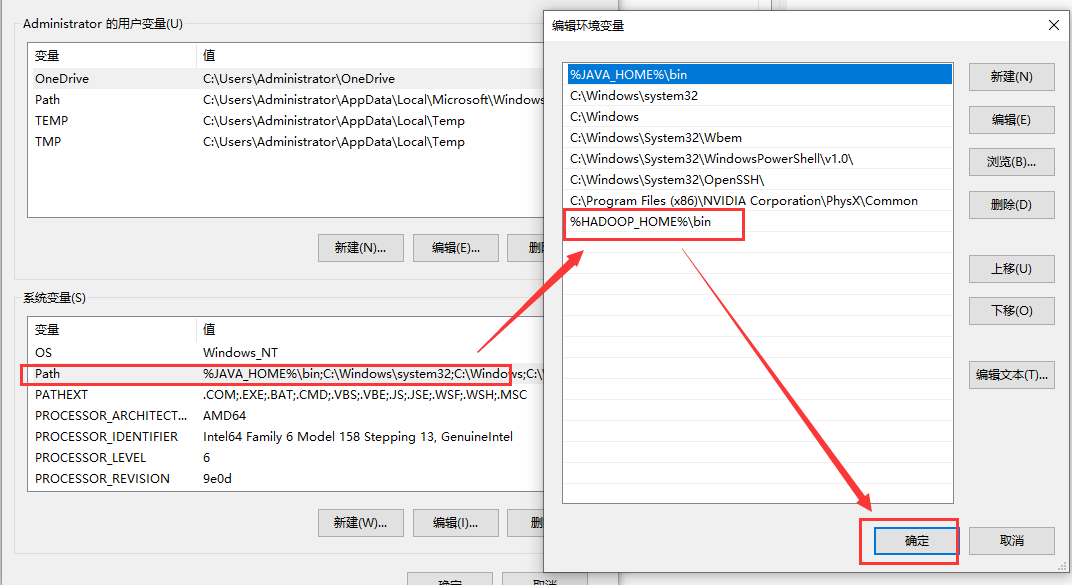

配置Hadoop环境变量

配置HADOOP_HOME

配置Path

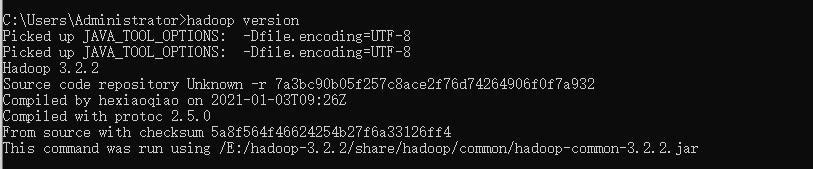

运行win+R出入cmd后,打开命令提示符,输入hadoop version,检查环境变量是否配置成功

1)如果出现下图

修改E:\hadoop-3.2.2\etc\hadoop\hadoop-env.cmd,用notepad--或其他编辑器打开,修改JAVA_HOME,其中PROGRA~1表示DOS下的program Files

2)修改完成后,重新查看环境变量是否配置成功,出现下图表示成功

修改hadoop配置文件

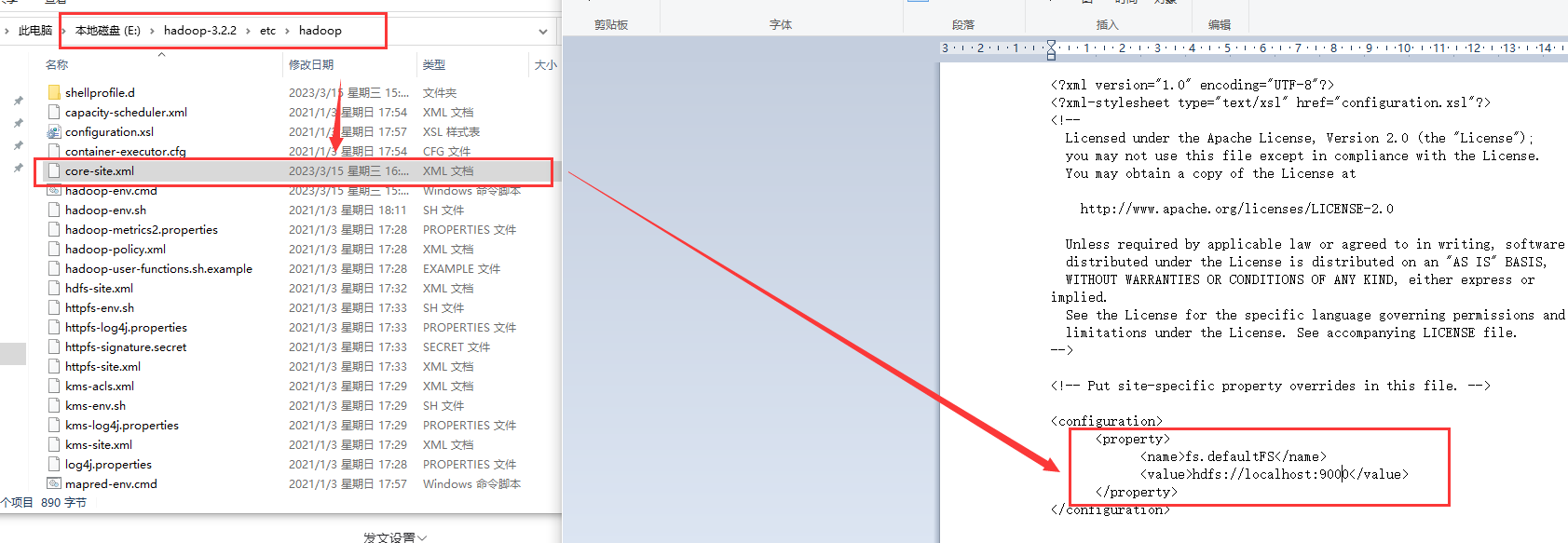

修改E:\hadoop-3.2.2\etc\hadoop\core-site.xml

填入以下内容

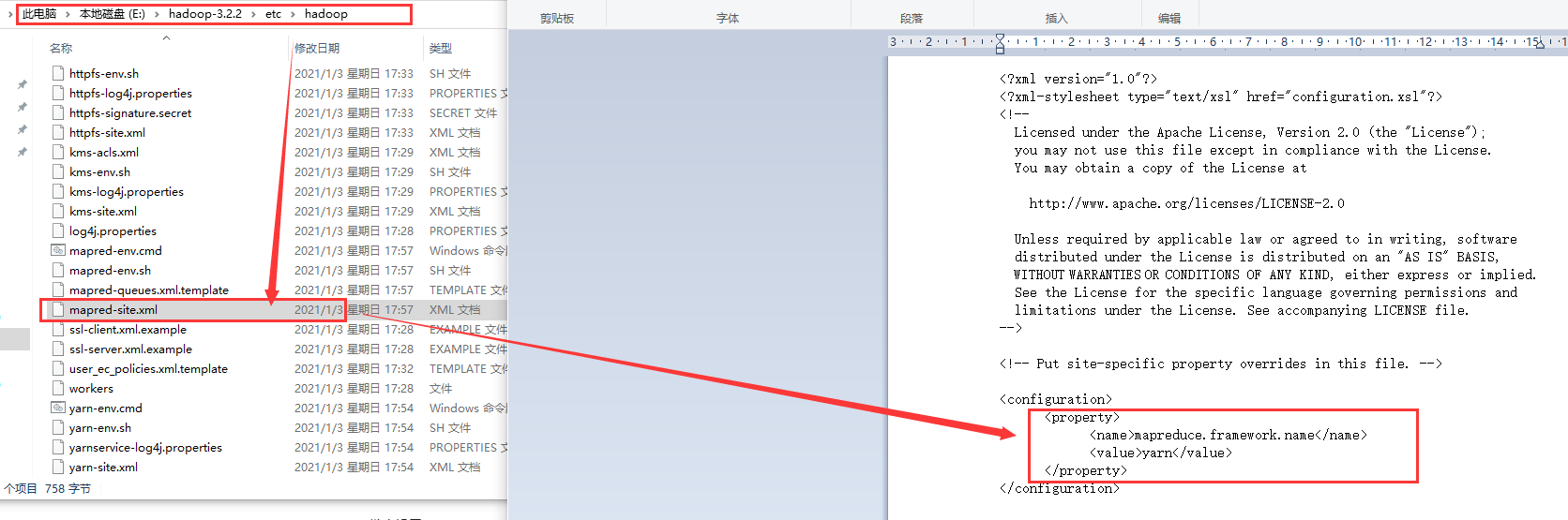

修改E:\hadoop-3.2.2\etc\hadoop\mapred-site.xml

填入以下内容

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

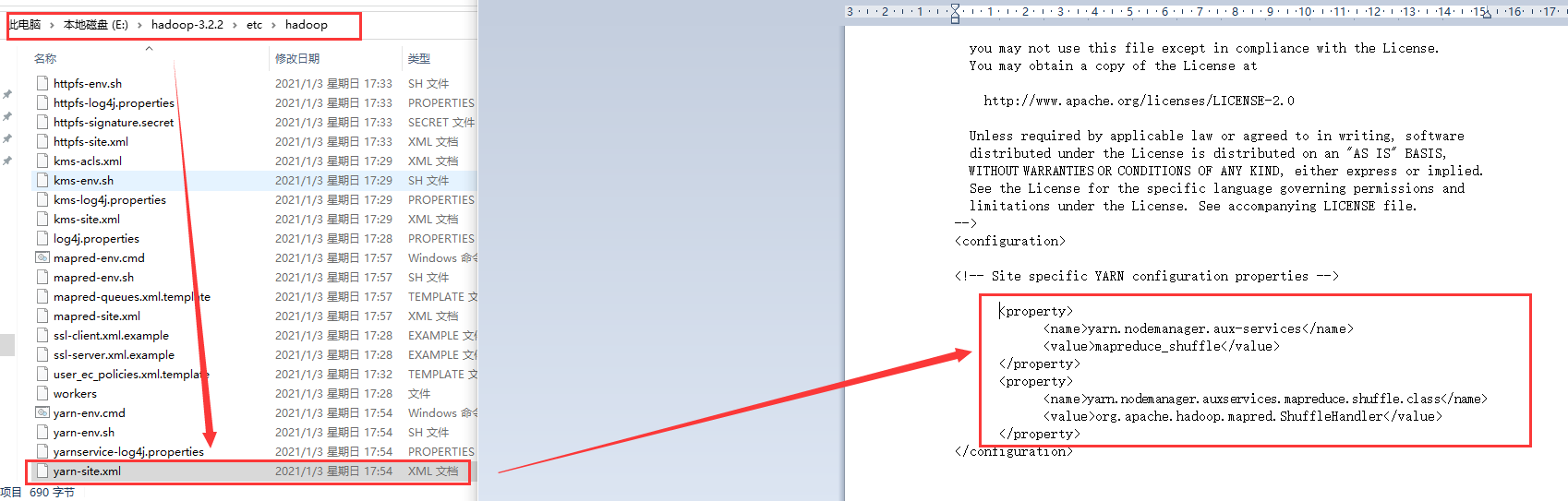

修改E:\hadoop-3.2.2\etc\hadoop\yarn-site.xml

填入以下内容

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.auxservices.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

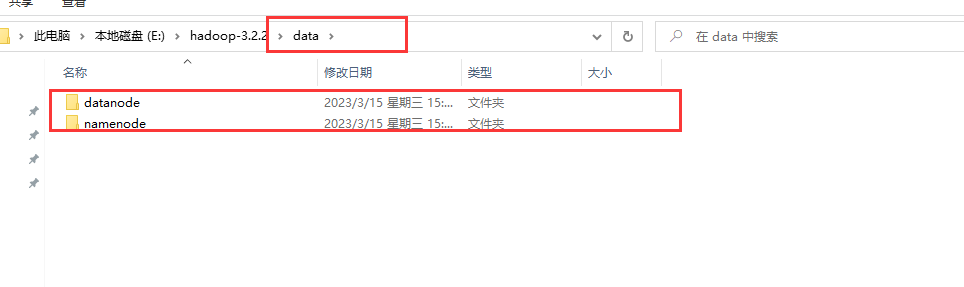

在E:\hadoop-3.2.2路径下新建文件夹data,data下新建namenode和datanode

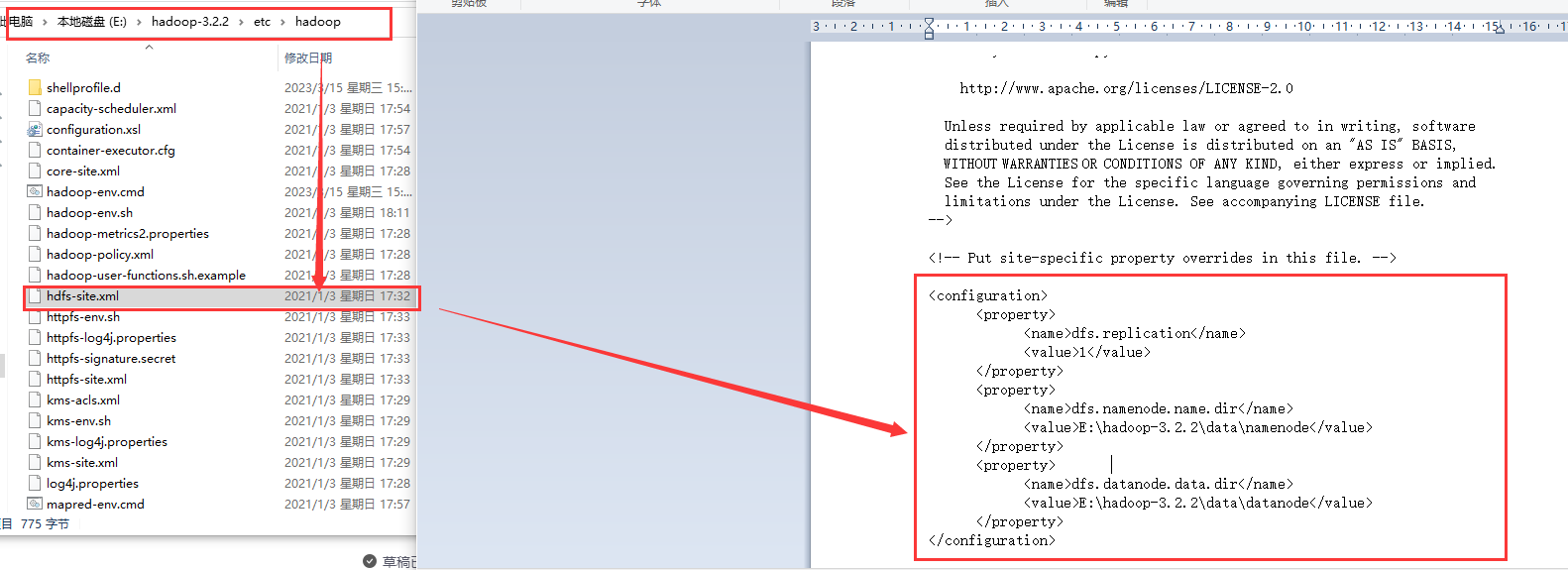

修改E:\hadoop-3.2.2\etc\hadoop\hdfs-site.xml

填入以下内容,其中dfs.namenode.name.dir与dfs.datanode.data.dir内容根据实际路径填写

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>E:\hadoop-3.2.2\data\namenode</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>E:\hadoop-3.2.2\data\datanode</value>

</property>

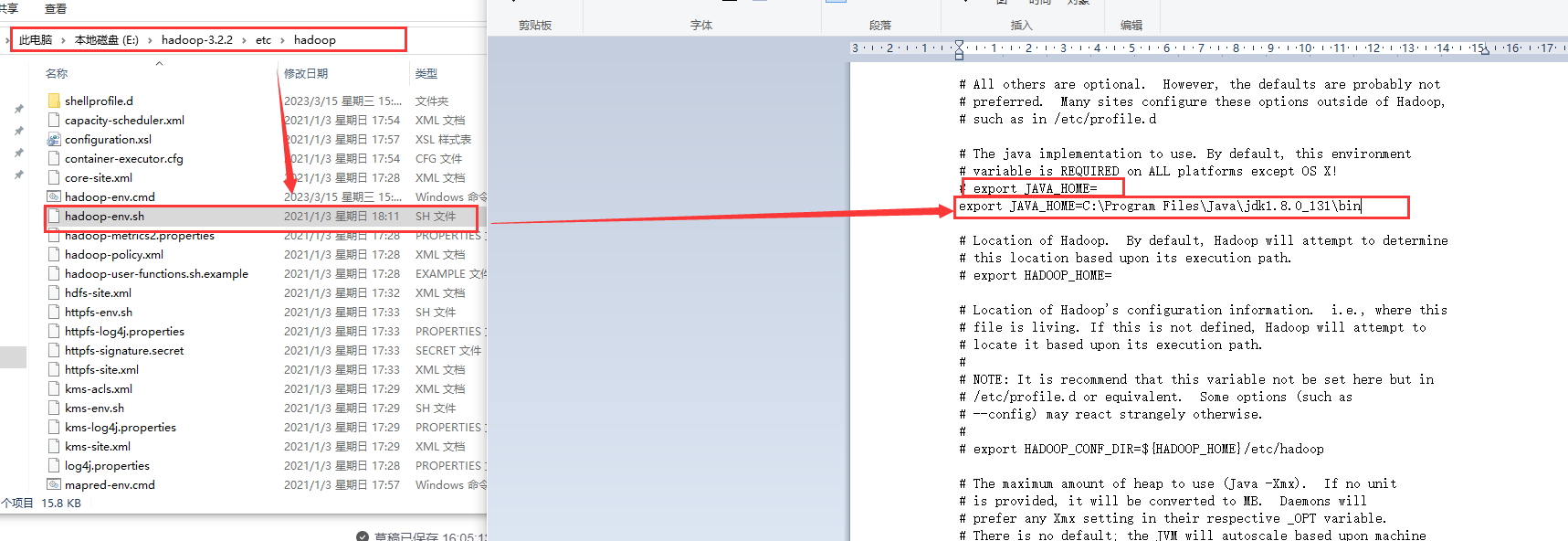

修改E:\hadoop-3.2.2\etc\hadoop\hadoop-env.sh

查找”export JAVA_HOME=“,填入本地JAVA_HOME/bin路径

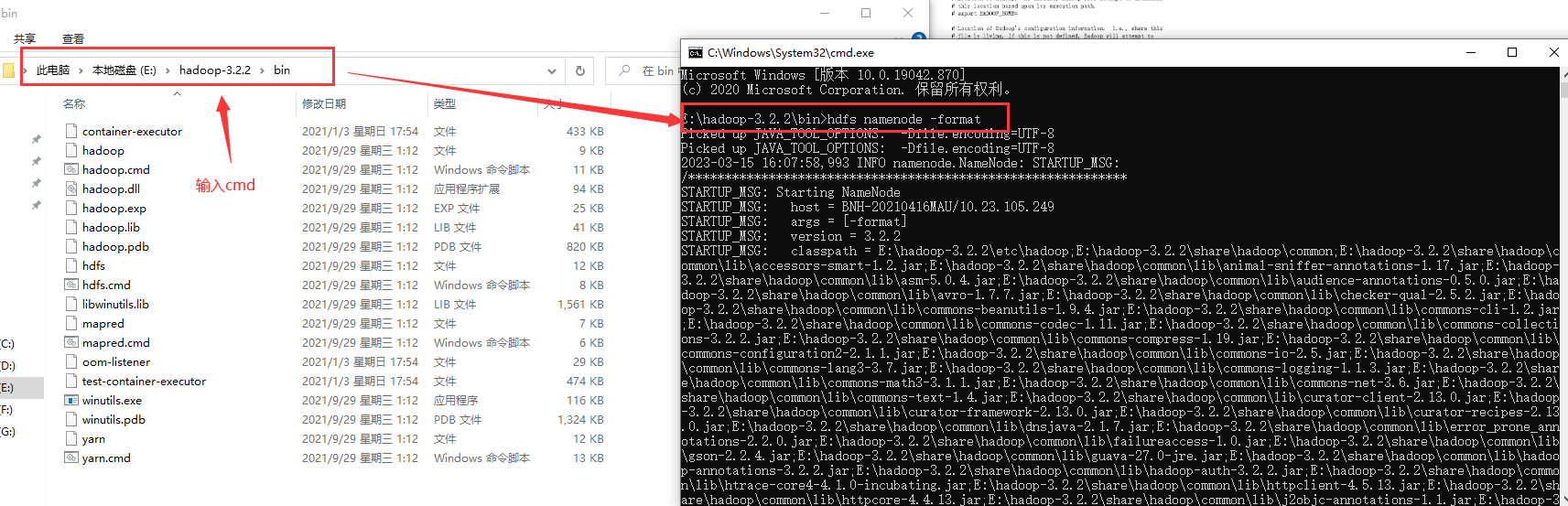

检查Hadoop是否安装成功

1.在Hadoop的bin路径下执行下面操作,打开运行窗口后,输入hdfs namenode -format 如果没报错,说明上面修改的配置文件没问题

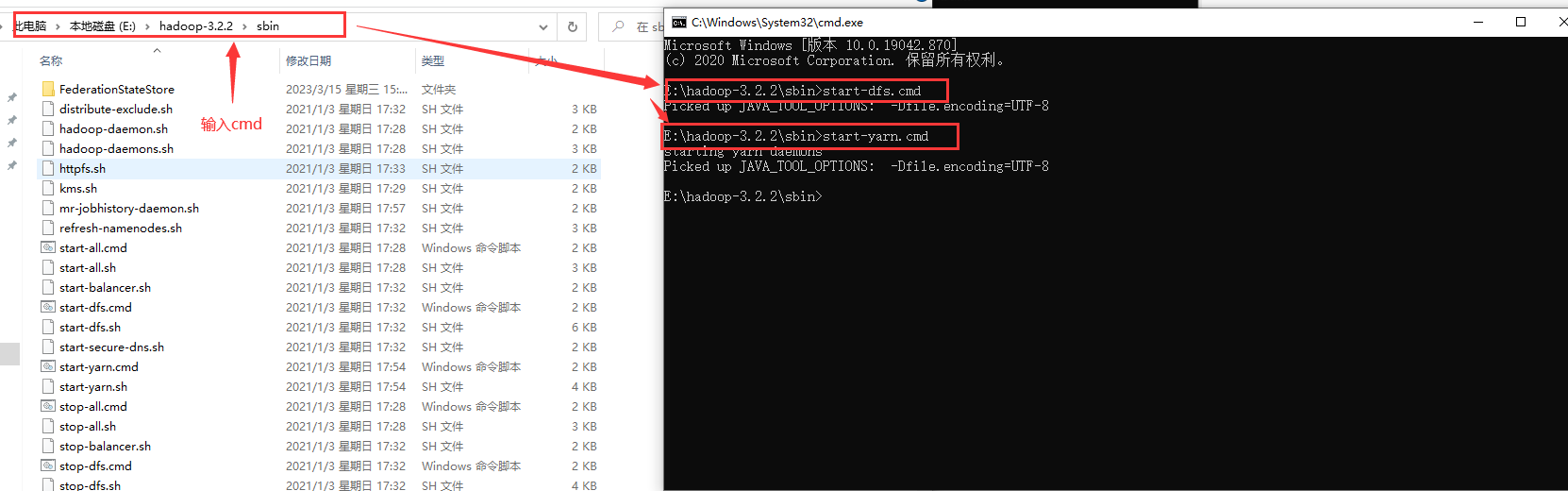

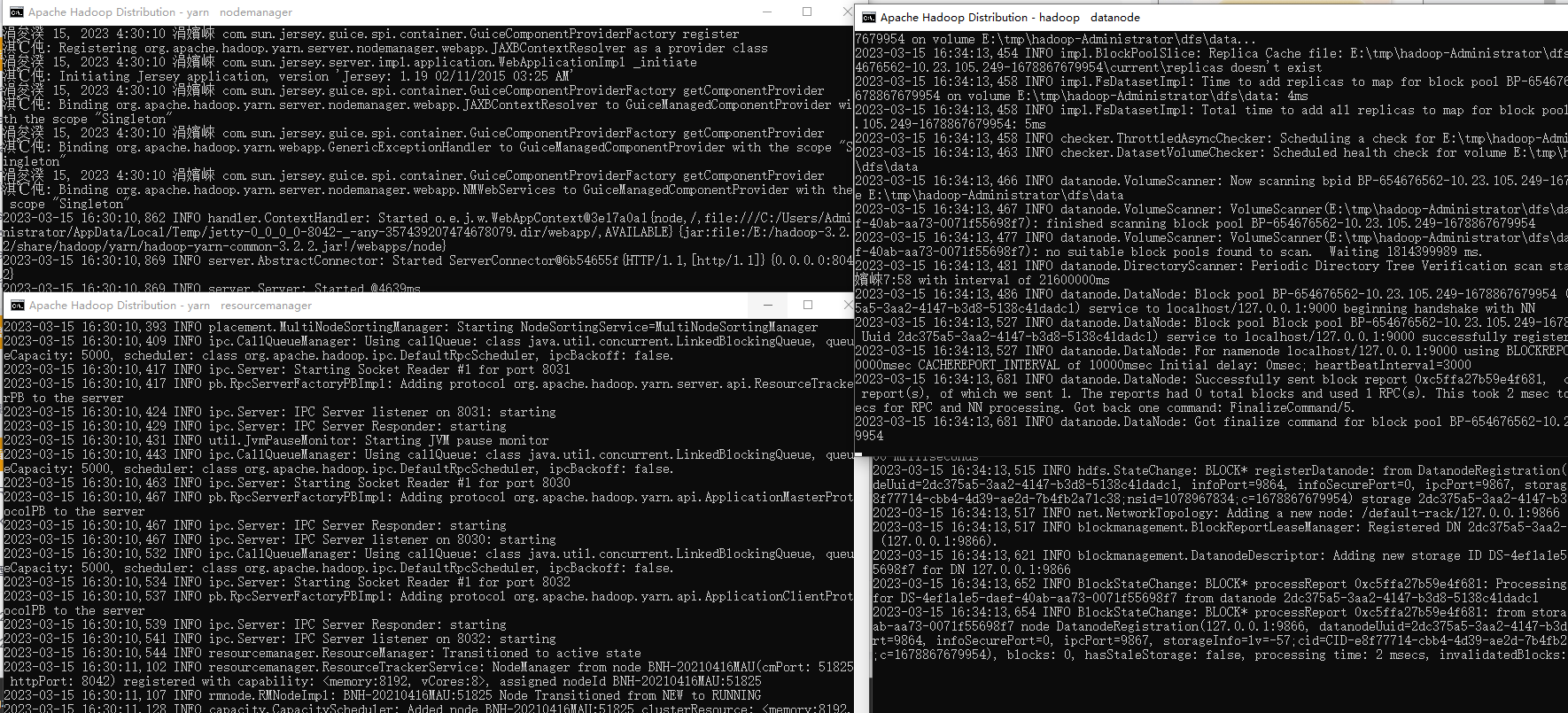

2.在Hadoop的sbin路径下执行下面操作,打开命令窗口后分别输入start-dfs.cmd 和 start-yarn.cmd,分别弹出两个窗口,共四个窗口。不关闭弹出的窗口

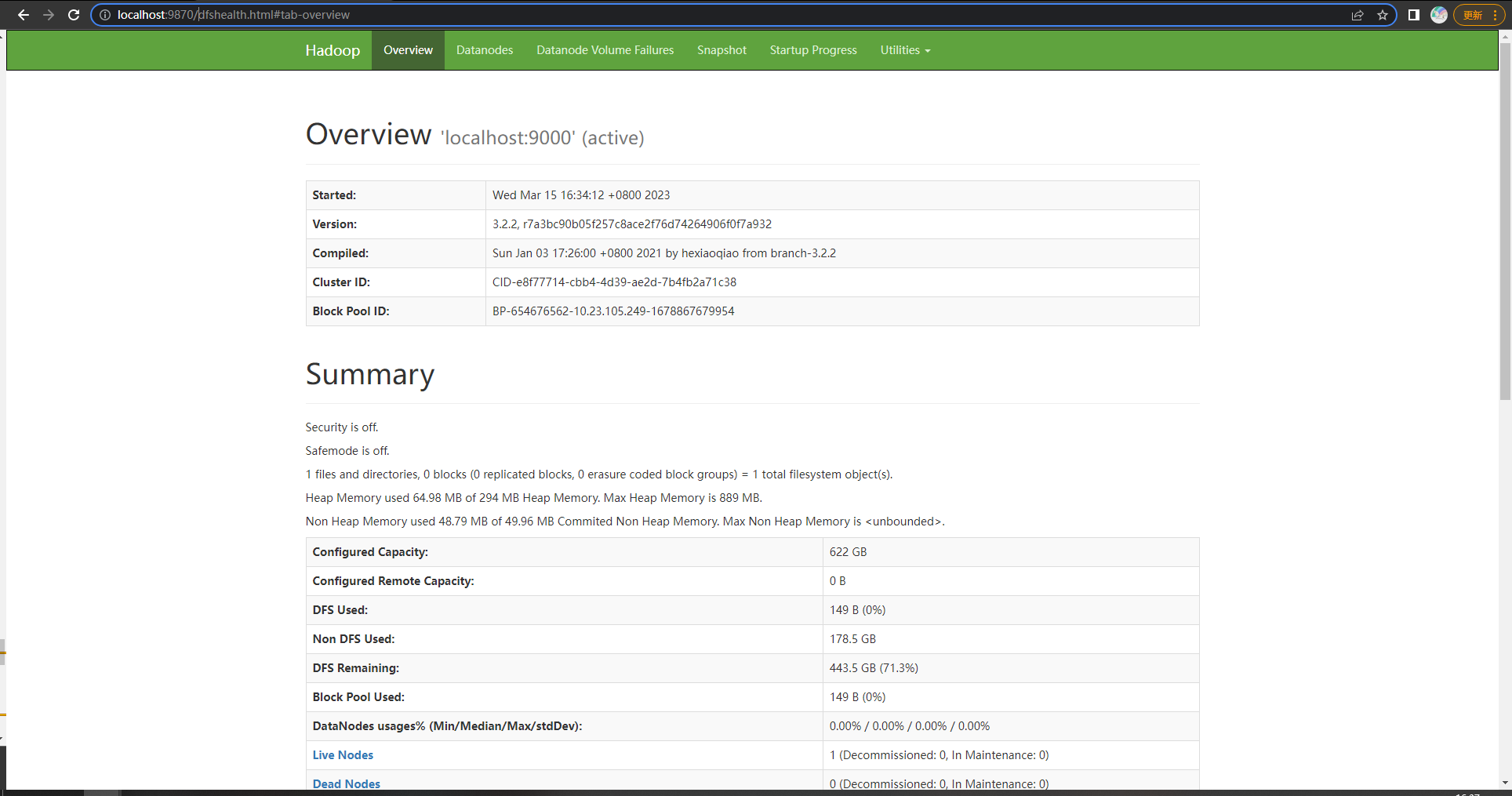

3.本地浏览器访问http://localhost:9870/,弹出一下页面,Hadoop安装配置完成

2636

2636

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?