本来想用Eclipse的,然而在网上找了一圈,发现大家都在说IntelliJ如何如何好。我也受到了鼓舞,遂决定在这台破机器上鼓捣一次IntelliJ吧。

Spark程序远程调试,就是将本地IDE连接到Spark集群中,让程序一边运行,一边通过debuger实时查看运行情况,配置好以后和本地debug差不多。

之前有写过Spark集群的安装部署。http://blog.csdn.net/u013468917/article/details/50979184当时是在hadoop2.2.0平台部署的Spark1.0.2.后来对Spark熟悉了一点后,就想把集群升级以下。干脆一部到位升级到最新的1.6.1.具体的安装过程和原来的1.0.2一模一样,解压之后将原来安装文件中的conf文件夹下的配置文件直接复制过来就好了,不过用的是hadoop2.3.0的预编译包,目前还没有出现什么问题。

所以这次的演示在Spark集群1.6.1上进行。

过程大致分为以下几步:

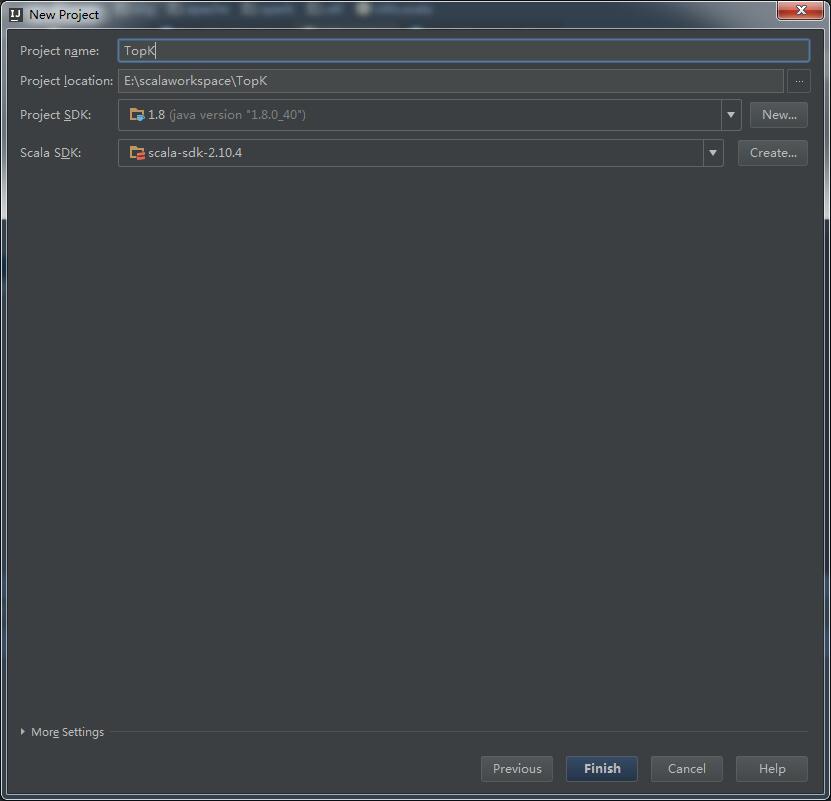

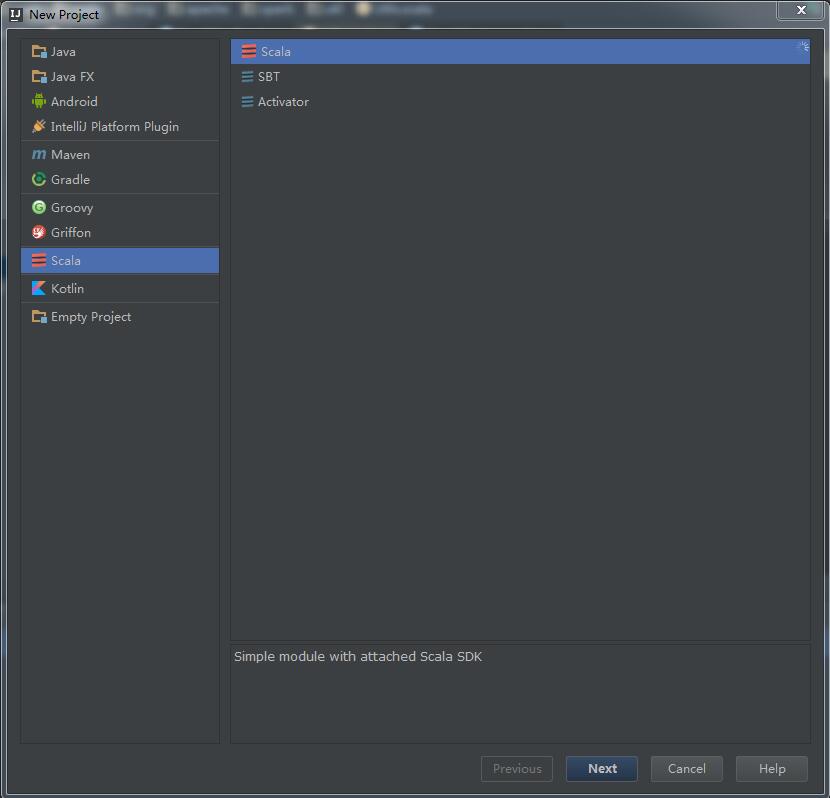

1、打开Intellij IDEA,File->New ->Project,选择Scala。

2、取名为TopK,然后如图选择Java和Scala的SDK

3、导入Spark依赖包,这个依赖包在压缩包的lib目录下名为 spark-assembly-XXXXXXX.

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

664

664

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?