激励函数也成激活函数。激励函数也就是为了解决我们日常生活中 不能用线性方程所概括的问题.

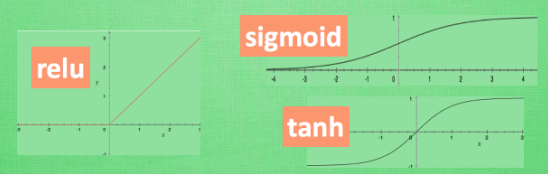

通常有以下几个常用的激活函数:

甚至可以创造自己的激励函数来处理自己的问题, 不过要确保的是这些激励函数必须是可以微分的, 因为在 backpropagation 误差反向传递的时候, 只有这些可微分的激励函数才能把误差传递回去.

想要恰当使用这些激励函数, 还是有窍门的. 比如当你的神经网络层只有两三层, 不是很多的时候, 对于隐藏层, 使用任意的激励函数, 随便掰弯是可以的, 不会有特别大的影响. 不过, 当你使用特别多层的神经网络, 不得随意选择利器. 因为这会涉及到梯度爆炸, 梯度消失的问题.

8881

8881

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?