第一周:

简介机器学习,有监督学习,无监督学习。

1-1,1-2,1-3,1-4

第二周:

2-1:回归问题举例

2-2:介绍cost function定义。

2-3:在回归函数是一个经过原点的直线的情况下,演绎cost function最小化的计算。

2-4:在回归函数是一条直线时,通过等高线演绎cost function最小化的计算。

2-5:简介梯度下降算法,但没有介绍偏微分部分。

2-6:以目标函数是一个经过原点的函数为例演绎梯度下降算法。

2-7:结合线性回归假设和梯度下降算法,得到第一个机器学习算法。

2-8:接下来课程介绍。

第三周:

本周内容复习:线性代数复习

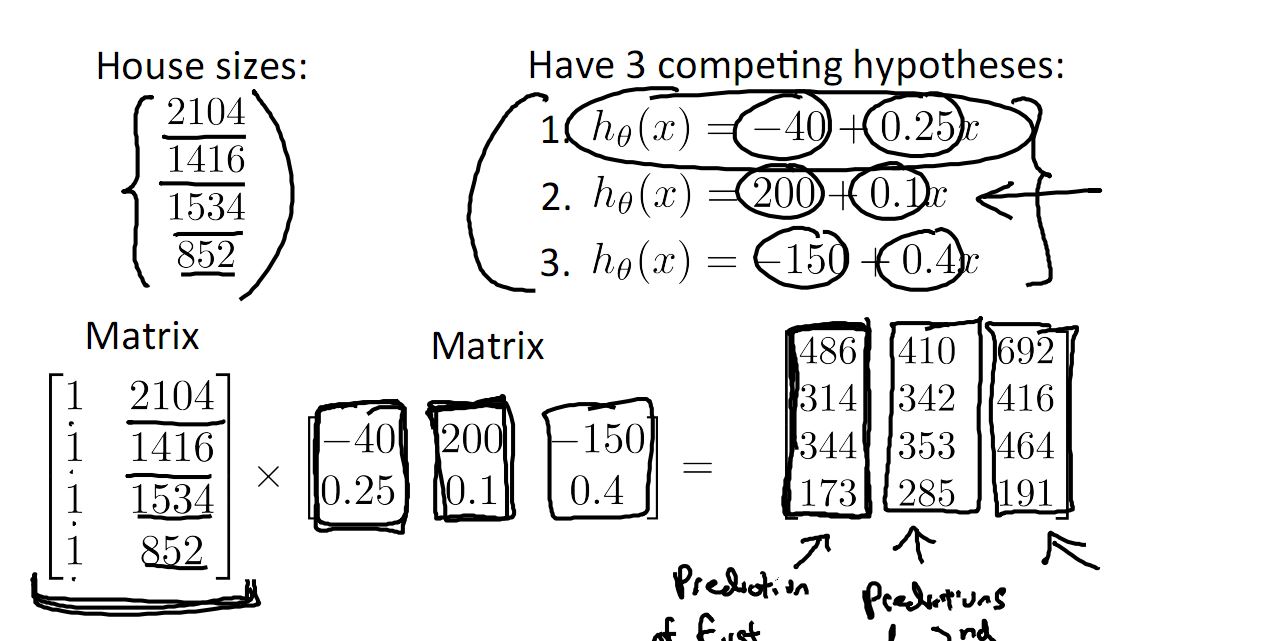

3-1,3-2,3-3,3-4:矩阵加减,数乘,乘法。其中3-4有价值的地方在下面这张图:

3-5:矩阵乘法的性质。

3-6:逆矩阵和转置矩阵。

第四周

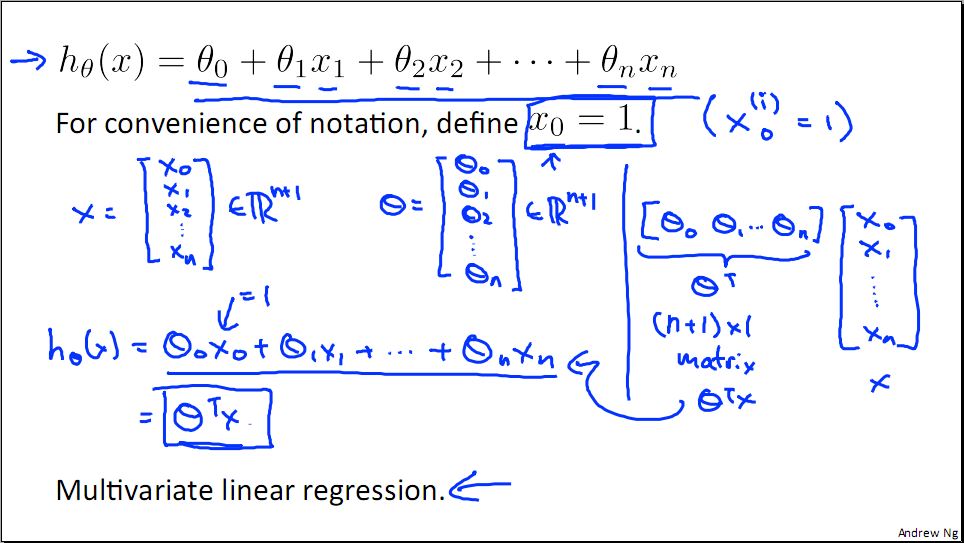

4-1:在多元输入问题下的回归分析假设函数h(x)表示。

视频截图:

4-2:如何设定多元输入问题下的回归分析假设h(x)的参数。

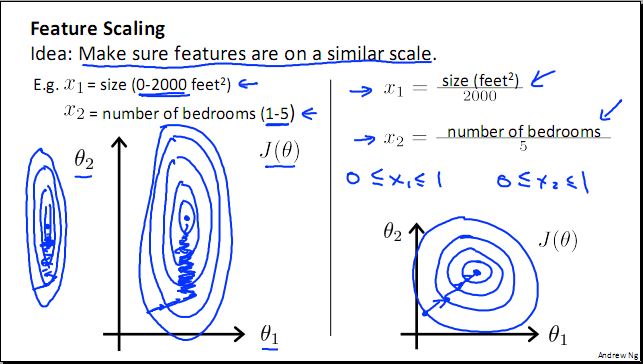

4-3:介绍特征缩放(使梯度下降的速度更快)

4-4:介绍学习速率的选择。

4-5:介绍通过特征组合和取次方,可以产生新的特征。

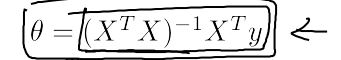

4-6:对于某些线性回归问题,介绍一种标准方程法(Normal Equation)求解h(x)的参数,可以比梯度下降算法更快。

4-7:标准方程法中出现不可逆矩阵时的策略。

第五周

第六周

6-1:使用线性回归解决0-1分类问题的不足,引入逻辑回归。

6-2:简介逻辑函数(或sigmoid函数),以及用逻辑函数结果的概率意义表示。

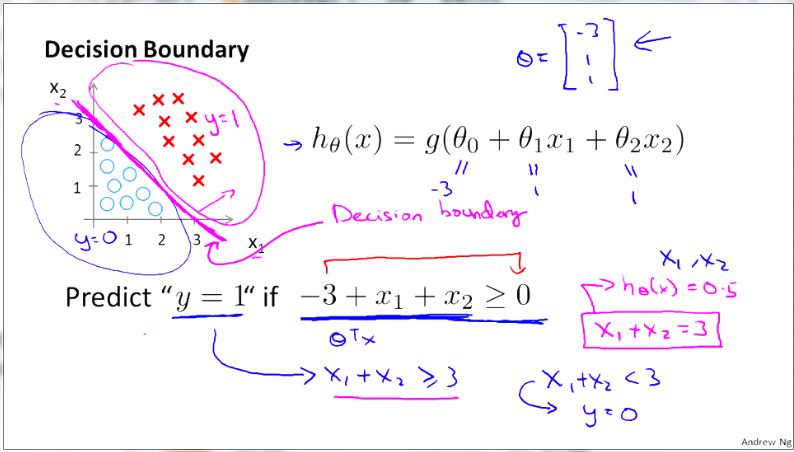

6-3:通过逻辑函数描述0-1分类问题,引入决策边界。

6-4:定义了sigmoid函数作为预测函数时的单训练样本的代价函数。

6-5:介绍如何进行逻辑回归的梯度下降。

6-6:使用Octave进行更高级的算法实现梯度下降算法的功能。

6-7:使用逻辑回归解决超过两个类别的分类问题。

第七周

7-1:引入过拟合问题。

7-2:介绍正规化后的cost function。

7-3:线性回归和标准方程法(Normal Equation)中引入正规化。

7-4:逻辑回归中引入正规化。

第八周

8-1:使用逻辑回归解决多输入分类问题时会遇到feature过多的情况。

8-2:引入神经网络,介绍其发展历史。

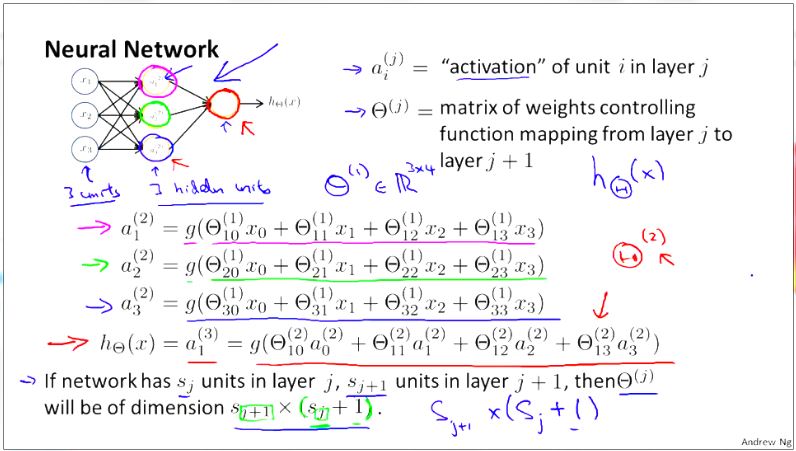

8-3:介绍神经网络的专业名词、形式。主要知识在下面这张视频截图:

8-4:

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?