一、逻辑回归

1.逻辑回归

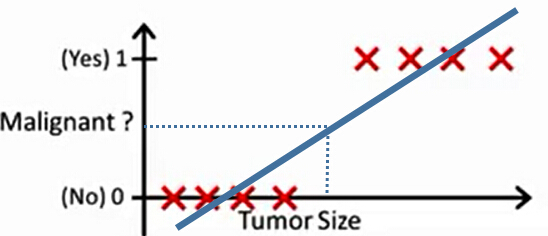

什么是逻辑回归问题,通俗地讲就是监督下的分类问题。通过前面的学习,我们已经掌握如何解决线性(非线性)回归的问题。那面对分类问题我们是否也可以用线性回归呢?简单起见,我们先讨论二元分类,首先让我们来看一个例子,肿瘤的大小与是否是恶性的关系,其中红色的 × 表示肿瘤大小,对应的 y 轴表示是否为恶性。

我们对数据进行线性回归,得到了一条很完美的直线。我们可以规定,当拟合出来的

2.假设表示

在线性回归问题中,我们定义了

hθ(x)=θTx(1)

在分类问题中,我们改变该函数,增加一个作用函数,即

hθ(x)=g(θTx)(2)

其中

g(z)

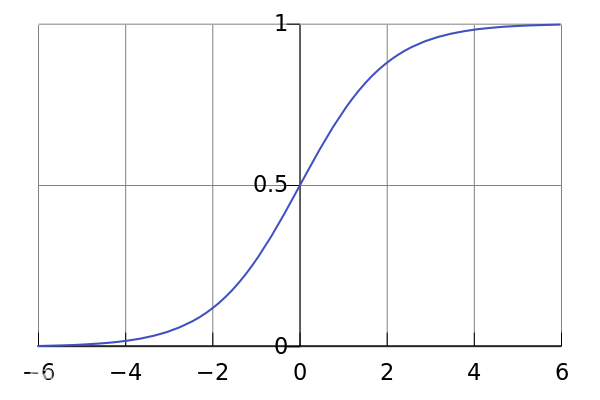

为sigmoid函数

g(z)=11+e−z(3)

那么把式(3)代入式(2),得

hθ(x)=11+e−θTx(4)

为什么要使用sigmoid函数?有一系列的数学原因,感兴趣的可以搜索广义线性模型,在这里就不阐述原因了。我们来直观地感受一下sigmoid函数,当

z→−∞

时,

g→0

;当

z→+∞

时,

g→1

。

下面我们对 hθ(x) 输出的结果做一个解释。由于它的取值范围,我们可以把它理解为概率。若 hθ(x)=0.7 ,在二元分类(本例)中即表示肿瘤在输入变量 x 下为恶性(

由于sigmoid函数的性质,且 hθ(x)∈(0,1) ,我们认为当 hθ(x)≥0.5 时,我们把数据 x 预测为类1即

3.决策边界

既然是分类问题,那么对于二分类,

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?