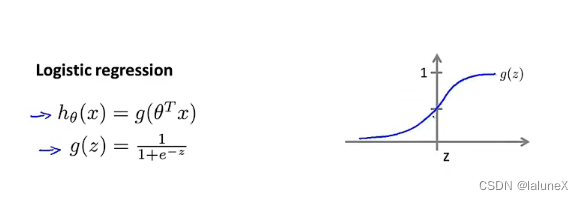

一、Logistic Regression

假设函数:

决策边界取决于θ参数的选取,而与样本无关

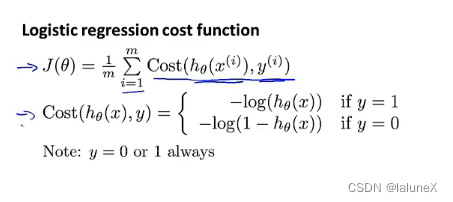

损失函数:

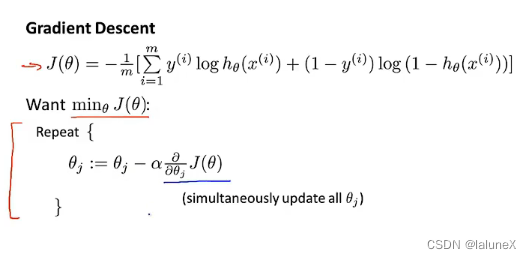

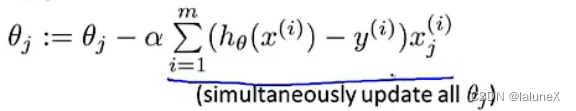

梯度下降:

可以发现:逻辑回归问题的梯度下降和线性回归的梯度下降公式相同

过拟合的解决方法

1.通过减少特征变量的个数

- 手动减少样本的特征变量(但是这样就舍掉了一些可能有作用的特征变量)

- 使用模型选择算法(Model selection algorithm)来自动选择哪些特征变量需要保留哪些可以删除

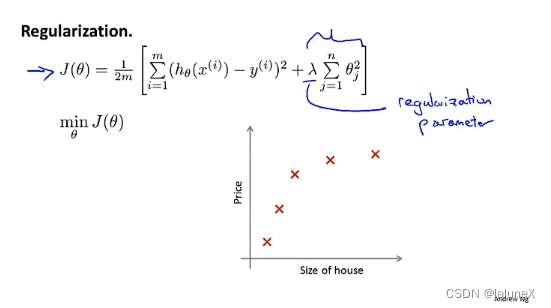

2.正则化

机器学习中经常会在损失函数中加入正则项,称之为正则化(Regularize)。它是为了防止模型过拟合,它的原理是在损失函数上加上某些规则(限制),使参数尽可能地小,从而减少求出过拟合解的可能性

对正规方程的正则化

逻辑回归、神经网络与SVM的选择

- 当特征n相对于样本m的数量多时,选择逻辑回归或无核的SVM

- 当样本m相对于特征n的数量多时,选择SVM

- 当样本m远大于特征n的数量时,选择逻辑回归或无核的SVM

- 神经网络适用于上面的所有情况,不过神经网络对算力的要求比较高,会比较费时

本文只用于个人学习与记录,侵权立删

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?