te按照实验要求选取了NTIRE2021中的HDRUNet论文进行阅读,此方法在NTIRE2021 HDR Challenge 单帧中获得第二名。

论文摘要

论文主要为了解决当前HDR的两个痛点:

1.相同场景下的多曝光图像难以获取

2.忽略了噪声与量化损失对HDR重建的影响

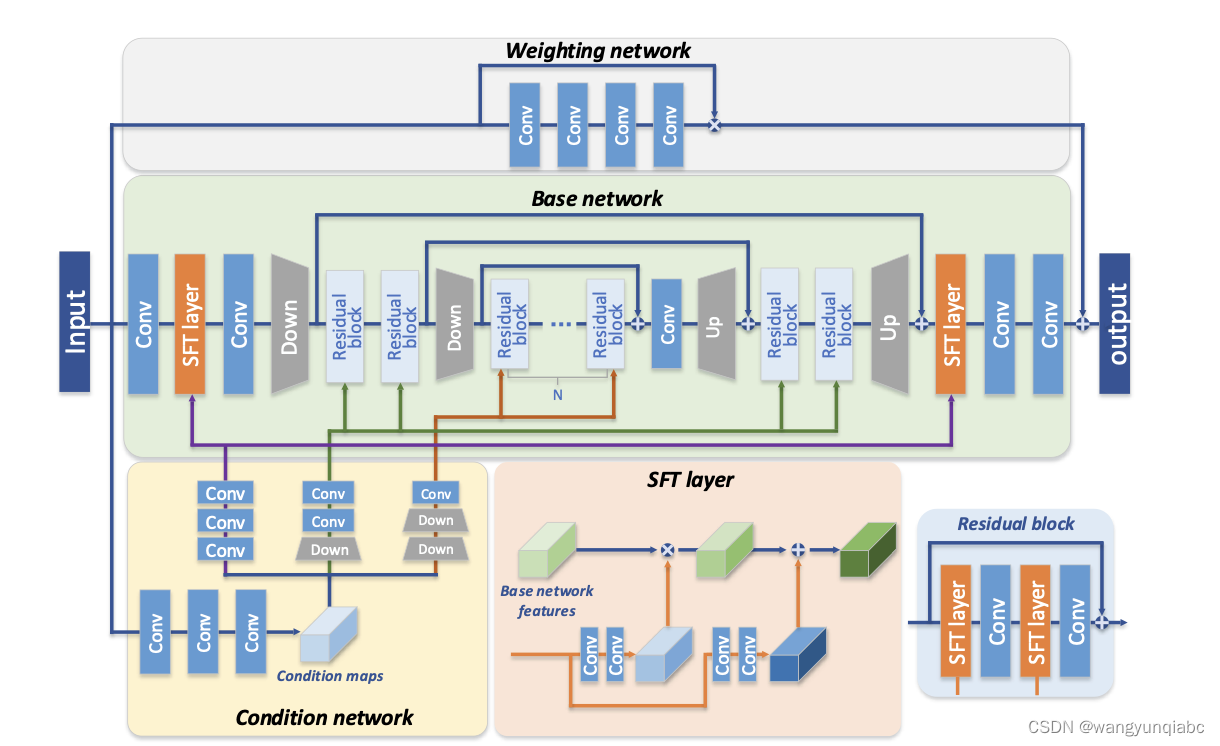

为解决这两个问题,论文提出了基于学习的HDRUnet方法,包括一个Unet基础网络,一个条件网络和一个加权网络,并提出了Tanh_L1损失用于平衡过曝和正常曝光

论文方法

观测对比

通过对比LDR与HDR的梯度图,发现噪声模式同时存在于高亮、暗部和正常曝光区域,启发设计了空域可变调制模块

网络结构

论文设计了带空域调制的UNet风格网络用于HDR重建,包含了以下三个部分

Base_network

Unet风格,8bit带噪LDR作为输入重建HDR

Conditional_netfwork

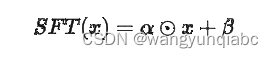

用位置相关、图像相关的图像处理方式,论文提出了带带SFT(Spatial Feature Transform)的条件网络用于提供空域可变调制。公式定义:

Weighting Network

由于正常曝光对于学习贡献较小,提出加权函数聚焦于过曝区域细节重建:

注:I表示LDR输入,表示最终重建的HDR图像,表示BaseNet的输出

Loss Function

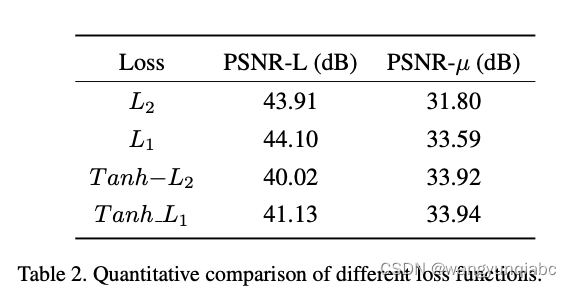

为解决现有损失函数无法聚焦于低亮区域提出损失函数定义如下:

实验

实验步骤

数据集:采用NTIRE2021 HDR竞赛的数据,它包含1494LDR/HDR对用于训练,60张LDR用于验证,201张LDR用于测试。

度量准则选择了PSNR-L与PSNR-u

消融实验

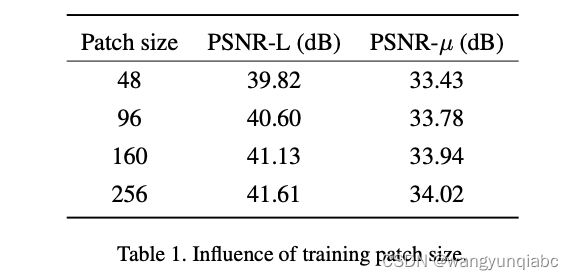

patch-size

损失函数

模块有效性

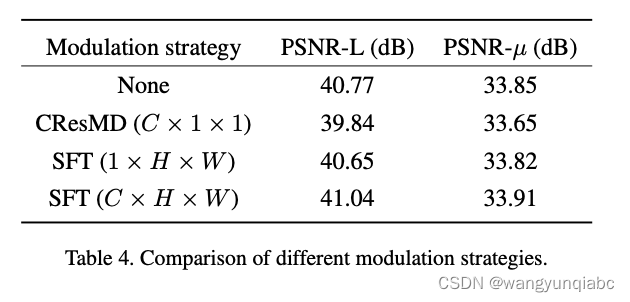

特征调制有效性

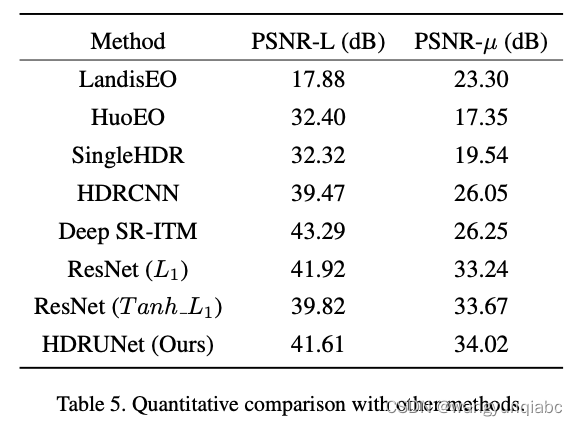

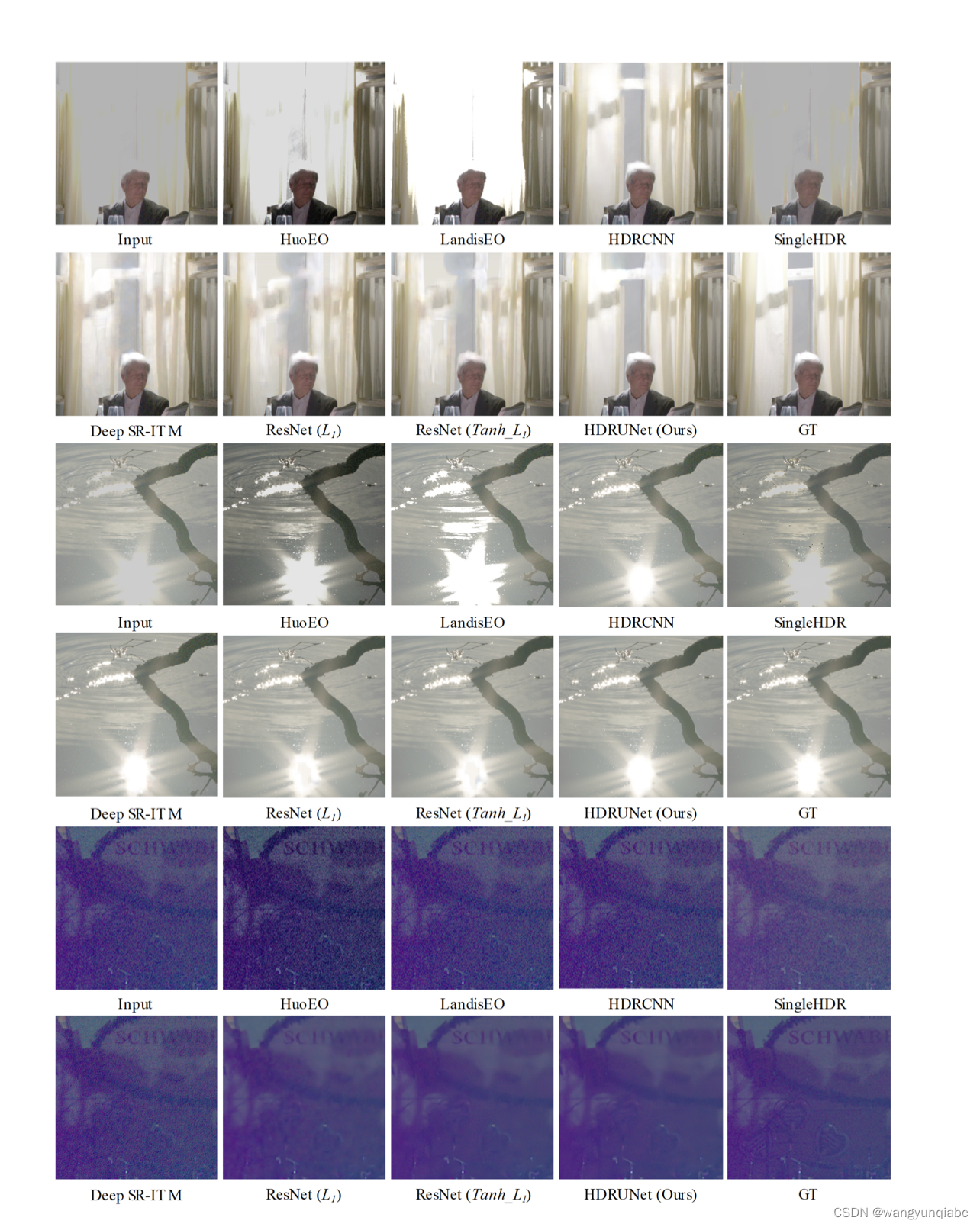

与其他方法的对比

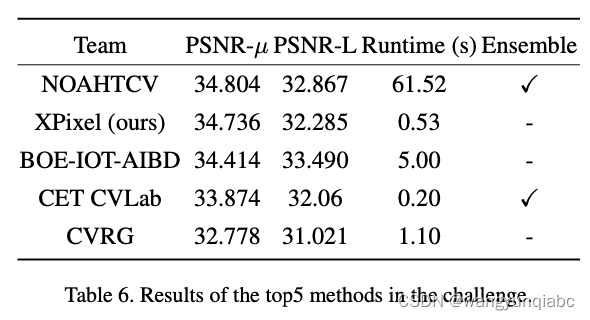

最终的挑战结果

实验结果

论文所提方法取得了与第一相当的PSNR-u指标(仅差0.07dB),但所提方法推理速度比第一方案快116倍

个人总结

这篇论文针对高动态范围(HDR)图像重建领域中的特定问题提出了一种新的解决方案。HDR图像旨在捕捉现实世界中从最暗到最亮的广泛亮度范围,但在实践中,创建这样的图像面临一些技术挑战。该论文旨在解决的两个主要问题是:

-

难以获取相同场景的多曝光图像:在现实世界情况下,获取同一场景在不同曝光条件下的多张图像可能很困难。这是因为动态场景随时间快速变化,或者在拍摄条件受限的情况下。

-

忽略了噪声与量化损失对HDR重建的影响:大多数现有技术没有充分考虑到低动态范围(LDR)图像中的噪声和量化损失是如何影响HDR重建的,这可能会在重建的HDR图像中产生不真实的效果。

为了应对这些挑战,该论文提出了HDRUnet,这是一个基于学习的方法,具有以下几个组件:

Base Network: 该网络采用U-Net风格的架构,输入是8位带噪的LDR图像,输出是重建的HDR图像。

Conditional Network: 为了实现图像处理的位置相关性和图像相关性,作者引入了带有空间特征变换(Spatial Feature Transform, SFT)的条件网络,这允许模型在不同空间区域适用不同的调整策略,以适应场景的不同部分。

Weighting Network: 由于正常曝光的区域在学习过程中的贡献较小,论文提出了一个加权函数,重点关注过曝区域的细节重建。

Loss Function: 为了更好地关注图像中的低亮度区域,提出了一种新的损失函数,Tanh_L1损失,旨在平衡过曝和正常曝光区域之间的差异。

从这篇论文中,我们可以看到几个关键点:

-

模型设计: HDRUnet通过集成了基础网络、条件网络和加权网络的复杂结构,展示了如何通过深度学习更智能地解决特定问题。

-

针对性的解决方案: 论文提出的SFT模块针对HDR图像中噪声模式的观察结果,表明作者对问题有深刻的理解,并能够针对性地设计解决方案。

-

创新的损失函数: Tanh_L1损失的引入,说明了作者在解决HDR重建问题时不仅仅局限于现有方法,而是创造性地提出新的解决策略。

该研究的贡献在于提供了一种复杂环境下实用的HDR图像重建方法,这对于计算摄影学、实时图像处理以及需要高质量图像输出的任何应用都是有价值的。此外,这种方法的提出还可能激发后续研究者在损失函数设计和网络结构创新上的进一步探索。

1733

1733

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?