【统计学习方法】学习笔记-第3章-k近邻法

- k近邻法(k-nearest neighbor,k-NN)是一种基本分类和回归方法(这里讨论分类),对于新的实例,根据其k个最近邻的训练实例的类别,通过多数表决等方式预测。k近邻不具有显式的学习过程,是利用训练数据对特征空间进行划分,作为分类模型。k近邻法的三个基本要素——k值选择、距离度量、分类决策规则。

3.1 k近邻算法

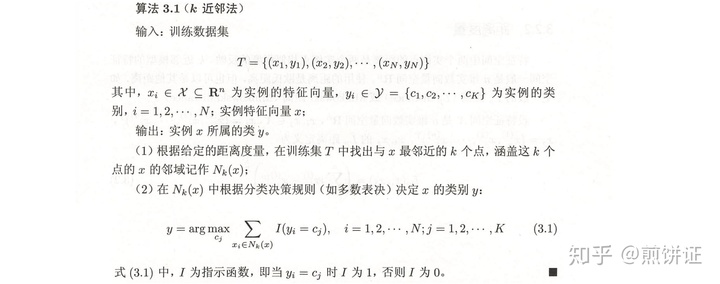

【算法3.1(k近邻法)】

- 当k=1时的特殊情况,称为最近邻算法。

3.2 k近邻模型

- k近邻法使用的模型实际上对应于对特征空间的划分,模型由三个基本要素决定——距离度量、k值选择、分类决策规则

- k近邻法中,当训练集、距离度量、k值、分类决策规则确定后,对于任一新的实例,其所属类别唯一确定。

- k近邻模型的距离度量一般使用欧式距离,也可以是更一般的

距离或Minkowski距离,设特征空间

是

维实数向量空间

,

,

,则

的

距离定义为:

- p=2时,为欧氏距离(Euclidean distance)

- p=1时,为曼哈顿距离(Manhattan distance)

- p=∞时,是各个坐标距离的最大值

- k值选择对k近邻法的结果有较大影响,较小的k值相当于用小邻域预测,学习的近似误差会减小,估计误差会增大,预测结果对邻近实例点非常敏感,即k值的减小意味着整体模型变复杂,容易过拟合;较大的k值相当于用大邻域预测,会减少估计误差,增大近似误差,整体模型变简单。

- 一般用交叉验证法选择最优k值

- k近邻法的分类决策规则通常是多数表决规则(majority voting rule),多数表决规则等价于经验风险最小化

- 假定分类的损失函数为0-1损失函数,分类函数为

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

984

984

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?