7月26日,智谱Maas开放平台(bigmodel.cn)正式上线了全新的视频生成大模型CogVideoX,成为国内首个通过API完成图片和文本视频生成任务的开放平台之一。用户无需排队即可轻松使用该平台,通过简单的API调用即可生成高质量定制视频内容,节省了用户的时间和精力。

CogVideoX模型的推出,为用户提供了一个便捷、高效、智能的视频生成工具,让用户可以快速将图片和文本转化为动态视频,满足各种场景下的需求,为用户带来了全新的体验和可能性。CogVideoX模型让用户可以轻松创建各种类型的视频内容,包括个人创意作品、商业宣传片、教育培训视频等,无论是个人用户还是企业机构,都可以通过这一平台快速实现视频内容的生成和定制,满足不同需求和用途。

我们第一时间对CogVideoX的API接口进行了深入评测,对文生视频Prompt进行调优。

1.开发环境配置:

Windows10 操作系统,其它可联网环境均可。

Python版本支持:正式版python 3.11 (亲测3.8, 3.9, 3.10, 3.11, 3.12都可以)。

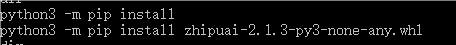

安装智谱Maas大模型接口 Python SD:pip install zhipuai

也可以参考官方文档安装:https://bigmodel.cn/dev/api#overview

注:调用文生图video接口,需要zhipuai sdk最新2.1.4版本,默认安装可能是2.1.0版本。可以print(zhipuai.__version__) 查看版本,如果不是,可以点击下方链接:https://github.com/MetaGLM/zhipuai-sdk-python-v4/releases/download/v2.1.4/zhipuai-2.1.4-py3-none-any.whl,下载最新whl到本地,按如下方式安装:

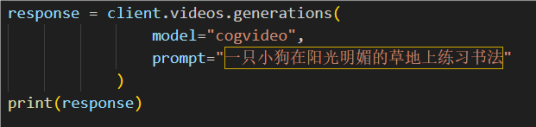

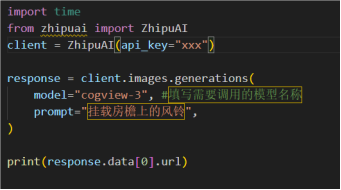

2.1行代码完成文生视频调用:

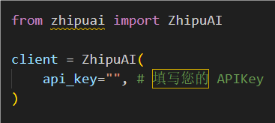

python sdk支持通过环境变量配置APIkey,创建Client。个人的APIkey可以注册智谱Maas平台后,在bigmodel.cn/usercenter/apikeys 页面申请。

通过调用Client对应的成员方法方式方便且快捷实现文生图功能。

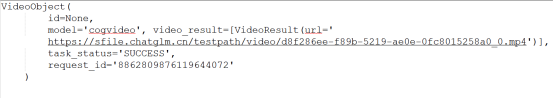

使用是异步调用的方式,调用完成会生成一个request_id,需要等待一段时间后,可以访问response状态“SUCCESS”和video_result获取生成视频。

将生成视频的url拷贝复制到浏览器打开或下载到本地,就可以看到视频内容了。

小狗画图

可见通过API方式调用文生视频非常的方便,只需要3行代码就完成了整个调用。此外,Maas平台还支持HTTP调用,支持主流第三方框架入OpenAI SDK和Langchain SDK的使用方式;开发语言支持主流Python和JAVA。更多使用可以参考官方接口文档(https://open.bigmodel.cn/dev/api)和使用指南(https://open.bigmodel.cn/dev/howuse/)。

3.1行代码完成图生视频调用

与文生视频的方式类似,先调用Maas平台文生图的接口生成一些测试用例:

生成的图片预览:

文生图的质量还是非常高的,然后增加url调用图生视频的接口,prompt指定希望图片主体想要实现动作,一行代码就可以得到需要视频。

4.文生视频深入体验

通过调用api的方式,随机尝试了一些Prompt看看生成视频的效果,结果让我感觉非常惊艳。

狮子在海底游泳

狮子在海底潜水

小老鼠在火山口烤玉米

老鼠在火山口烤玉米

北极冰原上的考察站

极地冰原上,一座废弃科考站,远处传来极光闪烁的极光

5.图生视频深度体验

同样调用api的方式,随机生成一些图片并制定主体相关的Prompt,通过图生成一视频,效果也非常不错。

可爱的小猫

一只可爱的小猫在和打招呼

风铃摆动

挂载房檐上的风铃在随风摆动

6.文生视频Prompt调优:

通过不停地调试prompt组成,我发现prompt工程对于生成视频质量有很大的影响。通过总结,我发现一条文生视频Prompt技巧:

提⽰词(Prompt)=镜头描述+主体描述+主体运动描述+场景描述

通过构成和调整这四个部分,可以明显提升生成视频的质量,举个例子:

Step1. 原始Prompt 镜头+主体:草原上有两头母狮

两只母狮

Prompt里面只有关于主体和镜头描述,生成视频也比较简单,就一个场景,草原上的两头狮子,相当于一张动图。

Step2. 增加主体运动描述:两头母狮在大草原上奔跑

狮子在蹦跑

生成视频比前一个版本更像一个视频,主体“狮子”奔跑起来了,也有一些场景的切换。但生成视频对主体“狮子”本身及主体运动细节描述并不清晰,导致生成视频清晰度并不高。

Step3. 增加主体细节描述及运动细节描述:两头雄壮的狮子在草原上奔跑,它们你追我赶,嘶吼着,眼睛炯炯有神,目光坚定而锐利,毛发在阳光下闪闪发光。

健壮的狮子

生成视频的质量有了明显的提升,主体“狮子”本身的细节,健硕身材描述更加清晰;对于狮子主体奔跑的刻画也更加清晰。但视频对于奔跑的场景刻画还是不够清晰,场景过于简单。

Step4. 增加场景刻画:

两头雄壮的母狮在绿草如茵的草原上奔跑,它们你追我赶,嘶吼着,眼睛炯炯有神,目光坚定而锐利,草原上有低矮的草地和高大的灌木,还有一些花朵。

,时长00:06

生成视频包含了灌木和乔木,以及一些花朵,视频的内容进一步丰富,质量进一步提升。

7.体验评测集展望

深度试用了智谱AIMaas开放平台最新的文生视频和图生视频接口,整体感觉:1. 通过API使用确实非常简单且方便;2. 文生图效果非常炸裂,文生/图生视频效果挺不错;3. 视频生成Prompt工程会直接影响生成视频效果。

文/图生成视频目前仍处于起步阶段,即使是智谱CogVideoX这样先进的模型也只能生成6秒钟的视频,通常存在明显的视觉缺陷。这可能是由于视频数据量庞大,需要更多的计算资源和时间来生成高质量的视频内容。文生成视频领域虽然面临着诸多挑战,但随着技术的不断进步和资源的不断投入,相信未来会取得更大的突破,为我们带来更加出色和引人入胜的文生成视频体验。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?