在日常工作中,我们经常会做一些PPT演示文档,在制作过程中都会些添加背景图片用来美化修饰,这时如果逐张幻灯片去插入背景或复制粘贴图片,会很麻烦,而且图片也很容易被误操作修改,其实有更快捷且不易被修改的方法——利用幻灯片母版设置背景。

我们首先来了解一下什么是母版,PPT母板就是一个格式模板,只需要在母版上预先设置好背景、配色方案、字体等,在使用时所有的幻灯片就都会跟着改变,插入新幻灯片时,也会把母版上的所有内容继承到新添加的幻灯片上。这样就能起到事半功倍的效果,今天就来和大家分享在PPT中如何设置母版的背景。

PPT母板

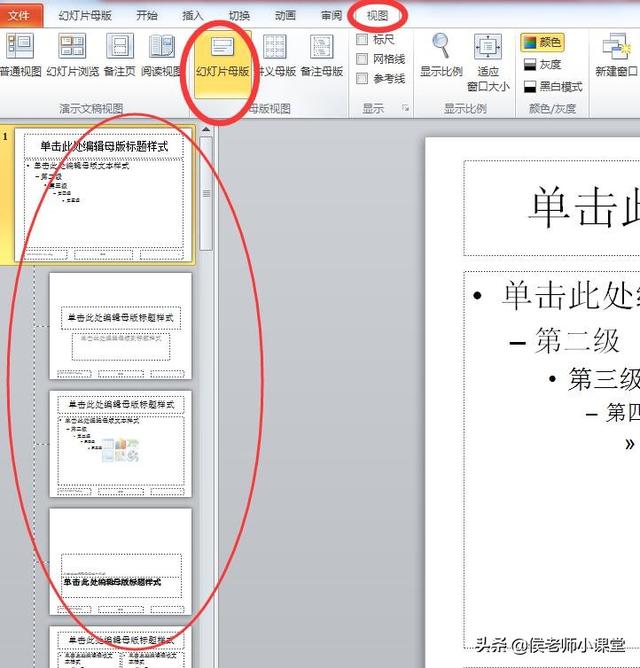

操作1:进入母版编辑模式

单击“视图”菜单——>选择“幻灯片母版”选项,即可进入幻灯片母版的编辑模式。

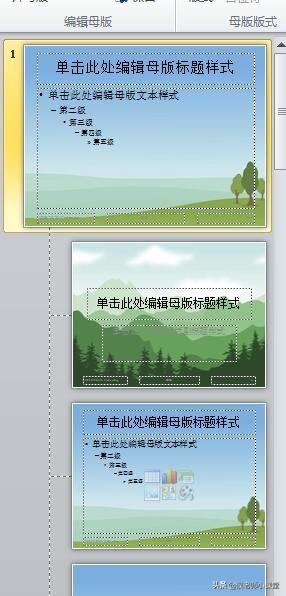

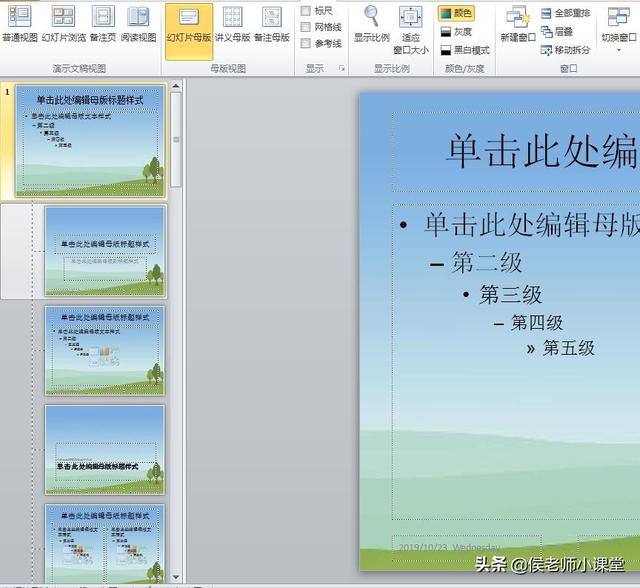

如下图,左侧为母版预览区,PPT默认有12张幻灯片母版页面。其中第一张为基础页,对它的格式内容进行的设置后,其余的页面上会自动显示。

幻灯片母版编辑模式

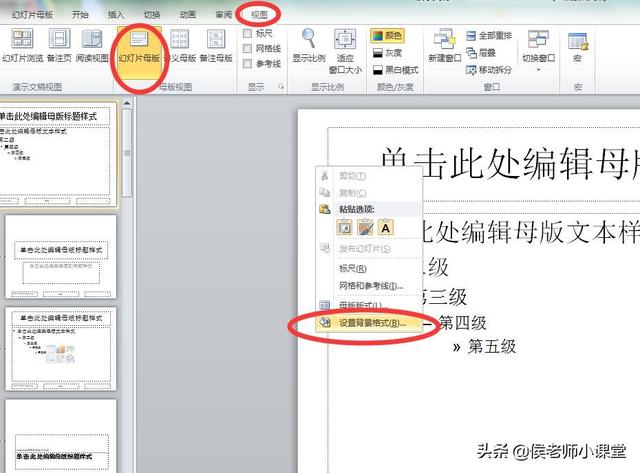

操作2:设置母版背景

单击选中左侧的第一张基础页——>在编辑区任意位置单击右键,在弹出的快捷菜单中选择“设置背景格式”;

设置背景格式

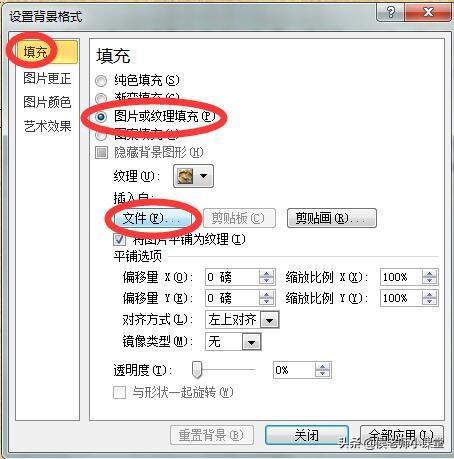

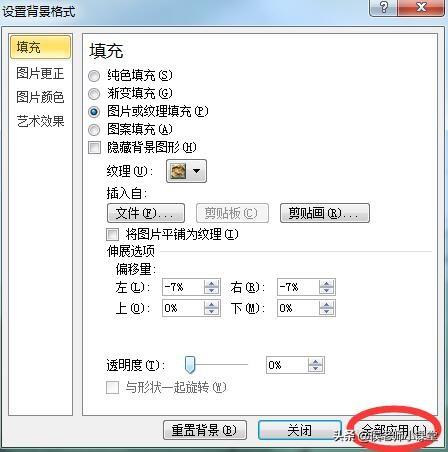

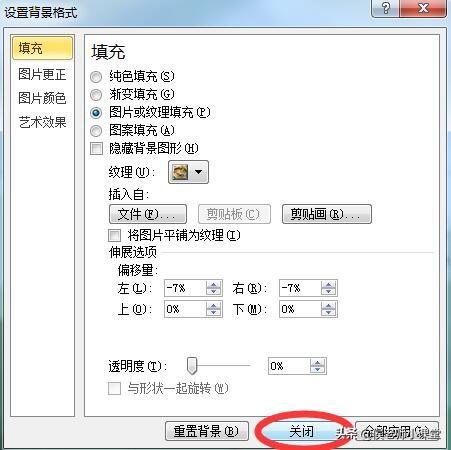

在弹出的设置背景格式对话框中选择“填充”——>选择右侧的“图片或纹理填充”——>单击插入“文件”按钮;

填充图片文件

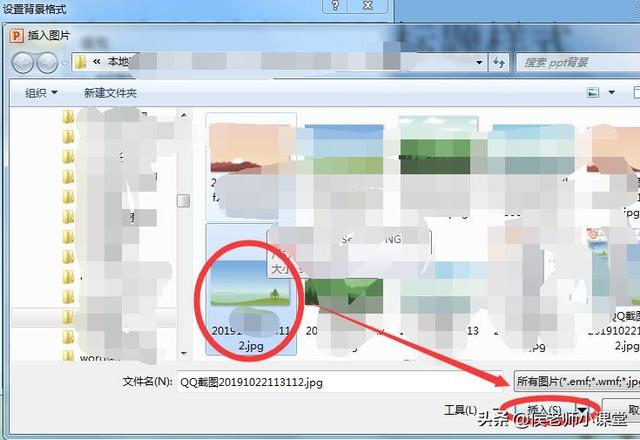

在弹出的插入图片对话框中找到电脑中存储的目标图片——>单击“插入”;

插入目标图片

返回到设置背景格式窗口,单击“全部应用”按钮即可。

全部应用

设置好后可以看到,不仅第一张基础页有了背景图片,它下方的11张默认的页面也都添加了同样的背景图片。

母版背景

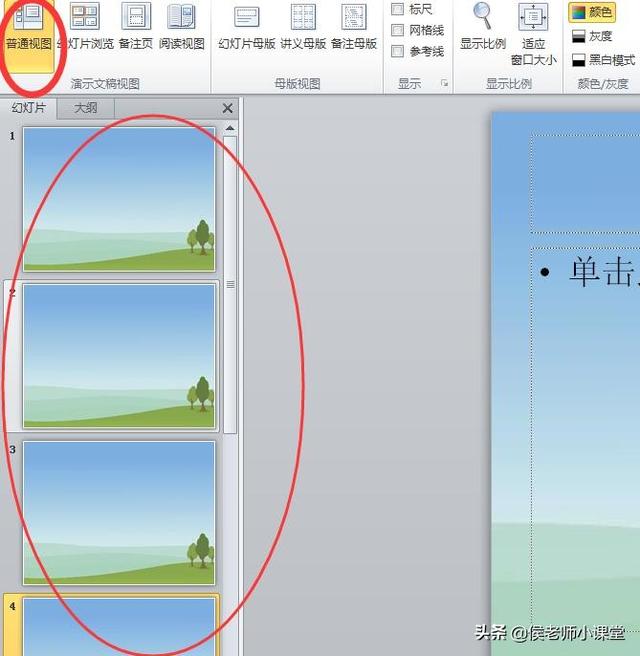

这时我们返回到“普通视图”可以看到所有的幻灯片已经添加了刚才母版背景,按enter回车键,会添加一张新的幻灯片,且背景会自动继承刚才设置的背景。

演示文档背景

操作3:设置封面背景:在母版中,第二张页面一般为封面,我们有时需要把封面设置成不同的背景,这时只需要在第二张母版页上插入背景图片即可,插入方法同上面基础页背景设置方法,所不同的是最后一步为单击“关闭”按钮,如下图:

设置封面背景

设置完成后我们切换到“普通视图”,可以看到封面页面背景改变了,而别的页面背景仍保持原来的状态。

封面背景效果

6806

6806

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?