攻击目标之前,最重要的是收集信息,搜索引擎就可以自动爬取网站的内容,不过搜索引擎都要遵守robots协议(这个...至于360搜索...),robots.txt是网站管理创建的一个txt文件,告诉搜索引擎哪些文件需要被爬取、哪些文件不希望被爬取。搜索引擎的spider的大致工作过程为首先请求一个页面,然后分析这个页面,查找该页面连接到其他内容的链接,然后再请求,如此循环。

我们可以使用工具来自动抓取Web站点的内容,工作原理与spider技术大致相同,但是这些工具可不受robots的约束,它们还会根据robots中禁止的目录来进行爬取。spider工具可以爬取网站的文件和目录,也可以分析HTML表单,并且可以按照指定的规则,提交表单。

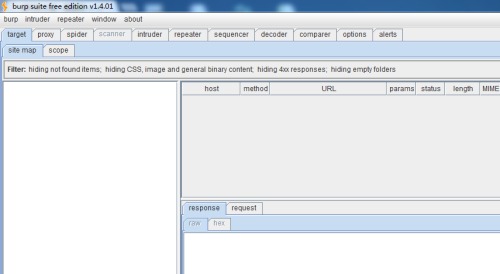

burp suite就是这样一款工具。界面如图:

探测网站(一)burp suite探测Web目录

最新推荐文章于 2024-04-16 14:33:13 发布

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1251

1251

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?